OpenClaw 不仅仅是一个名字花哨的聊天界面。它更像是一个 AI 代理的控制层,可以读取文件、调用工具,并在你常用的应用内做出响应。这种强大的功能正是其核心所在。也正因如此,你才不应该轻视它。如果你把它当作换了个 logo 的 ChatGPT 来看待,就会错过它的真正价值所在。只有把它当作基础设施来对待,才能真正发挥它的作用。.

OpenClaw 如何将聊天转化为行动

OpenClaw 不仅仅是一个带有插件的聊天界面。它作为一个本地网关,将你的聊天平台、AI 模型和动作层连接成一个统一的控制系统。它可以连接到 Telegram 或 Slack 等工具,连接到通过 Ollama 或 OpenAI 或 Anthropic 等云服务提供商在本地运行的模型,并通过持久化的本地内存管理文件访问、API 和脚本执行。所有数据都通过这个单一的网关进行传输。.

实际上,消息通过聊天窗口进入,代理对其进行评估,并可选择调用工具,然后返回结构化结果。它可以读取日志、汇总错误、创建工单、更新 CRM 记录或执行预定义脚本。上下文信息会在会话之间传递,这使得 OpenClaw 不仅仅是一个助手,而是一个运营层。.

FlyPix AI 和现实世界 AI 自动化

在 飞像素 AI, 虽然我们将人工智能代理应用于不同的领域,但原理类似。自动化只有与真实的运行数据直接连接才能创造价值。我们的平台专注于卫星、航空和无人机影像,利用人工智能模型大规模地检测、监控和检查目标。我们无需人工标注,而是通过训练模型实现地理空间分析的自动化,这些模型能够准确识别和勾勒目标轮廓。.

我们从一开始就将系统设计得实用性强。用户无需深厚的编程知识即可训练自定义AI模型,自定义标注,并将其应用于建筑、农业、基础设施维护和政府项目等各个行业。我们的重点不在于抽象的智能,而在于复杂视觉环境中可衡量的效率。.

您也可以在以下平台找到 FlyPix AI: LinkedIn 如果您想与我们联系,请访问我们的网站。对我们公司而言,人工智能并非实验性的,而是将可视化数据转化为结构化结果,供团队在实际运营中自信使用。.

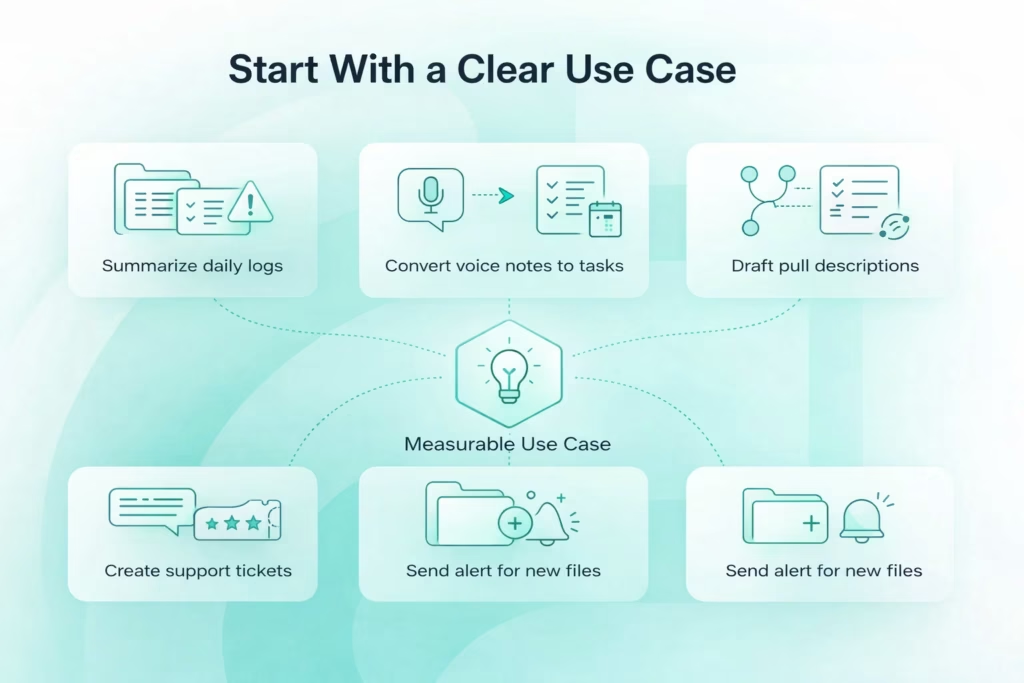

从明确的用例开始

人们在使用 OpenClaw 时犯的最大错误很简单:先安装后思考。当系统运行起来但用途不明确时,最终只会不断调整设置,而无法解决实际问题。在安装任何组件之前,务必先定义一个可衡量的使用场景。这个场景应该足够具体,以便你能清楚地判断它是否有效。一个好的初始目标通常是这样的:

- 汇总特定文件夹中的每日日志,并突出显示最新的关键错误。

- 将 Telegram 语音消息转换为带有标题和截止日期的结构化任务

- 使用仓库上下文和最近提交信息撰写拉取请求描述草稿

- 根据结构化的聊天输入创建具有优先级级别的支持工单

- 监控文件夹并在出现新文件时发送警报

每个示例都有清晰的触发条件、明确的输入和可观察的输出。这种结构使设置更加专注,避免了不必要的复杂性。从小处着手。如果目标模糊不清,你将花费更多时间修复架构,而不是创造价值。OpenClaw 与一个可衡量的工作流程绑定时效果最佳。一旦该循环稳定下来,扩展就应该有计划地进行,而不是随意尝试。.

为 OpenClaw 准备好您的系统

在运行安装程序之前,OpenClaw 的稳定配置就已经完成。它并非一个轻量级的聊天插件,而是一个本地网关,可以读取文件、执行工具并连接到外部模型。您的计算机、网络和权限都是系统的一部分。前期几分钟的准备工作可以避免之后数小时的故障排除。.

至少,你需要最新版本的 Node.js LTS、一个你用起来顺手的终端,以及 OpenAI 或 Anthropic 的云模型 API 密钥(如果你计划运行本地模型,则需要 Ollama)。Telegram 是最简单的测试界面。如果你打算运行本地模型,请根据实际情况规划硬件。16 GB 的内存是保证稳定运行的合理基准。更大的模型需要更多内存。.

您的环境至关重要。切勿盲目地将其安装在公司笔记本电脑上。切勿为了方便而公开端口。除非绝对必要,否则请避免使用管理员权限运行。OpenClaw 会读取本地文件并执行操作。这正是它的优势所在。请像对待任何可以直接访问您数据的系统一样谨慎对待它。.

OpenClaw 安装和初始设置

OpenClaw 更新迭代速度很快,因此最稳妥的做法是遵循官方安装流程。目标很简单——让网关稳定可靠地运行。目前不做任何实验,也不做任何自定义调整。只需要一个稳定的基础。.

1. 选择您的安装方式

根据当前发行版,您可以通过引导脚本或 npm 安装 OpenClaw。两种方法的目标相同——安装依赖项并注册网关服务。典型的引导流程如下:

| curl -fsSL https://openclaw.ai/install.sh | bash |

如果您更喜欢使用 npm,全局安装路径非常简单:

| npm install -g openclaw@latest |

两种方法都不应该感觉复杂。如果安装过程中出现错误,请先停止并解决问题后再继续。干净利落地安装比速度更重要。.

2. 运行入职流程

安装完成后,运行引导向导:

| 船上开爪 |

此步骤配置网关并将其设置为后台服务。完成后,系统应报告网关已激活。此时,OpenClaw 不仅已安装完毕,而且已可运行。.

3. 访问控制界面

默认情况下,控制界面(仪表盘)在本地运行:

| http://127.0.0.1:18789/(或 http://localhost:18789/) |

在浏览器中打开该地址。如果一切配置正确,您应该可以看到控制面板。如果无法加载,请检查以下内容:

- 确认网关服务正在运行

- 请确认没有其他进程正在使用端口 18789

- 检查本地防火墙设置

一条重要规则——网关必须绑定到本地主机,不要将其公开。控制界面管理着一个代理,该代理可以访问本地文件并执行工具。将访问权限限制在 127.0.0.1 可以确保在构建和测试过程中控制界面的安全。.

设置 Telegram 集成

Telegram 是激活 OpenClaw 最快捷的方式之一。设置简单,API 易于配置,几分钟内即可验证完整的消息循环。如果您专注于代理逻辑而非集成开销,那么 Telegram 是初始测试的理想选择。.

打开 Telegram,搜索 @BotFather,然后输入 /newbot。选择一个名称并复制提供的 API 令牌。在 OpenClaw 集成过程中,根据提示粘贴该令牌。保存后,网关会将您的本地代理连接到 Telegram。务必确保输入准确。一个错误的字符都可能导致连接中断。.

设置完成后,向您的机器人发送一条测试消息并检查控制界面。如果消息显示且 Telegram 收到回复,则说明循环运行正常。这确认了网关、模型和通信层协同工作。接下来,您就可以从设置阶段过渡到构建实际工作流程。.

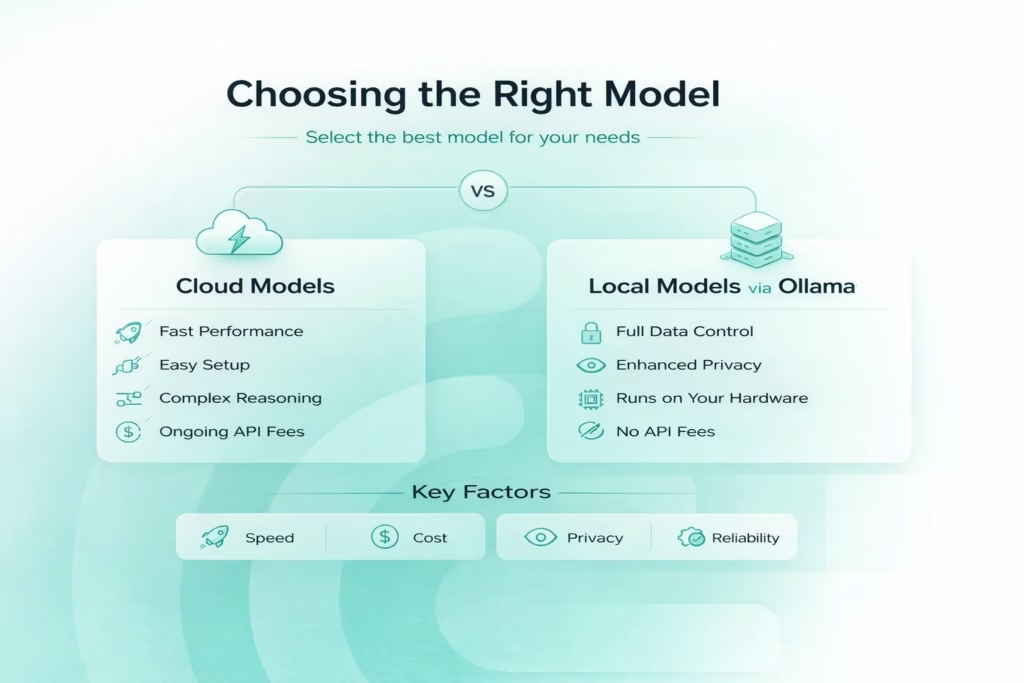

选择合适的型号

您选择的模型会直接影响速度、成本、隐私和整体可靠性。OpenClaw 的优势在于它不会将您锁定在单一供应商。但只有了解各种权衡取舍,灵活性才能真正发挥作用。主要有两种路径——云模型和本地模型。每种模型都满足不同的运营需求。.

1. 云模型——快速、强大、低摩擦

云模型是无需担心硬件即可获得强大推理性能的最快方式。您只需连接 API 密钥、配置提供商,代理即可投入使用。云模型通常最适合以下场景:

- 复杂推理和结构化决策

- 编码工作流程和调试

- 快速设置,配置极少

- 不想管理基础设施的团队

诸如 Claude 3.5 Sonnet 和 GPT-4 类系统之类的模型能够高可靠性地处理智能体工作流程。它们能够清晰地理解指令,很好地处理多步骤推理,并快速响应。其优缺点也很明显:

- 持续的 API 成本

- 数据传输到您的本地环境之外

- 对外部正常运行时间的依赖

对许多用户来说,这可以接受。但对另一些用户,尤其是在敏感环境下,则可能无法接受。.

2. 通过 Ollama 实现本地模型——控制与遏制

如果您重视隐私和自主性,那么通过 Ollama 运行本地模型是一个明智的选择。在这种设置下,模型始终保留在您的计算机上,无需调用外部 API,数据也不会离开您的网络。它非常适合以下场景:

- 数据敏感型工作流程

- 开发环境

- 离线能力

- 对执行过程拥有完全控制权

Ollama 支持 Qwen2.5-Coder、GLM-4 系列、Llama 3.1/3.2 变体以及其他具有适合智能体使用的大上下文窗口模型。对于 OpenClaw 而言,上下文大小至关重要。.

智能体依赖模型的上下文窗口来管理内存,因此较小的窗口可能会降低长时间会话中的一致性。32k-128k 的上下文窗口是稳定推理的实用基准(具体取决于模型;许多推荐用于 OpenClaw 的 Ollama 模型都从 32k-128k 开始)。.

性能取决于您的硬件。如果响应速度变慢或工具调用延迟,通常是资源不足,而非配置错误。关键在于选择一款适合您可用内存和处理能力的型号。.

3. 做出务实的选择

没有通用的答案。有些团队使用云模型进行繁重的推理,而使用本地模型进行开发或处理敏感任务。另一些团队则完全采用一种方法。选择时应考虑以下因素:

- 您的数据敏感性

- 性能要求

- 预算限制

- 硬件能力

合适的模型不仅能提升响应速度,还能稳定整个工作流程。当模型层与您的运营需求相匹配时,OpenClaw 就能以可预测且高效的方式运行。.

理解持久记忆

持久化记忆是 OpenClaw 区别于普通聊天助手的一大特色。它并非每次都从头开始,而是使用 SQLite 进行索引,将数据以分块 Markdown 文件作为数据源,并采用混合搜索(BM25 + 向量嵌入)的方式,将持久化记忆存储在本地。这不仅仅是聊天记录,更是一个组织有序的上下文信息库,供智能体在后续决策时参考。.

例如,您可以告诉代理:“我的内部仪表盘使用 React 和 Tailwind,最好使用函数式组件。”几天后,您又要求它构建一个头部组件。如果内存管理正常,它会遵循您之前的偏好设置,而无需您重复。这种连续性源于存储的上下文信息被反馈到推理过程中。.

这就是效率随时间提升的原因。您无需在每次会话中都重写指令,而是在系统内部积累持久的上下文信息。定期检查存储的内存,了解哪些内容被保存下来,是非常有价值的。当您了解内存的工作原理时,随着工作流程的扩展,您就能保持代理的一致性和可预测性。.

构建你的第一个真正的工作流程

连接稳定后,就可以从对话过渡到执行。OpenClaw 的实用性体现在执行结构化任务,而不仅仅是回复开放式问题。这就需要清晰地定义工作流程,以便智能体知道该做什么以及如何确认结果。一个可靠的工作流程始终包含四个组成部分:

- 扳机: 激活该流程的具体命令或事件,例如在 Telegram 中输入“新建工单”。.

- 输入结构: 代理完成任务所需的确切数据,例如标题、描述和紧急程度。.

- 工具执行: 代理执行的已定义操作,例如向您的票务系统 API 发送请求。.

- 确认输出: 提供结构化的回复以证明已完成,例如返回工单 ID 和简短摘要。.

以工单自动化为例。当您输入“新建工单”时,客服人员应自动收集所需字段,调用 API,并返回确认信息。无需猜测,无需假设。清晰的触发器和结构化的输入确保流程的可靠性。建议先从单一的工作流程入手,使其稳定运行,然后再逐步扩展。.

在真实环境中运行 OpenClaw

一旦您的第一个工作流程稳定下来,真正的应用就开始了。此时,OpenClaw 要么成为您日常运营的一部分,要么仍然只是一个技术实验。区别不在于添加更多自动化步骤,而在于观察现有流程在实际条件下的运行情况。让它运行起来,用不同的输入进行测试,观察它在极端情况下的运行情况,然后再进一步扩展。.

在日常使用中,可见性至关重要。请查看控制界面中的活动。检查哪些工具被触发以及输出的结构。如果结果不一致,通常是由于范围偏移或指令不明确,而不是模型本身的局限性。对结构进行小幅改进通常比更改模型本身更能提高稳定性。.

扩展应当有计划。逐步添加新任务,并将其与现有流程隔离,直至其行为可预测。OpenClaw 在工作流程清晰明确且内存使用量适中时表现最佳。日常使用并非持续不断的实验,而是对您理解并能自信管理的 AI 系统进行可控的扩展。.

实用建议和避免常见错误

OpenClaw 可以稳定运行数月,也可能变成一场永无止境的故障排除。区别通常在于管理规范。大多数问题并非源于模型本身,而是来自配置决策、不明确的范围或被忽略的边界。以下列出了区分稳定部署和脆弱部署的最常见陷阱和性能习惯。.

应避免的操作失误

这些模式在实际部署中反复出现。它们可能不会立即导致系统崩溃,但随着时间的推移,会造成风险和不稳定。.

- 未经批准在公司设备上安装: OpenClaw 读取本地文件,并可将数据发送到外部模型,这可能违反内部策略。.

- 未经审查就将专有代码导入云模型: 通过 API 传输的敏感数据可能会引发合规性和安全问题。.

- 授予不受限制的文件系统访问权限: 除非绝对必要,否则代理人不应该有权访问您的整个主目录。.

- 为了方便起见,暴露网关端口: 公开开放 18789 端口会增加攻击面,而没有实际好处。.

- 将记忆视为绝对可靠: 持久内存功能强大,但如果不定期检查,可能会存储过时或不正确的上下文信息。.

- 第一个工作流程过于复杂: 从多步骤自动化流程而非简单任务入手会增加配置错误。.

指导原则很简单——保持范围狭窄,限制权限,并在稳定性得到证明后逐步扩展。.

性能和稳定性优化

如果性能不稳定,原因通常是结构性问题,而非难以解释的原因。OpenClaw 依赖于模型容量、内存管理和清晰的提示信息。一些小的调整通常就能带来显著的改善。.

- 本地运行时,请减小模型大小: 较大的模型需要更多的内存和处理能力,这会增加延迟。.

- 如果条件允许,请增加可用内存: 当系统有足够的余量时,局部推理能力会提高。.

- 清理过多的内存占用: 长时间运行且存储大量上下文信息的会话会降低处理速度。.

- 限制工具调用循环次数: 重复或嵌套调用工具可能会造成不必要的延迟。.

- 使用结构化提示而不是开放式指令: 清晰的输入可以减少令牌使用量并提高响应精度。.

当指令范围明确且资源与工作负载相匹配时,性能会得到提升。OpenClaw 不需要持续调优,它需要精心配置和合理的预期。当这些条件都满足时,系统就能保持高效和可预测性。.

结论

当你不再把 OpenClaw 当作聊天机器人,而是把它当作基础设施来对待时,它就能真正发挥出强大的作用。关键不在于巧妙的回复,而在于可控的执行。当你明确目标、正确配置网关、选择合适的模型并精心构建初始工作流程时,系统就会从实验阶段转变为实际运行阶段。.

关键在于自律。一开始要缩小范围。保护好你的环境。先构建一个可靠的工作流程,然后再逐步扩展。OpenClaw 重视清晰性。你的输入和权限越清晰,结果就越可预测。如果使用得当,它不仅仅是一个附带工具的消息传递层,而是一个可控的 AI 执行层,可以集成到实际工作中。这才是它的价值所在。.

常问问题

只要按照官方指令操作,安装本身并不复杂。大多数问题并非源于技术复杂,而是源于目标不明确。如果在安装前明确一个具体的工作流程,安装过程就会顺畅得多。.

是的,如果您通过 Ollama 使用本地模型。在这种配置下,模型和网关都在您的计算机上运行,无需调用外部 API。请注意,性能取决于您的硬件配置。.

这取决于贵公司的政策。OpenClaw 可以读取本地文件并与外部模型交互。未经批准将其安装在公司设备上可能违反内部安全规则。最好使用个人电脑或专用环境。.

先从一些可衡量且风险较低的任务入手,例如日志汇总、撰写结构化消息或创建工单。初期避免复杂的多步骤自动化流程。在这个阶段,稳定性比雄心壮志更重要。.

持久化记忆允许智能体在不同会话之间保留上下文信息,从而提高交互的连续性。然而,更大的上下文窗口和更长的会话时间会增加资源消耗,尤其是在使用本地模型时。定期检查存储的记忆有助于保持上下文的清晰度和效率。.