La reconnaissance d'images peut paraître complexe, mais son principe de base est étonnamment simple. Une machine analyse les images comme des données, apprend des schémas à partir d'exemples et utilise cette expérience pour reconnaître ce qu'elle voit la fois suivante. La difficulté réside dans la préparation de ces exemples, l'apprentissage du modèle et la robustesse de cet apprentissage en conditions réelles.

Dans cet article, nous allons explorer étape par étape le fonctionnement de la reconnaissance d'images en apprentissage automatique. Pas de mathématiques complexes, pas de jargon inutile. Juste une explication claire de la transformation des images en signaux, de l'apprentissage des modèles pour les interpréter et des raisons pour lesquelles certains systèmes fonctionnent bien en conditions réelles tandis que d'autres échouent.

Que signifie réellement la reconnaissance d'images en apprentissage automatique ?

La reconnaissance d'images repose essentiellement sur la classification et l'identification. Un système reçoit une image et répond à des questions telles que :

- Que représente cette image ?

- Où se trouve un objet précis ?

- Combien d'objets sont présents ?

- Ces images appartiennent-elles à la même catégorie ?

En apprentissage automatique, la reconnaissance d'images fait partie de la vision par ordinateur. La vision par ordinateur vise à apprendre aux machines à interpréter les données visuelles de manière à faciliter la prise de décision.

Il est essentiel de comprendre d'emblée que les machines ne perçoivent pas les images comme les humains. Une personne voit un chat. Une machine voit une grille de chiffres. Tout ce qui suit en matière de reconnaissance d'images vise à combler cet écart.

Comment les machines perçoivent les images

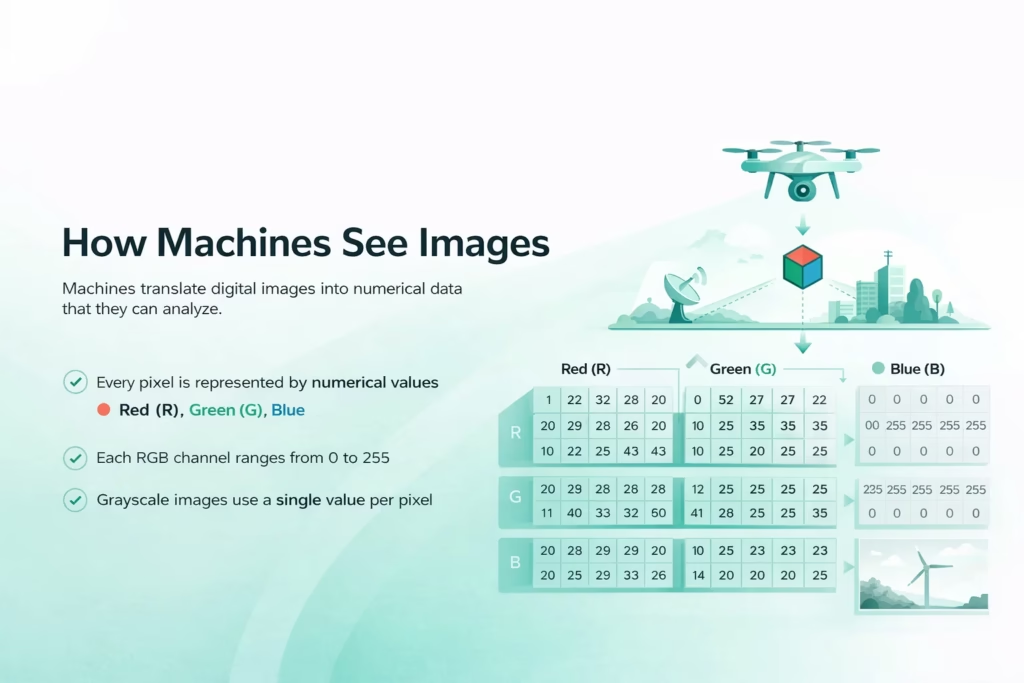

Avant tout apprentissage, une image doit être convertie dans un format exploitable par une machine. Les images numériques sont composées de pixels. Chaque pixel contient des valeurs numériques qui décrivent l'intensité de la couleur.

Dans une image RGB standard, chaque pixel contient trois valeurs :

- Rouge

- Vert

- Bleu

Chaque valeur est généralement comprise entre 0 et 255. Un pixel noir est représenté par des zéros. Un pixel blanc utilise les valeurs maximales. Une image complète est simplement une grande matrice de ces nombres.

Les images en niveaux de gris simplifient cela en utilisant une seule valeur par pixel, ce qui réduit la complexité et est souvent suffisant pour les tâches qui reposent sur la forme ou le contraste plutôt que sur la couleur.

À ce stade, l'image est dénuée de sens. Ce ne sont que des données. Tout l'enjeu de la reconnaissance d'images est d'identifier les motifs pertinents au sein de ces données.

Le rôle des données dans la reconnaissance d'images

Une bonne reconnaissance d'images repose sur des données de qualité. C'est là que de nombreux projets réussissent ou échouent, bien avant même l'entraînement du modèle. Même les algorithmes les plus performants peinent lorsque les images sous-jacentes ne reflètent pas les conditions réelles d'utilisation.

Collecte de données

L'ensemble de données doit refléter les conditions auxquelles le modèle sera confronté après son déploiement. Les images capturées en environnement contrôlé correspondent rarement à la variabilité du monde réel : l'éclairage change, les angles de vue se modifient, les objets se chevauchent et la résolution varie.

Un ensemble de données utile comprend

- Différents points de vue

- Variations d'éclairage

- Arrière-plans réalistes

- Exemples imparfaits ou bruités

Si un modèle est entraîné uniquement sur des images nettes et idéales, il est probable qu'il soit peu performant dans des conditions réelles où les conditions sont imprévisibles.

Étiquetage et annotation

Pour l'apprentissage supervisé, les images doivent être étiquetées. Les étiquettes indiquent au modèle ce qu'il doit apprendre. Cela peut être aussi simple que d'attribuer un nom de catégorie ou aussi précis que de définir les contours exacts des objets au niveau du pixel.

Types d'annotations courants

- Étiquettes au niveau de l'image pour la classification

- Boîtes englobantes pour la détection d'objets

- Masques de pixels pour la segmentation

- Points clés pour l'estimation de la pose

La qualité des annotations prime sur leur quantité. Des étiquettes incohérentes ou inexactes perturbent le modèle et limitent sa capacité à généraliser au-delà des données d'entraînement.

Comment nous utilisons la reconnaissance d'images dans l'analyse géospatiale chez FlyPix AI

À FlyPix AI, Nous appliquons la reconnaissance d'images à des données géospatiales réelles, notamment des images satellitaires, aériennes et de drones. Ces ensembles de données sont complexes et denses, ce qui rend l'analyse manuelle lente et incohérente. L'apprentissage automatique nous permet de détecter, de surveiller et d'inspecter de vastes zones avec précision en un temps considérablement réduit.

Notre plateforme utilise des agents d'IA pour identifier et délimiter des milliers d'objets dans des scènes complexes. Les utilisateurs peuvent entraîner des modèles personnalisés à l'aide de leurs propres annotations, sans avoir besoin de compétences en programmation ni d'expertise pointue en IA. La reconnaissance d'images devient ainsi accessible au quotidien, et non plus réservée aux équipes techniques.

Nous privilégions la rapidité et l'efficacité. Des tâches qui prenaient auparavant des heures, voire des jours, peuvent désormais être réalisées en quelques secondes, permettant aux équipes de passer plus rapidement de l'analyse d'images à la prise de décision. Les secteurs de la construction, de l'agriculture, des opérations portuaires, de la foresterie, des infrastructures et les projets gouvernementaux bénéficient tous de cette approche.

Pour nous, la reconnaissance d'images ne se limite pas à la détection. Il s'agit de transformer des données visuelles en informations fiables, valides en conditions réelles.

Prétraitement : Préparation des images pour l’apprentissage

Les images brutes sont rarement utilisées telles quelles. Le prétraitement améliore la cohérence et aide les modèles à apprendre plus efficacement les schémas pertinents en réduisant les variations inutiles avant même le début de l'entraînement.

Cette étape consiste généralement à redimensionner les images à une forme fixe afin que le modèle reçoive une entrée uniforme, à normaliser les valeurs des pixels pour maintenir la stabilité des plages numériques, à convertir les espaces colorimétriques lorsque les informations de couleur ne sont pas essentielles, à réduire le bruit causé par les capteurs ou la compression et à recadrer les régions qui ne contribuent pas à un signal utile.

La normalisation joue un rôle particulièrement important. En ramenant les valeurs des pixels à une plage cohérente, le modèle évite l'instabilité numérique pendant l'entraînement et converge de manière plus fiable.

L'augmentation des données est souvent appliquée en parallèle du prétraitement. Des techniques telles que la rotation, le retournement, le zoom et le réglage de la luminosité introduisent des variations contrôlées dans l'ensemble de données sans nécessiter la collecte de nouvelles images. Cela contribue à réduire le surapprentissage et améliore la capacité du modèle à gérer les changements de perspective, d'éclairage et d'orientation dans le monde réel.

Extraction de caractéristiques dans l'apprentissage automatique traditionnel

Avant que l'apprentissage profond ne devienne dominant, la reconnaissance d'images reposait largement sur l'extraction manuelle de caractéristiques. Les ingénieurs définissaient les caractéristiques visuelles sur lesquelles le modèle devait se concentrer.

Les caractéristiques typiques des produits artisanaux comprennent :

- Bords

- Coins

- Motifs de texture

- Dégradés

Des méthodes telles que l'histogramme des gradients orientés, les motifs binaires locaux et le sac de caractéristiques transforment les images en vecteurs numériques de longueur fixe.

Ces approches fonctionnaient bien pour des tâches spécifiques, mais exigeaient une solide expertise du domaine. Elles peinaient également à s'adapter aux changements de conditions visuelles. Chaque nouveau scénario nécessitait un réglage manuel.

Apprentissage profond et apprentissage automatique des caractéristiques

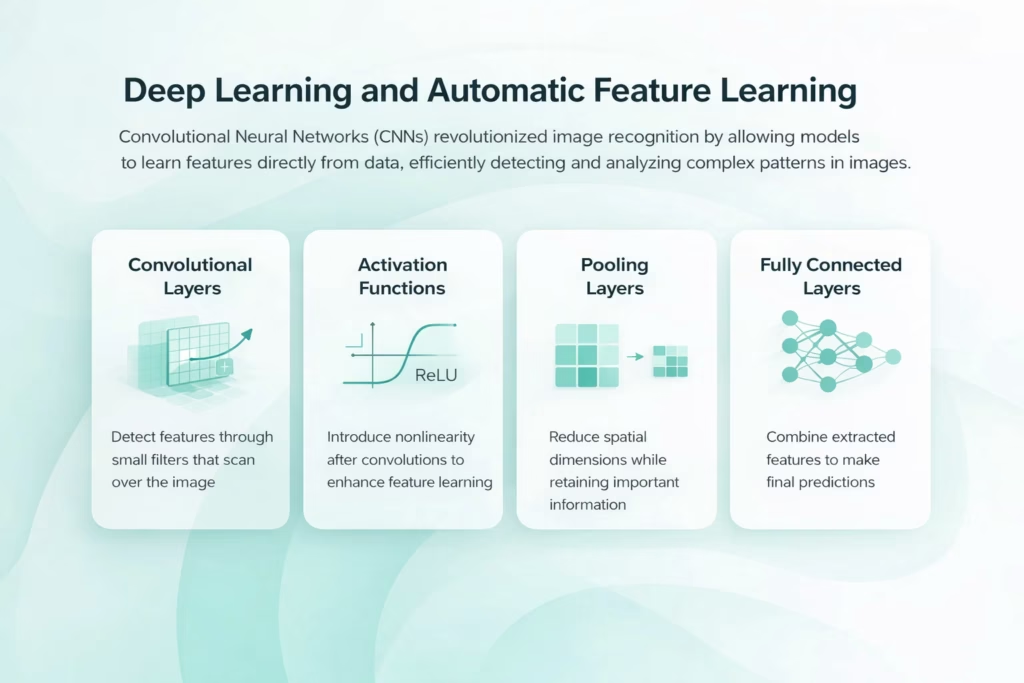

L'apprentissage profond a révolutionné la reconnaissance d'images en éliminant le besoin de caractéristiques prédéfinies. Au lieu d'indiquer au modèle ce qu'il doit rechercher, les ingénieurs lui permettent d'apprendre les caractéristiques directement à partir des données. Les réseaux de neurones convolutifs (CNN) constituent l'épine dorsale de la reconnaissance d'images moderne. Ils sont conçus pour exploiter la structure spatiale des images.

Couches convolutives

Les couches convolutionnelles appliquent de petits filtres à l'image. Ces filtres réagissent aux motifs locaux tels que les contours ou les textures. Les premières couches détectent les formes simples. Les couches plus profondes les combinent pour former des structures plus complexes. Cette approche par couches reflète la façon dont les humains traitent l'information visuelle, des lignes simples aux objets complets.

Fonctions d'activation

Après chaque convolution, les fonctions d'activation introduisent une non-linéarité. Cela permet au réseau de modéliser des relations complexes plutôt que de simples schémas linéaires.

Couches de regroupement

Le regroupement réduit les dimensions spatiales tout en préservant les caractéristiques importantes. Cela permet aux modèles de mieux gérer les petits décalages ou distorsions de la position des objets.

Couches entièrement connectées

Vers la fin du réseau, les caractéristiques extraites sont combinées et évaluées pour effectuer des prédictions. Ces couches intègrent des informations provenant de l'ensemble de l'image.

Le processus de formation étape par étape

L'entraînement d'un modèle de reconnaissance d'images est un processus itératif. Il implique une exposition répétée à des données étiquetées et un ajustement progressif des paramètres internes.

1. Passe en avant

Le modèle traite une image et produit une prédiction.

2. Calcul des pertes

La prédiction est comparée à l'étiquette réelle. Une fonction de perte mesure l'écart entre la prédiction et la réalité.

3. Rétropropagation

Le modèle ajuste ses pondérations internes pour réduire l'erreur. Cela se produit en propageant la perte à rebours à travers le réseau.

4. Optimisation

Un optimiseur met à jour les paramètres en fonction des gradients. Au fil des itérations, le modèle améliore sa précision. L'entraînement se poursuit jusqu'à ce que les performances se stabilisent ou atteignent un niveau acceptable sur les données de validation.

Détection d'objets et segmentation d'images

La reconnaissance d'images ne se limite pas à la classification. Dans de nombreuses situations concrètes, la simple présence d'un objet dans une image ne suffit pas. Les systèmes doivent souvent comprendre la position des objets, leur nombre et leurs interactions avec leur environnement. Ce besoin de perception spatiale est au cœur de la détection d'objets et de la segmentation d'images.

- La détection d'objets identifie la nature des objets et leur position dans l'image. Le modèle trace généralement des cadres de délimitation autour des objets et attribue une étiquette de classe à chaque cadre. Parmi les familles de modèles courantes, on trouve Faster R-CNN, SSD et YOLO ; le choix dépend souvent du compromis entre vitesse et précision.

- La segmentation d'image étiquette les pixels plutôt que de dessiner des rectangles, ce qui permet d'obtenir des contours beaucoup plus précis. Cette technique est utile lorsque les formes sont irrégulières, que les objets se chevauchent ou que la précision des bords est importante. La segmentation d'instance sépare les objets individuels d'une même classe, tandis que la segmentation sémantique étiquette les régions par catégorie sur l'ensemble de l'image.

Apprentissage supervisé, non supervisé et auto-supervisé

La plupart des systèmes de reconnaissance d'images reposent sur l'apprentissage supervisé, mais d'autres approches prennent une importance croissante à mesure que la disponibilité des données et les contraintes des projets évoluent.

Apprentissage non supervisé

Les modèles non supervisés découvrent des motifs sans étiquettes. Ils regroupent les images en fonction de leur similarité. Ceci est utile lorsque les données étiquetées sont rares.

Apprentissage auto-supervisé

Les méthodes d'apprentissage auto-supervisé génèrent des signaux d'apprentissage à partir des données elles-mêmes. Des tâches comme la prédiction des parties manquantes d'une image permettent aux modèles d'apprendre des représentations utiles avec un minimum d'étiquetage. Ces approches sont particulièrement précieuses pour les ensembles de données volumineux ou spécialisés.

Déploiement et contraintes du monde réel

Un modèle entraîné n'est utile que s'il fonctionne de manière fiable après son déploiement. C'est là que de nombreux systèmes de reconnaissance d'images rencontrent des difficultés, non pas à cause d'une mauvaise conception du modèle, mais parce que les conditions réelles correspondent rarement à l'environnement d'entraînement.

Une fois déployés, les modèles sont souvent confrontés à des variations de qualité d'image dues aux différentes caméras, aux niveaux de compression ou au flou de mouvement. Les objets peuvent apparaître sous des formes ou dans des contextes inhabituels, et des facteurs environnementaux tels que l'éclairage, les conditions météorologiques ou l'encombrement de l'arrière-plan peuvent introduire des motifs que le modèle n'a jamais rencontrés auparavant. Les limitations matérielles jouent également un rôle, notamment lorsque les modèles doivent s'exécuter sur des appareils aux ressources limitées plutôt que sur des serveurs puissants.

Les systèmes de reconnaissance d'images peuvent fonctionner dans le cloud ou directement sur les appareils en périphérie du réseau. Le déploiement dans le cloud offre une plus grande capacité de calcul et des mises à jour plus faciles, tandis que le déploiement en périphérie améliore la confidentialité, réduit la latence et permet aux systèmes de fonctionner sans connexion permanente. En contrepartie, la puissance de traitement est limitée, ce qui nécessite souvent des modèles plus petits ou optimisés.

Pour rester performants dans le temps, les modèles déployés nécessitent une surveillance continue. Leurs performances peuvent se dégrader en fonction de l'évolution de la distribution des données, ce qui impose un réentraînement et un ajustement périodiques. Il est donc essentiel de considérer le déploiement comme un processus continu, et non comme une étape finale, afin de garantir une reconnaissance d'images fiable en conditions réelles.

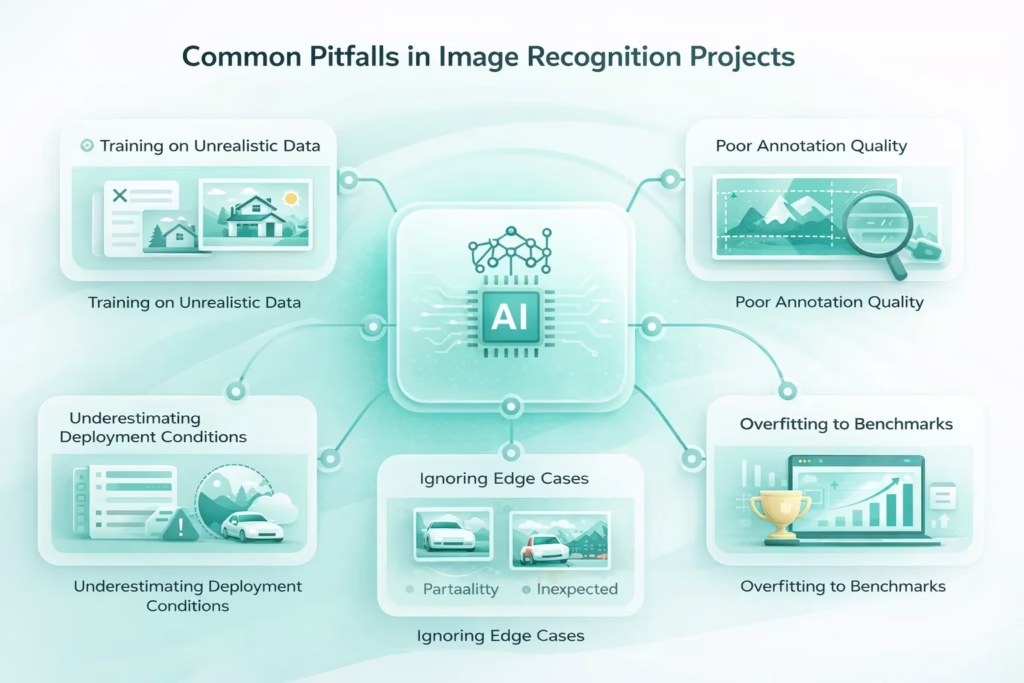

Pièges courants dans les projets de reconnaissance d'images

Même les systèmes de reconnaissance d'images les mieux conçus peuvent échouer si quelques problèmes récurrents sont négligés. Ces problèmes ont tendance à apparaître non pas pendant le développement, mais après que le modèle a été exposé à des conditions réelles d'utilisation.

- Entraînement sur des données irréalistes. Les modèles entraînés uniquement sur des images nettes, bien éclairées et parfaitement cadrées ont souvent des difficultés dans le monde réel. Le bruit de l'appareil photo, le flou de mouvement, les ombres et les occlusions partielles peuvent réduire considérablement la précision s'ils ne sont pas représentés dans l'ensemble d'entraînement.

- Mauvaise qualité des annotations. Des étiquettes incohérentes, des objets manquants ou des contours imprécis introduisent de la confusion lors de l'entraînement. Un ensemble de données plus petit, mais avec des annotations de haute qualité, est généralement plus performant qu'un grand ensemble de données mal étiqueté.

- En ignorant les cas limites. Il est facile de négliger les situations rares, les apparences inhabituelles des objets ou les arrière-plans inattendus. Ces cas particuliers sont souvent à l'origine des défaillances les plus graves après le déploiement.

- Surapprentissage par rapport aux points de référence. Optimiser les modèles pour obtenir de bonnes performances sur des jeux de données standard peut donner une fausse impression de succès. Des scores élevés aux tests de référence ne garantissent pas toujours des performances fiables sur des données personnalisées ou spécifiques à un domaine.

- Sous-estimation des conditions de déploiement. Les modèles se comportent différemment une fois déployés. Les variations de résolution d'image, les contraintes matérielles, la latence du réseau ou les conditions environnementales peuvent toutes avoir un impact sur les performances.

Les systèmes de reconnaissance d'images performants reposent sur des boucles de rétroaction continues, des contrôles réguliers des performances et des tests en conditions réelles. Considérer le déploiement comme un processus continu plutôt que comme une étape finale fait toute la différence entre un modèle prometteur sur le papier et un modèle fonctionnel en pratique.

Réflexions finales

La reconnaissance d'images en apprentissage automatique n'a rien de magique. C'est un processus structuré qui repose sur les données, l'apprentissage et l'itération. Les machines ne comprennent pas les images au sens humain du terme. Elles apprennent les associations entre les motifs et les résultats.

La puissance de la reconnaissance d'images ne réside pas dans un algorithme isolé, mais dans le système qui l'entoure : la qualité des données, la stratégie d'apprentissage, la rigueur de l'évaluation et un déploiement soigné.

Lorsque tous ces éléments sont réunis, la reconnaissance d'images devient un outil fiable plutôt qu'une simple démonstration. Et c'est ce qui la rend pratique.

Questions fréquemment posées

La reconnaissance d'images en apprentissage automatique consiste à enseigner à un système comment identifier et classer des objets, des motifs ou des caractéristiques dans des images. Le modèle apprend à partir de données visuelles étiquetées ou non et utilise cette expérience pour interpréter de nouvelles images qu'il n'a jamais vues auparavant.

Les machines ne perçoivent pas les images comme des objets ou des scènes. Elles les traitent comme des données numériques composées de valeurs de pixels. Les modèles de reconnaissance d'images apprennent à identifier des motifs dans ces nombres, tels que les contours, les textures et les formes, et les associent à des résultats connus grâce à l'apprentissage.

La reconnaissance d'images consiste généralement à identifier les éléments présents dans une image, souvent de manière générale. La détection d'objets va plus loin en identifiant les objets individuels et en les localisant dans l'image à l'aide de cadres de délimitation. La détection apporte une dimension spatiale que la simple classification ne permet pas.

La détection d'objets délimite les objets à l'aide de rectangles, tandis que la segmentation d'image étiquette chaque pixel. La segmentation permet des contours plus précis et est utilisée lorsque la forme ou la région exacte est importante, comme en imagerie médicale ou en analyse satellitaire.

Le modèle ne peut apprendre qu'à partir des données qu'il reçoit. Des images de mauvaise qualité, des étiquettes incohérentes ou des exemples d'entraînement irréalistes entraînent de faibles performances. Des données de haute qualité et bien annotées ont généralement un impact plus important que des architectures de modèles plus complexes.

La quantité de données dépend de la complexité de la tâche et du modèle utilisé. Les tâches de classification simples peuvent nécessiter des milliers d'images, tandis que les tâches de détection ou de segmentation plus complexes peuvent en exiger beaucoup plus. L'apprentissage par transfert et les approches auto-supervisées permettent de réduire les besoins en données.