L'entraînement d'un modèle de reconnaissance d'images repose moins sur des algorithmes sophistiqués que sur la maîtrise des fondamentaux. Des données de qualité, des étiquettes claires et un processus d'entraînement rigoureux sont bien plus importants que de privilégier les architectures les plus récentes. Négliger l'un de ces aspects, même le meilleur modèle aura du mal à fonctionner en situation réelle.

Ce guide explique comment les équipes entraînent concrètement des modèles de reconnaissance d'images performants en conditions réelles. Sans jargon théorique ni approche académique, il présente clairement les points essentiels, les erreurs fréquentes et comment construire un modèle fiable qui apprend et s'améliore avec le temps.

En quoi consiste réellement l'entraînement d'un modèle de reconnaissance d'images ?

Avant de détailler les étapes, il est utile de dissiper une idée reçue courante. L'entraînement d'un modèle de reconnaissance d'images ne consiste pas à apprendre à un système à “ voir ” comme les humains. Il s'agit de lui apprendre à reconnaître des schémas statistiques dans les pixels et à associer ces schémas à des étiquettes que vous définissez.

L'entraînement consiste essentiellement à présenter à un modèle de nombreux exemples d'images, à lui indiquer ce qui est correct et à le laisser s'ajuster en fonction de ses erreurs. Au fil du temps, le modèle apprend quels signaux visuels sont importants et lesquels peuvent être ignorés. Les contours, les textures, les formes, les transitions de couleurs et les relations spatiales font tous partie de cette représentation interne.

Ce processus dépend avant tout de trois choses :

- La qualité et la pertinence des données

- La clarté et la cohérence des étiquettes

- La boucle de rétroaction créée par l'évaluation et l'itération

Les algorithmes et les architectures sont importants, mais ils compensent rarement la faiblesse des données ou le manque de clarté des objectifs. Un modèle simple, entraîné sur des données bien préparées, sera presque toujours plus performant qu'un modèle complexe entraîné sans soin.

Il est également important de comprendre que l'entraînement n'est pas une action ponctuelle. Les systèmes de reconnaissance d'images s'améliorent progressivement. Les premières versions sont souvent imparfaites. Les performances augmentent à mesure que les données s'améliorent, que les cas limites sont ajoutés et que les hypothèses sont corrigées.

Avec cet état d'esprit, le processus étape par étape ci-dessous devient plus facile à suivre et bien plus efficace à appliquer.

Notre approche de l'entraînement des modèles de reconnaissance d'images chez FlyPix AI

À FlyPix AI, Nous entraînons nos modèles de reconnaissance d'images dans des conditions géospatiales réelles, et non sur des démonstrations contrôlées. Les images satellitaires, aériennes et de drones présentent du bruit, des variations et une complexité importantes ; notre processus d'entraînement est donc conçu dès le départ pour gérer les problèmes d'échelle, d'incohérence et les cas particuliers.

Nous permettons de créer des modèles d'IA personnalisés sans écrire une seule ligne de code, tout en conservant un contrôle total sur ce que le modèle détecte et comment il apprend. Les utilisateurs définissent les objets, les annotations et les priorités. Notre plateforme prend en charge l'entraînement, l'optimisation et l'infrastructure du modèle en arrière-plan.

L'entraînement n'est pas considéré comme une étape ponctuelle. Nous le concevons comme un processus itératif où les modèles s'améliorent au fur et à mesure que de nouvelles images apparaissent et que les conditions évoluent. L'apprentissage actif permet de concentrer l'entraînement sur les cas incertains, afin que les efforts soient investis là où ils améliorent réellement la précision.

Notre objectif n'est pas seulement la rapidité, mais aussi la fiabilité. En entraînant nos modèles sur des données géospatiales réelles, nous garantissons leur robustesse en production, et pas seulement lors des tests. Il en résulte une reconnaissance d'images qui transforme des visuels complexes en informations exploitables pour des secteurs tels que l'agriculture, les infrastructures, la foresterie et l'administration publique.

Les étapes pratiques de l'entraînement d'un modèle de reconnaissance d'images

L'entraînement d'un modèle de reconnaissance d'images ne consiste pas en un seul grand saut technique. Il s'agit d'une suite de petites décisions délibérées qui s'appuient les unes sur les autres. Chaque étape résout un problème spécifique, et en négliger ou précipiter une seule se traduit généralement par une faible précision, des prédictions instables ou un modèle qui ne fonctionne que dans des conditions idéales.

Les étapes décrites ci-dessous correspondent à la méthode d'entraînement des systèmes de reconnaissance d'images dans des projets concrets. Elles comprennent la définition de la tâche, la préparation des données, l'entraînement, l'évaluation et la maintenance à long terme. Malgré l'évolution possible des outils et des architectures, ce processus sous-jacent reste étonnamment constant d'un secteur à l'autre et pour tous les cas d'usage.

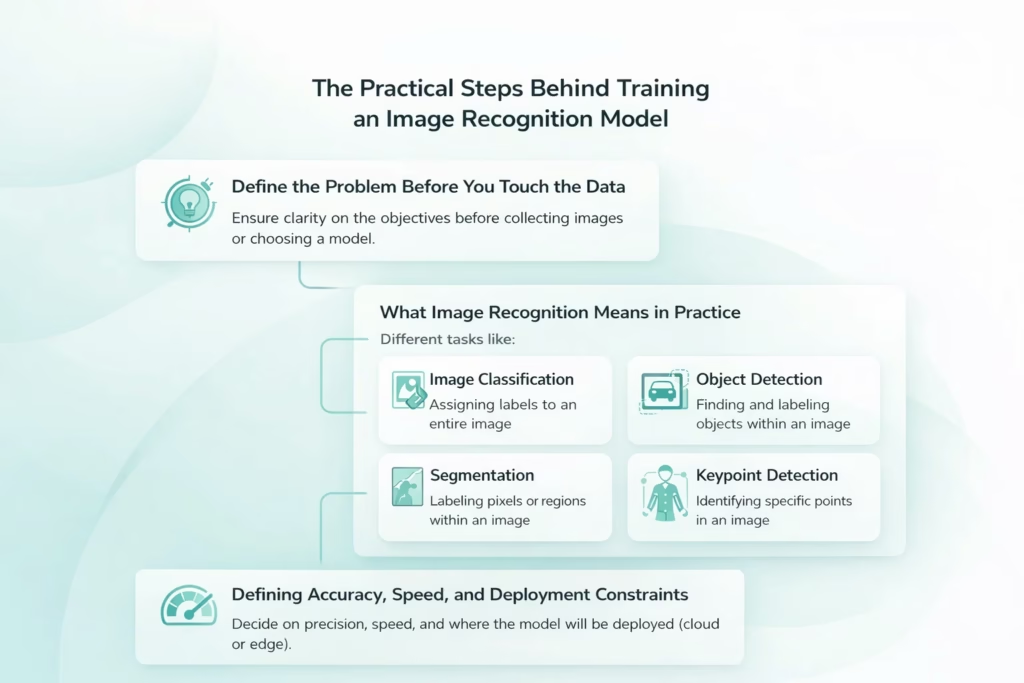

Étape 1 : Définir le problème avant de manipuler les données

Avant de collecter des images ou de choisir un modèle, il est essentiel de définir clairement le rôle du système. Cela paraît évident, mais c'est souvent là que de nombreux projets échouent discrètement. Des objectifs vagues conduisent à des données, des étiquettes et des critères d'évaluation erronés.

Que signifie la reconnaissance d'images en pratique ?

La reconnaissance d'images n'est pas une tâche unique. Elle peut prendre différentes formes selon le résultat attendu du système.

- Classification d'images. Attribution d'une ou plusieurs étiquettes à une image entière.

- Détection d'objets. Trouver des objets dans une image et identifier leur emplacement et leur catégorie.

- Segmentation. Étiquetage des pixels ou des régions au lieu du tracé de cadres de délimitation, souvent utilisé lorsque la précision est importante.

- Détection de points clés. Identification de points spécifiques dans une image, tels que des articulations, des points de repère ou des marqueurs de référence.

Chacune de ces approches requiert une configuration d'entraînement, une stratégie d'annotation et une méthode d'évaluation différentes. Un modèle entraîné pour la classification d'images ne fonctionnera pas automatiquement pour la détection d'objets. La structure du résultat détermine tout ce qui suit.

Définition des contraintes de précision, de vitesse et de déploiement

Au-delà de la tâche elle-même, il vous faut également déterminer le niveau de précision requis par le système. Une classification approximative est-elle acceptable, ou avez-vous besoin d'une précision au pixel près ? La vitesse est-elle plus importante que la précision ? Le modèle sera-t-il exécuté dans le cloud ou sur des appareils périphériques aux ressources limitées ?

Répondre à ces questions dès le début permet d'éviter le surdimensionnement et vous aide à faire les bons compromis plus tard dans le processus de formation.

Étape 2 : Collecter des données reflétant la réalité

Un modèle de reconnaissance d'images n'apprend que ce qu'on lui présente. Si les données d'entraînement ne reflètent pas une utilisation réelle, ses performances se dégraderont fortement après le déploiement.

Les bons ensembles de données ne sont pas seulement volumineux. Ils sont représentatifs.

Cela signifie :

- Images prises dans différentes conditions d'éclairage

- Variations d'angles, de distances et de perspectives

- Différents milieux et environnements

- Occlusions partielles et chevauchements

- De véritables imperfections comme le flou, le bruit ou les artefacts de compression

Une erreur fréquente consiste à entraîner le modèle sur des images nettes et idéales, puis à s'attendre à ce qu'il fonctionne dans des conditions difficiles. Les appareils photo réels ne se comportent pas comme des jeux de données soigneusement sélectionnés.

Un autre problème fréquent est le déséquilibre des classes. Si une catégorie apparaît beaucoup plus souvent que les autres, le modèle apprendra à la privilégier. On peut obtenir une précision élevée sur le papier tout en passant à côté de cas rares mais importants. À ce stade, il est préférable d'avoir moins d'images reflétant la réalité qu'un ensemble de données massif qui ne la reflète pas.

Étape 3 : Préparer et structurer correctement l’ensemble de données

Une fois les images collectées, il est essentiel de les organiser de manière à ce que le modèle puisse réellement apprendre. C'est là que la rigueur est primordiale. Les raccourcis pris à ce stade peuvent engendrer des comportements d'apprentissage incohérents par la suite.

- Règles d'organisation du jeu de données principal. Avant le début de l'entraînement, les images doivent respecter quelques principes structurels de base.

- Cohérence des images. Toutes les images doivent avoir un format et une résolution uniformes. Mélanger les tailles d'image, les espaces colorimétriques ou les types de fichiers introduit une variabilité inutile et ralentit l'apprentissage.

- Séparation claire des ensembles de données. Les images doivent être clairement séparées en ensembles d'entraînement, de validation et de test, sans aucun chevauchement entre eux.

- Aucune donnée dupliquée entre les divisions. La présence d'images dupliquées ou quasi-dupliquées dans différentes divisions fausse les résultats d'évaluation et engendre une confiance excessive dans les performances du modèle.

Répartition recommandée des phases d'entraînement, de validation et de test

Une division typique d'un ensemble de données ressemble à ceci :

Ensemble d'entraînement

Généralement, 60 à 80 % de l'ensemble des données. C'est à partir de cette partie que le modèle apprend les tendances et les caractéristiques.

Ensemble de validation

Généralement de 10 à 20 %. Utilisé pour optimiser les hyperparamètres et surveiller les performances pendant l'entraînement.

Ensemble de test

Généralement de 10 à 20 %. Réservé strictement à l'évaluation finale.

L'ensemble de test doit rester intact jusqu'à la toute fin. L'utiliser pour orienter les décisions pendant l'entraînement est contre-productif.

Prétraitement et normalisation

Les images nécessitent également un prétraitement avant le début de l'entraînement. Cela comprend généralement le redimensionnement des images à une taille d'entrée fixe et la normalisation des valeurs des pixels.

La normalisation permet au modèle de converger plus rapidement et de se comporter de manière plus cohérente sur différentes images en maintenant les valeurs d'entrée dans une plage prévisible.

Une mauvaise structure des données engendre des problèmes subtils difficiles à déboguer ultérieurement, c'est pourquoi ralentir à cette étape permet de gagner du temps au final.

Étape 4 : Étiqueter et annoter avec soin

La qualité des annotations a un impact direct sur les performances du modèle. Les modèles n'apprennent pas l'intention ; ils apprennent des schémas à partir des étiquettes.

Pour les tâches de classification, les étiquettes doivent être univoques. Si deux classes se chevauchent conceptuellement, le modèle aura des difficultés, aussi sophistiqué soit-il.

Pour la détection et la segmentation d'objets, la précision des annotations est encore plus importante :

- Les cadres de délimitation doivent être précis et uniformes.

- Aucun objet ne doit être omis ni étiqueté de manière incohérente.

- Les cas particuliers doivent suivre des règles claires.

Il convient d'établir des consignes d'annotation par écrit avant de commencer l'étiquetage à grande échelle. Autrement, différents annotateurs interpréteront différemment la même image.

L'étiquetage assisté par IA peut accélérer le processus, mais la vérification humaine reste essentielle. De petites erreurs d'annotation ajoutent du bruit, et ce bruit s'accumule rapidement. Si le modèle semble dysfonctionner par la suite, le problème réside souvent non pas dans son architecture, mais dans les étiquettes.

Étape 5 : Utiliser l’augmentation des données pour améliorer la généralisation

Même les jeux de données de grande qualité bénéficient de l'augmentation de données. Celle-ci introduit une variation contrôlée dans les données d'entraînement sans nécessiter de collecte d'images supplémentaires, ce qui permet au modèle d'apprendre des schémas visuels plus robustes.

Les techniques courantes consistent à faire pivoter ou retourner les images, à ajuster leur échelle ou à recadrer certaines zones, à modifier la luminosité et le contraste, et à introduire un léger bruit ou flou. Chacune de ces modifications expose le modèle à des conditions visuelles légèrement différentes tout en préservant la structure sous-jacente de l'image.

L'objectif n'est pas de déformer les images de manière aléatoire. L'augmentation des données doit simuler les types de variations que le modèle est susceptible de rencontrer après son déploiement. Par exemple, la rotation d'images médicales peut être pertinente dans certains contextes, tandis que l'inversion d'images de reconnaissance de texte en altérerait le sens. La solution la plus adaptée dépend entièrement du domaine d'application.

Appliquée judicieusement, l'augmentation réduit le surapprentissage et améliore la capacité d'un modèle à généraliser à des images qu'il n'a jamais vues auparavant.

Étape 6 : Choisir une architecture de modèle adaptée à la tâche

Le choix du modèle est important, mais moins qu'on ne le croit. Un modèle simple et bien entraîné surpasse souvent un modèle complexe mal entraîné.

Pour la plupart des tâches de reconnaissance d'images, les réseaux de neurones convolutifs restent la référence. Des architectures comme ResNet et EfficientNet offrent d'excellentes performances et une grande flexibilité.

Si la rapidité est essentielle, notamment pour la détection en temps réel, on utilise couramment des détecteurs à tir unique comme YOLO. Ils privilégient la rapidité et la simplicité au détriment de la précision.

Les transformateurs visuels peuvent donner d'excellents résultats sur des ensembles de données volumineux et diversifiés, notamment pour les images haute résolution. Cependant, ils nécessitent davantage de données et de puissance de calcul et ne sont pas toujours pratiques.

Dans de nombreux cas, l'apprentissage par transfert est la meilleure option. Partir d'un modèle pré-entraîné permet de gagner du temps et d'améliorer les résultats, notamment lorsque les données étiquetées sont limitées.

Étape 7 : Entraîner le modèle avec des paramètres intentionnels

L'entraînement ne se résume pas à appuyer sur un bouton et à attendre. La manière dont le modèle apprend dépend d'un petit nombre de paramètres qui influencent directement sa stabilité, sa vitesse et ses performances finales.

Paramètres de formation fondamentaux qui façonnent l'apprentissage

Plusieurs paramètres interagissent pendant l'entraînement. Chacun influe sur la manière dont le modèle se met à jour et réagit aux erreurs.

Vitesse d'apprentissage et stabilité de l'entraînement

Le taux d'apprentissage détermine la vitesse à laquelle le modèle met à jour ses poids internes. S'il est trop élevé, l'entraînement devient instable et risque de ne pas converger. S'il est trop faible, l'apprentissage est ralenti et le modèle peut se retrouver bloqué sur des solutions médiocres qui ne s'améliorent jamais de manière significative.

Taille du lot et équilibre des ressources

La taille des lots influe à la fois sur la stabilité de l'entraînement et sur l'utilisation de la mémoire. Les lots plus importants tendent à produire des mises à jour plus fluides, mais nécessitent davantage de ressources de calcul. Les lots plus petits introduisent une plus grande variabilité dans les mises à jour, ce qui peut parfois favoriser la généralisation, mais peut aussi ralentir la convergence.

Nombre d'époques et durée d'entraînement

Le nombre d'époques détermine la durée de l'entraînement. Un nombre insuffisant d'époques peut entraîner un sous-entraînement du modèle, tandis qu'un nombre excessif peut conduire à un surapprentissage si les performances cessent de s'améliorer sur les données de validation.

Choix de l'optimiseur et comportement de convergence

Le choix de l'optimiseur influence la capacité du modèle à explorer efficacement l'espace des fonctions de perte. Différents optimiseurs gèrent les gradients, l'inertie et la dynamique d'apprentissage de manières différentes, ce qui peut modifier sensiblement le comportement d'entraînement.

Suivi des signaux de formation et de validation

Il est essentiel de suivre les pertes d'apprentissage et de validation tout au long du processus. Si la précision d'apprentissage continue de s'améliorer tandis que les performances de validation stagnent ou diminuent, un surapprentissage est probable.

C’est là que la patience est payante. Ajuster un paramètre à la fois permet de mieux comprendre ce qui améliore réellement les résultats, au lieu de semer la confusion en modifiant plusieurs variables simultanément.

Étape 8 : Appliquer une régularisation pour éviter le surapprentissage

Le surapprentissage est l'un des problèmes les plus courants en reconnaissance d'images. Le modèle fonctionne bien sur les données d'entraînement, mais échoue sur les nouvelles images.

Les techniques de régularisation permettent de contrôler cela :

- L'abandon du modèle l'oblige à s'appuyer sur plusieurs fonctionnalités.

- Les pénalités L1 et L2 empêchent les poids de devenir trop importants.

- L'arrêt précoce interrompt l'entraînement avant la sur-optimisation.

Ces techniques ne corrigent pas les erreurs de données. Ce sont des mesures de protection qui fonctionnent mieux lorsque l'ensemble de données est déjà fiable.

Un modèle qui généralise bien paraît souvent moins impressionnant pendant l'entraînement, mais il est plus performant là où ça compte.

Étape 9 : Évaluer avec les indicateurs appropriés

La précision à elle seule ne révèle que rarement toute la vérité. Elle peut même être trompeuse, notamment dans le cas de données déséquilibrées.

Une meilleure évaluation comprend :

- Précision pour comprendre les faux positifs

- Rappel pour comprendre les détections manquées

- Le score F1 permet d'équilibrer les deux

- Matrices de confusion pour identifier les problèmes au niveau de la classe

- AUC-ROC pour les problèmes de classification binaire

Pour la détection d'objets, des métriques comme l'intersection sur l'union et la précision moyenne sont essentielles.

L'évaluation doit toujours être effectuée sur des données que le modèle n'a jamais utilisées. Autrement, les résultats donnent une confiance illusoire.

Étape 10 : Valider dans des conditions réalistes

Les mesures hors ligne ne suffisent pas à comprendre le comportement d'un modèle de reconnaissance d'images une fois déployé. La validation doit être effectuée dans des environnements proches des conditions réelles de production.

Tests au-delà des benchmarks hors ligne

La validation réaliste implique souvent d'effectuer l'inférence sur des flux vidéo en direct ou des flux de données en temps réel, plutôt que sur des images de test statiques. Elle peut également nécessiter de tester le modèle sur différentes configurations matérielles, notamment lors du déploiement sur des périphériques aux ressources limitées.

L'évaluation des performances sous différentes charges système est tout aussi importante. Un modèle performant de manière isolée peut se comporter très différemment lors du traitement de volumes importants de données ou lorsqu'il fonctionne en parallèle avec d'autres services. L'analyse manuelle des cas de défaillance à ce stade révèle souvent des schémas que les indicateurs automatisés ne détectent pas.

De nombreux problèmes n'apparaissent que durant cette phase. Les pics de latence, les contraintes de mémoire et les cas limites imprévus peuvent modifier le comportement du modèle en pratique. La validation est l'étape où les performances théoriques se confrontent au comportement réel et où les derniers ajustements sont souvent les plus importants.

Étape 11 : Itérer en se basant sur des preuves, et non sur des hypothèses

Très peu de modèles sont corrects du premier coup. Des itérations sont nécessaires.

Une bonne itération est guidée par l'analyse :

- Examiner les faux positifs et les faux négatifs

- Identifier les modèles de données manquantes

- Ajuster les étiquettes ou les stratégies d'augmentation

- Ajustez soigneusement les hyperparamètres

L'ajout de données est souvent plus efficace que la simple modification des architectures, notamment en ce qui concerne les cas de défaillance. L'itération doit réduire l'incertitude, et non introduire du hasard.

Étape 12 : Maintenir et recycler au fil du temps

Les modèles de reconnaissance d'images ne sont pas des systèmes statiques. Les environnements changent, les capteurs évoluent et les conditions d'utilisation réelles sont rarement fixes. Sans surveillance continue, même les modèles les plus performants perdent progressivement en précision.

Pourquoi la maintenance est une exigence continue

Une fois déployé, un modèle interagit avec de nouvelles données. Les variations d'éclairage, les conditions météorologiques, le matériel de la caméra ou le comportement de l'utilisateur peuvent modifier l'apparence des images par rapport à l'ensemble d'entraînement initial. C'est pourquoi la maintenance continue est essentielle.

Performances du modèle de surveillance

Le suivi des performances dans le temps permet de déceler les baisses progressives de précision qui ne déclenchent pas d'alertes immédiates. La dégradation silencieuse est fréquente dans les systèmes de reconnaissance d'images et passe souvent inaperçue sans surveillance régulière.

Collecte de données nouvelles et représentatives

À mesure que les conditions évoluent, il est nécessaire de recueillir et d'analyser de nouvelles données. Cela permet de garantir que l'ensemble de données d'entraînement continue de refléter l'utilisation réelle plutôt que des hypothèses obsolètes.

Réentraînement avec des ensembles de données mis à jour

Le réentraînement permet au modèle d'intégrer de nouveaux exemples et de corriger les faiblesses qui apparaissent. Il est souvent plus efficace de procéder par étapes que d'attendre une baisse significative des performances.

Biais d'audit et dérive des données

Des audits réguliers permettent de détecter les biais, les déséquilibres de classes et les dérives de données susceptibles de fausser progressivement les prédictions. La résolution précoce de ces problèmes garantit la fiabilité du modèle dans différents environnements et populations.

Les équipes qui prévoient la formation continue dès le départ ont tendance à concevoir des systèmes durables. Au lieu de réagir aux échecs, elles considèrent la reconnaissance d'images comme un processus vivant qui s'améliore grâce aux données qu'il analyse.

Réflexions finales

L'entraînement d'un modèle de reconnaissance d'images ne consiste pas à rechercher la perfection. Il s'agit de construire un système qui apprend de manière fiable, s'adapte au fil du temps et se comporte de façon prévisible dans le monde réel.

De solides résultats s'obtiennent grâce à des fondamentaux bien maîtrisés : une collecte de données réfléchie, un étiquetage précis, des choix de modèles raisonnables et une évaluation honnête.

Une fois ces éléments réunis, le modèle n'a pas besoin d'être tape-à-l'œil. Il doit simplement être fonctionnel.

Et quand ça fonctionne, ça a tendance à continuer de fonctionner, même si les conditions changent.

Questions fréquemment posées

Le délai dépend de l'envergure de la tâche, de la taille et de la qualité de l'ensemble de données, et de l'utilisation ou non de modèles pré-entraînés. Les modèles de classification simples peuvent être entraînés en quelques jours ou semaines, tandis que les systèmes de détection ou de segmentation d'objets plus complexes nécessitent souvent plusieurs semaines, voire plusieurs mois, en incluant la préparation, la validation et l'itération des données.

Il n'y a pas de nombre fixe. Certains modèles fonctionnent bien avec quelques milliers d'images de haute qualité, notamment grâce à l'apprentissage par transfert. D'autres nécessitent des dizaines, voire des centaines de milliers d'images pour une généralisation fiable. L'important n'est pas le volume, mais que les données reflètent les conditions réelles et les cas particuliers.

Non. Dans la plupart des cas, il est préférable de partir d'un modèle pré-entraîné. L'apprentissage par transfert réduit le temps d'entraînement, améliore les performances avec des données limitées et diminue les coûts d'infrastructure. L'entraînement à partir de zéro est généralement réservé aux domaines très spécialisés ou aux très grands ensembles de données.

La mauvaise qualité des données est le problème le plus fréquent. Des étiquettes incohérentes, des cas limites manquants, des images d'entraînement non réalistes ou des fuites de données entre les ensembles de données causent souvent plus de dégâts que le choix du modèle ou les paramètres des hyperparamètres.

Le surapprentissage se manifeste généralement lorsque les performances d'entraînement continuent de s'améliorer tandis que les performances de validation cessent de progresser ou commencent à décliner. Cela indique que le modèle apprend de manière trop spécifique les données d'entraînement et ne parvient pas à généraliser à de nouvelles images.