OpenClaw est un outil open source qui vous permet de transformer un puissant modèle de langage en un assistant personnel capable d'effectuer de véritables tâches. Vous pouvez discuter avec lui sur WhatsApp, Telegram, Discord, Slack ou des applications similaires ; il peut lire et envoyer des e-mails, gérer votre agenda, naviguer sur le web, travailler avec des fichiers, exécuter des scripts simples – bref, se comporter comme un collègue serviable et toujours disponible.

L'élément le plus important est le modèle d'IA auquel vous le connectez. OpenClaw n'est qu'un simple intermédiaire et un exécutant. La véritable réflexion, la mémorisation et la prise de décision sont effectuées par le modèle que vous choisissez. Un mauvais choix peut entraîner des dysfonctionnements, des coûts excessifs, voire des problèmes de sécurité. En revanche, un modèle adapté garantit une expérience fluide et fiable.

Pourquoi le choix du modèle change tout

À chaque commande envoyée à OpenClaw, l'historique complet de la conversation est transmis au modèle – parfois des centaines de milliers de mots si la discussion dure depuis plusieurs jours. Le modèle doit alors tout comprendre, se souvenir des échanges précédents, déterminer la prochaine étape et rédiger des instructions très précises (appelées appels d'outils) pour qu'OpenClaw sache quel bouton cliquer ou quel courriel envoyer.

Si le modèle commence à oublier des détails des messages précédents (même dix messages seulement), il se met rapidement à faire des erreurs et à perdre le fil de la conversation. S'il perturbe la mise en forme ou la logique des appels d'outils, les actions échouent complètement ou atteignent la mauvaise cible : mauvais e-mail envoyé, mauvais événement de calendrier modifié, mauvais fichier consulté. Enfin, si le modèle est trop facilement dupé par des formulations trompeuses dissimulées dans un e-mail ou une page web, une invite malveillante peut inciter votre assistant à exécuter des commandes dangereuses ou à divulguer des informations sensibles.

Le modèle ne se résume donc pas à être “ intelligent ou non intelligent ”. Il doit exceller dans trois domaines essentiels pour OpenClaw :

- Garder une longue mémoire sans se tromper

- suivre les instructions à la lettre

- Appeler correctement les outils (fonctions) à chaque fois

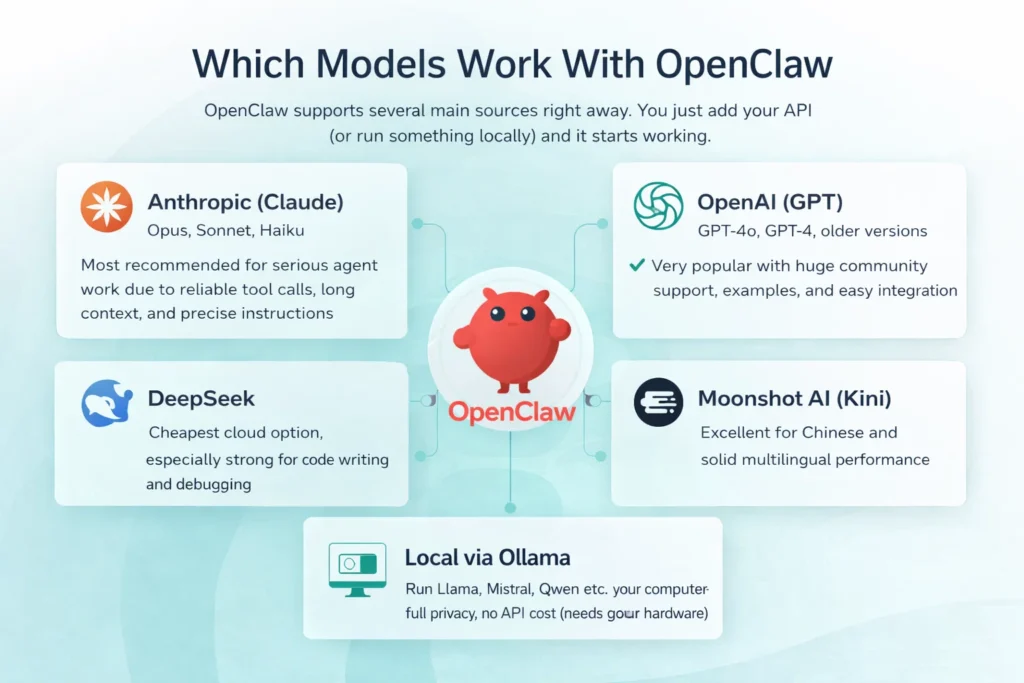

Quels modèles sont compatibles avec OpenClaw ?

OpenClaw prend en charge plusieurs sources principales dès sa création. Il vous suffit d'ajouter votre clé API (ou d'exécuter une commande en local) et cela fonctionne immédiatement.

- Anthropique (Claude)Opus, Sonnet, Haiku – les formats les plus recommandés pour un travail d'agent sérieux en raison de la fiabilité des outils utilisés, du contexte étendu et des instructions précises.

- OpenAI (GPT)GPT-4o, GPT-4 et versions antérieures sont très populaires et bénéficient d'un large soutien de la communauté, d'exemples et d'une intégration facile.

- DeepSeek: l'option cloud la moins chère, particulièrement performante pour l'écriture et le débogage de code.

- IA Moonshot (Kimi): excellent pour le chinois et performances multilingues solides.

- Local via Ollama: exécutez Llama, Mistral, Qwen etc. sur votre ordinateur – confidentialité totale, aucun coût d'API (nécessite un bon matériel).

FlyPix AI + OpenClaw : Plus de temps pour les décisions, moins de travail manuel

À FlyPix AI Nous sommes spécialisés dans l'automatisation de l'analyse géospatiale à partir d'images satellitaires, de drones et aériennes. Nous détectons et comptons les objets, mesurons les surfaces, suivons leur évolution dans le temps et produisons des rapports et des cartes clairs. Nos services sont utiles à nos clients dans les domaines suivants : suivi de chantier, agriculture, évaluations environnementales, inspection des infrastructures et aménagement urbain.

Notre plateforme permet de gagner jusqu'à 99,71 T³ de temps auparavant consacré aux tâches SIG manuelles. Plus besoin de logiciels coûteux ni d'analystes spécialisés : notre interface sans code permet à n'importe quelle équipe de créer des modèles personnalisés pour ses objets spécifiques.

Nous savons que même une fois l'analyse terminée, il reste encore beaucoup de travail administratif à accomplir : rédiger des rapports, organiser les fichiers d'images et les résultats, planifier les examens de suivi ou les visites sur le terrain, trier les courriels contenant de nouvelles données et préparer les mises à jour destinées aux parties prenantes.

C’est précisément pourquoi nous considérons OpenClaw comme un complément naturel et puissant.

Nos clients peuvent utiliser un assistant IA local et gratuit (par exemple avec Ollama) qui garantit une confidentialité maximale des données et fonctionne hors ligne – un point essentiel pour le traitement d'images sensibles. OpenClaw prend en charge automatiquement toutes les tâches de suivi : rédaction de rapports à partir de nos analyses, organisation des fichiers par projet ou par date, gestion des calendriers, recherche de réglementations ou d'études pertinentes et envoi de synthèses.

Modèles GPT : flexibles et familiers

Les modèles GPT d'OpenAI restent un choix très performant et largement utilisé pour OpenClaw, notamment par les personnes déjà familiarisées avec l'écosystème OpenAI.

Ces modèles sont particulièrement performants lorsque vous avez besoin de réponses rapides à des questions simples ou directes, lorsque vous générez fréquemment du code ou des scripts et que vous avez besoin d'une sortie structurée et propre telle que des listes, des tableaux ou du JSON, ou lorsque vous souhaitez tirer parti de l'énorme collection d'exemples, de bibliothèques, de tutoriels et d'outils construits par la communauté qui entourent les API OpenAI.

Comparées aux derniers modèles Claude, les variantes GPT peuvent parfois présenter une légère baisse de cohérence lors de conversations très longues ou lorsqu'un processus complexe et rigoureux d'appel d'outils en plusieurs étapes est requis. Cependant, la différence reste minime pour la plupart des flux de travail quotidiens. Si vous disposez déjà d'un abonnement OpenAI, de crédits gratuits ou si vous appréciez simplement leur rapidité et leur prise en main, GPT-4o (ou une variante similaire) constitue généralement le point de départ le plus simple et le plus pratique. De nombreux utilisateurs d'OpenClaw débutent avec GPT pour sa facilité d'utilisation et ne passent à Claude que plus tard, lorsqu'ils sont confrontés à des tâches exigeant un raisonnement plus précis ou des mécanismes de sécurité intégrés plus robustes.

Claude : Le choix sérieux le plus courant

Les modèles Claude d'Anthropic sont les plus populaires auprès des utilisateurs sérieux d'OpenClaw car ils sont conçus pour être précis, logiques et excellents pour suivre des instructions longues et détaillées.

- Niveau supérieur (niveau Opus): idéal pour la gestion de données sensibles (finance, santé, juridique, informations privées), les flux de travail complexes en plusieurs étapes ou lorsque la sécurité est essentielle (très forte résistance aux injections de paquets et aux ruses).

- Niveau intermédiaire (niveau Sonnet): ce que la plupart des gens utilisent quotidiennement : gère les e-mails, le calendrier, les recherches Web et les automatisations standard de manière fiable, avec un excellent rapport qualité-prix et des réponses suffisamment rapides.

- Niveau léger (niveau haïku): bon marché et très rapide, mais ne convient qu'aux commandes simples, en une seule étape, où les erreurs occasionnelles n'ont pas grande importance.

C’est pourquoi Claude devient souvent le choix par défaut ou la recommandation principale : il correspond mieux que la plupart des alternatives aux besoins d’OpenClaw en matière de fiabilité, de contexte étendu et d’utilisation sécurisée des outils.

Deepseek : Quand vous voulez dépenser presque rien

Les modèles DeepSeek sont prisés des utilisateurs d'OpenClaw qui privilégient les coûts les plus bas. Ils coûtent beaucoup moins cher que Claude ou GPT tout en gérant efficacement les tâches simples à modérées.

Ils sont particulièrement adaptés pour :

- Trier et répondre aux courriels simples

- Modifications de base du calendrier (ajouter, vérifier, déplacer des événements)

- Aide rapide au code, petits scripts, débogage de routine

- Des automatisations simples sans planification approfondie

Pour une utilisation quotidienne légère à modérée (20 à 50 interactions), ils coûtent souvent 5 à 20 fois moins cher que les modèles haut de gamme tout en restant utilisables pour des tâches non critiques.

Les compromis sont bien réels :

- Moins à l'aise lors des longues conversations (oublie plus vite les détails)

- Difficultés avec les flux de travail complexes en plusieurs étapes

- Moins précis sur les tâches à forts enjeux (finance, juridique, communication avec les clients)

- Résistance à l'injection rapide inférieure à celle de Claude

Meilleure adaptation: budget serré, tâches principalement simples/moyennes, et vous acceptez une fiabilité légèrement moindre pour les tâches plus complexes.

De nombreux utilisateurs utilisent DeepSeek pour 80 à 90% de travail de routine et ne passent à des modèles plus puissants que pour les cas sensibles ou complexes – cela permet de maintenir les factures très basses tout en couvrant ce qui compte.

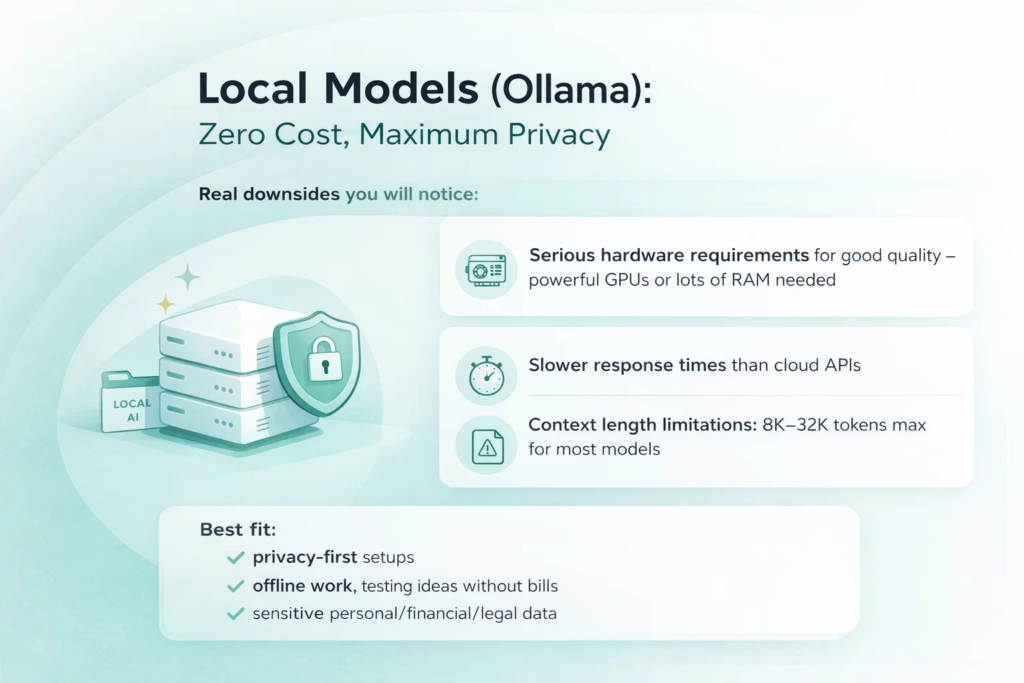

Modèles locaux (Ollama) : coût nul, confidentialité maximale

Si vous souhaitez absolument éviter que vos données ne quittent votre machine, les modèles locaux via Ollama constituent la seule solution viable. Vous téléchargez un modèle de poids ouvert, vous l'exécutez sur votre propre matériel, et OpenClaw communique directement avec lui via un serveur local – sans clés API, sans fournisseur de cloud, et sans aucun journal d'activité ailleurs.

Les modèles plus importants (environ 70 milliards de paramètres, comme Llama 3.1 70B, Qwen 2.5 72B ou les variantes de Mistral) offrent des performances étonnamment proches de celles des modèles cloud de milieu de gamme pour de nombreuses tâches OpenClaw : gestion des e-mails, gestion de calendrier, recherches web basiques et assistance à la programmation. Sur une machine dotée d'un matériel performant (plus de 48 Go de RAM, une bonne carte graphique ou une mémoire unifiée sur Apple Silicon), ils sont parfaitement utilisables au quotidien.

Les modèles plus petits (7B à 13B, comme le Llama 3.1 8B, le Phi-3 Mini et le Mistral 7B) fonctionnent correctement même sur des ordinateurs portables classiques dotés de 16 à 32 Go de RAM. Ils sont rapides et peu gourmands en ressources, mais nettement moins performants : ils peinent avec les raisonnements complexes, perdent rapidement le contexte et commettent davantage d’erreurs face à des problèmes complexes.

Les véritables inconvénients que vous remarquerez :

- Les exigences matérielles sont cruciales pour une bonne qualité : les modèles haut de gamme nécessitent des cartes graphiques puissantes ou une grande quantité de mémoire vive ; sans cela, tout ralentit considérablement.

- Les temps de réponse sont généralement plus longs que ceux des API cloud (quelques secondes de plus par réponse, parfois beaucoup plus sur des machines moins puissantes).

- La longueur du contexte est limitée : la plupart des modèles locaux se limitent à 8 000 à 32 000 jetons (certains plus récents vont au-delà grâce à des astuces), tandis que les sessions OpenClaw dépassent souvent largement cette limite, ce qui entraîne une perte de détails par l’agent.

Meilleure adaptation: configurations privilégiant la confidentialité, travail hors ligne, test d'idées sans factures, ou lorsque vous traitez des données personnelles/financières/juridiques sensibles que vous ne confiez à aucun service cloud.

Combien coûte chaque modèle par mois avec OpenClaw ?

Les coûts mensuels dépendent du modèle et du niveau d'utilisation. OpenClaw envoie l'historique complet des conversations à chaque fois ; par conséquent, les conversations longues et les tâches fréquentes augmentent rapidement la consommation de jetons. Une utilisation légère correspond à environ 10 à 15 tâches par jour, une utilisation modérée à 30 à 50, et une utilisation intensive à plus de 100 (agent toujours actif).

Coûts mensuels approximatifs basés sur les habitudes d'utilisation réelles :

- Claude de niveau supérieur (niveau Opus): léger $80–150, modéré $200–400, lourd $500–750+

- Claude de niveau intermédiaire (niveau Sonnet): léger $15–30, modéré $40–80, lourd $100–200

- GPT-4o (OpenAI): léger $12–25, modéré $30–60, lourd $80–150

- DeepSeek ou Claude léger (niveau Haiku): léger à modéré $5–15 ou moins, lourd généralement inférieur à $30

- Modèles locaux via OllamaCoût de l'API $0 (électricité et matériel uniquement)

Les chiffres réels varient en fonction de la durée des sessions, du nombre d'outils utilisés et de l'efficacité des prompts. Suivez votre consommation sur le tableau de bord OpenClaw ou la console fournisseur pendant une semaine pour connaître vos dépenses réelles. Choisir le niveau de forfait adapté à votre charge de travail vous permettra de réaliser des économies substantielles.

Guide rapide : Quel modèle choisir pour quel poste chez OpenClaw

| Cas d'utilisation / de travail | Modèle(s) recommandé(s) | Pourquoi ce modèle convient le mieux |

| Assistant quotidien (courriel, calendrier, messages, recherche rapide) | Claude moyen (niveau Sonnet) ou GPT-4o | Fiable pour les tâches quotidiennes, bon rapport vitesse/prix, gère bien le contexte et les outils |

| Programmation intensive, écriture et correction de scripts, automatisations devant fonctionner du premier coup | Claude puissant (niveau Opus) ou GPT puissant | Raisonnement supérieur, code source précis, moins d'erreurs dans la logique complexe et le débogage |

| Lecture de longs documents, résumé de rapports volumineux, analyse approfondie | Claude (tous niveaux, de préférence milieu/haut de gamme) ou Gémeaux (si disponible) | Excellente gestion des contextes longs et extraction/résumé structuré |

| Travail ultra-privé – aucune donnée ne quitte votre appareil | Grand modèle local via Ollama (par exemple Llama 70B, Qwen, Mistral) | Tout le traitement reste sur votre matériel, confidentialité totale, aucun appel API |

| Budget très serré, uniquement des tâches basiques/simples | DeepSeek ou petit modèle local | Extrêmement peu coûteux (voire gratuit), mais tout à fait convenable pour les commandes en une seule étape et les automatisations légères. |

| Beaucoup de travail en chinois ou en langues étrangères (hors anglais). | Kimi (IA Moonshot) ou GPT-4o | Excellentes compétences multilingues, notamment une maîtrise parfaite du chinois. |

Ce qui compte vraiment lorsqu'on compare les modèles d'Openclaw

Voici les principaux éléments que les utilisateurs vérifient concrètement lorsqu'ils choisissent un modèle pour OpenClaw :

- Avec quelle précision et fiabilité effectue-t-il les appels d'outils sans erreurs de format ou de logique ?

- Sa capacité à conserver l'historique des conversations longues sans oublier ni mélanger les détails précédents

- Dans quelle mesure il suit scrupuleusement vos instructions à la lettre, sans ajouter, omettre ou modifier quoi que ce soit.

- Avec quelle efficacité il décompose les tâches complexes en petites étapes sûres et correctes

- Sa rapidité de réponse (rend la conversation fluide et sans latence)

- Combien cela coûte-t-il par mois pour votre utilisation quotidienne normale ?

Pour conclure

Il n'existe pas de modèle “ idéal ” pour OpenClaw. Le choix dépend de votre utilisation principale, de votre budget et de vos priorités : confidentialité ou rapidité ?.

Les modèles Claude (en particulier celui du milieu) restent le choix le plus sûr pour la plupart des personnes qui souhaitent un comportement fiable de l'agent sans corrections constantes.

Les modèles GPT sont parfaits si vous évoluez déjà dans l'univers OpenAI ou si vous avez besoin de réponses créatives rapides.

DeepSeek permet de réaliser d'importantes économies lorsque la qualité n'a pas besoin d'être parfaite.

Les modèles locaux vous offrent un contrôle total et aucun coût récurrent – si vous possédez le matériel.

Commencez par le plus simple à configurer (généralement Claude Sonnet ou GPT-4o), utilisez-le pendant une semaine, identifiez les points faibles, puis essayez-en un autre. OpenClaw facilite la transition et vous permet de rester flexible.

FAQ

Commencez par Claude Sonnet (version intermédiaire). Il est fiable, gère bien la plupart des tâches quotidiennes et de nombreux guides sont disponibles pour lui.

Oui. Vous pouvez changer de modèle à tout moment ou en définir différents pour différentes tâches/agents dans la configuration.

Pour les tâches simples ou privées, oui, surtout les plus importantes sur du matériel performant. Pour les conversations complexes et longues ou les environnements à haute sécurité, les solutions cloud sont généralement plus adaptées.

Il excelle dans le suivi précis des instructions, la mémorisation des longues conversations et l'appel correct des outils. Cela réduit les dysfonctionnements des automatisations et les risques de sécurité.

Oui, si vos tâches sont simples à moyennes et que vous acceptez une fiabilité légèrement inférieure pour les tâches complexes, c'est l'une des solutions les plus économiques pour obtenir des résultats corrects.

Oui. Les modèles plus difficiles à tromper et qui respectent scrupuleusement les règles rendent l'ensemble du système plus sûr, notamment lors de la lecture de courriels ou de sites web aléatoires.

Consultez le nombre de messages quotidiens. Pour une utilisation légère, presque tous les modèles sont économiques. Pour une utilisation intensive, les modèles les moins chers (DeepSeek, Haiku, version locale) sont les plus avantageux. Vérifiez votre consommation de jetons sur le tableau de bord après une semaine.