La reconnaissance d'images s'est discrètement imposée des laboratoires de recherche aux systèmes du quotidien. Elle permet d'étiqueter les photos, de guider les voitures autonomes, de numériser les images médicales et de surveiller les infrastructures à grande échelle. Sur le papier, les chiffres de précision sont souvent impressionnants. En pratique, la réalité est plus nuancée.

La précision en reconnaissance d'images ne se résume pas à un simple chiffre et sa signification varie selon le contexte. Un modèle performant sur des images de référence nettes peut rencontrer des difficultés en conditions réelles, sous des angles inhabituels, en faible luminosité ou dans des scènes complexes. Pour bien comprendre la précision réelle de cette technologie, il est essentiel d'aller au-delà des simples affirmations et d'examiner comment elle est mesurée, dans quels domaines elle se vérifie et quelles sont ses lacunes.

Cet article explique cela en termes simples, sans exagération, et en se concentrant sur le comportement de la reconnaissance d'images en dehors des démonstrations contrôlées.

Précision de la reconnaissance d'images

La précision en reconnaissance d'images ne signifie pas qu'un système voit toujours ce qu'un humain voit. Elle signifie que, dans des conditions définies, un modèle produit des prédictions qui correspondent aux données étiquetées selon des règles spécifiques.

La plupart des systèmes sont évalués à l'aide d'ensembles de données structurés où les images sont préalablement annotées. Un modèle est considéré comme précis lorsque ses prédictions correspondent à ces annotations dans les limites de seuils acceptés. Ceci introduit déjà une limite : les modèles sont évalués par rapport à des annotations humaines, et non par rapport à la réalité elle-même.

La précision varie également selon la tâche. La classification d'images se concentre sur l'identification des éléments présents. La détection d'objets ajoute la nécessité de les localiser. La segmentation va plus loin en définissant des contours précis. Chaque étape accroît la complexité et multiplie les risques d'erreur.

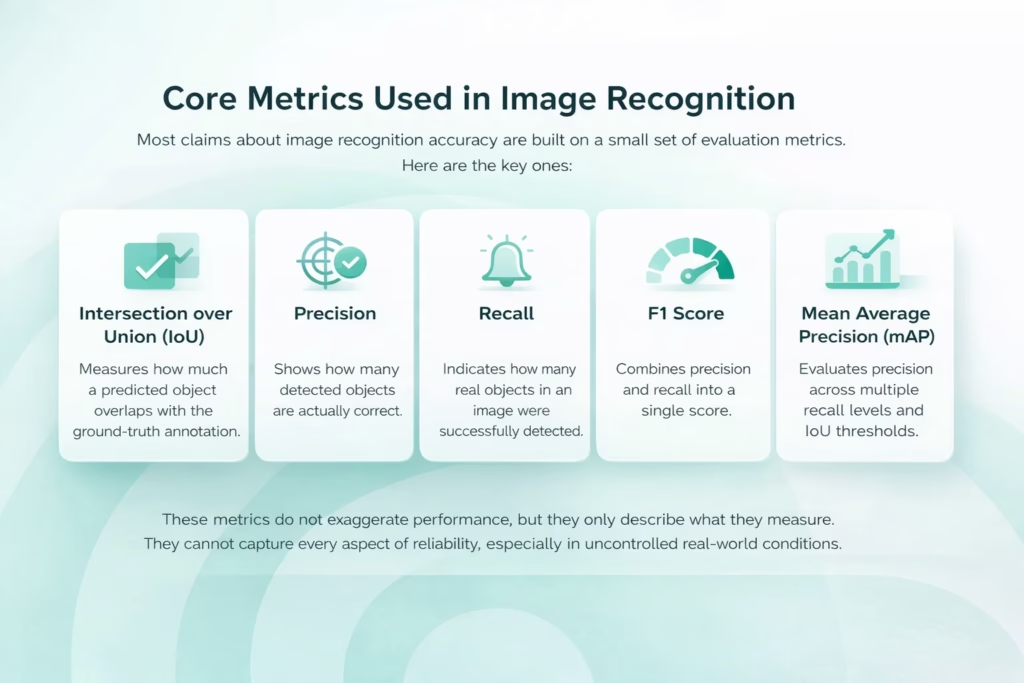

Métriques de base utilisées en reconnaissance d'images

La plupart des affirmations concernant la précision de la reconnaissance d'images reposent sur un nombre restreint de métriques d'évaluation. Chacune d'elles capture un aspect différent de la performance, et aucune ne permet, à elle seule, de dresser un tableau complet.

- Intersection sur Union (IoU). Ce test mesure la correspondance entre un objet prédit et l'annotation de référence. Il se concentre sur l'alignement spatial, et non sur la simple détection de l'objet.

- Précision. Indique le nombre d'objets correctement détectés. Une haute précision signifie moins de faux positifs.

- Rappel. Indique le nombre d'objets réels correctement détectés dans une image. Un taux de rappel élevé signifie moins d'objets manqués.

- Score F1. Elle combine précision et rappel en une seule valeur. Utile pour la comparaison, mais elle peut masquer d'importants compromis entre faux positifs et faux négatifs.

- Précision moyenne (mAP). Couramment utilisée pour la détection d'objets. Évalue la précision selon différents niveaux de rappel et seuils d'IoU. Puissante, mais souvent mal comprise ou citée hors contexte.

Ces indicateurs ne surestiment pas les performances, mais ils ne décrivent que ce qu'ils sont conçus pour mesurer. Ils ne peuvent pas appréhender tous les aspects de la fiabilité, notamment lorsque les systèmes passent d'ensembles de données contrôlés à des conditions réelles.

Précision de la reconnaissance d'images chez FlyPix AI

À FlyPix AI, Nous travaillons avec la reconnaissance d'images sur des données géospatiales réelles, où la précision est mise à l'épreuve par l'échelle, la complexité et l'évolution des conditions. Les images satellitaires, aériennes et de drones sont rarement nettes ; la précision doit donc être maintenue au-delà des seuils de référence.

Notre objectif est de rendre la reconnaissance d'images utile en pratique. Cela implique des agents d'IA capables de détecter et de délimiter rapidement les objets, mais aussi des modèles entraînés sur des données spécifiques à un secteur plutôt que sur des exemples génériques. Cet entraînement personnalisé permet d'adapter la précision aux méthodes de travail réelles des équipes, que ce soit dans le BTP, l'agriculture ou la surveillance des infrastructures.

Pour nous, la précision ne se résume pas à un simple chiffre. Elle englobe la constance sur de vastes ensembles de données, la fiabilité dans le temps et la stabilité des performances lors du passage des projets pilotes à la production. C'est sur ces critères que repose le développement de FlyPix AI.

Pourquoi la précision des indices de référence peut être trompeuse

Les scores élevés obtenus aux tests de performance sont réels, mais ils peuvent donner une fausse impression. De nombreux systèmes de reconnaissance d'images affichent d'excellents résultats sur des jeux de données populaires, et il est facile d'en conclure que le problème est résolu. Le hic, c'est que ces tests récompensent souvent des performances dans des conditions plus idéales et plus prévisibles que celles auxquelles les systèmes sont confrontés après leur déploiement.

Les benchmarks testent souvent la partie facile.

Le problème n'est pas que les résultats des tests de performance soient incorrects, mais plutôt que nombre d'entre eux soient plus faciles que les conditions réelles. Les images des jeux de données sélectionnés présentent souvent des sujets bien définis, des points de vue familiers et des compositions relativement soignées. L'éclairage est stable, les objets sont centrés et les cas particuliers qui perturbent les modèles en production sont moins fréquents.

Lorsque les modèles apprennent et sont évalués sur ce type de données, ils excellent dans ce qu'ils voient le plus souvent. Puis, confrontés au monde réel : angles de caméra différents, arrière-plans plus complexes, variations saisonnières, flou de mouvement, occlusion et objets qui ne correspondent pas à leur description théorique, leurs performances peuvent chuter brutalement. Cette chute est rarement visible dans les chiffres de précision annoncés.

La difficulté des images est inégale, mais les indicateurs la traitent comme si elle était égale.

Une façon utile d'y réfléchir est la suivante : toutes les images ne sont pas également reconnaissables, même pour les humains. Certaines sont comprises instantanément. D'autres nécessitent un second regard, davantage de contexte, ou tout simplement plus de temps.

L'évaluation traditionnelle attribue le même niveau de difficulté à toutes les images, ce qui fausse la définition de la “ précision ”. De nombreux jeux de données de référence sont composés majoritairement d'images facilement reconnaissables. Or, cela pose problème, car les modèles peuvent sembler progresser considérablement alors qu'ils s'améliorent principalement sur les images les plus simples, et non sur les cas véritablement complexes.

Les modèles plus complexes révèlent souvent clairement cette tendance : des progrès significatifs sur les images simples et des progrès plus faibles sur les images plus difficiles. Ainsi, le score moyen augmente, mais l’écart persiste sur les images réalistes et complexes.

Les humains et les modèles échouent différemment.

Les humains et les machines n'abordent pas la reconnaissance de la même manière. Les humains s'appuient sur le contexte, la mémoire et un raisonnement flexible. Les modèles, quant à eux, se basent sur des schémas statistiques appris. Cette différence apparaît dès qu'une image devient ambiguë, encombrée ou inhabituelle.

Les humains peuvent souvent se remettre d'informations partielles et prendre une bonne décision. Les modèles ont tendance à être plus fragiles, et lorsque le schéma se rompt, la défaillance peut être brutale. Certains systèmes récents combinant vision et langage se comportent de manière plus humaine face à des entrées inhabituelles, mais une robustesse équivalente à celle de l'humain reste l'exception.

C’est aussi pourquoi les affirmations générales selon lesquelles “ l’IA surpasse les humains en matière de vision ” reposent généralement sur des comparaisons trop restrictives. Dans des environnements complexes et non contrôlés, la situation est plus nuancée, et c’est précisément là que la précision est primordiale.

Précision dans les applications réelles

Utilisation industrielle et des infrastructures

En environnement contrôlé, la reconnaissance d'images peut être très précise. Des caméras fixes, un éclairage stable et un nombre limité d'objets permettent aux systèmes de fonctionner de manière constante. C'est une pratique courante dans le contrôle qualité en production et la surveillance des infrastructures.

Véhicules autonomes et systèmes critiques pour la sécurité

Dans des environnements dynamiques comme les routes, la précision devient plus difficile à maintenir. L'éclairage, les conditions météorologiques et les obstacles imprévus mettent à l'épreuve même les systèmes les plus performants. Dans ce contexte, la fiabilité en situation de contrainte prime sur la précision moyenne.

Imagerie médicale

La reconnaissance d'images médicales est soumise à des exigences strictes. Les images sont complexes et les enjeux importants. Même de petites erreurs ont des conséquences. Améliorer la précision est précieux, mais les systèmes nécessitent une validation rigoureuse et une supervision humaine.

Surveillance et sécurité

Les systèmes de surveillance sont confrontés à des défis supplémentaires liés aux biais, à l'équité et aux variations environnementales. Leur précision peut varier selon les groupes démographiques ou les lieux, ce qui soulève des préoccupations qui dépassent le simple cadre des performances techniques.

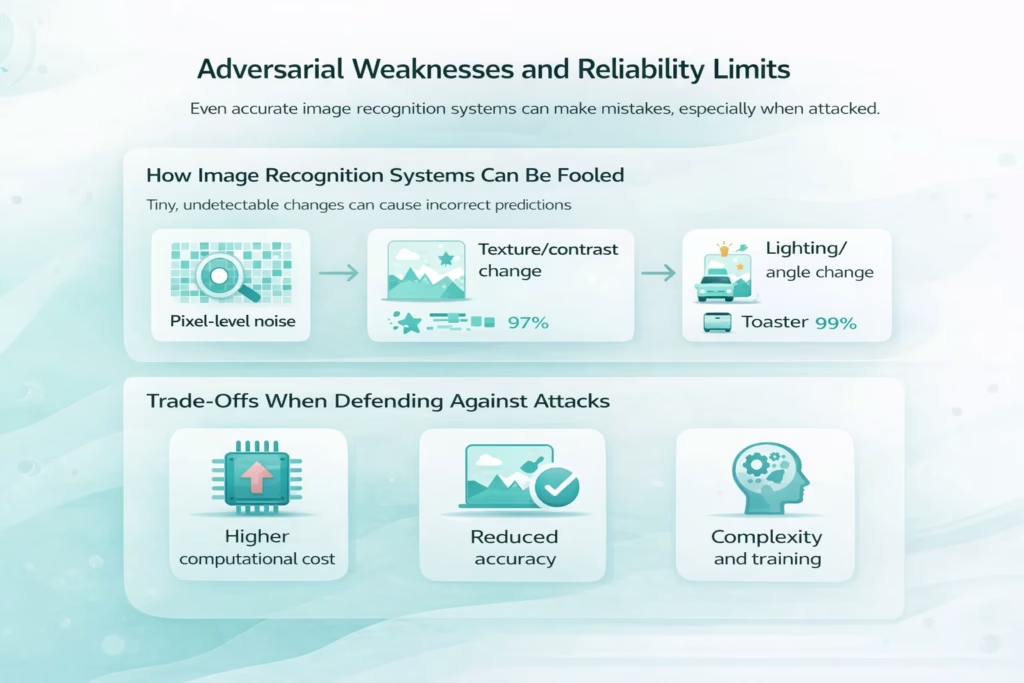

Faiblesses adverses et limites de fiabilité

Même les systèmes de reconnaissance d'images les plus précis peuvent présenter des défaillances inattendues. Ces défaillances ne sont pas toujours évidentes et surviennent souvent dans des situations qui paraissent anodines à un observateur humain.

Comment tromper les systèmes de reconnaissance d'images

De petites modifications soigneusement étudiées d'une image peuvent amener un modèle à faire des prédictions confiantes mais erronées.

- Un léger bruit au niveau des pixels, invisible à l'œil nu.

- Des changements subtils de texture ou de contraste qui modifient les modèles appris

- De légères variations d'éclairage, d'angle ou de composition de l'arrière-plan

- Perturbations artificielles conçues spécifiquement pour perturber les modèles

Pour un observateur extérieur, l'image reste inchangée. Pour le mannequin, elle peut soudainement appartenir à une toute autre catégorie.

Compromis liés à la défense contre les attaques

Il existe des techniques pour rendre les modèles plus robustes, mais elles sont rarement gratuites.

- Coût de calcul accru et inférence plus lente

- Précision réduite sur les images nettes et non adverses

- Des chaînes de formation et de maintenance plus complexes

- Coûts de déploiement et d'exploitation plus élevés

En raison de ces compromis, de nombreux systèmes du monde réel acceptent un certain niveau de fragilité plutôt que de viser une résistance totale aux attaques.

Pourquoi la précision seule ne suffit pas

Un système peut être précis en moyenne et pourtant échouer aux moments les plus critiques. De nombreux modèles de reconnaissance d'images fonctionnent bien sur des données familières, mais se mettent en panne face à des cas limites, des conditions inhabituelles ou des scénarios mal représentés lors de l'entraînement. Ces échecs ne sont pas toujours spectaculaires. Souvent, le système continue de fonctionner comme si de rien n'était, produisant des résultats qui semblent fiables, mais qui sont en réalité incorrects.

C’est pourquoi la cohérence et la transparence priment souvent sur les chiffres de précision affichés. Les équipes doivent comprendre le comportement d’un système en situation d’incertitude, identifier ses angles morts et comprendre comment les erreurs se manifestent. Un déploiement responsable repose sur la capacité à savoir non seulement la fréquence à laquelle un modèle est correct, mais aussi comment et pourquoi il se trompe lorsque les choses dérapent.

Alors, quelle est la précision de la technologie de reconnaissance d'images ?

Dans des conditions contrôlées, la technologie de reconnaissance d'images peut se révéler extrêmement précise. Lorsque les tâches sont ciblées, les environnements stables et les données étroitement alignées sur les ensembles d'entraînement, ses performances peuvent égaler, voire surpasser, celles des humains. C'est pourquoi cette technologie est si performante dans des contextes structurés tels que le contrôle de production ou la surveillance d'infrastructures fixes.

Dans des environnements complexes et réalistes, la précision diminue sensiblement. Les modèles peinent à gérer les événements rares, les contextes inhabituels et les variations de la distribution des données au fil du temps. Les progrès en reconnaissance d'images sont réels, mais inégaux. Les indicateurs de précision ne donnent qu'une vision partielle de la situation et doivent être interprétés en tenant compte du contexte, des risques et des comportements réels.

Conclusion

La précision de la reconnaissance d'images n'est pas garantie. C'est un résultat conditionnel qui dépend des données, des méthodes d'évaluation et du contexte.

Utilisée avec précaution, en tenant compte d'attentes réalistes et en appliquant les mesures de sécurité appropriées, la reconnaissance d'images apporte une réelle valeur ajoutée. Considérée comme infaillible, elle présente des risques.

La question la plus importante n'est pas de savoir si la reconnaissance d'images est précise en théorie, mais comment elle se comporte dans les conditions spécifiques de son utilisation. C'est là que la précision prend tout son sens.

Questions fréquemment posées

La reconnaissance d'images peut être très précise dans des environnements contrôlés et pour des tâches bien définies. En conditions réelles, sa précision varie en fonction de la qualité des données, du contexte et de la correspondance entre les conditions de déploiement et les données d'entraînement.

La précision reflète la concordance entre les prédictions d'un modèle et les données étiquetées, selon des règles d'évaluation spécifiques. Elle ne mesure ni la compréhension, ni le raisonnement, ni la fiabilité dans des conditions inattendues.

De nombreux jeux de données de référence contiennent des images nettes et prévisibles, plus faciles à reconnaître que les données réelles. Par conséquent, les modèles peuvent obtenir des scores élevés sans pour autant être robustes face aux variations, au bruit ou aux situations rares.

Pour des tâches précises et répétitives, avec des images claires, les systèmes de reconnaissance d'images peuvent surpasser les humains. Dans des situations complexes, ambiguës ou inconnues, les humains restent généralement plus fiables.

Les indicateurs les plus courants comprennent l'intersection sur l'union (IoU), la précision, le rappel, le score F1 et la précision moyenne (mAP). Chaque indicateur reflète un aspect différent de la performance et doit être interprété conjointement, et non isolément.