Les modèles de reconnaissance d'images échouent rarement à cause d'une architecture erronée. Leurs échecs sont plutôt dus à une mauvaise compréhension ou à une mesure inadéquate de leur précision, ou encore à des tests effectués dans des conditions non réalistes. Un modèle peut paraître performant lors de l'entraînement et pourtant se révéler totalement inefficace face à des données réelles.

Vérifier la précision de la reconnaissance d'images ne se résume pas à obtenir un score unique. Il s'agit de comprendre ce que le modèle reconnaît correctement, ce qu'il ne reconnaît pas et pourquoi ces erreurs se produisent. En pratique, la précision repose sur une combinaison de métriques, de méthodes de validation rigoureuses et de tests rigoureux en situation réelle. Ce guide explique comment évaluer les systèmes de reconnaissance d'images afin de déterminer s'ils sont opérationnels.

Pourquoi la précision globale dit rarement la vérité

La précision globale est la mesure la plus courante, mais aussi la moins pertinente dès que les projets dépassent le stade des problèmes simples. Elle évalue la fréquence à laquelle les prédictions correspondent aux étiquettes, mais elle ignore le déséquilibre des classes, la gravité des erreurs et les variations de distribution.

Un modèle peut atteindre une précision très élevée en étant performant sur des cas courants et simples, tout en échouant systématiquement sur des cas rares mais critiques. Dans les projets réels, ces cas rares sont souvent la raison d'être du modèle.

La précision globale n'est pas inutile, mais elle doit être considérée comme un indicateur superficiel. Elle peut signaler une panne manifeste, mais ne garantit pas la fiabilité d'un système.

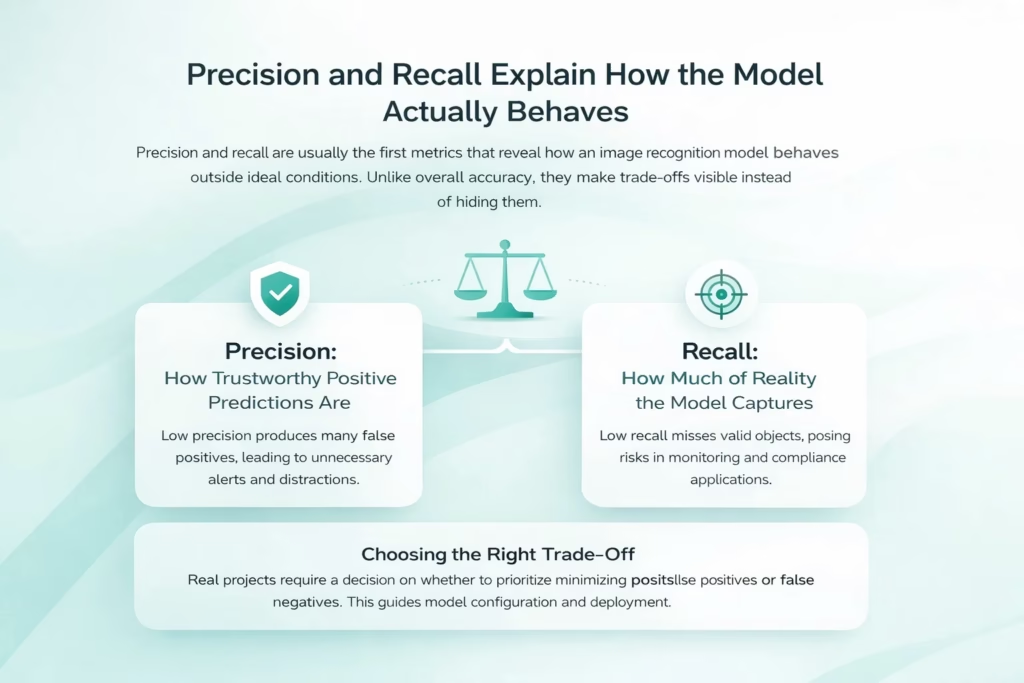

La précision et le rappel expliquent le comportement réel du modèle.

La précision et le rappel sont généralement les premiers indicateurs qui révèlent le comportement d'un modèle de reconnaissance d'images en dehors des conditions idéales. Contrairement à la précision globale, ils mettent en évidence les compromis au lieu de les masquer.

Précision : Dans quelle mesure les prédictions positives sont-elles fiables ?

La précision reflète la fréquence à laquelle le modèle fait une prédiction correcte. Une faible précision signifie que le système produit de nombreux faux positifs. Dans les projets réels, cela devient rapidement problématique lorsque chaque détection déclenche une alerte, un flux de travail ou une vérification humaine. Même un modèle techniquement précis peut devenir inutilisable s'il sollicite constamment une attention inutile.

Rappel : Quelle part de réalité le modèle capture-t-il ?

Le rappel mesure la couverture. Il indique dans quelle mesure le modèle détecte correctement les éléments présents. Un modèle avec un faible rappel peut manquer des objets valides, même si les détections effectuées sont correctes. Dans les systèmes de surveillance, de sécurité ou de conformité, les détections manquées présentent souvent un risque plus élevé que les fausses détections.

Choisir le bon compromis

La précision et le rappel décrivent différents modes de défaillance, et aucun n'est universellement supérieur. Dans la pratique, il est indispensable de choisir explicitement les erreurs les plus acceptables. Ce choix doit orienter le réglage des seuils, la sélection du modèle et l'évaluation finale de la précision.

Rendre la précision de la reconnaissance d'images pratique chez FlyPix AI

À FlyPix AI, Nous travaillons dans le domaine de la reconnaissance d'images, où la précision doit résister aux conditions réelles, et non pas seulement à des données de test idéales. Les images satellitaires, aériennes et de drones sont complexes par nature ; nous nous concentrons donc sur une précision qui se maintient quels que soient l'environnement, l'échelle et les variations.

Nous ne considérons pas la précision comme une simple note. Notre plateforme est conçue pour aider les équipes à entraîner des modèles personnalisés, à valider visuellement les détections et à itérer rapidement. En intégrant les connaissances du domaine au modèle et en réduisant le temps de test et de réentraînement, nous faisons de la précision un outil concret sur lequel les équipes peuvent s'appuyer, et non une simple mesure ponctuelle.

La précision ne s'arrête pas au déploiement. Comme les images évoluent avec le temps, nos processus prennent en charge la validation et le réentraînement continus, afin que les modèles restent adaptés aux conditions réelles au lieu de devenir progressivement obsolètes.

Interpréter conjointement les indicateurs de précision de base

Une fois les indicateurs de précision de base établis, le véritable travail commence. Les systèmes de reconnaissance d'images échouent rarement par manque d'une métrique. Leurs échecs sont plutôt dus à une interprétation isolée des métriques. La précision, le rappel, le score F1, l'IoU et la mAP décrivent tous différents aspects du comportement du modèle, et aucun n'est significatif pris individuellement. L'objectif est de comprendre leurs interactions et ce qu'elles révèlent lorsqu'elles sont considérées conjointement.

Utiliser le score F1 sans perte de détails

Le score F1 combine la précision et le rappel en un seul chiffre. Il est utile pour les comparaisons, notamment lorsque l'une ou l'autre de ces métriques ne doit pas prédominer.

Cependant, le score F1 ne doit jamais remplacer une vérification directe de la précision et du rappel. Deux modèles présentant le même score F1 peuvent se comporter très différemment en pratique. L'un peut manquer des cas rares, tandis que l'autre peut générer un grand nombre de faux positifs.

Considérez le score F1 comme un résumé, et non comme une conclusion.

La précision de la détection d'objets change les règles

La précision de la reconnaissance d'images se complexifie lorsqu'il faut inclure la détection d'objets. Les systèmes de détection doivent identifier les éléments présents et les localiser correctement dans l'image.

L'intersection sur l'union (IoU) mesure la précision avec laquelle les boîtes englobantes prédites correspondent aux données réelles. Elle transforme la précision en un problème spatial plutôt qu'en une simple tâche de classification.

Le choix des seuils d'IoU n'est pas un détail technique. Des seuils trop permissifs peuvent masquer des problèmes de localisation. Des seuils trop stricts peuvent pénaliser des détections pourtant suffisamment précises pour une utilisation opérationnelle. Dans les projets concrets, l'IoU doit refléter le niveau de précision requis pour les détections, et non ce qui est le plus esthétique dans les rapports.

Précision moyenne et ses limites

La précision moyenne (mAP) est largement utilisée car elle combine la fiabilité de la détection, la qualité du classement et la précision de la localisation selon différents seuils. Elle offre une méthode structurée pour comparer des modèles de détection d'objets entraînés dans des conditions similaires.

Le mAP est surtout utile comme métrique comparative. Il permet aux équipes de déterminer si une approche améliore la qualité de la détection par rapport à une autre. En revanche, il ne garantit pas la robustesse. Un modèle peut obtenir un bon score de mAP et pourtant échouer dans certaines conditions d'éclairage, d'environnement ou de disposition des objets.

C’est pourquoi le mAP doit être considéré comme un outil d’analyse, et non comme un verdict.

Toujours considérer les performances par classe

L'une des raisons les plus fréquentes de l'échec des systèmes de reconnaissance d'images est l'hétérogénéité des performances entre les classes. Les métriques agrégées masquent ce problème.

Lors de l'évaluation de la précision, il convient toujours d'examiner les indicateurs par classe. Cela permet de déterminer si certains objets sont systématiquement plus difficiles à détecter ou plus susceptibles d'être confondus avec d'autres.

Cette étape modifie souvent les priorités. Un modèle qui paraît globalement performant peut s'avérer inacceptable s'il échoue sur les points les plus importants.

Les matrices de confusion transforment les erreurs en modèles

Les matrices de confusion constituent l'un des outils les plus pratiques pour comprendre le comportement d'un modèle de reconnaissance d'images. Au lieu de réduire les erreurs à un seul score, elles montrent comment les prédictions passent d'une classe à l'autre, révélant ainsi la structure des erreurs.

Ce que révèlent les matrices de confusion

En confrontant les prédictions aux données réelles, les matrices de confusion permettent de répondre à des questions auxquelles les métriques scalaires ne peuvent pas répondre :

- Quelles sont les classes les plus souvent confondues ?

- Que les erreurs soient unidirectionnelles ou mutuelles

- Que les erreurs se regroupent autour de catégories visuellement similaires ou qui se chevauchent

Pourquoi ce point de vue est important

Ces tendances révèlent souvent des problèmes sous-jacents, comme des définitions de classes ambiguës, un étiquetage incohérent ou des exemples d'entraînement manquants. Les matrices de confusion, en mettant en évidence les relations entre les classes, sont particulièrement utiles pour décider de collecter davantage de données, d'affiner les étiquettes ou d'ajuster les limites des classes.

La validation ne fonctionne qu'avec des données véritablement inconnues.

L'évaluation de la précision est compromise lorsque les données de validation sont trop similaires aux données d'entraînement. Ce problème survient plus fréquemment que les équipes ne le pensent.

Si des versions augmentées des mêmes images apparaissent dans plusieurs sections, ou si les données proviennent de conditions très spécifiques, la précision semble artificiellement élevée. Le modèle est actuellement testé sur des variations de données déjà rencontrées.

Un ensemble de tests pertinent doit présenter des différences significatives. Cela peut inclure des différences de lieux, d'appareils, de périodes ou de conditions de capture. Sans cette distinction, l'évaluation de la précision devient auto-confirmante plutôt que prédictive.

Les tests en conditions réelles modifient les conclusions

De nombreux problèmes de précision n'apparaissent que lorsque les modèles sont confrontés aux imperfections du monde réel. Le flou de mouvement, le bruit, l'occlusion, les artefacts de compression et un éclairage insuffisant révèlent des faiblesses que les jeux de données impeccables ne mettent jamais en évidence.

Les tests en conditions réalistes mènent souvent à des découvertes certes dérangeantes, mais précieuses. Un modèle performant dans des scénarios idéaux peut rencontrer des difficultés dès que les conditions varient, même légèrement. Détecter ce problème avant le déploiement permet de gagner du temps, de réduire les coûts et de préserver la crédibilité.

Cette étape ne requiert pas une simulation parfaite. Elle exige un échantillonnage fidèle de l'aspect réel des images en production.

Précision au fil du temps et rôle des biais

La précision de la reconnaissance d'images n'est pas statique. Les données réelles évoluent constamment et les modèles non surveillés se dégradent progressivement. Les variations saisonnières, les nouveaux matériels, les changements environnementaux et les modifications du comportement des utilisateurs influent tous sur l'apparence des images et leur interprétation par les modèles. Lorsque la précision n'est vérifiée qu'au lancement, cette lente dégradation passe souvent inaperçue jusqu'à ce que les défaillances deviennent évidentes.

Les contrôles de précision post-déploiement doivent privilégier l'analyse des tendances plutôt que l'observation de valeurs isolées. Une baisse progressive des performances est souvent plus dangereuse qu'une panne soudaine, car elle se dissimule derrière des indicateurs familiers. Une surveillance continue permet de détecter rapidement les variations subtiles et d'intervenir avant que la précision ne chute en dessous des seuils acceptables.

Les biais jouent un rôle direct dans ce processus. Les modèles entraînés sur des données restreintes ou déséquilibrées ont tendance à être performants uniquement dans les conditions qu'ils ont déjà rencontrées. Lorsque de nouveaux environnements, types d'objets ou motifs visuels apparaissent, les indicateurs de précision surestiment la fiabilité. Réduire les biais améliore la couverture, mais aussi la robustesse. Des modèles plus équitables sont généralement plus stables dans le temps et plus faciles à maintenir face à l'évolution des conditions.

Utiliser la précision pour prendre de vraies décisions

Les indicateurs de précision servent à orienter les décisions, non à impressionner les parties prenantes. Les rapports doivent expliquer les compromis, les limites et les risques connus au lieu de les dissimuler derrière un seul chiffre. Une précision présentée hors contexte engendre une confiance illusoire et conduit les équipes à négliger les problèmes qui apparaissent ultérieurement en production.

En pratique, un rapport de précision utile devrait clairement indiquer les points suivants :

- Quels types d'erreurs sont les plus importants et pourquoi sont-ils acceptables ou non ?

- Lorsque le modèle présente des performances inégales, notamment dans les classes ou les scénarios de fiabilité moindre

- Quelles sont les conditions que reflète l'évaluation, telles que les sources de données, les environnements ou les périodes ?

- Comment les performances devraient évoluer au fil du temps et comment elles seront surveillées

Des rapports clairs et honnêtes renforcent la confiance entre les équipes et permettent de mettre en place des systèmes plus faciles à maintenir, à améliorer et sur lesquels on peut s'appuyer en situation réelle.

Quand un modèle est réellement prêt

Un modèle est prêt lorsque son comportement est compris, et non lorsque ses indicateurs atteignent leur maximum. Des scores élevés peuvent masquer des performances fragiles, surtout s'ils proviennent d'ensembles de données restreints ou de conditions idéales. L'important est de comprendre comment le modèle échoue, où ces erreurs se produisent et si elles correspondent à un niveau de risque acceptable. Les erreurs prévisibles peuvent être gérées par des seuils, des flux de travail ou un réentraînement. Les erreurs inconnues apparaissent plus tard, généralement lorsque leur correction coûte plus cher.

Une véritable préparation repose sur une évaluation rigoureuse plutôt que sur une interprétation optimiste. Cela implique des tests en conditions réelles, une validation à l'aide de données inédites et un suivi des performances après déploiement. Un modèle observé et ajusté en continu est bien plus fiable qu'un modèle qui paraissait performant au lancement.

Réflexions finales

Vérifier la précision de la reconnaissance d'images dans des projets réels ne consiste pas à obtenir le meilleur score, mais à comprendre comment un système se comporte face aux réalités du terrain.

Les indicateurs sont des outils. Utilisés avec soin, ils révèlent les forces et les faiblesses. Utilisés sans précaution, ils créent une confiance illusoire.

La différence entre une démonstration et un système de reconnaissance d'images fiable ne réside pas dans l'architecture, mais dans la manière dont la précision est mesurée, testée et maintenue avec rigueur dans le temps.

Questions fréquemment posées

Il n'existe pas de métrique idéale. La précision globale peut fournir une indication rapide, mais elle est rarement suffisante à elle seule. Dans les projets concrets, la précision doit être évaluée en combinant la justesse, le rappel et des métriques spécifiques à la tâche, comme l'IoU ou le mAP pour la détection d'objets. La combinaison optimale dépend des types d'erreurs les plus critiques dans votre cas d'utilisation.

Cela se produit généralement lorsque les données d'évaluation sont trop similaires aux données d'entraînement ou ne reflètent pas les conditions réelles. Des images nettes, des environnements limités ou des fuites de données entre les phases d'entraînement peuvent gonfler les scores de précision. Lorsque le modèle est confronté à un nouvel éclairage, de nouveaux angles de vue, du bruit ou de nouveaux environnements, des faiblesses non anticipées apparaissent.

Tout dépend du coût des erreurs. Si les faux positifs entraînent une vérification manuelle, des alertes ou des actions automatisées, la précision prime. Si l'absence d'objets crée des risques ou des angles morts, le rappel est plus important. La plupart des systèmes réels nécessitent un compromis réfléchi plutôt qu'une optimisation aveugle d'un seul indicateur.

Non. Le score F1 est utile pour la comparaison, mais il masque l'équilibre entre la précision et le rappel. Deux modèles présentant le même score F1 peuvent avoir des comportements très différents en pratique. Il est toujours préférable d'examiner séparément la précision et le rappel avant de prendre une décision.

Il est important de vérifier régulièrement la précision des données après leur déploiement, et non pas une seule fois. La fréquence optimale dépend de la vitesse d'évolution des données, mais tout système exposé à de nouveaux environnements, saisons ou matériels doit faire l'objet d'une surveillance continue. Une lente dérive des performances est fréquente et passe souvent inaperçue sans suivi des tendances.