OpenClaw n'est pas une simple interface de messagerie instantanée au nom accrocheur. Il s'apparente davantage à une couche de contrôle pour les agents d'IA, capable de lire des fichiers, d'appeler des outils et de répondre directement dans vos applications habituelles. C'est là tout son intérêt. C'est aussi la raison pour laquelle il ne faut pas le prendre à la légère. Si vous l'abordez comme un simple ChatGPT avec un logo différent, vous passerez à côté de son utilité. En l'envisageant comme une infrastructure, vous en tirerez pleinement parti.

Comment OpenClaw transforme le chat en action

OpenClaw n'est pas qu'une simple interface de messagerie instantanée avec des extensions. Il fonctionne comme une passerelle locale qui connecte votre plateforme de messagerie, votre modèle d'IA et votre couche d'action au sein d'un système unique et contrôlé. Il se connecte à des outils comme Telegram ou Slack, à un modèle exécuté localement via Ollama ou via un fournisseur cloud tel qu'OpenAI ou Anthropic, et gère l'accès aux fichiers, les API et l'exécution de scripts grâce à une mémoire locale persistante. Tout transite par cette passerelle unique.

Concrètement, un message est reçu par chat, l'agent l'évalue, peut éventuellement faire appel à un outil, puis renvoie un résultat structuré. Il peut consulter les journaux, résumer les erreurs, créer des tickets, mettre à jour les enregistrements CRM ou exécuter des scripts prédéfinis. Le contexte est conservé d'une session à l'autre, ce qui fait d'OpenClaw une véritable couche opérationnelle et non un simple assistant.

FlyPix IA et automatisation de l'IA dans le monde réel

À FlyPix AI, Nous appliquons des agents d'IA dans un domaine différent, mais le principe reste similaire. L'automatisation ne crée de valeur que lorsqu'elle est directement connectée à des données opérationnelles réelles. Notre plateforme se concentre sur l'imagerie satellitaire, aérienne et par drone, où des modèles d'IA détectent, surveillent et inspectent les objets à grande échelle. Au lieu d'une annotation manuelle, nous automatisons l'analyse géospatiale grâce à des modèles entraînés à identifier et à délimiter les objets avec précision.

Nous avons conçu le système pour qu'il soit pratique dès le départ. Les utilisateurs peuvent entraîner des modèles d'IA personnalisés sans connaissances approfondies en programmation, définir leurs propres annotations et les appliquer à divers secteurs tels que la construction, l'agriculture, la maintenance des infrastructures et les projets gouvernementaux. L'objectif n'est pas l'intelligence abstraite, mais l'efficacité mesurable dans des environnements visuels complexes.

Vous pouvez également trouver FlyPix AI sur LinkedIn Si vous souhaitez nous contacter via cette plateforme. Pour notre entreprise, l'IA ne se résume pas à l'expérimentation. Il s'agit de transformer des données visuelles en résultats structurés que les équipes peuvent exploiter en toute confiance dans leurs opérations réelles.

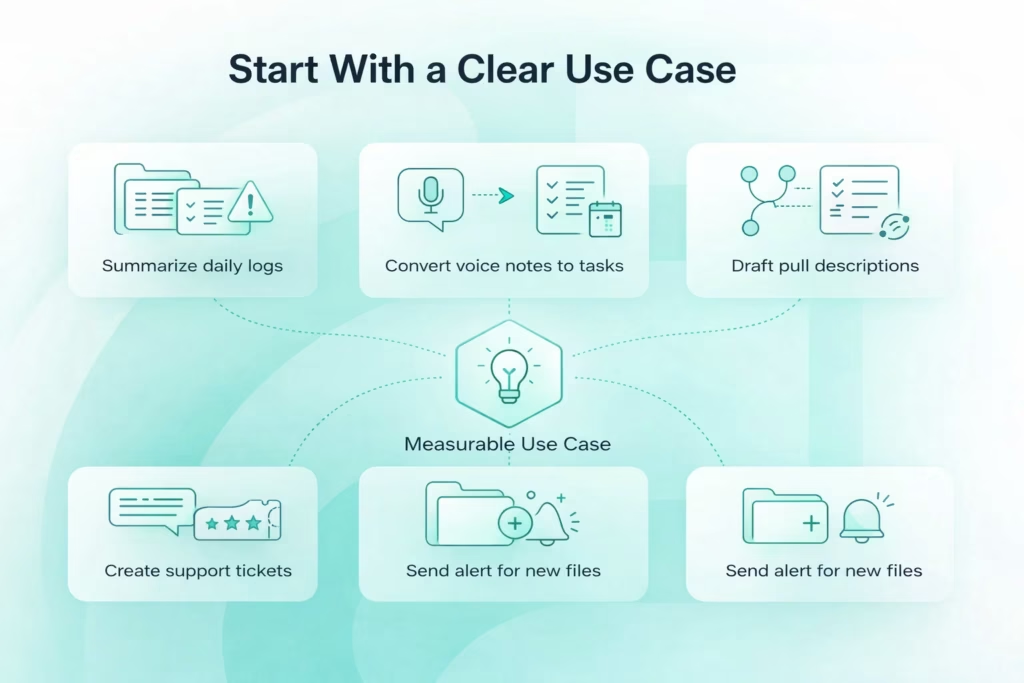

Commencez par un cas d'utilisation clair

L'erreur la plus fréquente avec OpenClaw est simple : installer d'abord et réfléchir ensuite. Une fois le système en marche, mais sans objectif précis, on finit par modifier des paramètres au lieu de résoudre un vrai problème. Avant toute installation, définissez un cas d'utilisation mesurable. Il doit être suffisamment spécifique pour permettre de déterminer clairement si cela fonctionne ou non. Voici un exemple de cas d'utilisation initial pertinent :

- Résumez les journaux quotidiens d'un dossier spécifique et mettez en évidence la dernière erreur critique.

- Convertissez les notes vocales Telegram en tâches structurées avec titre et échéance.

- Descriptions préliminaires des demandes de fusion utilisant le contexte du dépôt et les commits récents

- Créer des tickets d'assistance à partir de données de chat structurées avec des niveaux de priorité

- Surveiller un dossier et envoyer une alerte lorsque de nouveaux fichiers apparaissent

Chaque exemple possède un déclencheur clair, une entrée définie et une sortie observable. Cette structure permet de se concentrer sur l'essentiel et d'éviter toute complexité inutile. Commencez par un objectif précis. Si cet objectif est vague, vous passerez plus de temps à corriger l'architecture qu'à créer de la valeur. OpenClaw est plus performant lorsqu'il est intégré à un flux de travail mesurable. Une fois ce flux stabilisé, l'extension devient intentionnelle et non plus expérimentale.

Préparez votre système pour OpenClaw

Une configuration stable d'OpenClaw commence avant même l'exécution du programme d'installation. Il ne s'agit pas d'un simple plugin de chat, mais d'une passerelle locale capable de lire des fichiers, d'exécuter des outils et de se connecter à des modèles externes. Votre machine, votre réseau et vos permissions font partie intégrante du système. Quelques minutes de préparation en amont vous éviteront des heures de dépannage par la suite.

Vous aurez besoin au minimum de la dernière version LTS de Node.js, d'un terminal que vous maîtrisez et d'une clé API pour votre modèle cloud (OpenAI, Anthropic ou Ollama si vous prévoyez d'exécuter un modèle local). Telegram est l'interface la plus simple pour vos premiers tests. Si vous optez pour une exécution locale, prévoyez une configuration matérielle réaliste. Seize gigaoctets de RAM constituent une base raisonnable pour des performances stables. Les modèles plus volumineux nécessiteront davantage de mémoire.

Votre environnement est important. N'installez pas ce logiciel à l'aveuglette sur un ordinateur portable professionnel. Ne laissez pas de ports ouverts publiquement par commodité. Évitez de l'exécuter avec des privilèges élevés, sauf en cas d'absolue nécessité. OpenClaw lit les fichiers locaux et exécute des actions : c'est là son principal atout. Traitez-le avec la même précaution que n'importe quel système ayant un accès direct à vos données.

Installation et configuration initiale d'OpenClaw

OpenClaw évolue rapidement ; il est donc plus sûr de suivre la procédure d'installation officielle. L'objectif est simple : faire fonctionner la passerelle de manière fluide et fiable. Pas d'expérimentations, pas de modifications personnalisées pour le moment. Juste une base stable.

1. Choisissez votre méthode d'installation

Selon la distribution utilisée, OpenClaw s'installera soit via un script d'installation initiale, soit via npm. Les deux méthodes visent le même objectif : installer les dépendances et enregistrer le service de passerelle. Le processus d'installation initiale se déroule généralement comme suit :

| curl -fsSL https://openclaw.ai/install.sh | bash |

Si vous préférez npm, la procédure d'installation globale est simple :

| npm install -g openclaw@latest |

Aucune des deux méthodes ne devrait paraître compliquée. Si l'installation génère des erreurs, arrêtez-vous et résolvez-les avant de poursuivre. Une installation propre est plus importante que la rapidité.

2. Exécuter le processus d'intégration

Après l'installation, exécutez l'assistant d'intégration :

| Openclaw à bord |

Cette étape configure la passerelle et l'installe en tant que service d'arrière-plan. Une fois l'opération terminée, le système devrait indiquer que la passerelle est active. À ce stade, OpenClaw est non seulement installé, mais aussi opérationnel.

3. Accédez à l'interface utilisateur de contrôle

Par défaut, l'interface utilisateur de contrôle (tableau de bord) s'exécute localement à l'emplacement suivant :

| http://127.0.0.1:18789/ (ou http://localhost:18789/) |

Ouvrez cette adresse dans votre navigateur. Si tout est correctement configuré, le tableau de bord devrait s'afficher. S'il ne se charge pas, vérifiez les points suivants :

- Vérifiez que le service de passerelle est en cours d'exécution.

- Vérifiez qu'aucun autre processus n'utilise le port 18789.

- Vérifiez les paramètres du pare-feu local

Une règle importante : la passerelle doit rester liée à l’hôte local. Ne l’exposez pas publiquement. L’interface de contrôle gère un agent qui peut accéder aux fichiers locaux et exécuter des outils. Limiter l’accès à 127.0.0.1 garantit la sécurité de cette surface de contrôle pendant les phases de développement et de test.

Configuration de l'intégration Telegram

Telegram est l'un des moyens les plus rapides d'activer OpenClaw. La configuration est simple, l'API est facile à provisionner et vous pouvez vérifier le fonctionnement complet des messages en quelques minutes. C'est la solution idéale pour les tests initiaux, lorsque vous vous concentrez sur la logique de l'agent plutôt que sur les contraintes d'intégration.

Ouvrez Telegram, recherchez @BotFather et saisissez /newbot. Choisissez un nom et copiez le jeton API fourni. Lors de l'intégration à OpenClaw, collez ce jeton lorsque vous y êtes invité. Une fois enregistré, la passerelle connecte votre agent local à Telegram. L'exactitude est cruciale : une seule erreur de saisie peut interrompre la connexion.

Une fois la configuration terminée, envoyez un message de test à votre bot et vérifiez l'interface de contrôle. Si le message s'affiche et qu'une réponse est renvoyée à Telegram, la boucle fonctionne. Cela confirme que la passerelle, le modèle et la couche de communication fonctionnent ensemble. Vous pouvez ensuite passer de la configuration à la création de véritables flux de travail.

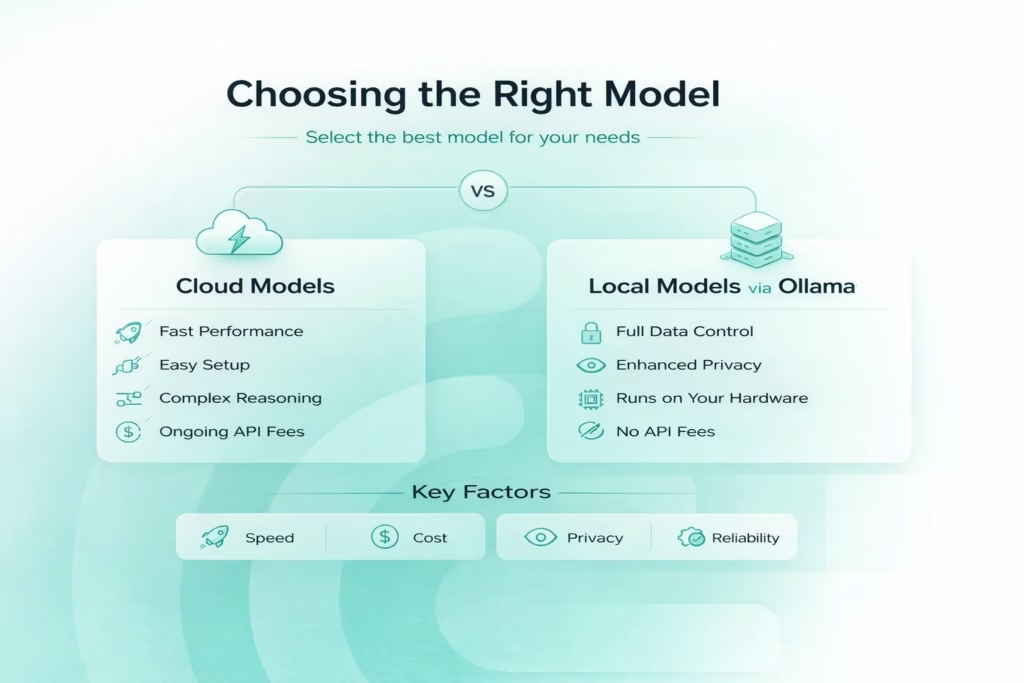

Choisir le bon modèle

Le choix de votre modèle influe directement sur la vitesse, le coût, la confidentialité et la fiabilité globale. OpenClaw ne vous impose pas un fournisseur unique, ce qui constitue un atout. Cependant, cette flexibilité n'est utile que si vous en comprenez les compromis. Deux options principales s'offrent à vous : les modèles cloud et les modèles locaux. Chacune répond à un besoin opérationnel différent.

1. Modèles de nuages – Rapides, puissants, à faible friction

Les modèles cloud sont la solution la plus rapide pour obtenir des performances de raisonnement élevées sans se soucier du matériel. Il suffit de connecter une clé API, de configurer le fournisseur, et l'agent est opérationnel. Les modèles cloud sont généralement les plus adaptés pour :

- Raisonnement complexe et prise de décision structurée

- Flux de travail de codage et débogage

- Installation rapide avec une configuration minimale

- Les équipes qui ne souhaitent pas gérer l'infrastructure

Des modèles tels que Claude 3.5 Sonnet et les systèmes de type GPT-4 gèrent les flux de travail multi-agents avec une grande fiabilité. Ils interprètent clairement les instructions, gèrent efficacement le raisonnement en plusieurs étapes et répondent rapidement. Les compromis sont évidents :

- Coûts API continus

- Les données sont transmises en dehors de votre environnement local.

- Dépendance à la disponibilité externe

Pour de nombreux utilisateurs, cela est acceptable. Pour d'autres, notamment dans des environnements sensibles, cela peut ne pas l'être.

2. Modèles locaux via Ollama – Contrôle et confinement

Si la confidentialité et l'autonomie sont importantes, l'exécution d'un modèle local via Ollama est un choix judicieux. Dans cette configuration, le modèle reste sur votre machine. Aucun appel d'API externe. Aucune donnée ne quitte votre réseau. Cette solution est particulièrement adaptée pour :

- Flux de travail sensibles aux données

- environnements de développement

- Fonctionnalités hors ligne

- Contrôle total de l'exécution

Ollama prend en charge des modèles tels que Qwen2.5-Coder, la série GLM-4, les variantes Llama 3.1/3.2 et d'autres modèles dotés de grandes fenêtres de contexte adaptées aux agents. Pour OpenClaw, la taille du contexte est importante.

L'agent dépend de la fenêtre de contexte du modèle pour gérer la mémoire ; par conséquent, des fenêtres plus petites peuvent réduire la cohérence lors de sessions longues. Une fenêtre de contexte de 32 000 à 128 000 éléments constitue une base pratique pour un raisonnement stable (selon le modèle ; de nombreux modèles Ollama recommandés pour OpenClaw commencent avec une fenêtre de 32 000 à 128 000 éléments).

Les performances dépendent de votre matériel. Si les réponses sont lentes ou si les appels d'outils sont lents, il s'agit généralement d'un manque de ressources, et non d'une erreur de configuration. L'essentiel est de choisir un modèle adapté à votre mémoire et à votre puissance de traitement disponibles.

3. Faire le choix pratique

Il n'existe pas de solution universelle. Certaines équipes utilisent des modèles cloud pour les calculs complexes et des modèles locaux pour le développement ou les tâches sensibles. D'autres privilégient une seule approche. Choisissez en fonction de :

- Sensibilité de vos données

- exigences de performance

- contraintes budgétaires

- Capacités matérielles

Un modèle adapté ne se contente pas d'améliorer les réponses ; il stabilise l'ensemble du flux de travail. Lorsque la couche de modélisation correspond à vos besoins opérationnels, OpenClaw fonctionne de manière prévisible et efficace.

Comprendre la mémoire persistante

La mémoire persistante est l'une des caractéristiques qui distinguent OpenClaw d'un assistant conversationnel classique. Au lieu de repartir de zéro à chaque fois, elle stocke localement des données persistantes grâce à SQLite pour l'indexation, des fichiers Markdown segmentés comme source de référence et une recherche hybride (BM25 + plongements vectoriels). Il s'agit de bien plus qu'un simple historique de conversation : c'est un contexte organisé auquel l'agent peut se référer ultérieurement pour prendre des décisions.

Par exemple, vous pourriez indiquer à l'agent : “ Mon tableau de bord interne utilise React et Tailwind. Je privilégie les composants fonctionnels. ” Quelques jours plus tard, vous lui demandez de créer un composant d'en-tête. Si sa mémoire fonctionne correctement, il respectera vos préférences initiales sans que vous ayez à les répéter. Cette continuité est assurée par le contexte enregistré, réinjecté dans le processus de raisonnement.

C’est ainsi que l’efficacité se construit au fil du temps. Au lieu de réécrire les instructions à chaque session, vous accumulez un contexte durable au sein du système. Il est judicieux de consulter régulièrement la mémoire stockée pour voir ce qui est enregistré. En comprenant le fonctionnement de la mémoire, vous garantissez la cohérence et la prévisibilité de l’agent à mesure que vos flux de travail se développent.

Création de votre premier véritable flux de travail

Une fois la connexion établie, il est temps de passer de la conversation à l'exécution. OpenClaw devient vraiment utile lorsqu'il exécute des tâches structurées, et non plus seulement des réponses à des questions ouvertes. Cela nécessite de définir clairement un flux de travail, afin que l'agent sache quoi faire et comment confirmer le résultat. Un flux de travail fiable comprend toujours quatre composantes :

- Déclenchement: La commande ou l'événement spécifique qui active le processus, comme par exemple saisir “ nouveau ticket ” dans Telegram.

- Structure d'entrée : Les données exactes dont l'agent a besoin pour accomplir la tâche, par exemple le titre, la description et le niveau d'urgence.

- Exécution de l'outil : L'action définie effectuée par l'agent, telle que l'envoi d'une requête à l'API de votre système de billetterie.

- Résultat de confirmation : Une réponse structurée qui atteste de la réalisation de la tâche, comme le renvoi de l'identifiant du ticket et d'un bref résumé.

Prenons l'exemple simple de l'automatisation des tickets. Lorsque vous saisissez “ nouveau ticket ”, l'agent doit collecter les informations requises, interroger l'API et renvoyer une confirmation. Aucune approximation, aucune supposition. Des déclencheurs clairs et des entrées structurées garantissent la fiabilité du processus. Commencez par un flux de travail ciblé, stabilisez-le, puis développez-le progressivement.

Utilisation d'OpenClaw dans des environnements réels

Une fois votre premier flux de travail stabilisé, l'utilisation réelle commence. C'est à ce stade qu'OpenClaw s'intègre à vos opérations quotidiennes ou reste une expérimentation technique. La différence ne réside pas dans l'ajout d'automatisations supplémentaires, mais dans l'observation du comportement du processus existant en conditions réelles. Laissez-le fonctionner. Testez-le avec différentes entrées. Observez comment il gère les cas limites avant d'aller plus loin.

Au quotidien, la visibilité est essentielle. Consultez l'activité dans l'interface de contrôle. Vérifiez quels outils sont déclenchés et comment les résultats sont structurés. Si les résultats semblent incohérents, la cause est généralement un décalage du périmètre ou des instructions imprécises, plutôt que des limitations du modèle. De petites améliorations de la structure offrent souvent une meilleure stabilité qu'une modification du modèle lui-même.

L'extension doit être progressive. Intégrez les nouvelles tâches graduellement et isolez-les des processus existants jusqu'à ce qu'elles soient prévisibles. OpenClaw est plus performant lorsque les flux de travail sont clairement délimités et que la mémoire reste pertinente. Au quotidien, il ne s'agit pas d'expérimentation constante, mais de faire évoluer de manière maîtrisée un système d'IA que vous comprenez et que vous pouvez gérer avec assurance.

Conseils pratiques et erreurs courantes à éviter

OpenClaw peut fonctionner sans problème pendant des mois, ou se transformer en un exercice constant de dépannage. La différence tient généralement à la rigueur de la gestion. La plupart des problèmes ne proviennent pas du modèle lui-même, mais plutôt des choix de configuration, d'un périmètre imprécis ou de limites négligées. Vous trouverez ci-dessous les pièges les plus courants et les habitudes de performance qui distinguent les déploiements stables des déploiements fragiles.

Erreurs opérationnelles à éviter

Ce sont des schémas que l'on observe fréquemment dans des déploiements réels. Ils ne provoquent peut-être pas de panne immédiate du système, mais ils engendrent des risques et une instabilité à long terme.

- Installation sur un appareil d'entreprise sans autorisation : OpenClaw lit les fichiers locaux et peut envoyer des données à des modèles externes, ce qui peut enfreindre les politiques internes.

- Intégration de code propriétaire dans des modèles cloud sans examen préalable : La transmission de données sensibles via des API peut engendrer des problèmes de conformité et de sécurité.

- Octroi d'un accès illimité au système de fichiers : L'agent ne devrait pas avoir accès à l'intégralité de votre répertoire personnel, sauf en cas d'absolue nécessité.

- Exposer le port de la passerelle pour plus de commodité : L'ouverture publique du port 18789 augmente la surface d'attaque sans réel avantage.

- Considérer la mémoire comme infaillible : La mémoire persistante est puissante, mais elle peut stocker des informations obsolètes ou incorrectes si elle n'est pas révisée.

- Complexifier inutilement le premier flux de travail : Commencer par une automatisation en plusieurs étapes au lieu d'une tâche simple augmente les risques d'erreurs de configuration.

Le principe directeur est simple : limiter le champ d'application, restreindre les autorisations et étendre progressivement une fois la stabilité prouvée.

Optimisation des performances et de la stabilité

Si les performances semblent inconstantes, la cause est souvent d'ordre structurel plutôt qu'inexpliquée. OpenClaw dépend de la capacité du modèle, de la gestion de la mémoire et de la clarté des invites. De petits ajustements permettent généralement d'obtenir un résultat notable.

- Réduisez la taille du modèle lors de l'exécution locale : Les modèles plus grands nécessitent plus de mémoire et de puissance de traitement, ce qui augmente la latence.

- Augmentez la mémoire vive disponible si possible : Le raisonnement local s'améliore lorsque le système dispose d'une marge de manœuvre suffisante.

- Nettoyer les accumulations excessives de mémoire : Les sessions de longue durée avec un contexte stocké important peuvent ralentir le traitement.

- Limiter les boucles d'appel d'outils : Les appels d'outils répétés ou imbriqués peuvent engendrer des retards inutiles.

- Utilisez des consignes structurées plutôt que des instructions ouvertes : Des données d'entrée claires réduisent l'utilisation des jetons et améliorent la précision des réponses.

Les performances s'améliorent lorsque les instructions sont circonscrites et les ressources adaptées à la charge de travail. OpenClaw ne nécessite pas de réglages constants, mais une configuration réfléchie et des attentes réalistes. Dans ces conditions, le système reste efficace et prévisible.

Conclusion

OpenClaw révèle toute sa puissance dès lors qu'on cesse de le considérer comme un simple chatbot et qu'on l'intègre à une infrastructure. Il ne s'agit pas de réponses intelligentes, mais d'une exécution maîtrisée. En définissant un objectif clair, en configurant correctement la passerelle, en choisissant le modèle adapté et en structurant soigneusement votre premier flux de travail, le système devient moins expérimental et plus opérationnel.

La clé, c'est la discipline. Commencez par un périmètre restreint. Protégez votre environnement. Mettez en place un flux de travail fiable, puis élargissez-le. OpenClaw privilégie la clarté. Plus vos entrées et permissions sont claires, plus les résultats sont prévisibles. Utilisé correctement, OpenClaw n'est pas qu'une simple interface de messagerie avec des outils intégrés. C'est une couche d'exécution d'IA contrôlable, intégrable au travail réel. C'est là que réside sa valeur ajoutée.

FAQ

L'installation en elle-même est simple si vous suivez les instructions officielles. La plupart des difficultés proviennent d'objectifs mal définis, et non de complexités techniques. Si vous définissez un processus précis avant l'installation, la configuration sera beaucoup plus fluide.

Oui, si vous utilisez un modèle local via Ollama. Dans cette configuration, le modèle et la passerelle s'exécutent sur votre machine. Aucun appel d'API externe n'est requis. Notez que les performances dépendent des capacités de votre matériel.

Cela dépend des politiques de votre organisation. OpenClaw peut lire les fichiers locaux et interagir avec des modèles externes. Son installation sur un appareil professionnel sans autorisation peut enfreindre les règles de sécurité internes. Il est préférable d'utiliser un ordinateur personnel ou un environnement dédié.

Commencez par des actions mesurables et peu risquées, comme la synthèse des journaux, la rédaction de messages structurés ou la création de tickets. Évitez les automatisations complexes en plusieurs étapes au début. À ce stade, la stabilité prime sur l'ambition.

La mémoire persistante permet à l'agent de conserver le contexte d'une session à l'autre, ce qui améliore la continuité. Cependant, des fenêtres de contexte plus larges et des sessions longues peuvent accroître la consommation de ressources, notamment avec les modèles locaux. La consultation périodique de la mémoire stockée contribue à maintenir la clarté et l'efficacité.