OpenClaw es una herramienta de código abierto que te permite convertir un potente modelo de lenguaje en un asistente personal que realmente hace cosas. Chateas con él en WhatsApp, Telegram, Discord, Slack o aplicaciones similares, y puede leer y enviar correos electrónicos, administrar tu calendario, navegar por la web, trabajar con archivos, ejecutar scripts sencillos; básicamente, actúa como un compañero de trabajo servicial que nunca duerme.

Lo más importante es el modelo de IA que conectes. OpenClaw es simplemente el mensajero y el ejecutor. El verdadero pensamiento, la memorización y la decisión ocurren dentro del modelo que elijas. Si eliges el incorrecto, las cosas se romperán, costarán demasiado o se volverán inseguras. Si eliges una buena combinación, la experiencia será fluida y confiable.

Por qué la elección del modelo lo cambia todo

Cada vez que se le da un comando a OpenClaw, este envía al modelo todo el historial de la conversación hasta el momento; a veces, cientos de miles de palabras si la conversación lleva días en curso. El modelo debe comprenderlo todo, recordar lo dicho anteriormente, determinar qué hacer a continuación y escribir instrucciones muy precisas (llamadas a herramientas) para que OpenClaw sepa qué botón presionar o qué correo electrónico enviar.

Si el modelo empieza a olvidar detalles de mensajes anteriores (incluso de hace solo diez vueltas), rápidamente empieza a cometer errores y a abandonar el hilo. Si se altera el formato o la lógica de las llamadas a herramientas, las acciones fallan por completo o acaban afectando al objetivo equivocado: correo electrónico incorrecto enviado, evento de calendario incorrecto modificado, archivo incorrecto accedido. Y si el modelo se deja engañar fácilmente por un texto engañoso oculto en un correo electrónico entrante o en una página web que visita, un mensaje malicioso puede inducir a su asistente a ejecutar comandos dañinos o filtrar información confidencial.

Así que el modelo no es solo "inteligente o no inteligente". Debe ser bueno en tres aspectos importantes para OpenClaw:

- mantener una memoria larga sin confundirse

- siguiendo instrucciones con mucha precisión

- llamar a herramientas (funciones) correctamente cada vez

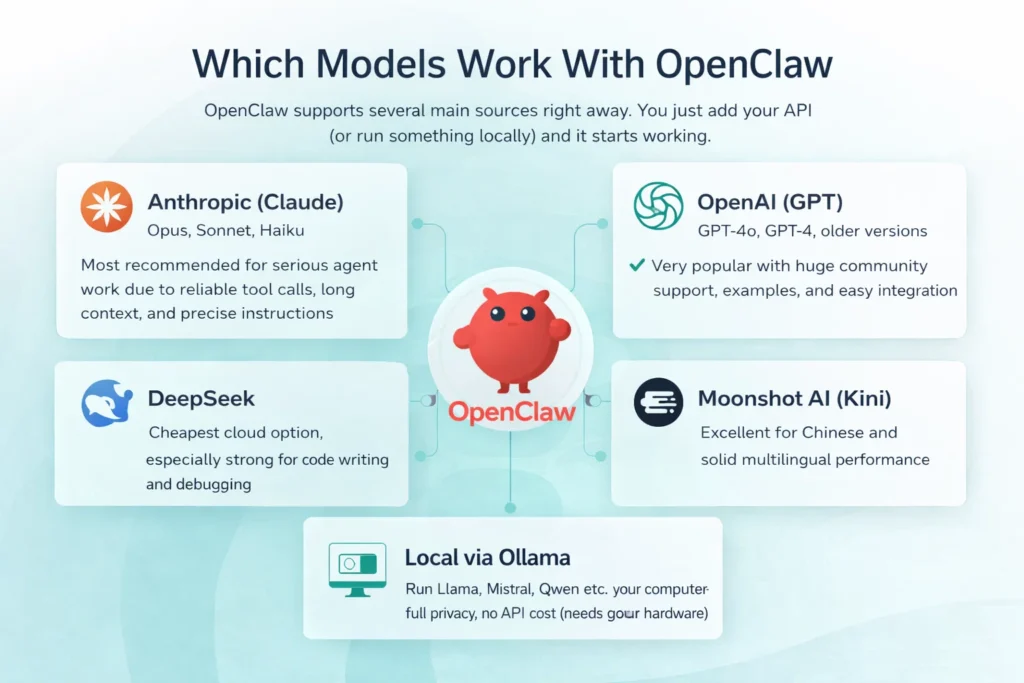

¿Qué modelos funcionan con Openclaw?

OpenClaw admite varias fuentes principales de inmediato. Simplemente añade tu clave API (o ejecuta algo localmente) y empieza a funcionar.

- Antrópico (Claude):Opus, Sonnet, Haiku: los más recomendados para trabajos serios con agentes debido a llamadas de herramientas confiables, contexto extenso e instrucciones precisas.

- OpenAI (GPT):GPT-4o, GPT-4, versiones anteriores: muy populares con un gran apoyo de la comunidad, ejemplos y fácil integración.

- Búsqueda profunda:la opción en la nube más económica, especialmente potente para escribir y depurar código.

- Inteligencia artificial de Moonshot (Kimi):Excelente para chino y sólido desempeño multilingüe.

- Local vía Ollama:Ejecute Llama, Mistral, Qwen, etc. en su computadora: privacidad total, sin costo de API (necesita buen hardware).

FlyPix AI + OpenClaw: Más tiempo para tomar decisiones, menos trabajo manual

En FlyPix AI Nos especializamos en la automatización del análisis geoespacial a partir de imágenes satelitales, de drones y aéreas. Detectamos objetos, los contamos, medimos áreas, rastreamos cambios a lo largo del tiempo y entregamos informes o mapas claros. Esto ayuda a nuestros clientes en la supervisión de la construcción, la agricultura, las evaluaciones ambientales, la inspección de infraestructura y la planificación urbana.

Nuestra plataforma ahorra hasta un 99,71 TP3T del tiempo que antes se dedicaba a tareas SIG manuales. Ya no se necesita software costoso ni analistas especializados: nuestra interfaz sin código permite a cualquier equipo crear modelos personalizados para sus objetos específicos.

Sabemos que incluso después de completar el análisis, queda una cantidad significativa de trabajo administrativo: redactar informes, organizar archivos de imágenes y resultados, programar revisiones de seguimiento o visitas de campo, clasificar correos electrónicos con nuevos datos y preparar actualizaciones para las partes interesadas.

Es exactamente por eso que vemos a OpenClaw como un complemento natural y poderoso.

Nuestros clientes pueden usar un asistente de IA local gratuito (por ejemplo, con Ollama) que mantiene el máximo nivel de privacidad de datos y funciona sin conexión, algo fundamental al gestionar imágenes sensibles. OpenClaw se encarga automáticamente de todas las tareas de seguimiento: redacta informes a partir de nuestros análisis, organiza archivos por proyecto o fecha, gestiona calendarios, investiga normativas o estudios relevantes y envía resúmenes breves.

Modelos GPT: flexibles y familiares

Los modelos GPT de OpenAI siguen siendo una opción muy sólida y ampliamente utilizada para OpenClaw, particularmente entre las personas que ya se sienten cómodas trabajando dentro del ecosistema OpenAI.

Estos modelos funcionan especialmente bien cuando necesita respuestas rápidas a preguntas simples o directas, cuando genera código o scripts con frecuencia y requiere resultados estructurados limpios como listas, tablas o JSON, o cuando desea aprovechar la enorme colección de ejemplos, bibliotecas, tutoriales y herramientas creadas por la comunidad existentes que rodean las API de OpenAI.

En comparación con los últimos modelos de Claude, las variantes de GPT a veces muestran una consistencia ligeramente menor durante conversaciones muy largas o cuando se requieren llamadas a herramientas de varios pasos extremadamente estrictas. Sin embargo, la diferencia práctica sigue siendo pequeña para la mayoría de los flujos de trabajo cotidianos. Si ya tiene una suscripción a OpenAI, tiene acceso a créditos gratuitos o simplemente valora su velocidad y familiaridad, GPT-4o (o una variante similar) suele ser el punto de partida más sencillo y práctico. Muchos usuarios de OpenClaw comienzan con GPT por su accesibilidad y solo se pasan a Claude más adelante, cuando se encuentran con tareas que exigen un razonamiento más preciso o medidas de seguridad integradas más robustas.

Claude: La elección seria más común

Los modelos Claude de Anthropic son la opción más popular entre los usuarios serios de OpenClaw porque están diseñados para ser cuidadosos, lógicos y excelentes para seguir instrucciones largas y detalladas.

- Nivel superior (nivel Opus): ideal cuando se manejan datos confidenciales (finanzas, salud, legales, información privada), flujos de trabajo complejos de varios pasos o cuando la seguridad es crítica (resistencia muy fuerte a inyecciones rápidas y trucos).

- Nivel medio (nivel de soneto):lo que la mayoría de la gente usa a diario: maneja correo electrónico, calendario, búsquedas web y automatizaciones estándar de manera confiable, con un excelente equilibrio entre calidad y costo y respuestas lo suficientemente rápidas.

- Nivel ligero (nivel Haiku):barato y muy rápido, pero sólo es adecuado para comandos simples de un solo paso donde los errores ocasionales no importan mucho.

Es por eso que Claude a menudo se convierte en la recomendación predeterminada o principal: se adapta a las necesidades de OpenClaw en cuanto a confiabilidad, contexto extenso y uso seguro de herramientas mejor que la mayoría de las alternativas.

Deepseek: Cuando no quieres gastar casi nada

Los modelos DeepSeek son populares entre los usuarios de OpenClaw que priorizan los costos más bajos posibles. Su costo es mucho menor que el de Claude o GPT y, aun así, gestionan tareas básicas y moderadas con eficacia.

Funcionan bien para:

- Ordenar y responder correos electrónicos sencillos

- Cambios básicos en el calendario (agregar, verificar, mover eventos)

- Ayuda rápida con el código, pequeños scripts, depuración de rutina

- Automatizaciones sencillas sin planificación profunda

Para un uso diario ligero a medio (20 a 50 interacciones), suelen costar entre 5 y 20 veces menos que los modelos premium y, al mismo tiempo, siguen siendo utilizables para trabajos no críticos.

Las compensaciones son reales:

- Más débil en conversaciones largas (olvida los detalles más rápido)

- Tiene dificultades con flujos de trabajo complejos de varios pasos

- Menos preciso en tareas de alto riesgo (finanzas, asuntos legales, comunicación con clientes)

- Menor resistencia a la inyección inmediata que Claude

Mejor ajuste:presupuesto ajustado, tareas mayormente simples/medianas, y se acepta una confiabilidad ligeramente menor en cosas más difíciles.

Muchos usuarios ejecutan DeepSeek para 80–90% de trabajo rutinario y cambian a modelos más potentes solo para casos sensibles o complejos: esto mantiene las facturas muy bajas y al mismo tiempo cubre lo que importa.

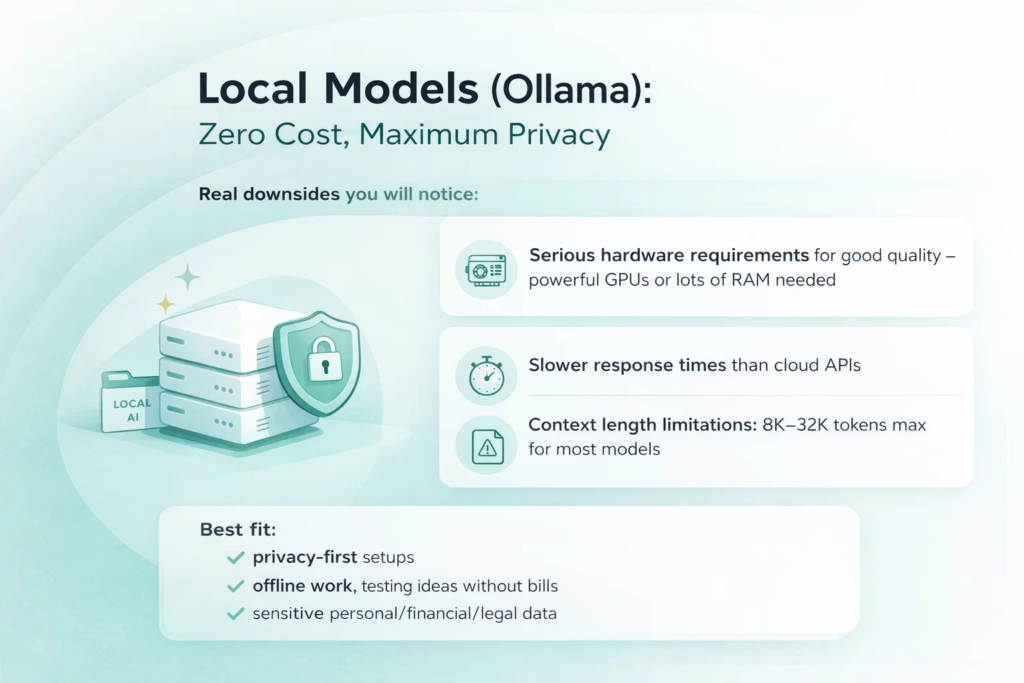

Modelos Locales (Ollama): Costo Cero, Máxima Privacidad

Si no desea que sus datos salgan de su equipo, los modelos locales a través de Ollama son la única solución viable. Descargue un modelo de peso abierto, ejecútelo en su propio hardware y OpenClaw se comunica con él directamente a través de un servidor local: sin claves API, sin proveedor de nube ni registros en ningún otro lugar.

Los modelos más grandes (con parámetros de alrededor de 70 B, como Llama 3.1 70B, Qwen 2.5 72B o las variantes de Mistral) pueden ofrecer un rendimiento sorprendentemente cercano al de los modelos de nube de gama media en muchas tareas de OpenClaw: gestión de correo electrónico, gestión de calendario, búsqueda web básica y ayuda con código simple. En una máquina con hardware potente (más de 48 GB de RAM, buena GPU o memoria unificada en Apple Silicon), resultan útiles para el trabajo diario.

Los modelos más pequeños (7B–13B, como Llama 3.1 8B, Phi-3 Mini, Mistral 7B) funcionan bien incluso en portátiles comunes con 16–32 GB de RAM. Son rápidos y económicos, pero claramente más débiles: tienen dificultades para el razonamiento de varios pasos, olvidan el contexto fácilmente y cometen más errores en tareas complejas.

Desventajas reales que notarás:

- Los requisitos de hardware son importantes para lograr una buena calidad: los modelos grandes necesitan GPU potentes o mucha RAM; sin eso, todo se ralentiza drásticamente.

- Los tiempos de respuesta suelen ser más lentos que los de las API en la nube (segundos más largos por respuesta, a veces mucho más largos en máquinas más débiles)

- La longitud del contexto es limitada: la mayoría de los modelos locales tienen un límite de entre 8 000 y 32 000 tokens (algunos más nuevos superan ese límite con trucos), mientras que las sesiones de OpenClaw a menudo crecen mucho más allá de eso, por lo que el agente comienza a perder detalles anteriores.

Mejor ajuste:configuraciones que priorizan la privacidad, trabajo sin conexión, probar ideas sin facturas o cuando procesa datos personales, financieros o legales confidenciales que no confía a ningún servicio en la nube.

¿Cuánto cuesta cada modelo al mes con OpenClaw?

Los costos mensuales dependen del modelo y el nivel de uso. OpenClaw envía el historial completo de conversaciones cada vez, por lo que los chats más largos y las tareas frecuentes aumentan rápidamente el uso de tokens. El uso ligero se realiza entre 10 y 15 tareas al día, el moderado entre 30 y 50, y el intensivo, más de 100 (agente siempre activo).

Costos mensuales aproximados basados en patrones reales de usuarios:

- Claude de primer nivel (nivel Opus): ligero $80–150, moderado $200–400, pesado $500–750+

- Claude de nivel medio (nivel soneto): ligero $15–30, moderado $40–80, pesado $100–200

- GPT-4o (AI abierta): ligero $12–25, moderado $30–60, pesado $80–150

- DeepSeek o Claude ligero (nivel Haiku): leve a moderado $5–15 o menos, intenso generalmente por debajo de $30

- Modelos locales vía Ollama:Costo API $0 (solo electricidad y hardware)

Las cifras reales varían según la duración de la sesión, las llamadas a herramientas y la eficiencia de las solicitudes. Realice un seguimiento del uso en el panel de control de OpenClaw o en la consola del proveedor durante una semana para ver su gasto real. Elegir el nivel adecuado para su carga de trabajo le permite ahorrar más dinero.

Guía rápida: Qué modelo para qué trabajo en OpenClaw

| Trabajo/Caso de uso | Modelo(s) recomendado(s) | Por qué este modelo se adapta mejor |

| Asistente diario (correo electrónico, calendario, mensajes, búsqueda rápida) | Claude Medio (nivel Soneto) o GPT-4o | Confiable para tareas diarias, buen equilibrio entre velocidad y costo, maneja bien el contexto y las herramientas. |

| Codificación pesada, escritura y corrección de scripts, automatizaciones que deben funcionar a la primera. | Claude fuerte (nivel Opus) o GPT fuerte | Razonamiento superior, salida de código precisa, menos errores en lógica compleja y depuración |

| Lectura de documentos extensos, resumen de informes grandes, análisis profundos | Claude (cualquier nivel, preferiblemente medio/superior) o Géminis (si está disponible) | Excelente manejo de contextos largos y extracción/resumen estructurado |

| Trabajo súper privado: no se pierden datos de tu dispositivo | Gran modelo local vía Ollama (p. ej. Llama 70B, Qwen, Mistral) | Todo el procesamiento permanece en su hardware, total privacidad, sin llamadas API |

| Presupuesto muy ajustado, solo tareas básicas/simples | DeepSeek o modelo local pequeño | Costo extremadamente bajo (o gratuito), aún decente para comandos de un paso y automatizaciones ligeras |

| Mucho trabajo multilingüe en chino o en otros idiomas. | Kimi (IA de Moonshot) o GPT-4o | Fuerte desempeño multilingüe, especialmente fluido y preciso en chino. |

Lo que realmente importa al comparar modelos para Openclaw

Estas son las principales cosas que la gente realmente verifica en la práctica al elegir un modelo para OpenClaw:

- Con qué precisión y fiabilidad realiza llamadas a herramientas sin errores de formato ni de lógica

- Qué bien mantiene un largo historial de conversaciones sin olvidar ni mezclar detalles anteriores

- Cuán estrictamente sigue sus instrucciones exactas sin agregar, omitir ni cambiar cosas

- Con qué eficacia divide tareas complejas en pasos pequeños, seguros y correctos

- Qué tan rápido responde (hace que el chat se sienta natural en lugar de lento)

- ¿Cuánto cuesta al mes su uso diario normal?

Concluyendo

No existe un modelo único "ideal" para OpenClaw. Depende de lo que hagas con más frecuencia, de tu presupuesto y de si te importa más la privacidad o la velocidad.

Los modelos de Claude (especialmente el del medio) siguen siendo la apuesta más segura para la mayoría de las personas que desean un comportamiento confiable del agente sin correcciones constantes.

Los modelos GPT son excelentes si ya vives en el mundo OpenAI o necesitas respuestas creativas rápidas.

DeepSeek ahorra mucho dinero cuando la calidad no tiene por qué ser perfecta.

Los modelos locales le brindan control total y cero costos continuos, si tiene el hardware.

Empieza con lo que te resulte más fácil de configurar (normalmente Claude Sonnet o GPT-4o), úsalo durante una semana, observa qué te molesta y luego prueba algo diferente. OpenClaw facilita el cambio, así que no estás atado.

Preguntas frecuentes

Empieza con Claude Sonnet (versión intermedia). Es fiable, se adapta bien a la mayoría de las tareas diarias y existen muchas guías para ello.

Sí. Puedes cambiar de modelo en cualquier momento o configurar modelos diferentes para distintas tareas o agentes en la configuración.

Para tareas sencillas o privadas, sí, especialmente las de gran envergadura en hardware potente. Para conversaciones complejas y largas, o de alta seguridad, los modelos en la nube suelen ser mejores.

Es muy eficaz para seguir instrucciones con precisión, recordar conversaciones largas y llamar a herramientas correctamente. Esto reduce las automatizaciones defectuosas y los riesgos de seguridad.

Sí, si tus tareas son básicas o medianas y no te importa una fiabilidad ligeramente inferior en tareas difíciles, es una de las maneras más económicas de obtener buenos resultados.

Sí. Los modelos que son más difíciles de engañar y que siguen reglas estrictas hacen que todo el sistema sea más seguro, especialmente al leer correos electrónicos o sitios web aleatorios.

Revisa tu recuento diario de mensajes. Uso ligero: casi cualquier modelo es económico. Uso intensivo: los modelos más económicos (DeepSeek, Haiku, local) son los que más ahorran. Consulta el uso de tokens en el panel de control después de una semana.