El reconocimiento de imágenes ha pasado silenciosamente de los laboratorios de investigación a los sistemas cotidianos. Etiqueta fotos, guía vehículos autónomos, escanea imágenes médicas y monitoriza infraestructuras a gran escala. En teoría, las cifras de precisión suelen parecer impresionantes. En la práctica, el panorama es más matizado.

La precisión en el reconocimiento de imágenes no es una cifra única y no significa lo mismo en todos los contextos. Un modelo que funciona bien con imágenes de referencia limpias puede tener dificultades en condiciones reales, ángulos inusuales, poca iluminación o escenas complejas. Para comprender la precisión real de esta tecnología, conviene analizar más allá de los titulares y analizar cómo se mide la precisión, dónde se mantiene y dónde persisten las deficiencias.

Este artículo lo explica en términos sencillos, sin exageraciones y centrándose en cómo se comporta el reconocimiento de imágenes fuera de demostraciones controladas.

Precisión en el reconocimiento de imágenes

La precisión en el reconocimiento de imágenes no implica que un sistema siempre vea lo que ve un humano. Significa que, en condiciones definidas, un modelo produce predicciones que se alinean con los datos etiquetados según reglas específicas.

La mayoría de los sistemas se evalúan utilizando conjuntos de datos estructurados cuyas imágenes se anotan previamente. Un modelo se considera preciso cuando sus predicciones coinciden con dichas anotaciones dentro de los umbrales aceptados. Esto ya introduce una limitación: los modelos se comparan con etiquetas humanas, no con la realidad misma.

La precisión también varía según la tarea. La clasificación de imágenes se centra en identificar lo presente. La detección de objetos añade el requisito de localizarlos. La segmentación va más allá al definir límites precisos. Cada paso aumenta la complejidad y presenta nuevas posibilidades de error.

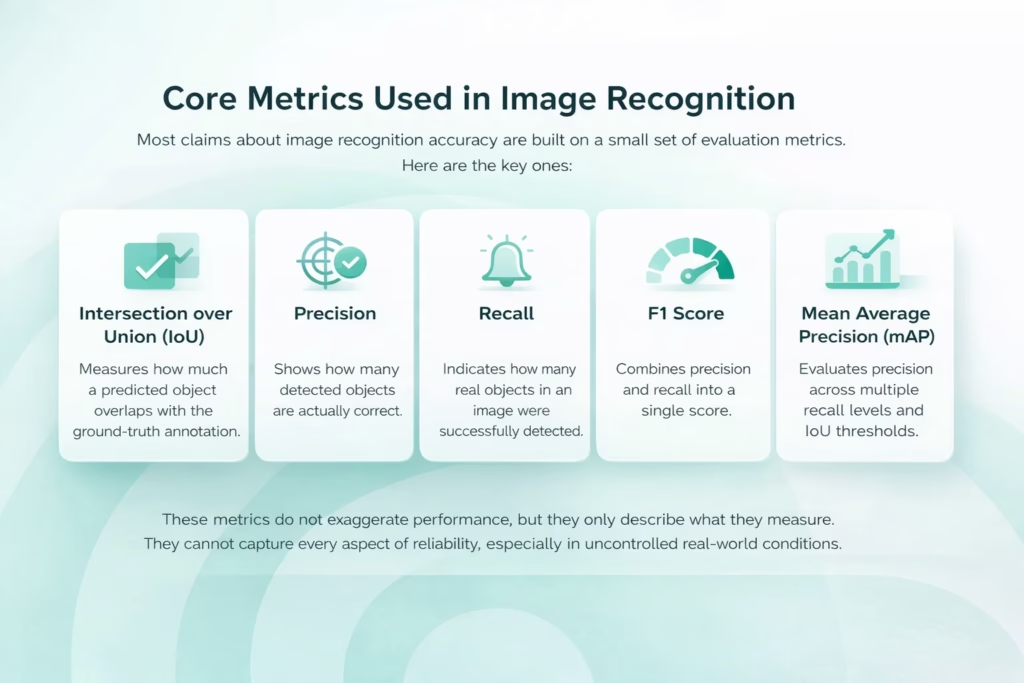

Métricas básicas utilizadas en el reconocimiento de imágenes

La mayoría de las afirmaciones sobre la precisión del reconocimiento de imágenes se basan en un pequeño conjunto de métricas de evaluación. Cada una de ellas captura un aspecto diferente del rendimiento, y ninguna de ellas, por sí sola, ofrece la información completa.

- Intersección sobre unión (IoU). Mide la proximidad de un objeto predicho con la anotación de la verdad fundamental. Se centra en la alineación espacial, no solo en si se detectó un objeto.

- Precisión. Muestra cuántos objetos detectados son realmente correctos. Una alta precisión implica menos falsos positivos.

- Recordar. Indica cuántos objetos reales se detectaron correctamente en una imagen. Una alta tasa de recuperación implica menos objetos omitidos.

- Puntuación F1. Combina precisión y recuperación en un único valor. Útil para la comparación, pero puede ocultar importantes disyuntivas entre falsos positivos y falsos negativos.

- Precisión media promedio (mAP). Se usa comúnmente para la detección de objetos. Evalúa la precisión en múltiples niveles de recuperación y umbrales de IoU. Es potente, pero a menudo se malinterpreta o se cita sin contexto.

Estas métricas no exageran el rendimiento, sino que solo describen lo que están diseñadas para medir. No pueden capturar todos los aspectos de la confiabilidad, especialmente cuando los sistemas pasan de conjuntos de datos controlados a condiciones reales.

Precisión en el reconocimiento de imágenes con FlyPix AI

En FlyPix AI, Trabajamos con reconocimiento de imágenes en datos geoespaciales del mundo real, donde la precisión se evalúa según la escala, la complejidad y las condiciones cambiantes. Las imágenes satelitales, aéreas y de drones rara vez se ven nítidas, por lo que la precisión debe superar los parámetros de referencia.

Nos centramos en que el reconocimiento de imágenes sea útil en la práctica. Esto implica agentes de IA que detectan y delimitan objetos rápidamente, pero también modelos entrenados con datos específicos de la industria en lugar de ejemplos genéricos. El entrenamiento personalizado permite que la precisión refleje el trabajo real de los equipos, ya sea en construcción, agricultura o monitoreo de infraestructura.

Para nosotros, la precisión no es un solo número. Se trata de consistencia en grandes conjuntos de datos, fiabilidad a lo largo del tiempo y un rendimiento estable a medida que los proyectos pasan de la fase piloto a la producción. Ese es el estándar en torno al cual construimos FlyPix AI.

Por qué la precisión de los puntos de referencia puede ser engañosa

Las puntuaciones altas en los benchmarks son reales, pero pueden dar una impresión errónea. Muchos sistemas de reconocimiento de imágenes reportan resultados excelentes en conjuntos de datos populares, y es fácil interpretarlo como un "problema resuelto". El problema es que los benchmarks suelen recompensar el rendimiento en condiciones más limpias y predecibles que las que enfrentan los sistemas después de la implementación.

Los puntos de referencia a menudo ponen a prueba la parte fácil

El problema no es que los resultados de las pruebas de referencia sean incorrectos, sino que muchas pruebas de referencia son más sencillas que las condiciones reales. Las imágenes en conjuntos de datos seleccionados suelen tener sujetos claros, perspectivas familiares y composiciones relativamente nítidas. La iluminación es estable, los objetos están centrados y los casos inusuales que rompen los modelos en producción son menos frecuentes.

Cuando los modelos aprenden y se evalúan con ese tipo de datos, se vuelven muy competentes en lo que ven con mayor frecuencia. Luego se enfrentan al mundo real: diferentes ángulos de cámara, fondos más desordenados, cambios estacionales, desenfoque de movimiento, oclusión y objetos que no se parecen a los de los libros de texto. El rendimiento puede disminuir drásticamente, y esa disminución rara vez se aprecia en las cifras de precisión.

La dificultad de la imagen es desigual, pero las métricas la tratan como si fuera igual

Una forma útil de pensarlo es esta: no todas las imágenes son igualmente reconocibles, ni siquiera para los humanos. Algunas imágenes se comprenden al instante. Otras requieren una segunda mirada, más contexto o simplemente más tiempo.

La evaluación tradicional trata todas las imágenes como si tuvieran el mismo peso de dificultad, lo que distorsiona el significado de "precisión". Muchos conjuntos de datos de referencia se basan principalmente en imágenes fáciles de reconocer. Esto es importante porque los modelos pueden parecer mucho mejores, aunque lo hacen principalmente en el extremo fácil del espectro, no en los casos realmente desafiantes.

Los modelos más grandes suelen mostrar este patrón con claridad: mejoras significativas en imágenes más sencillas y menor progreso en las más complejas. Por lo tanto, la puntuación media aumenta, pero la diferencia en imágenes complejas del mundo real sigue siendo considerable.

Los humanos y los modelos fallan de manera diferente

Los humanos y las máquinas no abordan el reconocimiento de la misma manera. Las personas se basan en el contexto, la memoria y el razonamiento flexible. Los modelos se basan en patrones estadísticos aprendidos. Esa diferencia se hace evidente en el momento en que una imagen se vuelve ambigua, desordenada o desconocida.

Los humanos a menudo pueden recuperarse de información parcial y aun así tomar una decisión acertada. Los modelos tienden a ser más frágiles, y cuando el patrón se rompe, el fallo puede ser abrupto. Algunos sistemas más nuevos que combinan visión y lenguaje se comportan de forma más similar a la humana ante entradas inusuales, pero la robustez a nivel humano aún no es la norma.

Esta es también la razón por la que las afirmaciones generalizadas de que “la IA supera a los humanos en visión” suelen provenir de comparaciones de referencia limitadas. En entornos desordenados y sin control, la situación es más compleja, y es precisamente ahí donde la precisión es fundamental.

Precisión en aplicaciones del mundo real

Uso industrial y de infraestructura

En entornos controlados, el reconocimiento de imágenes puede ser muy preciso. Las cámaras fijas, la iluminación estable y la limitación de tipos de objetos permiten que los sistemas funcionen de forma constante. Esto es común en la inspección de fabricación y la monitorización de infraestructuras.

Vehículos autónomos y sistemas críticos para la seguridad

En entornos dinámicos como las carreteras, mantener la precisión se vuelve más difícil. La iluminación, el clima y los objetos impredecibles suponen un reto incluso para los sistemas más avanzados. En estos casos, la fiabilidad bajo presión es más importante que la precisión promedio.

Imágenes médicas

El reconocimiento de imágenes médicas se rige por requisitos estrictos. Las imágenes son sutiles y hay mucho en juego. Incluso los pequeños errores importan. Las mejoras en la precisión son valiosas, pero los sistemas requieren una validación minuciosa y supervisión humana.

Vigilancia y seguridad

Los sistemas de vigilancia enfrentan desafíos adicionales relacionados con el sesgo, la imparcialidad y la variación ambiental. La precisión puede variar según la demografía o la ubicación, lo que plantea inquietudes que van más allá del rendimiento técnico.

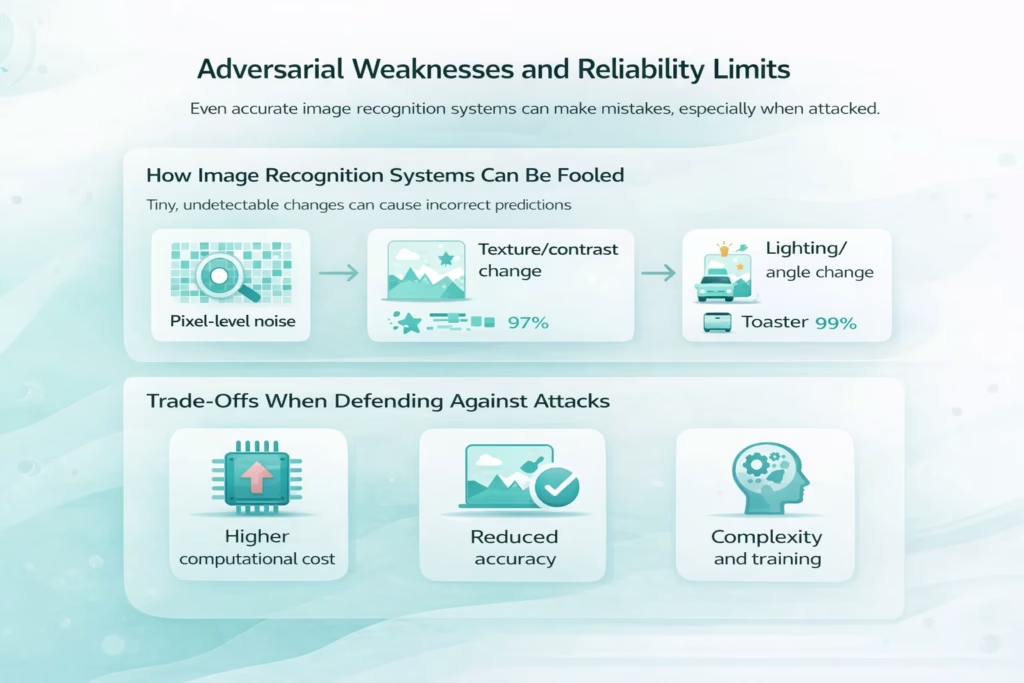

Debilidades adversarias y límites de confiabilidad

Incluso los sistemas de reconocimiento de imágenes de alta precisión pueden fallar de forma inesperada. Estos fallos no siempre son evidentes y suelen ocurrir en situaciones que parecen triviales para un observador humano.

Cómo se pueden engañar los sistemas de reconocimiento de imágenes

Pequeños cambios realizados cuidadosamente en una imagen pueden provocar que un modelo haga predicciones confiables pero incorrectas.

- Ruido leve a nivel de píxel que es invisible para el ojo humano

- Cambios sutiles de textura o contraste que alteran los patrones aprendidos

- Ligeros cambios en la iluminación, el ángulo o la composición del fondo.

- Perturbaciones artificiales diseñadas específicamente para confundir los modelos

Para una persona, la imagen sigue siendo la misma. Para el modelo, de repente puede pertenecer a una categoría completamente diferente.

Compensaciones en la defensa contra ataques

Existen técnicas para hacer los modelos más robustos, pero rara vez son gratuitas.

- Mayor coste computacional e inferencia más lenta

- Precisión reducida en imágenes limpias y no adversarias

- Canalizaciones de formación y mantenimiento más complejas

- Mayores costos de implementación y operación

Debido a estas compensaciones, muchos sistemas del mundo real aceptan un nivel de fragilidad en lugar de aspirar a una resistencia adversa total.

Por qué la precisión por sí sola no es suficiente

Un sistema puede ser preciso en promedio y aun así fallar en los momentos más importantes. Muchos modelos de reconocimiento de imágenes funcionan bien con datos familiares, pero fallan al encontrar casos extremos, condiciones inusuales o escenarios mal representados durante el entrenamiento. Estos fallos no siempre son graves. A menudo, el sistema continúa funcionando como si nada fallara, generando resultados que parecen confiables, pero que son discretamente incorrectos.

Por ello, la consistencia y la transparencia suelen ser más importantes que la precisión de las cifras. Los equipos necesitan comprender cómo se comporta un sistema cuando existe incertidumbre, dónde se encuentran sus puntos ciegos y cómo surgen los errores. Una implementación responsable depende de saber no solo con qué frecuencia un modelo acierta, sino también cómo y por qué falla cuando las cosas se salen del guion.

Entonces, ¿qué tan precisa es la tecnología de reconocimiento de imágenes?

En condiciones controladas, la tecnología de reconocimiento de imágenes puede ser extremadamente precisa. Cuando las tareas son limitadas, los entornos son estables y los datos se ajustan estrechamente a los conjuntos de entrenamiento, el rendimiento puede igualar o incluso superar los resultados humanos. Por eso, la tecnología funciona tan bien en entornos estructurados como la inspección de fabricación o la monitorización de infraestructuras fijas.

En entornos complejos del mundo real, la precisión disminuye notablemente. Los modelos tienen dificultades con eventos inusuales, contextos desconocidos y cambios en la distribución de datos a lo largo del tiempo. El progreso en el reconocimiento de imágenes es real, pero desigual. Las métricas de precisión capturan parte de la historia, no la imagen completa, y deben interpretarse teniendo en cuenta el contexto, el riesgo y el comportamiento en el mundo real.

Conclusión

La precisión del reconocimiento de imágenes no es una promesa. Es un resultado condicional determinado por los datos, los métodos de evaluación y el contexto.

Cuando se utiliza con cuidado, con expectativas realistas y las medidas de seguridad adecuadas, el reconocimiento de imágenes ofrece un valor real. Si se considera infalible, conlleva riesgos.

La pregunta más importante no es la precisión teórica del reconocimiento de imágenes, sino su comportamiento en las condiciones específicas donde se implementa. Ahí es donde la precisión cobra importancia.

Preguntas frecuentes

El reconocimiento de imágenes puede ser muy preciso en entornos controlados y tareas bien definidas. En condiciones reales, la precisión varía según la calidad de los datos, el contexto y la coincidencia entre las condiciones de implementación y los datos de entrenamiento.

La precisión refleja la precisión con la que las predicciones de un modelo coinciden con los datos etiquetados bajo reglas de evaluación específicas. No mide la comprensión, el razonamiento ni la fiabilidad en condiciones inesperadas.

Muchos benchmarks contienen imágenes nítidas y predecibles, más fáciles de reconocer que los datos del mundo real. Como resultado, los modelos pueden alcanzar puntuaciones altas sin ser robustos a la variación, el ruido o escenarios inusuales.

En tareas específicas y repetitivas con imágenes claras, los sistemas de reconocimiento de imágenes pueden superar a los humanos. En situaciones complejas, ambiguas o desconocidas, los humanos suelen ser más fiables.

Las métricas comunes incluyen la intersección sobre la unión (IoU), la precisión, la recuperación, la puntuación F1 y la precisión media promedio (mAP). Cada métrica captura un aspecto diferente del rendimiento y debe interpretarse en conjunto, no de forma aislada.