El reconocimiento de imágenes parece complejo, pero la idea central es sorprendentemente sencilla. Una máquina analiza las imágenes como datos, aprende patrones a partir de ejemplos y utiliza esa experiencia para reconocer lo que ve la próxima vez. El verdadero trabajo reside en cómo se preparan esos ejemplos, cómo el modelo aprende de ellos y qué tan bien se mantiene ese aprendizaje fuera del laboratorio.

En este artículo, explicaremos paso a paso cómo funciona el reconocimiento de imágenes en el aprendizaje automático. Sin matemáticas complejas ni palabras de moda. Simplemente una visión clara de cómo las imágenes se convierten en señales, cómo los modelos aprenden a interpretarlas y por qué algunos sistemas funcionan bien en condiciones reales mientras que otros fallan.

Qué significa realmente el reconocimiento de imágenes en el aprendizaje automático

En esencia, el reconocimiento de imágenes se basa en la clasificación y la identificación. Un sistema recibe una imagen y responde a preguntas como:

- ¿Qué hay en esta imagen?

- ¿Dónde se encuentra un objeto específico?

- ¿Cuántos objetos hay presentes?

- ¿Estas imágenes pertenecen a la misma categoría?

En términos de aprendizaje automático, el reconocimiento de imágenes forma parte de la visión artificial. Esta se centra en enseñar a las máquinas a interpretar datos visuales de forma útil para la toma de decisiones.

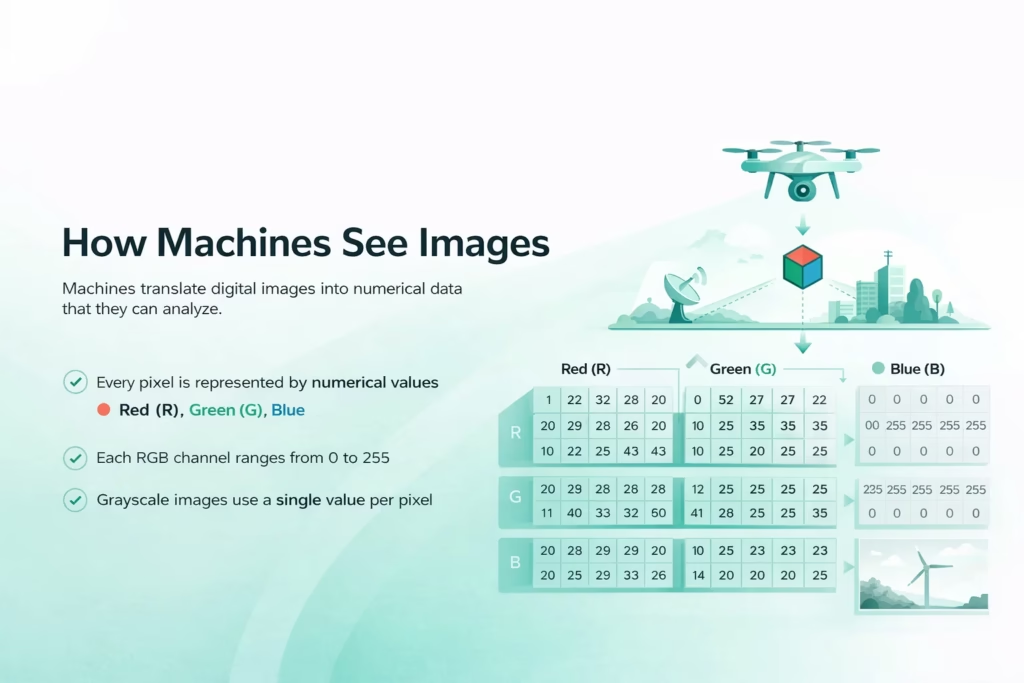

Una distinción importante que hay que hacer desde el principio es que las máquinas no ven las imágenes como los humanos. Una persona ve un gato. Una máquina ve una cuadrícula de números. Todo lo que sigue en el reconocimiento de imágenes existe para salvar esa brecha.

Cómo ven las imágenes las máquinas

Antes de que se produzca cualquier aprendizaje, una imagen debe traducirse a un formato con el que una máquina pueda trabajar. Las imágenes digitales están compuestas de píxeles. Cada píxel contiene valores numéricos que describen la intensidad del color.

En una imagen RGB estándar, cada píxel contiene tres valores:

- Rojo

- Verde

- Azul

Cada valor suele oscilar entre 0 y 255. Un píxel negro se representa con ceros. Un píxel blanco utiliza los valores máximos. Una imagen completa es simplemente una gran matriz de estos números.

Las imágenes en escala de grises simplifican esto al usar un solo valor por píxel, lo que reduce la complejidad y a menudo es suficiente para tareas que dependen de la forma o el contraste en lugar del color.

En esta etapa, la imagen no tiene significado. Son solo datos. La función del reconocimiento de imágenes consiste en aprender qué patrones de esos datos son importantes.

El papel de los datos en el reconocimiento de imágenes

Un buen reconocimiento de imágenes comienza con datos de calidad. Aquí es donde muchos proyectos tienen éxito o fracasan mucho antes de entrenar cualquier modelo. Incluso los algoritmos más potentes tienen dificultades cuando las imágenes subyacentes no reflejan las condiciones operativas reales.

Recopilación de datos

El conjunto de datos debe reflejar las condiciones a las que se enfrentará el modelo tras su implementación. Las imágenes capturadas en entornos controlados rara vez coinciden con la variabilidad del mundo real. La iluminación cambia. Los ángulos se desplazan. Los objetos se superponen. La resolución varía.

Un conjunto de datos útil incluye

- Diferentes puntos de vista

- Variaciones en la iluminación

- Fondos realistas

- Ejemplos imperfectos o ruidosos

Si un modelo se entrena únicamente con imágenes limpias e ideales, es probable que tenga un rendimiento deficiente en entornos prácticos donde las condiciones son impredecibles.

Etiquetado y anotación

Para el aprendizaje supervisado, las imágenes deben estar etiquetadas. Las etiquetas indican al modelo qué debe aprender. Esto puede ser tan simple como asignar un nombre a una categoría o tan detallado como definir los límites exactos de los objetos a nivel de píxel.

Tipos de anotaciones comunes

- Etiquetas a nivel de imagen para clasificación

- Cuadros delimitadores para la detección de objetos

- Máscaras de píxeles para segmentación

- Puntos clave para la estimación de la pose

La calidad de las anotaciones es más importante que el volumen. Las etiquetas inconsistentes o inexactas confunden al modelo y limitan su capacidad de generalizar más allá de los datos de entrenamiento.

Cómo utilizamos el reconocimiento de imágenes en el análisis geoespacial en FlyPix AI

En FlyPix AI, Aplicamos reconocimiento de imágenes a datos geoespaciales reales, incluyendo imágenes satelitales, aéreas y de drones. Estos conjuntos de datos son complejos y densos, lo que hace que el análisis manual sea lento e inconsistente. El aprendizaje automático nos permite detectar, monitorear e inspeccionar grandes áreas con precisión en una fracción de tiempo.

Nuestra plataforma utiliza agentes de IA para identificar y delinear miles de objetos en escenas complejas. Los usuarios pueden entrenar modelos personalizados con sus propias anotaciones, sin necesidad de conocimientos de programación ni experiencia avanzada en IA. Esto hace que el reconocimiento de imágenes sea práctico para el trabajo diario, no solo para equipos técnicos.

Nos centramos principalmente en la velocidad y la escala. Tareas que antes tomaban horas o días ahora se pueden completar en segundos, lo que ayuda a los equipos a pasar de la toma de imágenes a la toma de decisiones con mayor rapidez. Los proyectos de construcción, agricultura, operaciones portuarias, silvicultura, infraestructura y gobierno se benefician de este enfoque.

Para nosotros, el reconocimiento de imágenes va más allá de la detección. Se trata de convertir los datos visuales en información fiable y sostenible en condiciones reales.

Preprocesamiento: preparación de imágenes para el aprendizaje

Las imágenes sin procesar rara vez se utilizan tal cual. El preprocesamiento mejora la consistencia y ayuda a los modelos a aprender patrones relevantes con mayor eficiencia, al reducir la variación innecesaria incluso antes de comenzar el entrenamiento.

Esta etapa generalmente implica cambiar el tamaño de las imágenes a una forma fija para que el modelo reciba una entrada uniforme, normalizar los valores de los píxeles para mantener rangos numéricos estables, convertir espacios de color cuando la información de color no es esencial, reducir el ruido causado por los sensores o la compresión y recortar regiones que no contribuyen con una señal útil.

La normalización desempeña un papel fundamental. Al escalar los valores de los píxeles a un rango consistente, el modelo evita la inestabilidad numérica durante el entrenamiento y converge con mayor fiabilidad.

El aumento de datos se suele aplicar junto con el preprocesamiento. Técnicas como la rotación, el volteo, el zoom y el ajuste de brillo introducen una variación controlada en el conjunto de datos sin necesidad de recopilar nuevas imágenes. Esto ayuda a reducir el sobreajuste y mejora la capacidad del modelo para gestionar los cambios reales de perspectiva, iluminación y orientación.

Extracción de características en el aprendizaje automático tradicional

Antes de que el aprendizaje profundo se generalizara, el reconocimiento de imágenes dependía en gran medida de la extracción manual de características. Los ingenieros definían en qué características visuales debía centrarse el modelo.

Las características típicas de la artesanía incluyen:

- Bordes

- Esquinas

- Patrones de textura

- Gradientes

Métodos como el Histograma de Gradientes Orientados, Patrones Binarios Locales y Bolsa de Características transformaron las imágenes en vectores numéricos de longitud fija.

Estos enfoques funcionaron bien para tareas específicas, pero requerían un amplio conocimiento del dominio. Además, presentaban dificultades para adaptarse a los cambios en las condiciones visuales. Cada nuevo escenario exigía un ajuste manual.

Aprendizaje profundo y aprendizaje automático de características

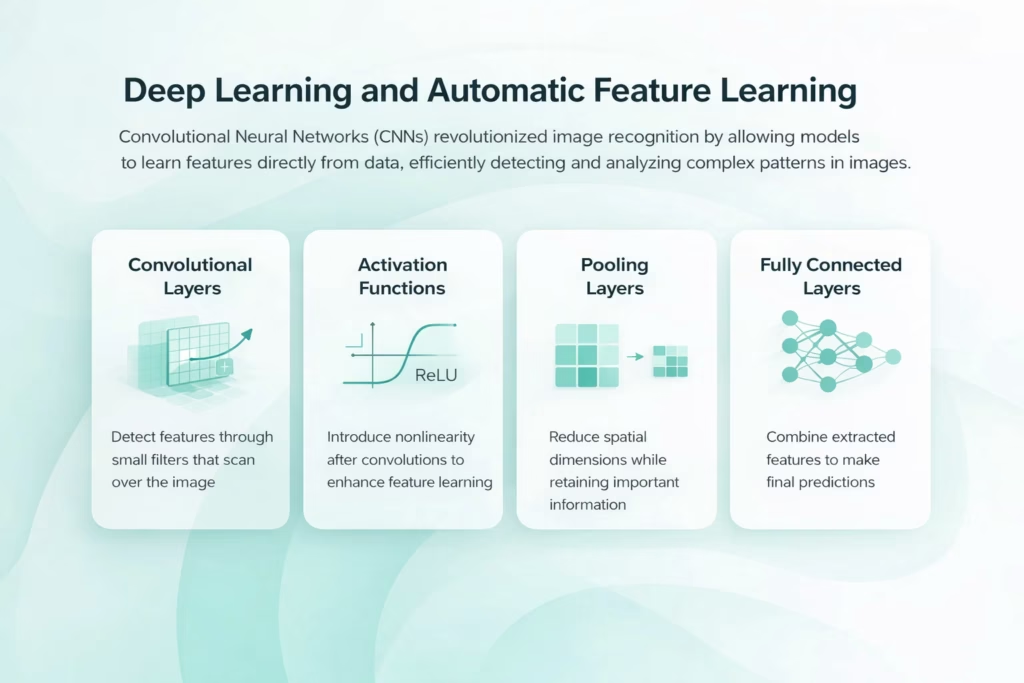

El aprendizaje profundo transformó el reconocimiento de imágenes al eliminar la necesidad de características personalizadas. En lugar de indicarle al modelo qué buscar, los ingenieros le permiten aprender características directamente de los datos. Las redes neuronales convolucionales (CNN) son la columna vertebral del reconocimiento de imágenes moderno. Están diseñadas para aprovechar la estructura espacial de las imágenes.

Capas convolucionales

Las capas convolucionales aplican pequeños filtros a una imagen. Estos filtros responden a patrones locales como bordes o texturas. Las capas iniciales detectan formas simples. Las capas más profundas las combinan para formar estructuras más complejas. Este enfoque en capas refleja cómo los humanos procesamos la información visual, desde líneas simples hasta objetos completos.

Funciones de activación

Tras cada convolución, las funciones de activación introducen no linealidad. Esto permite que la red modele relaciones complejas en lugar de patrones lineales simples.

Capas de agrupación

La agrupación reduce las dimensiones espaciales, conservando características importantes. Esto ayuda a los modelos a gestionar pequeños cambios o distorsiones en la posición de los objetos.

Capas completamente conectadas

Hacia el final de la red, las características extraídas se combinan y evalúan para generar predicciones. Estas capas integran información de toda la imagen.

El proceso de formación paso a paso

El entrenamiento de un modelo de reconocimiento de imágenes es un proceso iterativo. Implica la exposición repetida a datos etiquetados y el ajuste gradual de los parámetros internos.

1. Pase hacia adelante

El modelo procesa una imagen y produce una predicción.

2. Cálculo de pérdidas

La predicción se compara con la etiqueta verdadera. Una función de pérdida mide el grado de error de la predicción.

3. Retropropagación

El modelo ajusta sus ponderaciones internas para reducir el error. Esto se logra propagando la pérdida hacia atrás a través de la red.

4. Optimización

Un optimizador actualiza los parámetros según los gradientes. Tras numerosas iteraciones, el modelo mejora su precisión. El entrenamiento continúa hasta que el rendimiento se estabiliza o alcanza niveles aceptables en los datos de validación.

Detección de objetos y segmentación de imágenes

El reconocimiento de imágenes no se limita a la clasificación. En muchos escenarios del mundo real, simplemente saber que un objeto existe en una imagen no es suficiente. Los sistemas a menudo necesitan comprender dónde se encuentran los objetos, cuántos hay y cómo se relacionan con su entorno. Esta necesidad de conocimiento espacial es lo que impulsa la detección de objetos y la segmentación de imágenes.

- La detección de objetos identifica qué son los objetos y dónde aparecen en la imagen. El modelo suele dibujar cuadros delimitadores alrededor de los elementos y asignar una etiqueta de clase a cada cuadro. Las familias de modelos comunes incluyen Faster R-CNN, SSD y YOLO, y la elección suele basarse en el equilibrio entre velocidad y precisión.

- La segmentación de imágenes etiqueta píxeles en lugar de dibujar rectángulos, lo que aumenta la precisión de los límites. Esto resulta útil cuando las formas son irregulares, los objetos se superponen o la precisión en los bordes es importante. La segmentación de instancias separa objetos individuales de la misma clase, mientras que la segmentación semántica etiqueta regiones por categoría en toda la imagen.

Aprendizaje supervisado, no supervisado y autosupervisado

La mayoría de los sistemas de reconocimiento de imágenes se basan en el aprendizaje supervisado, pero otros enfoques son cada vez más importantes a medida que cambian la disponibilidad de datos y las limitaciones del proyecto.

Aprendizaje no supervisado

Los modelos no supervisados descubren patrones sin etiquetas. Agrupan imágenes según su similitud. Esto resulta útil cuando los datos etiquetados son escasos.

Aprendizaje autosupervisado

Los métodos autosupervisados generan señales de aprendizaje a partir de los propios datos. Tareas como la predicción de partes faltantes de una imagen permiten a los modelos aprender representaciones útiles con un etiquetado mínimo. Estos enfoques son especialmente valiosos para conjuntos de datos a gran escala o especializados.

Implementación y restricciones del mundo real

Un modelo entrenado solo es útil si funciona de forma fiable tras su implementación. Aquí es donde muchos sistemas de reconocimiento de imágenes empiezan a tener dificultades, no porque el modelo esté mal diseñado, sino porque las condiciones reales rara vez se ajustan al entorno de entrenamiento.

Una vez implementados, los modelos suelen experimentar variaciones en la calidad de imagen debido a diferentes cámaras, niveles de compresión o desenfoque de movimiento. Los objetos pueden aparecer en formas o contextos desconocidos, y factores ambientales como la iluminación, el clima o el desorden del fondo pueden introducir patrones que el modelo nunca antes había visto. Las limitaciones de hardware también influyen, especialmente cuando se espera que los modelos se ejecuten en dispositivos con recursos limitados en lugar de servidores potentes.

Los sistemas de reconocimiento de imágenes pueden operar en la nube o directamente en dispositivos en el borde. La implementación en la nube ofrece mayor capacidad computacional y actualizaciones más sencillas, mientras que la implementación en el borde mejora la privacidad, reduce la latencia y permite que los sistemas funcionen sin conectividad constante. La desventaja es una capacidad de procesamiento limitada, que a menudo requiere modelos más pequeños u optimizados.

Para mantener su eficacia a lo largo del tiempo, los modelos implementados requieren una monitorización continua. El rendimiento puede disminuir a medida que cambian las distribuciones de datos, lo que requiere un reentrenamiento y ajustes periódicos. Considerar la implementación como un proceso continuo, en lugar de un paso final, es esencial para mantener un reconocimiento de imágenes fiable en condiciones reales.

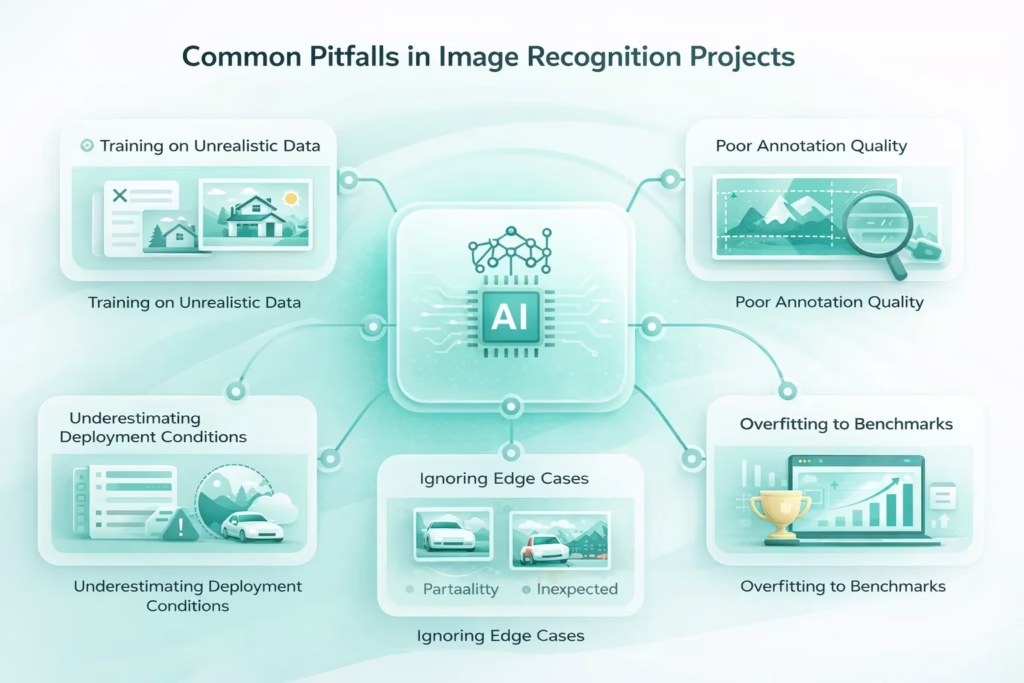

Errores comunes en los proyectos de reconocimiento de imágenes

Incluso los sistemas de reconocimiento de imágenes bien diseñados pueden fallar si se pasan por alto algunos problemas recurrentes. Estos problemas tienden a surgir no durante el desarrollo, sino después de que un modelo se expone a condiciones operativas reales.

- Entrenamiento con datos poco realistas. Los modelos entrenados únicamente con imágenes nítidas, bien iluminadas y con un encuadre perfecto suelen tener dificultades en el mundo real. El ruido de la cámara, el desenfoque de movimiento, las sombras y la oclusión parcial pueden reducir significativamente la precisión si no se representan en el conjunto de entrenamiento.

- Mala calidad de anotación. Las etiquetas inconsistentes, los objetos faltantes o los límites imprecisos generan confusión durante el entrenamiento. Un conjunto de datos pequeño con anotaciones de alta calidad suele tener un mejor rendimiento que un conjunto de datos grande con un etiquetado deficiente.

- Ignorando casos extremos. Es fácil pasar por alto situaciones excepcionales, apariciones inusuales de objetos o fondos inesperados. Estos casos extremos suelen ser responsables de los fallos más graves tras la implementación.

- Sobreajuste a los puntos de referencia. Optimizar los modelos para que funcionen bien con conjuntos de datos estándar puede generar una falsa sensación de éxito. Unas puntuaciones altas en los benchmarks no siempre se traducen en un rendimiento fiable con datos personalizados o específicos del dominio.

- Subestimar las condiciones de despliegue. Los modelos se comportan de forma diferente una vez implementados. Los cambios en la resolución de la imagen, las limitaciones del hardware, la latencia de la red o las condiciones ambientales pueden afectar el rendimiento.

Los sistemas de reconocimiento de imágenes exitosos se construyen con ciclos de retroalimentación continuos, comprobaciones periódicas de rendimiento y pruebas en condiciones reales. Tratar la implementación como un proceso continuo, en lugar de como un paso final, marca la diferencia entre un modelo que luce bien en teoría y uno que funciona en la práctica.

Reflexiones finales

El reconocimiento de imágenes en el aprendizaje automático no es mágico. Es un proceso estructurado basado en datos, aprendizaje e iteración. Las máquinas no comprenden imágenes en el sentido humano. Aprenden asociaciones entre patrones y resultados.

Lo que hace que el reconocimiento de imágenes sea potente no es un algoritmo único, sino el sistema que lo rodea: la calidad de los datos, la estrategia de entrenamiento, la disciplina de evaluación y una implementación cuidadosa.

Cuando estas piezas se alinean, el reconocimiento de imágenes se convierte en una herramienta fiable en lugar de una demostración frágil. Y eso es lo que lo hace práctico.

Preguntas frecuentes

El reconocimiento de imágenes en el aprendizaje automático consiste en enseñar a un sistema a identificar y clasificar objetos, patrones o características en imágenes. El modelo aprende de datos visuales, etiquetados o no, y utiliza esa experiencia para interpretar imágenes nuevas que no ha visto antes.

Las máquinas no ven las imágenes como objetos o escenas. Las procesan como datos numéricos compuestos por valores de píxeles. Los modelos de reconocimiento de imágenes aprenden patrones dentro de esos números, como bordes, texturas y formas, y los asocian con resultados conocidos mediante entrenamiento.

El reconocimiento de imágenes suele referirse a la identificación de lo presente en una imagen, a menudo a un alto nivel. La detección de objetos va más allá, identificando objetos individuales y localizándolos dentro de la imagen mediante cuadros delimitadores. La detección añade una percepción espacial que la clasificación simple no proporciona.

La detección de objetos los delimita mediante cuadros rectangulares, mientras que la segmentación de imágenes etiqueta píxeles individuales. La segmentación permite límites más precisos y se utiliza cuando la exactitud de las formas o regiones es importante, como en imágenes médicas o análisis satelitales.

El modelo solo puede aprender de los datos que recibe. Imágenes de baja calidad, etiquetas inconsistentes o ejemplos de entrenamiento poco realistas reducen el rendimiento. Los datos de alta calidad y bien anotados suelen tener un mayor impacto que las arquitecturas de modelos más complejas.

La cantidad de datos depende de la complejidad de la tarea y del modelo utilizado. Las tareas de clasificación sencillas pueden requerir miles de imágenes, mientras que las tareas de detección o segmentación más complejas pueden requerir considerablemente más. El aprendizaje por transferencia y los enfoques autosupervisados pueden reducir la necesidad de datos.