Los modelos de reconocimiento de imágenes rara vez fallan porque la arquitectura sea incorrecta. Fallan porque la precisión se malinterpreta, se mide de forma deficiente o se verifica en condiciones que no reflejan la realidad. Un modelo puede parecer impresionante durante el entrenamiento y, aun así, fallar al encontrarse con datos reales.

Comprobar la precisión del reconocimiento de imágenes no se trata de buscar una sola puntuación. Se trata de comprender qué acierta el modelo, qué omite y por qué ocurren esos errores. En la práctica, la precisión es una combinación de métricas, disciplina de validación y pruebas honestas en escenarios reales. Esta guía explica cómo evaluar los sistemas de reconocimiento de imágenes para determinar si están listos para su uso.

Por qué la precisión general rara vez dice la verdad

La precisión general es la métrica más común y también la menos informativa una vez que los proyectos superan los problemas de juguete. Mide la frecuencia con la que las predicciones coinciden con las etiquetas, pero ignora el desequilibrio de clases, la gravedad de los errores y los cambios en la distribución.

Un modelo puede alcanzar una precisión muy alta si funciona bien en casos comunes y fáciles, mientras que falla constantemente en casos poco frecuentes pero críticos. En proyectos reales, estos casos poco frecuentes suelen ser la razón de ser del modelo.

La precisión general no es inútil, pero debe considerarse una señal superficial. Puede indicar si algo está claramente dañado, pero no puede confirmar la fiabilidad de un sistema.

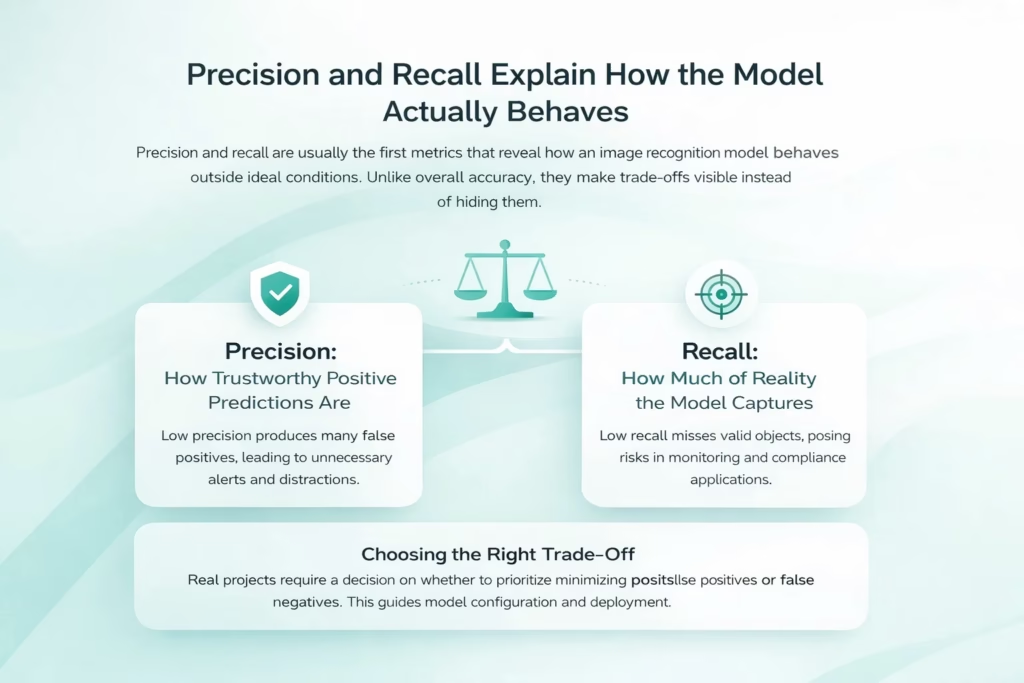

La precisión y la recuperación explican cómo se comporta realmente el modelo

La precisión y la recuperación suelen ser las primeras métricas que revelan el comportamiento de un modelo de reconocimiento de imágenes fuera de condiciones ideales. A diferencia de la precisión general, hacen visibles las compensaciones en lugar de ocultarlas.

Precisión: ¿Qué tan confiables son las predicciones positivas?

La precisión refleja la frecuencia con la que el modelo acierta al realizar una predicción positiva. Una precisión baja significa que el sistema produce muchos falsos positivos. En proyectos reales, esto se convierte rápidamente en un problema cuando cada detección activa una alerta, un flujo de trabajo o una revisión humana. Incluso un modelo técnicamente preciso puede resultar inutilizable si requiere atención innecesaria constantemente.

Recordatorio: ¿Cuánta realidad capta el modelo?

La recuperación mide la cobertura. Muestra cuánto de lo realmente presente logra detectar el modelo. Un modelo con baja recuperación omite objetos válidos, incluso si las detecciones que realiza son correctas. En sistemas de monitorización, seguridad o cumplimiento normativo, las detecciones omitidas suelen conllevar un mayor riesgo que las falsas.

Elegir la compensación adecuada

La precisión y la recuperación describen diferentes modos de fallo, y ninguno es universalmente mejor. Los proyectos reales requieren una decisión explícita sobre qué errores son más aceptables. Esta decisión debería guiar el ajuste de umbrales, la selección del modelo y la forma en que se juzga la precisión en última instancia.

Hacer que la precisión del reconocimiento de imágenes sea práctica en FlyPix AI

En FlyPix AI, Trabajamos con reconocimiento de imágenes, donde la precisión debe resistir condiciones reales, no solo datos de prueba limpios. Las imágenes satelitales, aéreas y de drones son complejas por naturaleza, por lo que nos centramos en una precisión que se mantenga en diferentes entornos, escalas y cambios.

No consideramos la precisión como una puntuación única. Nuestra plataforma está diseñada para ayudar a los equipos a entrenar modelos personalizados, validar detecciones visualmente e iterar rápidamente. Al mantener el conocimiento del dominio cerca del modelo y reducir el tiempo de prueba y reentrenamiento, hacemos que la precisión sea algo con lo que los equipos puedan trabajar activamente, no solo medirla una vez.

La precisión no se limita a la implementación. A medida que las imágenes cambian con el tiempo, nuestros flujos de trabajo permiten la validación y el reentrenamiento continuos, de modo que los modelos se mantienen alineados con las condiciones del mundo real en lugar de perder relevancia gradualmente.

Interpretación conjunta de métricas de precisión básicas

Una vez que se tienen las cifras básicas de precisión, comienza el verdadero trabajo. Los sistemas de reconocimiento de imágenes rara vez fallan por falta de una métrica. Fallan porque las métricas se leen de forma aislada. La precisión, la recuperación, la puntuación F1, el IoU y el mAP describen diferentes aspectos del comportamiento del modelo, y ninguno de ellos es significativo por sí solo. El objetivo es comprender cómo interactúan y qué revelan al analizarlos en conjunto.

Cómo usar la puntuación F1 sin perder detalles

La puntuación F1 combina precisión y recuperación en un solo número. Resulta útil para comparaciones, especialmente cuando ninguna métrica debe predominar.

Sin embargo, la puntuación F1 nunca debe sustituir la inspección directa de la precisión y la recuperación. Dos modelos con la misma puntuación F1 pueden comportarse de forma muy diferente en la práctica. Uno puede pasar por alto casos excepcionales. Otro puede saturar el sistema con detecciones falsas.

Considere la puntuación de F1 como un resumen, no como una conclusión.

La precisión en la detección de objetos cambia las reglas

La precisión del reconocimiento de imágenes se vuelve más compleja cuando se trata de la detección de objetos. Los sistemas de detección deben identificar lo presente y localizarlo correctamente en la imagen.

La intersección sobre unión, o IoU, mide la precisión con la que los cuadros delimitadores predichos se superponen con la realidad del terreno. Convierte la precisión en un problema espacial, en lugar de una simple tarea de clasificación.

La elección de los umbrales de IoU no es un detalle técnico. Los umbrales poco rigurosos pueden ocultar problemas de localización. Los umbrales extremadamente estrictos pueden penalizar detecciones suficientemente buenas para el uso operativo. En proyectos reales, el IoU debe reflejar la precisión necesaria de las detecciones, no lo que mejor se ve en los informes.

Precisión media promedio y sus límites

La precisión media promedio (mAP) se utiliza ampliamente porque combina la confianza en la detección, la calidad de la clasificación y la precisión de la localización en distintos umbrales. Proporciona una forma estructurada de comparar modelos de detección de objetos entrenados en condiciones similares.

mAP es más valioso como métrica comparativa. Ayuda a los equipos a comprender si un enfoque mejora la calidad de detección en comparación con otro. Lo que no garantiza es la robustez. Un modelo puede obtener buenos resultados en mAP y aun así fallar en condiciones específicas de iluminación, entornos o disposición de objetos.

Por esta razón, mAP debe ser tratado como una lente, no como un veredicto.

Siempre mira el rendimiento por clase

Una de las razones más comunes por las que fallan los sistemas de reconocimiento de imágenes es el rendimiento desigual de las clases. Las métricas agregadas ocultan este problema.

Al evaluar la precisión, inspeccione siempre las métricas por clase. Esto revela si ciertos objetos son consistentemente más difíciles de detectar o más propensos a confundirse con otros.

Este paso suele cambiar las prioridades. Un modelo que parece sólido en general puede resultar inaceptable si falla en las clases más importantes.

Las matrices de confusión convierten los errores en patrones

Las matrices de confusión son una de las herramientas más prácticas para comprender el comportamiento de un modelo de reconocimiento de imágenes. En lugar de agrupar los errores en una sola puntuación, muestran cómo se mueven las predicciones entre clases, revelando la estructura de los errores.

Lo que revelan las matrices de confusión

Al comparar predicciones con la verdad fundamental, las matrices de confusión ayudan a responder preguntas que las métricas escalares no pueden:

- ¿Qué clases se confunden con más frecuencia entre sí?

- Si los errores tienden a ser unidireccionales o mutuos

- Si los errores se agrupan en torno a categorías visualmente similares o superpuestas

Por qué es importante este punto de vista

Estos patrones suelen indicar directamente problemas subyacentes, como definiciones de clase ambiguas, etiquetado inconsistente o ejemplos de entrenamiento faltantes. Dado que las matrices de confusión exponen las relaciones entre clases, son especialmente útiles para decidir si se deben recopilar más datos, refinar las etiquetas o ajustar los límites de las clases.

La validación solo funciona con datos realmente invisibles

La evaluación de la precisión falla cuando los datos de validación son demasiado similares a los de entrenamiento. Esto ocurre con más frecuencia de lo que los equipos esperan.

Si aparecen versiones aumentadas de las mismas imágenes en múltiples divisiones, o si los datos provienen de las mismas condiciones limitadas, la precisión parece artificialmente alta. El modelo se está probando con variaciones de lo que ya ha observado.

Un conjunto de pruebas significativo debe diferir en aspectos relevantes. Esto puede incluir diferentes ubicaciones, dispositivos, períodos de tiempo o condiciones de captura. Sin esta separación, la evaluación de la precisión se vuelve autoconfirmativa en lugar de predictiva.

Las pruebas en condiciones reales cambian las conclusiones

Muchos problemas de precisión solo aparecen cuando los modelos se topan con imperfecciones del mundo real. El desenfoque de movimiento, el ruido, la oclusión, los artefactos de compresión y la mala iluminación revelan debilidades que los conjuntos de datos limpios nunca revelan.

Las pruebas en condiciones realistas suelen generar descubrimientos incómodos, pero valiosos. Un modelo que funciona bien en escenarios ideales puede presentar dificultades si las condiciones varían, incluso ligeramente. Detectar esto antes de la implementación ahorra tiempo, costes y credibilidad.

Esta etapa no requiere una simulación perfecta. Requiere un muestreo preciso de cómo se ven realmente las imágenes en producción.

La precisión a lo largo del tiempo y el papel del sesgo

La precisión del reconocimiento de imágenes no es estática. Los datos del mundo real evolucionan constantemente, y los modelos que no se monitorizan se desfasan gradualmente de la realidad. Los cambios estacionales, el nuevo hardware, los cambios ambientales y los cambios en el comportamiento del usuario afectan la apariencia de las imágenes y la interpretación de los modelos. Cuando la precisión solo se comprueba en el lanzamiento, esta lenta degradación suele pasar desapercibida hasta que los fallos se hacen evidentes.

Las comprobaciones de precisión posteriores a la implementación deben centrarse en las tendencias, no en cifras aisladas. Una disminución gradual del rendimiento suele ser más peligrosa que un fallo repentino, ya que se esconde tras métricas habituales. La monitorización continua permite detectar cambios sutiles con antelación y reaccionar antes de que la precisión descienda por debajo de los niveles aceptables.

El sesgo juega un papel directo en este proceso. Los modelos entrenados con datos limitados o desequilibrados tienden a tener un buen rendimiento solo en las condiciones que ya han observado. Cuando aparecen nuevos entornos, tipos de objetos o patrones visuales, las métricas de precisión sobreestiman la fiabilidad. Reducir el sesgo mejora la cobertura, pero también la robustez. Los modelos más justos suelen ser más estables a lo largo del tiempo y más fáciles de mantener a medida que cambian las condiciones.

Usar la precisión para tomar decisiones reales

Las métricas de precisión existen para guiar las decisiones, no para impresionar a las partes interesadas. Los informes deben explicar las compensaciones, las limitaciones y los riesgos conocidos, en lugar de ocultarlos tras una sola cifra. Cuando la precisión se presenta sin contexto, se genera una falsa confianza y los equipos pasan por alto problemas que surgen más adelante en la producción.

En la práctica, unos informes de precisión útiles deberían dejar claro lo siguiente:

- ¿Qué tipos de errores son los más importantes y por qué son aceptables o no?

- Donde el modelo funciona de manera desigual, incluidas clases o escenarios con menor confiabilidad

- Qué condiciones refleja la evaluación, como fuentes de datos, entornos o períodos de tiempo

- Cómo se espera que cambie el rendimiento con el tiempo y cómo se supervisará

Los informes claros y honestos generan confianza entre los equipos y conducen a sistemas que son más fáciles de mantener, mejorar y utilizar en el mundo real.

Cuando un modelo está realmente listo

Un modelo está listo cuando se comprende su comportamiento, no cuando sus métricas alcanzan su punto máximo. Las puntuaciones altas pueden ocultar un rendimiento frágil, especialmente si provienen de conjuntos de datos limitados o condiciones ideales. Lo más importante es saber cómo falla el modelo, dónde ocurren esas fallas y si se ajustan a un riesgo aceptable. Los errores predecibles se pueden gestionar mediante umbrales, flujos de trabajo o reentrenamiento. Los errores desconocidos aparecen más tarde, generalmente cuando el costo de corregirlos es mayor.

La verdadera preparación se basa en una evaluación rigurosa, no en una interpretación optimista. Esto implica realizar pruebas en condiciones realistas, validar con datos nunca vistos y supervisar el rendimiento tras la implementación. Un modelo que se observa y ajusta continuamente es mucho más fiable que uno que simplemente parecía sólido al momento del lanzamiento.

Reflexiones finales

Comprobar la precisión del reconocimiento de imágenes en proyectos reales no consiste en obtener la puntuación más alta. Se trata de comprender cómo se comporta un sistema cuando la realidad interviene.

Las métricas son herramientas. Si se usan con cuidado, revelan fortalezas y debilidades. Si se usan con descuido, generan confianza sin fiabilidad.

La diferencia entre una demostración y un sistema de reconocimiento de imágenes confiable no reside en la arquitectura. Se trata de la precisión con la que se mide, se prueba y se mantiene a lo largo del tiempo.

Preguntas frecuentes

No existe una métrica ideal. La precisión general puede ser útil como señal rápida, pero rara vez es suficiente por sí sola. En proyectos reales, la precisión debe evaluarse mediante una combinación de precisión, recuperación y métricas específicas de la tarea, como IoU o mAP para la detección de objetos. La combinación adecuada depende de los tipos de errores más importantes en su caso de uso.

Esto suele ocurrir cuando los datos de evaluación son demasiado similares a los de entrenamiento o no reflejan las condiciones reales. Imágenes limpias, entornos limitados o fugas de datos entre divisiones pueden inflar las puntuaciones de precisión. Una vez que el modelo se enfrenta a nuevas condiciones de iluminación, ángulos, ruido o entornos, aparecen debilidades que nunca se habían evaluado.

Depende del coste de los errores. Si los falsos positivos activan revisiones manuales, alertas o acciones automatizadas, la precisión es más importante. Si la falta de objetos genera riesgo o puntos ciegos, la recuperación es más importante. La mayoría de los sistemas reales requieren un equilibrio consciente en lugar de optimizar una métrica a ciegas.

No. La puntuación F1 es útil para la comparación, pero oculta el equilibrio entre la precisión y la recuperación. Dos modelos con la misma puntuación F1 pueden comportarse de forma muy distinta en la práctica. Siempre analice la precisión y la recuperación por separado antes de tomar decisiones.

La precisión debe verificarse regularmente después de la implementación, no solo una vez. La frecuencia adecuada depende de la velocidad con la que cambian los datos, pero cualquier sistema expuesto a nuevos entornos, estaciones o hardware debe monitorearse continuamente. Las fluctuaciones en el rendimiento son comunes y, a menudo, pasan desapercibidas si no se rastrean las tendencias.