El reconocimiento de imágenes suena intimidante al principio. Redes neuronales, conjuntos de datos, bucles de entrenamiento, GPU... puede parecer mucho antes de siquiera escribir una línea de código. Pero en la práctica, desarrollar una IA de reconocimiento de imágenes se trata más de tomar buenas decisiones paso a paso que de dominarlo todo de golpe.

En esencia, el reconocimiento de imágenes consiste en enseñar a un sistema a detectar patrones en las imágenes y a emitir juicios coherentes basados en lo que ve. Esto podría implicar identificar objetos, clasificar escenas, detectar defectos o señalar anomalías. La tecnología que lo sustenta es potente, pero el proceso en sí es sorprendentemente sólido: definir la tarea, preparar los datos, entrenar un modelo, probarlo honestamente e implementarlo donde sea realmente útil.

Este artículo explica ese proceso de forma práctica y concisa. Sin exageraciones, sin atajos ni suposiciones de que se está elaborando un trabajo de investigación. Simplemente, una visión clara de cómo se desarrolla la IA de reconocimiento de imágenes hoy en día, qué es realmente importante en cada etapa y dónde se suelen cometer errores.

Comience con un problema que pueda describir claramente

Antes de tocar datos o modelos, se necesita una tarea bien definida. No se trata de "reconocer imágenes", sino de algo concreto.

- ¿Estás clasificando una imagen completa en una categoría?

- ¿Estás encontrando objetos y dibujando cuadros alrededor de ellos?

- ¿Estás identificando formas o límites exactos a nivel de píxel?

Cada uno de ellos constituye un problema distinto, con costes y riesgos diferentes.

Muchos proyectos fracasan porque empiezan vagos y se complican demasiado tarde. Si no puedes explicar tu objetivo en una sola frase a alguien sin conocimientos técnicos, aún no está listo.

Buenos ejemplos

- “Detecte daños visibles en los paneles de la carrocería del automóvil a partir de fotografías”.”

- “Cuenta troncos apilados en imágenes aéreas”.”

- “Identificar si un área de cultivo muestra estrés temprano”.”

Malos ejemplos

- “Utilice IA para analizar imágenes”.”

- “Construir una visión artificial inteligente”.”

La claridad aquí ahorra meses después.

Entender cómo las imágenes se convierten en números

Una computadora no ve objetos. Ve conjuntos de números.

Cada imagen se convierte en píxeles, y cada píxel se convierte en valores que representan la intensidad o el color. Una imagen en color no es una imagen para un modelo. Es una cuadrícula de números en múltiples canales.

El reconocimiento de imágenes funciona aprendiendo patrones dentro de esos números: bordes, formas, texturas, contrastes. No porque el modelo comprenda el significado, sino porque encuentra regularidades estadísticas que se correlacionan con las etiquetas.

Esto es importante porque cambia la forma en que se piensa sobre la calidad de los datos. Si el modelo falla, a menudo se debe a que los números que analiza son inconsistentes, ruidosos o engañosos.

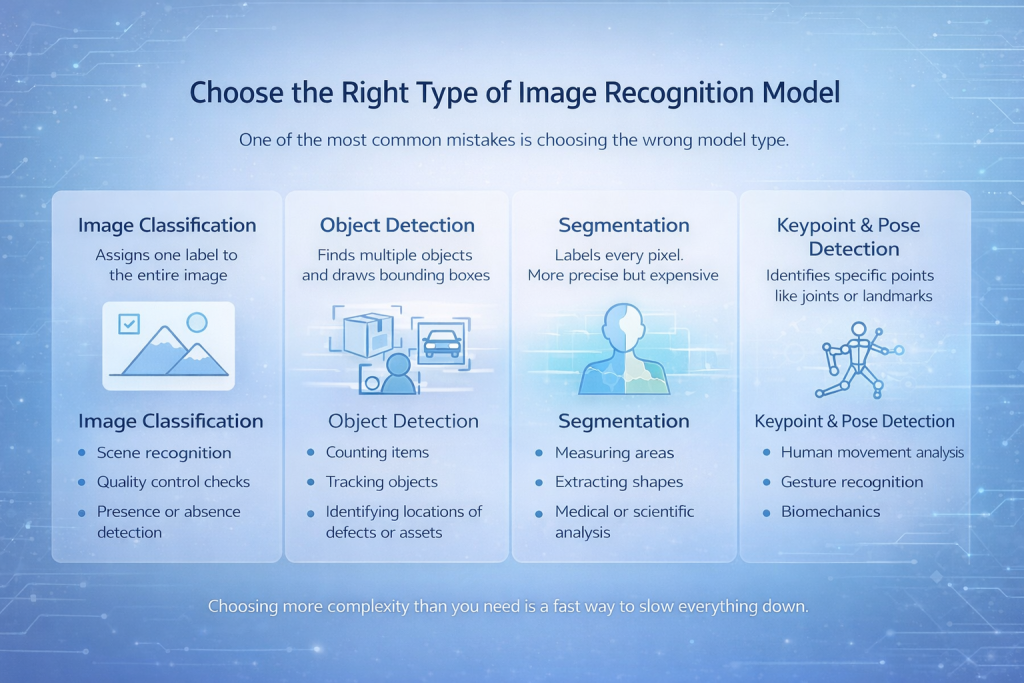

Elija el tipo correcto de modelo de reconocimiento de imágenes

Uno de los errores más comunes es elegir el tipo de modelo equivocado.

Hay varias categorías principales:

Clasificación de imágenes

El modelo asigna una etiqueta a toda la imagen. Es simple, rápido y eficaz cuando el objeto de interés domina la imagen.

Ideal para:

- Reconocimiento de escenas

- Controles de calidad

- Detección de presencia o ausencia

Object Detection

El modelo encuentra múltiples objetos y dibuja cuadros delimitadores alrededor de ellos.

Ideal para:

- Contando artículos

- Seguimiento de objetos

- Identificación de ubicaciones de defectos o activos

Segmentación

Cada píxel tiene una etiqueta. Esto es más preciso y más costoso.

Ideal para:

- Áreas de medición

- Extrayendo formas

- Análisis médico o científico

Detección de puntos clave y poses

El modelo identifica puntos específicos como articulaciones o puntos de referencia.

Ideal para:

- Análisis del movimiento humano

- Reconocimiento de gestos

- Biomecánica

Elegir más complejidad de la que necesitas es una forma rápida de ralentizar todo.

Los datos no solo son importantes. Son el proyecto.

Los modelos captan la atención. Los datos hacen el verdadero trabajo.

Un sistema de reconocimiento de imágenes eficaz depende mucho más del conjunto de datos que de la arquitectura. El modelo más avanzado fallará si los datos son débiles o inconsistentes.

Principios clave que realmente importan:

La variedad de datos supera al volumen de datos

Diez mil imágenes similares suelen ser peores que dos mil distintas. Los diferentes ángulos, condiciones de iluminación, fondos, resoluciones y tipos de dispositivos son más importantes que el recuento bruto.

Las etiquetas deben coincidir con la realidad

Si los humanos discuten sobre las etiquetas, el modelo aprenderá a confundirse. Las clases ambiguas deben fusionarse o redefinirse con antelación.

El equilibrio importa

Si una clase predomina, la precisión se vuelve engañosa. Un modelo puede ser "preciso" si siempre adivina la clase mayoritaria.

La anotación es donde se gana o se pierde la calidad

El etiquetado suele ser apresurado y se nota más tarde. Una anotación deficiente crea problemas difíciles de detectar durante el entrenamiento, pero dolorosamente obvios en la práctica. Los modelos se vuelven inestables, las predicciones parecen aleatorias y los casos extremos se acumulan. Cada imagen mal etiquetada envenena silenciosamente el proceso de aprendizaje.

Una buena anotación comienza con reglas de etiquetado claras que todos siguen de la misma manera. Cuando diferentes personas interpretan las etiquetas de forma distinta, el modelo detecta la confusión en lugar de patrones. La consistencia es tan importante como la precisión, por lo que las comprobaciones puntuales periódicas y las pequeñas auditorías son esenciales. Ayudan a detectar desviaciones a tiempo, antes de que se propaguen por el conjunto de datos.

La anotación también necesita espacio para evolucionar. A medida que surgen nuevos casos extremos, las etiquetas deben refinarse en lugar de imponerse a definiciones que ya no encajan. Este tipo de limpieza iterativa es lenta, pero compensa la estabilidad del modelo.

Las herramientas de etiquetado asistidas por IA pueden agilizar el proceso, especialmente con grandes conjuntos de datos, pero no sustituyen el criterio humano. Simplemente repiten la lógica que se les da. Si las reglas son poco claras o erróneas, la automatización corregirá el error, no lo solucionará.

El preprocesamiento no es cosmético

El preprocesamiento no se trata solo de mejorar la nitidez de las imágenes. Se trata de reducir la variación no deseada y resaltar lo importante.

Pasos comunes que realmente ayudan:

- Cambiar el tamaño de las imágenes a una resolución consistente

- Normalización de valores de píxeles

- Corrección de la orientación

- Recortar áreas irrelevantes

La mejora de datos merece especial atención. Transformaciones sencillas como la rotación, el volteo, los cambios de brillo o la inyección de ruido pueden mejorar drásticamente la generalización. El objetivo no es manipular el modelo, sino prepararlo para la realidad.

Si sus datos parecen demasiado perfectos, su modelo entrará en pánico en el mundo real.

La arquitectura del modelo importa menos de lo que crees

Existe una fuerte tentación de perseguir el modelo más novedoso o del que más se habla. Transformadores, redes troncales masivas y tuberías complejas pueden parecer impresionantes en teoría, pero no garantizan mejores resultados.

En la práctica, muchos sistemas fiables de reconocimiento de imágenes se basan en arquitecturas consolidadas. Las redes neuronales convolucionales siguen dominando este campo por una razón: son estables, eficientes y más fáciles de comprender cuando algo falla. Esta fiabilidad suele ser más importante que obtener unos puntos porcentuales adicionales en las pruebas de referencia.

El aprendizaje por transferencia suele ser el punto de partida más inteligente. Usar un modelo que ya ha aprendido de conjuntos de datos grandes y diversos proporciona una base sólida, especialmente cuando los datos propios son limitados. El ajuste fino funciona mejor cuando la nueva tarea se acerca razonablemente a lo que el modelo ha visto antes, cuando el sobreajuste se controla activamente y cuando el reentrenamiento se realiza con cuidado en lugar de de forma agresiva. Los ajustes pequeños y deliberados tienden a ser mejores que el reentrenamiento forzado.

Los modelos más grandes no siempre son mejores. Son más costosos de entrenar, más difíciles de depurar y suelen presentar fallos sutiles que son difíciles de rastrear.

El entrenamiento es una conversación iterativa con tus datos

El entrenamiento no es una operación de un solo clic. Es un ciclo.

Entrenas, observas los resultados, identificas patrones de falla, ajustas datos o parámetros y repites.

Prácticas clave de formación:

- Utilice conjuntos de entrenamiento, validación y prueba separados

- Observe las curvas de pérdida, no solo la precisión

- Detener el entrenamiento cuando la mejora se estanca

- Ajuste cuidadosamente la tasa de aprendizaje y el tamaño del lote

La aceleración por GPU no es opcional para trabajos serios. El entrenamiento con CPU es útil para el aprendizaje, pero poco práctico para proyectos reales. Las GPU reducen el tiempo de iteración, lo que mejora directamente la calidad del modelo al permitir la experimentación.

La evaluación debe ir más allá de la precisión

La precisión es una de las métricas más fáciles de calcular y de malinterpretar. Un modelo puede parecer muy preciso y, aun así, ser inútil en condiciones reales.

Una buena evaluación es más profunda. Las matrices de confusión ayudan a identificar dónde el modelo realiza constantemente llamadas erróneas. La precisión y la recuperación son mucho más informativas cuando las clases están desequilibradas o cuando ciertos errores son más costosos que otros. Las pruebas con imágenes completamente nuevas del mundo real a menudo revelan problemas que nunca aparecen en datos de validación limpios.

El paso de evaluación más valioso sigue siendo la revisión manual. Analizar directamente las predicciones fallidas y preguntarse por qué se produjeron proporciona información que ninguna métrica puede capturar por completo. Los modelos son sorprendentemente honestos sobre sus debilidades si se dedica el tiempo a examinar sus errores en lugar de confiar en cifras resumidas.

La implementación lo cambia todo

¿Por qué los modelos fallan después de la implementación?

Muchos modelos de reconocimiento de imágenes funcionan bien durante el desarrollo y luego fracasan silenciosamente una vez implementados. Este es uno de los momentos más comunes y frustrantes de todo el proceso.

La razón es simple. Las entradas del mundo real rara vez se asemejan a los datos de entrenamiento. Las imágenes provienen de diferentes cámaras, las condiciones de iluminación cambian a lo largo del día, aparecen artefactos de compresión y los usuarios no siguen patrones de uso ideales. Incluso pequeños cambios en la forma en que se capturan las imágenes pueden llevar a un modelo fuera del espacio en el que aprendió a operar.

Lo que parecía estable en un entorno controlado de repente se vuelve poco confiable.

Las restricciones que no puedes ignorar

La implementación obliga a pensar más allá de la precisión del modelo. La velocidad de inferencia se vuelve crucial cuando se necesitan predicciones en tiempo real. El uso de memoria es importante cuando el modelo se ejecuta en dispositivos edge o hardware móvil. Las limitaciones de hardware determinan qué tipo de arquitecturas son viables, y la estabilidad de la API se vuelve esencial cuando otros sistemas dependen de sus predicciones.

La monitorización también pasa de ser un lujo a una necesidad. Sin visibilidad del comportamiento del modelo tras su lanzamiento, los fallos pueden pasar desapercibidos hasta que se pierde la confianza.

Hacer que el modelo sea utilizable

Exportar un modelo a formatos como TensorFlow Lite u ONNX no es solo un paso técnico al final del proceso. Forma parte de convertir un modelo entrenado en algo realmente utilizable en producción. Estos formatos ayudan a adaptar el modelo a diferentes entornos, reducen la sobrecarga y mejoran la compatibilidad con los objetivos de implementación.

Un modelo que funciona bien en un portátil, pero no sobrevive a la implementación, no está terminado. El verdadero éxito solo se logra cuando el sistema funciona de forma consistente donde está destinado.

Reconocimiento de imágenes en el mundo real: cómo lo construimos en FlyPix AI

En FlyPix AI, No consideramos el reconocimiento de imágenes como un ejercicio de laboratorio. Trabajamos a diario con imágenes satelitales, aéreas y de drones, donde las escenas son densas, los objetos se superponen y las condiciones nunca son perfectas. Esta realidad determina cómo desarrollamos y usamos la IA.

Nuestro objetivo siempre ha sido simple: eliminar el cuello de botella del análisis visual manual. Los equipos dedicaban cientos de horas a anotar imágenes, verificar resultados y volver a verificarlos cada vez que cambiaban las condiciones. Creamos FlyPix para automatizar ese trabajo mediante agentes de IA capaces de detectar, monitorizar e inspeccionar objetos a escala, sin sacrificar la precisión.

Lo más importante para nosotros es la practicidad. No debería necesitar conocimientos profundos de IA ni un equipo de ingenieros de aprendizaje automático para entrenar un modelo que se adapte a su caso de uso. Con FlyPix, los equipos pueden crear modelos de reconocimiento de imágenes personalizados utilizando sus propias anotaciones, centrándose en los objetos que realmente importan en su sector. Obras de construcción, puertos, terrenos agrícolas, infraestructuras, áreas forestales: las imágenes son diferentes, pero el desafío es el mismo.

También diseñamos todo teniendo en cuenta la implementación. Los datos geoespaciales del mundo real cambian constantemente, por lo que los modelos deben gestionar la variación desde el primer día. Esto implica construir sistemas que funcionen de forma fiable fuera de demostraciones limpias, procesen grandes volúmenes de imágenes con rapidez y ofrezcan resultados que los equipos puedan implementar de inmediato. Para nosotros, el reconocimiento de imágenes solo tiene éxito cuando se mantiene en las operaciones diarias, no solo durante las pruebas.

Los bucles de retroalimentación mantienen vivo el modelo

Una IA de reconocimiento de imágenes no es estática. Los datos cambian. Los entornos cambian. Las expectativas cambian.

Los sistemas que perduran están diseñados teniendo en cuenta la retroalimentación:

- Recopilar nuevas imágenes después de la implementación

- Casos de fallo de la vía

- Reentrenarse periódicamente

- Ajustar las etiquetas cuando la realidad cambia

Ignorar el aprendizaje posterior a la implementación es una de las formas más rápidas de perder la confianza en el sistema.

Conclusión

Desarrollar una IA de reconocimiento de imágenes que realmente funcione se trata menos de seguir los modelos más recientes y más de acertar con los fundamentos. Una definición clara del problema, un análisis riguroso de los datos, una evaluación minuciosa y una planificación realista de la implementación son mucho más importantes que la elección de un único algoritmo.

Los sistemas más confiables no son los más complejos. Son aquellos que se construyen con una comprensión profunda de cómo cambian las imágenes en el mundo real y cómo reaccionan los modelos a dichos cambios. Se entrenan con datos que reflejan la realidad, se evalúan con métricas que revelan debilidades y se implementan teniendo en cuenta las limitaciones desde el primer día.

Si hay una conclusión, es esta: el reconocimiento de imágenes es un proceso de ingeniería, no un experimento puntual. Cuando se trata de esta manera, se itera con cuidado y se mantiene el uso real, los resultados tienden a mantenerse mucho después de la demostración.

Preguntas frecuentes

La IA de reconocimiento de imágenes es un tipo de sistema de visión artificial que aprende a identificar patrones, objetos o características en imágenes. Funciona analizando datos de píxeles y utilizando modelos entrenados para asociar patrones visuales con etiquetas o resultados.

No siempre. Si bien los grandes conjuntos de datos son útiles, la diversidad y la calidad son más importantes que el volumen bruto. Con el aprendizaje por transferencia y una mejora adecuada, se pueden entrenar modelos útiles en conjuntos de datos relativamente pequeños, pero bien seleccionados.

Para la mayoría de los proyectos, comenzar con una red neuronal convolucional probada y aplicar el aprendizaje por transferencia es un enfoque seguro y eficaz. Los modelos más complejos solo deben utilizarse cuando exista una razón clara y datos suficientes que los respalden.

La precisión por sí sola no es suficiente. Debe analizar las matrices de confusión, la precisión y la recuperación, y probar el modelo con imágenes reales que nunca se entrenaron. La revisión manual de los fallos suele ser el paso más revelador.

Esto suele ocurrir porque las imágenes de producción difieren de los datos de entrenamiento. Los cambios en la iluminación, la calidad de la cámara, la compresión de la imagen o el comportamiento del usuario pueden afectar el rendimiento. Esta diferencia es común y debe planificarse durante el desarrollo.

Sí. La implementación no es un paso final que pueda ignorarse hasta el final. Las limitaciones del hardware, la velocidad de inferencia, el uso de memoria y los requisitos de integración influyen en cómo se debe construir y entrenar el modelo.