Entrenar un modelo de reconocimiento de imágenes se trata menos de algoritmos ingeniosos y más de acertar con los fundamentos. Datos de calidad, etiquetas claras y un proceso de entrenamiento meticuloso son mucho más importantes que buscar la arquitectura más reciente. Si se omite cualquiera de estos, incluso el mejor modelo tendrá dificultades en el mundo real.

Esta guía explica cómo los equipos entrenan modelos de reconocimiento de imágenes que se mantienen fuera del laboratorio. No se basa en teoría ni en el ámbito académico. Simplemente ofrece una visión clara de en qué centrarse, qué suele fallar y cómo construir un modelo que aprenda de forma fiable y mejore con el tiempo.

En qué consiste realmente el entrenamiento de un modelo de reconocimiento de imágenes

Antes de comenzar con los pasos, conviene aclarar una idea errónea común. Entrenar un modelo de reconocimiento de imágenes no consiste en enseñarle a un sistema a "ver" como lo hacen los humanos. Se trata de enseñarle a reconocer patrones estadísticos en píxeles y a asociarlos con las etiquetas que usted defina.

En esencia, el entrenamiento consiste en mostrarle al modelo numerosos ejemplos de imágenes, indicarle qué es correcto y permitirle ajustarse automáticamente en función de los errores. Con el tiempo, el modelo aprende qué señales visuales son importantes y cuáles pueden ignorarse. Los bordes, las texturas, las formas, las transiciones de color y las relaciones espaciales forman parte de esta representación interna.

Este proceso depende de tres cosas más que cualquier otra:

- La calidad y relevancia de los datos

- La claridad y consistencia de las etiquetas

- El ciclo de retroalimentación creado a través de la evaluación y la iteración

Los algoritmos y las arquitecturas son importantes, pero rara vez compensan la debilidad de los datos o la falta de claridad en los objetivos. Un modelo simple entrenado con datos bien preparados casi siempre superará a un modelo complejo entrenado de forma descuidada.

También es importante comprender que el entrenamiento no es una acción única. Los sistemas de reconocimiento de imágenes mejoran gradualmente. Las versiones iniciales suelen ser preliminares. El rendimiento aumenta a medida que mejoran los datos, se añaden casos extremos y se corrigen las suposiciones.

Con esa mentalidad en mente, el proceso paso a paso a continuación se vuelve más fácil de seguir y mucho más efectivo de aplicar.

Nuestro enfoque para entrenar modelos de reconocimiento de imágenes en FlyPix AI

En FlyPix AI, Entrenamos modelos de reconocimiento de imágenes para condiciones geoespaciales reales, no para demostraciones controladas. Las imágenes satelitales, aéreas y de drones conllevan ruido, variación y complejidad, por lo que nuestro proceso de entrenamiento está diseñado para gestionar la escala, la inconsistencia y los casos extremos desde el principio.

Facilitamos el entrenamiento de modelos de IA personalizados sin necesidad de programar, manteniendo un control total sobre lo que el modelo detecta y cómo aprende. Los usuarios definen objetos, anotaciones y prioridades. Nuestra plataforma se encarga del entrenamiento, la optimización y la infraestructura del modelo en segundo plano.

El entrenamiento no se considera un paso único. Lo diseñamos como un proceso iterativo donde los modelos mejoran a medida que aparecen nuevas imágenes y cambian las condiciones. El aprendizaje activo ayuda a centrar el entrenamiento en casos inciertos, de modo que el esfuerzo se centra donde realmente mejora la precisión.

Nuestro objetivo no es solo velocidad, sino también confiabilidad. Al entrenar con datos geoespaciales reales, garantizamos la fiabilidad de los modelos en producción, no solo en pruebas. El resultado es un reconocimiento de imágenes que convierte imágenes complejas en información útil para sectores como la agricultura, la infraestructura, la silvicultura y la administración pública.

Los pasos prácticos detrás del entrenamiento de un modelo de reconocimiento de imágenes

Entrenar un modelo de reconocimiento de imágenes no es un gran salto técnico. Es una secuencia de pequeñas decisiones deliberadas que se complementan entre sí. Cada paso resuelve un problema específico, y omitir o apresurar alguno de ellos suele traducirse posteriormente en baja precisión, predicciones inestables o un modelo que solo funciona en condiciones ideales.

Los pasos a continuación siguen el proceso de entrenamiento de los sistemas de reconocimiento de imágenes en proyectos reales. Abarcan desde la definición de la tarea y la preparación de los datos hasta el entrenamiento, la evaluación y el mantenimiento a largo plazo. Si bien las herramientas y las arquitecturas pueden cambiar, este proceso subyacente se mantiene sorprendentemente consistente en todos los sectores y casos de uso.

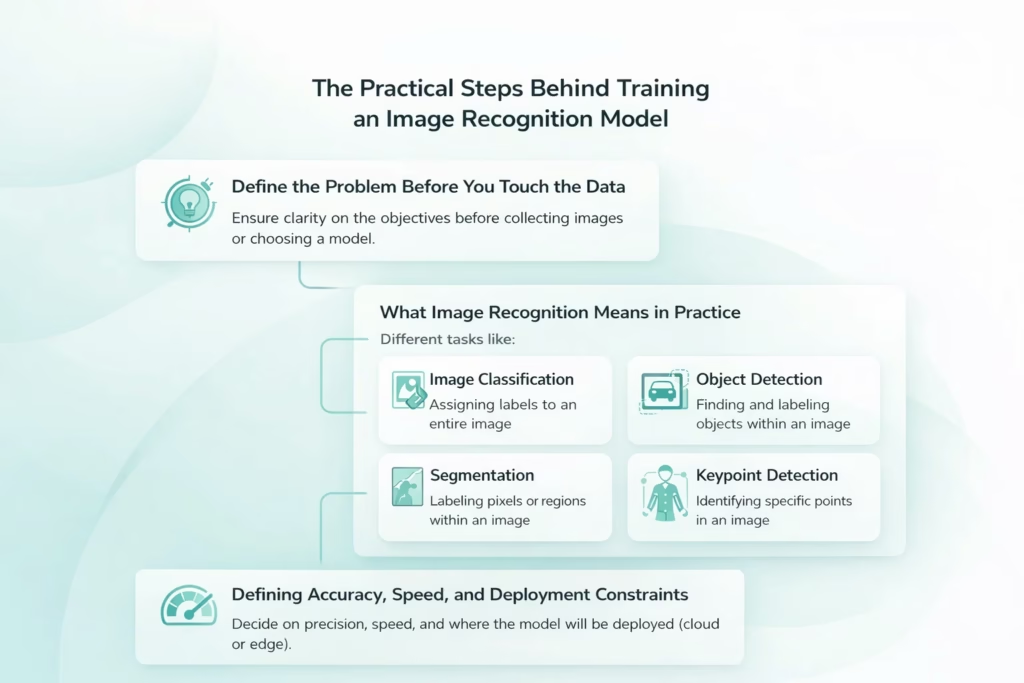

Paso 1: Defina el problema antes de tocar los datos

Antes de recopilar imágenes o elegir un modelo, es necesario tener claro qué debe hacer el sistema. Esto parece obvio, pero es donde muchos proyectos fracasan silenciosamente. Los objetivos imprecisos conducen a datos, etiquetas y criterios de evaluación erróneos.

Qué significa el reconocimiento de imágenes en la práctica

El reconocimiento de imágenes no es una tarea única. Puede adoptar diferentes formas según lo que se desee que el sistema produzca.

- Clasificación de imágenes. Asignación de una o más etiquetas a una imagen completa.

- Detección de objetos. Localización de objetos en una imagen e identificación de su ubicación y categoría.

- Segmentación. Etiquetado de píxeles o regiones en lugar de dibujar cuadros delimitadores. Se utiliza a menudo cuando la precisión es importante.

- Detección de puntos clave. Identificación de puntos específicos en una imagen, como articulaciones, puntos de referencia o marcadores de referencia.

Cada uno de estos enfoques requiere una configuración de entrenamiento, una estrategia de anotación y un método de evaluación diferentes. Un modelo entrenado para la clasificación de imágenes no funcionará automáticamente para la detección de objetos. La estructura del resultado define todo lo que sigue.

Definición de limitaciones de precisión, velocidad y implementación

Más allá de la tarea en sí, también debe decidir la precisión que necesita el sistema. ¿Es aceptable una clasificación aproximada o necesita precisión a nivel de píxel? ¿Es la velocidad más importante que la precisión? ¿El modelo se ejecutará en la nube o en dispositivos edge con recursos limitados?

Responder estas preguntas de manera temprana evita la ingeniería excesiva y le ayuda a elegir las compensaciones correctas más adelante en el proceso de capacitación.

Paso 2: Recopilar datos que reflejen el mundo real

Un modelo de reconocimiento de imágenes solo aprende lo que se le muestra. Si los datos de entrenamiento no se corresponden con el uso real, el rendimiento se verá afectado tras la implementación.

Los buenos conjuntos de datos no solo son grandes, sino que también son representativos.

Esto significa:

- Imágenes tomadas bajo diferentes condiciones de iluminación.

- Variaciones en ángulos, distancias y perspectivas

- Diferentes orígenes y entornos

- Oclusiones parciales y superposiciones

- Imperfecciones reales como desenfoque, ruido o artefactos de compresión

Un error común es entrenar con imágenes limpias e ideales y esperar que el modelo funcione en condiciones desfavorables. Las cámaras reales no se comportan como conjuntos de datos seleccionados.

Otro problema frecuente es el desequilibrio de clases. Si una categoría aparece con mucha más frecuencia que otras, el modelo aprenderá a favorecerla. Se podría obtener una alta precisión en teoría, pero pasar por alto casos raros pero importantes. En esta etapa, es mejor tener menos imágenes que reflejen la realidad que un conjunto masivo de datos que no lo haga.

Paso 3: Preparar y estructurar adecuadamente el conjunto de datos

Una vez recopiladas las imágenes, es necesario organizarlas de forma que el modelo pueda aprender de ellas. Aquí es donde la disciplina importa. Pequeños atajos en esta etapa suelen convertirse en un comportamiento de entrenamiento confuso más adelante.

- Reglas básicas de organización de conjuntos de datos. Antes de comenzar el entrenamiento, las imágenes deben seguir algunos principios estructurales básicos.

- Coherencia entre imágenes. Todas las imágenes deben tener el mismo formato y resolución. Mezclar tamaños de imagen, espacios de color o tipos de archivo introduce una variabilidad innecesaria y ralentiza el aprendizaje.

- Borrar divisiones de conjuntos de datos. Las imágenes deben estar claramente separadas en conjuntos de entrenamiento, validación y prueba, sin superposición entre ellos.

- Sin datos duplicados en las divisiones. Las imágenes duplicadas o casi duplicadas en diferentes divisiones generan resultados de evaluación engañosos y una falsa confianza en el rendimiento del modelo.

División recomendada de entrenamiento, validación y prueba

Una división típica de un conjunto de datos se ve así:

Conjunto de entrenamiento

Generalmente, entre el 60 % y el 80 % del conjunto total de datos. Aquí es donde el modelo aprende patrones y características.

Conjunto de validación

Normalmente entre el 10 % y el 20 %. Se utiliza para ajustar hiperparámetros y supervisar el rendimiento durante el entrenamiento.

Conjunto de prueba

Generalmente entre el 10 y el 20 por ciento. Reservado estrictamente para la evaluación final.

El conjunto de pruebas debe permanecer intacto hasta el final. Usarlo para guiar decisiones durante el entrenamiento anula su propósito.

Preprocesamiento y normalización

Las imágenes también requieren preprocesamiento antes de comenzar el entrenamiento. Esto suele incluir redimensionar las imágenes a un tamaño de entrada fijo y normalizar los valores de los píxeles.

La normalización ayuda a que el modelo converja más rápido y se comporte de manera más consistente en diferentes imágenes al mantener los valores de entrada dentro de un rango predecible.

Una estructura deficiente del conjunto de datos provoca problemas sutiles que son difíciles de depurar más adelante, por lo que reducir la velocidad en este paso ahorra tiempo en general.

Paso 4: Etiquete y anote con cuidado

La calidad de las anotaciones tiene un impacto directo en el rendimiento del modelo. Los modelos no aprenden la intención, sino patrones a partir de las etiquetas.

Para las tareas de clasificación, las etiquetas deben ser inequívocas. Si dos clases se superponen conceptualmente, el modelo tendrá dificultades, por muy avanzado que sea.

Para la detección y segmentación de objetos, la precisión de la anotación es aún más importante:

- Los cuadros delimitadores deben ser ajustados y consistentes.

- Los objetos no deben pasarse por alto ni etiquetarse de forma inconsistente.

- Los casos extremos deben seguir reglas claras

Las pautas de anotación deben redactarse antes de comenzar el etiquetado a gran escala. De lo contrario, distintos anotadores interpretarán la misma imagen de forma distinta.

El etiquetado asistido por IA puede agilizar el proceso, pero la revisión humana sigue siendo esencial. Pequeños errores de anotación añaden ruido, y este se acumula rápidamente. Si el modelo parece confuso posteriormente, el problema suele no ser la arquitectura, sino las etiquetas.

Paso 5: Utilice el aumento de datos para mejorar la generalización

Incluso los conjuntos de datos robustos se benefician de la mejora. Esta mejora introduce variación controlada en los datos de entrenamiento sin necesidad de recopilar imágenes adicionales, lo que ayuda al modelo a aprender patrones visuales más robustos.

Las técnicas comunes incluyen rotar o voltear imágenes, ajustar la escala o recortar regiones, modificar el brillo y el contraste, e introducir pequeñas cantidades de ruido o desenfoque. Cada uno de estos cambios expone al modelo a condiciones visuales ligeramente diferentes, preservando al mismo tiempo la estructura subyacente de la imagen.

El objetivo no es distorsionar las imágenes aleatoriamente. La aumentación debe simular los tipos de variación que probablemente encontrará el modelo tras su implementación. Por ejemplo, rotar imágenes médicas puede ser razonable en algunos contextos, mientras que invertir las imágenes de reconocimiento de texto alteraría su significado. Lo que funciona depende completamente del dominio del problema.

Cuando se aplica de forma inteligente, el aumento reduce el sobreajuste y mejora la capacidad de un modelo de generalizarse a imágenes que nunca ha visto antes.

Paso 6: Elija una arquitectura de modelo que se ajuste a la tarea

La elección del modelo es importante, pero no tanto como muchos creen. Un modelo simple bien entrenado suele superar a uno complejo mal entrenado.

Para la mayoría de las tareas de reconocimiento de imágenes, las redes neuronales convolucionales siguen siendo la base. Arquitecturas como ResNet y EfficientNet ofrecen un alto rendimiento y flexibilidad.

Si la velocidad es crucial, especialmente para la detección en tiempo real, se suelen utilizar detectores de disparo único como YOLO. Estos sacrifican precisión por velocidad y simplicidad.

Los transformadores de visión pueden ofrecer excelentes resultados con conjuntos de datos grandes y diversos, especialmente para imágenes de alta resolución. Sin embargo, requieren más datos y recursos computacionales, y no siempre son prácticos.

En muchos casos, el aprendizaje por transferencia es la mejor opción. Empezar con un modelo preentrenado ahorra tiempo y mejora los resultados, especialmente cuando los datos etiquetados son limitados.

Paso 7: Entrenar el modelo con configuraciones intencionales

El entrenamiento no se limita a pulsar "Ejecutar" y esperar. El aprendizaje del modelo depende de un pequeño conjunto de parámetros que determinan directamente la estabilidad, la velocidad y el rendimiento final.

Parámetros básicos de formación que dan forma al aprendizaje

Varias configuraciones interactúan durante el entrenamiento. Cada una afecta la forma en que el modelo se actualiza y responde a los errores.

Tasa de aprendizaje y estabilidad del entrenamiento

La tasa de aprendizaje controla la rapidez con la que el modelo actualiza sus ponderaciones internas. Si se establece demasiado alta, el entrenamiento se vuelve inestable y podría no converger. Si es demasiado baja, el aprendizaje se ralentiza y el modelo puede atascarse en soluciones débiles que nunca mejoran significativamente.

Tamaño del lote y balance de recursos

El tamaño del lote influye tanto en la estabilidad del entrenamiento como en el uso de memoria. Los lotes más grandes tienden a producir actualizaciones más fluidas, pero requieren más recursos computacionales. Los lotes más pequeños introducen mayor variación en las actualizaciones, lo que a veces puede facilitar la generalización, pero también puede ralentizar la convergencia.

Recuento de épocas y duración del entrenamiento

El número de épocas determina la duración del entrenamiento. Un número insuficiente de épocas puede dejar el modelo subentrenado, mientras que un número excesivo puede provocar un sobreajuste si el rendimiento deja de mejorar con los datos de validación.

Elección del optimizador y comportamiento de convergencia

La selección del optimizador afecta la eficiencia con la que el modelo gestiona el panorama de pérdidas. Cada optimizador gestiona los gradientes, el impulso y la dinámica de aprendizaje de forma distinta, lo que puede modificar notablemente el comportamiento del entrenamiento.

Monitoreo de señales de entrenamiento y validación

El seguimiento de las pérdidas de entrenamiento y validación es esencial durante todo el proceso. Si la precisión del entrenamiento continúa mejorando mientras el rendimiento de la validación se estanca o disminuye, es probable que se esté produciendo un sobreajuste.

Aquí es donde la paciencia da sus frutos. Ajustar un parámetro a la vez facilita comprender qué mejora realmente los resultados, en lugar de generar confusión modificando varias variables a la vez.

Paso 8: Aplicar regularización para evitar el sobreajuste

El sobreajuste es uno de los problemas más comunes en el reconocimiento de imágenes. El modelo funciona bien con datos de entrenamiento, pero falla con imágenes nuevas.

Las técnicas de regularización ayudan a controlar esto:

- La deserción obliga al modelo a depender de múltiples características

- Las penalizaciones L1 y L2 evitan que los pesos crezcan demasiado

- La detención temprana detiene el entrenamiento antes de la sobreoptimización

Estas técnicas no son soluciones para datos erróneos. Son medidas de seguridad que funcionan mejor cuando el conjunto de datos ya es sólido.

Un modelo que generaliza bien a menudo parece menos impresionante durante el entrenamiento, pero funciona mejor donde importa.

Paso 9: Evaluar con las métricas adecuadas

La precisión por sí sola rara vez revela la realidad completa. Especialmente en conjuntos de datos desequilibrados, puede ser engañosa.

Una mejor evaluación incluye:

- Precisión para comprender los falsos positivos

- Recordar para comprender las detecciones perdidas

- Puntuación F1 para equilibrar ambos

- Matrices de confusión para identificar problemas a nivel de clase

- AUC-ROC para problemas de clasificación binaria

Para la detección de objetos, métricas como Intersección sobre Unión y precisión promedio son esenciales.

La evaluación siempre debe realizarse con datos que el modelo nunca ha visto. De lo contrario, los resultados generan una falsa confianza.

Paso 10: Validar en condiciones realistas

Las métricas offline no son suficientes para comprender el comportamiento de un modelo de reconocimiento de imágenes una vez implementado. La validación debe realizarse en entornos que se asemejen al uso real de la producción.

Pruebas más allá de los puntos de referencia fuera de línea

La validación realista suele implicar ejecutar inferencias con transmisiones de cámaras en vivo o flujos de datos en tiempo real, en lugar de imágenes de prueba estáticas. También puede implicar probar el modelo en diferentes configuraciones de hardware, especialmente cuando la implementación incluye dispositivos periféricos con recursos limitados.

Evaluar el rendimiento bajo cargas variables del sistema es igualmente importante. Un modelo que funciona bien de forma aislada puede comportarse de forma muy diferente al procesar grandes volúmenes de datos o al operar junto con otros servicios. La revisión manual de los casos de fallo en esta etapa suele revelar patrones que las métricas automatizadas no detectan.

Muchos problemas solo aparecen durante esta fase. Los picos de latencia, las limitaciones de memoria y los casos extremos inesperados pueden cambiar el comportamiento del modelo en la práctica. La validación es donde el rendimiento teórico da paso al comportamiento real, y donde los ajustes finales suelen ser más importantes.

Paso 11: Iterar basándose en evidencia, no en suposiciones

Muy pocos modelos son correctos a la primera. Se espera iteración.

La buena iteración está impulsada por el análisis:

- Revisar los falsos positivos y los falsos negativos

- Identificar patrones de datos faltantes

- Ajustar etiquetas o estrategias de aumento

- Ajuste los hiperparámetros cuidadosamente

Añadir más datos suele ser más útil que ajustar las arquitecturas. Especialmente los datos que representan casos de fallo. La iteración debe reducir la incertidumbre, no introducir aleatoriedad.

Paso 12: Mantener y volver a capacitar a lo largo del tiempo

Los modelos de reconocimiento de imágenes no son sistemas estáticos. Los entornos cambian, los sensores evolucionan y el uso en el mundo real rara vez se mantiene estable. Sin una atención continua, incluso los modelos robustos pierden precisión poco a poco.

Por qué el mantenimiento es un requisito continuo

Una vez implementado, un modelo comienza a interactuar con nuevos patrones de datos. Los cambios en la iluminación, el clima, el hardware de la cámara o el comportamiento del usuario pueden modificar la apariencia de las imágenes en comparación con el conjunto de entrenamiento original. Esto hace que el mantenimiento continuo sea esencial, no opcional.

Monitoreo del rendimiento del modelo

El seguimiento del rendimiento a lo largo del tiempo ayuda a detectar caídas graduales de la precisión que podrían no generar alertas inmediatas. La degradación silenciosa es común en los sistemas de reconocimiento de imágenes y, a menudo, pasa desapercibida sin una supervisión regular.

Recopilación de datos nuevos y representativos

A medida que cambian las condiciones, es necesario recopilar y revisar nuevos datos. Esto garantiza que el conjunto de datos de entrenamiento siga reflejando el uso real, en lugar de suposiciones obsoletas.

Reentrenamiento con conjuntos de datos actualizados

El reentrenamiento permite que el modelo incorpore nuevos ejemplos y corrija las debilidades emergentes. Suele ser más efectivo reentrenarlo gradualmente que esperar a que el rendimiento disminuya significativamente.

Sesgo de auditoría y desviación de datos

Las auditorías periódicas ayudan a detectar sesgos, desequilibrios de clases y desviaciones de datos que pueden distorsionar lentamente las predicciones. Abordar estos problemas de forma temprana mantiene la fiabilidad del modelo en diferentes entornos y poblaciones.

Los equipos que planifican la capacitación desde el principio tienden a construir sistemas duraderos. En lugar de reaccionar ante los fallos, tratan el reconocimiento de imágenes como un proceso vivo que mejora con los datos que aprende.

Reflexiones finales

Entrenar un modelo de reconocimiento de imágenes no se trata de buscar la perfección. Se trata de construir un sistema que aprenda de forma fiable, se adapte con el tiempo y se comporte de forma predecible en el mundo real.

Los buenos resultados se obtienen con fundamentos bien aplicados: recopilación de datos meditada, etiquetado cuidadoso, elección de modelos razonables y evaluación honesta.

Cuando esas piezas están en su lugar, el modelo no necesita ser llamativo. Simplemente necesita funcionar.

Y cuando funciona, tiende a seguir funcionando, incluso cuando las condiciones cambian.

Preguntas frecuentes

El cronograma depende del alcance de la tarea, el tamaño y la calidad del conjunto de datos, y si se utilizan modelos preentrenados. Los modelos de clasificación simples pueden entrenarse en días o semanas, mientras que los sistemas más complejos de detección o segmentación de objetos suelen tardar de varias semanas a meses, cuando incluyen la preparación, validación e iteración de datos.

No hay una cifra fija. Algunos modelos funcionan bien con unos pocos miles de imágenes de alta calidad, especialmente cuando se utiliza el aprendizaje por transferencia. Otros requieren decenas o cientos de miles de imágenes para generalizar de forma fiable. Lo que importa más que el volumen es si los datos reflejan las condiciones reales y los casos extremos.

No. En la mayoría de los casos, la mejor opción es empezar con un modelo preentrenado. El aprendizaje por transferencia reduce el tiempo de entrenamiento, mejora el rendimiento con datos limitados y reduce los costos de infraestructura. El entrenamiento desde cero suele reservarse para dominios altamente especializados o conjuntos de datos muy grandes.

La mala calidad de los datos es el problema más común. Etiquetas inconsistentes, casos extremos faltantes, imágenes de entrenamiento poco realistas o fugas de datos entre conjuntos de datos suelen causar más daño que la elección del modelo o la configuración de hiperparámetros.

El sobreajuste suele aparecer cuando el rendimiento del entrenamiento sigue mejorando, pero el de la validación deja de mejorar o empieza a disminuir. Esto indica que el modelo está aprendiendo los datos de entrenamiento con demasiada precisión y no logra generalizarlos a nuevas imágenes.