OpenClaw no es solo otra interfaz de chat con un nombre elegante. Es más bien una capa de control para agentes de IA que pueden leer archivos, llamar a herramientas y responder dentro de las aplicaciones que ya usas. Esa potencia es su esencia. También es la razón por la que no deberías tratarlo a la ligera. Si lo abordas como ChatGPT con un logotipo diferente, perderás lo que lo hace útil. Si lo abordas como infraestructura, le sacarás un verdadero provecho.

Cómo OpenClaw convierte el chat en acción

OpenClaw no es solo una interfaz de chat con complementos. Funciona como una puerta de enlace local que conecta tu plataforma de chat, tu modelo de IA y tu capa de acción en un único sistema controlado. Se conecta con herramientas como Telegram o Slack, se conecta a un modelo que se ejecuta localmente a través de Ollama o de un proveedor de nube como OpenAI o Anthropic, y gestiona el acceso a archivos, las API y la ejecución de scripts mediante memoria local persistente. Todo fluye a través de esta única puerta de enlace.

En la práctica, un mensaje entra por chat, el agente lo evalúa, opcionalmente llama a una herramienta y devuelve un resultado estructurado. Puede leer registros, resumir errores, crear tickets, actualizar registros de CRM o ejecutar scripts predefinidos. El contexto se transmite entre sesiones, lo que convierte a OpenClaw en una capa operativa en lugar de ser un simple asistente.

FlyPix AI y automatización de IA en el mundo real

En FlyPix AI, Aplicamos agentes de IA en un dominio diferente, pero el principio es similar. La automatización solo genera valor cuando se conecta directamente con datos operativos reales. Nuestra plataforma se centra en imágenes satelitales, aéreas y de drones, donde los modelos de IA detectan, monitorean e inspeccionan objetos a escala. En lugar de la anotación manual, automatizamos el análisis geoespacial con modelos entrenados para identificar y delinear objetos con precisión.

Diseñamos el sistema para que sea práctico desde el principio. Los usuarios pueden entrenar modelos de IA personalizados sin conocimientos avanzados de programación, definir sus propias anotaciones y aplicarlas en sectores como la construcción, la agricultura, el mantenimiento de infraestructuras y proyectos gubernamentales. El enfoque no es la inteligencia abstracta, sino la eficiencia medible en entornos visuales complejos.

También puedes encontrar FlyPix AI en LinkedIn Si desea contactarnos allí, hágalo. Para nuestra empresa, la IA no se trata de experimentación. Se trata de convertir datos visuales en resultados estructurados que los equipos puedan usar con confianza en operaciones reales.

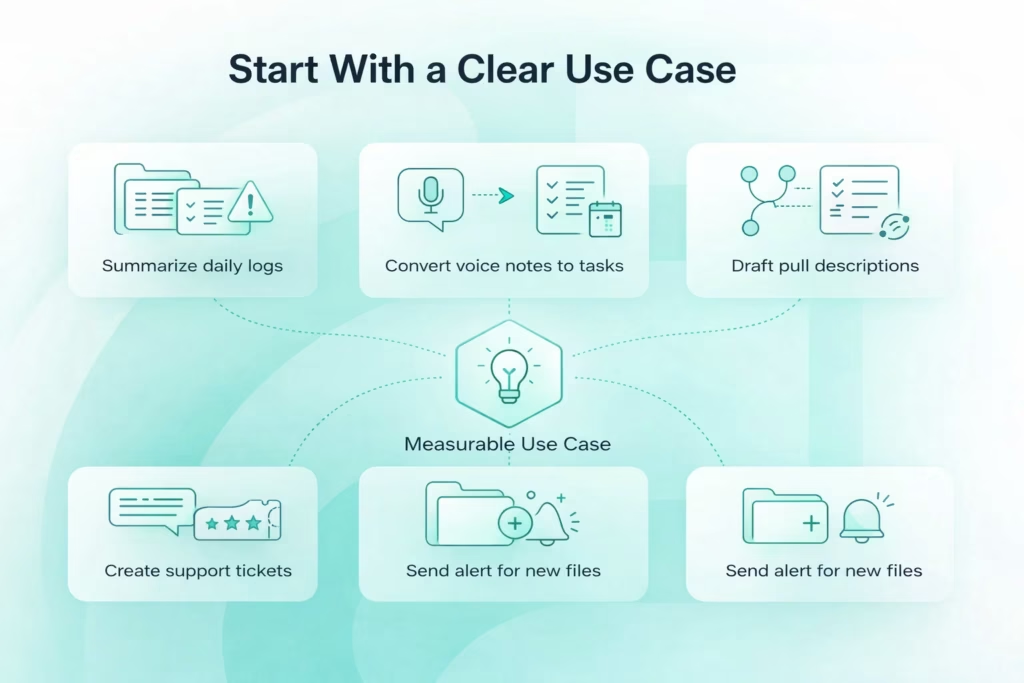

Comience con un caso de uso claro

El mayor error que se comete con OpenClaw es simple: primero instalan y luego piensan. Cuando el sistema está en funcionamiento, pero el propósito no está claro, se termina ajustando la configuración en lugar de resolver un problema real. Antes de instalar nada, define un caso de uso medible. Debe ser lo suficientemente específico como para poder determinar con claridad si funciona o no. Los primeros objetivos sólidos suelen ser así:

- Resuma los registros diarios de una carpeta específica y resalte el último error crítico

- Convierte notas de voz de Telegram en tareas estructuradas con título y fecha límite

- Borradores de descripciones de solicitudes de extracción utilizando el contexto del repositorio y las confirmaciones recientes

- Crear tickets de soporte a partir de entradas de chat estructuradas con niveles de prioridad

- Supervisar una carpeta y enviar una alerta cuando aparecen nuevos archivos

Cada ejemplo tiene un disparador claro, una entrada definida y una salida observable. Esta estructura mantiene la configuración enfocada y evita complejidades innecesarias. Empiece con un enfoque específico. Si el objetivo es vago, dedicará más tiempo a mejorar la arquitectura que a generar valor. OpenClaw funciona mejor cuando se vincula a un flujo de trabajo medible. Una vez que ese bucle se estabiliza, la expansión se vuelve intencional en lugar de experimental.

Prepare su sistema para OpenClaw

Una configuración estable de OpenClaw se inicia antes de ejecutar el instalador. Este no es un plugin de chat ligero. Es una puerta de enlace local que puede leer archivos, ejecutar herramientas y conectarse a modelos externos. Su equipo, red y permisos forman parte del sistema. Unos minutos de preparación anticipada evitan horas de resolución de problemas más adelante.

Como mínimo, necesitas la última versión de Node.js (LTS), una terminal que te resulte cómoda y una clave API de modelo en la nube de OpenAI o Anthropic, u Ollama si planeas ejecutar un modelo local. Telegram es la interfaz más sencilla para las primeras pruebas. Si vas a usar el modelo local, planifica tu hardware de forma realista. Dieciséis gigabytes de RAM son una base razonable para un rendimiento estable. Los modelos más grandes requerirán más.

Tu entorno importa. No lo instales a ciegas en un portátil corporativo. No expongas los puertos públicamente por comodidad. Evita ejecutarlo con privilegios elevados a menos que sea absolutamente necesario. OpenClaw lee archivos locales y ejecuta acciones. Esa es su fortaleza. Trátalo con el mismo cuidado que le darías a cualquier sistema con acceso directo a tus datos.

Instalación y configuración inicial de OpenClaw

OpenClaw avanza con rapidez, por lo que lo más seguro es seguir el proceso de instalación oficial. El objetivo es simple: que la puerta de enlace funcione de forma limpia y predecible. Sin experimentos ni ajustes personalizados todavía. Solo una base sólida.

1. Elija su método de instalación

Dependiendo de la distribución actual, instalará OpenClaw mediante un script de arranque o mediante npm. Ambos métodos buscan el mismo resultado: instalar dependencias y registrar el servicio de puerta de enlace. El flujo de arranque típico es el siguiente:

| curl -fsSL https://openclaw.ai/install.sh | bash |

Si prefieres npm, la ruta de instalación global es sencilla:

| npm install -g openclaw@latest |

Ninguno de los métodos debería parecer complicado. Si la instalación presenta errores, deténgala y resuélvalos antes de continuar. Una instalación limpia es más importante que la velocidad.

2. Ejecutar el proceso de incorporación

Después de la instalación, ejecute el asistente de incorporación:

| garra abierta a bordo |

Este paso configura la puerta de enlace y la configura como servicio en segundo plano. Una vez completado, el sistema debería informar que la puerta de enlace está activa. En este punto, OpenClaw no solo está instalado, sino que ya está operativo.

3. Acceda a la interfaz de control

De forma predeterminada, la interfaz de usuario de control (panel de control) se ejecuta localmente en:

| http://127.0.0.1:18789/ (o http://localhost:18789/) |

Abre esa dirección en tu navegador. Si todo está configurado correctamente, deberías ver el panel de control. Si no carga, comprueba lo siguiente:

- Confirme que el servicio de puerta de enlace se esté ejecutando

- Verifique que ningún otro proceso esté usando el puerto 18789

- Revisar la configuración del firewall local

Una regla importante: mantenga la puerta de enlace vinculada a localhost. No la exponga públicamente. La interfaz de control administra un agente que puede acceder a archivos locales y ejecutar herramientas. Restringir el acceso a 127.0.0.1 mantiene la superficie de control segura mientras compila y prueba.

Configuración de la integración de Telegram

Telegram es una de las formas más rápidas de activar OpenClaw. La configuración es sencilla, la API es fácil de aprovisionar y puedes verificar el bucle de mensajes completo en minutos. Es ideal para las pruebas iniciales cuando te centras en la lógica del agente, no en la sobrecarga de integración.

Abre Telegram, busca @BotFather y escribe /newbot. Elige un nombre y copia el token de API proporcionado. Durante la integración con OpenClaw, pega ese token cuando se te solicite. Una vez guardado, la pasarela conecta tu agente local a Telegram. La precisión es fundamental. Un solo carácter incorrecto puede romper la conexión.

Tras la configuración, envía un mensaje de prueba a tu bot y revisa la interfaz de control. Si el mensaje aparece y recibes una respuesta en Telegram, el bucle funciona correctamente. Esto confirma que la puerta de enlace, el modelo y la capa de comunicación funcionan conjuntamente. A partir de aquí, pasa de la configuración a la creación de flujos de trabajo reales.

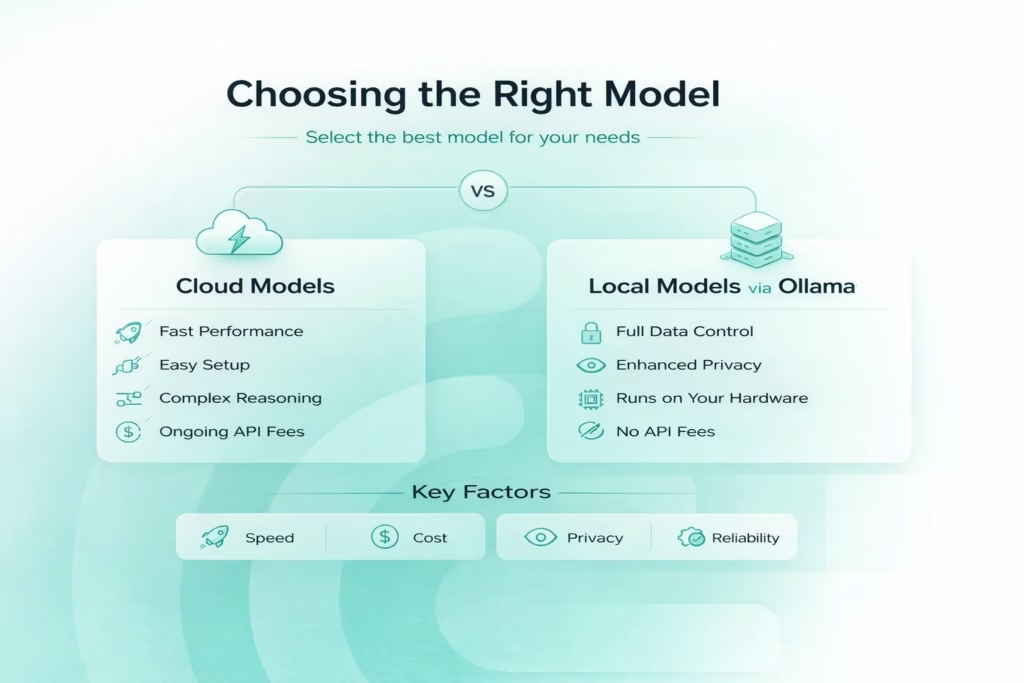

Elegir el modelo adecuado

La elección del modelo afecta directamente la velocidad, el coste, la privacidad y la fiabilidad general. OpenClaw no te limita a un único proveedor, lo cual es una ventaja. Sin embargo, la flexibilidad solo es útil si comprendes las ventajas y desventajas. Existen dos opciones principales: modelos en la nube y modelos locales. Cada uno satisface una necesidad operativa diferente.

1. Modelos en la nube: rápidos, potentes y de baja fricción

Los modelos en la nube son la forma más rápida de obtener un rendimiento de razonamiento sólido sin preocuparse por el hardware. Se conecta una clave API, se configura el proveedor y el agente está listo. Los modelos en la nube suelen ser ideales para:

- Razonamiento complejo y toma de decisiones estructurada

- Flujos de trabajo de codificación y depuración

- Configuración rápida con mínima configuración

- Equipos que no quieren gestionar infraestructura

Modelos como Claude 3.5 Sonnet y los sistemas de clases GPT-4 gestionan flujos de trabajo agénticos con alta fiabilidad. Interpretan las instrucciones con claridad, gestionan bien el razonamiento multipaso y responden con rapidez. Las ventajas y desventajas son claras:

- Costos continuos de API

- Los datos se transmiten fuera de su entorno local

- Dependencia del tiempo de actividad externo

Para muchos usuarios, esto es aceptable. Para otros, especialmente en entornos sensibles, puede que no lo sea.

2. Modelos locales a través de Ollama: Control y contención

Si la privacidad y la autonomía son importantes, ejecutar un modelo local a través de Ollama es la opción lógica. Con esta configuración, el modelo permanece en su máquina. Sin llamadas a API externas. Sin datos que salgan de su red. Es ideal para:

- Flujos de trabajo sensibles a los datos

- Entornos de desarrollo

- Capacidad sin conexión

- Control total sobre la ejecución

Ollama admite modelos como Qwen2.5-Coder, la serie GLM-4, las variantes de Llama 3.1/3.2 y otros modelos con ventanas de contexto amplias, ideales para agentes. Para OpenClaw, el tamaño del contexto es fundamental.

El agente depende de la ventana de contexto del modelo para gestionar la memoria, por lo que ventanas más pequeñas pueden reducir la consistencia en sesiones más largas. Una ventana de contexto de 32 k-128 k es una base práctica para un razonamiento estable (dependiendo del modelo; muchos modelos Ollama recomendados para OpenClaw parten de 32 k-128 k).

El rendimiento depende del hardware. Si las respuestas se ralentizan o las llamadas a herramientas se retrasan, suele deberse a una limitación de recursos, no a un error de configuración. La clave está en elegir un modelo que se ajuste a la memoria y la potencia de procesamiento disponibles.

3. Tomar la decisión práctica

No hay una respuesta universal. Algunos equipos utilizan modelos en la nube para razonamiento complejo y modelos locales para desarrollo o tareas delicadas. Otros se comprometen plenamente con un enfoque. Elija en función de:

- Sensibilidad de sus datos

- Requisitos de rendimiento

- Restricciones presupuestarias

- Capacidad de hardware

El modelo adecuado no solo mejora las respuestas, sino que estabiliza todo el flujo de trabajo. Cuando la capa del modelo se alinea con sus necesidades operativas, OpenClaw funciona de forma predecible y eficiente.

Comprender la memoria persistente

La memoria persistente es una de las características que distingue a OpenClaw de un asistente de chat típico. En lugar de empezar desde cero cada vez, almacena la memoria persistente localmente mediante SQLite para la indexación, archivos Markdown fragmentados como fuente de información y búsqueda híbrida (BM25 + incrustaciones vectoriales). Esto es más que un simple registro de chat. Es un contexto organizado al que el agente puede hacer referencia para tomar decisiones posteriormente.

Por ejemplo, podrías decirle al agente: “Mi panel interno usa React y Tailwind. Prefiero componentes funcionales”. Unos días después, le pides que cree un componente de encabezado. Si la memoria funciona correctamente, seguirá esas preferencias anteriores sin que tengas que repetirlas. Esta continuidad se debe a que el contexto almacenado se reintroduce en el proceso de razonamiento.

Aquí es donde la eficiencia se desarrolla con el tiempo. En lugar de reescribir instrucciones en cada sesión, se acumula contexto duradero dentro del sistema. Vale la pena revisar la memoria almacenada de vez en cuando para ver qué se guarda. Al comprender el funcionamiento de la memoria, se mantiene la consistencia y la previsibilidad del agente a medida que los flujos de trabajo se expanden.

Construyendo su primer flujo de trabajo real

Una vez que la conexión es estable, es hora de pasar de la conversación a la ejecución. OpenClaw resulta práctico cuando ejecuta tareas estructuradas, no solo responde a preguntas abiertas. Esto requiere definir un flujo de trabajo claro, para que el agente sepa qué hacer y cómo confirmar el resultado. Un flujo de trabajo fiable siempre incluye cuatro componentes:

- Desencadenar: El comando o evento específico que activa el proceso, como escribir “nuevo ticket” en Telegram.

- Estructura de entrada: Los datos exactos que el agente necesita para completar la tarea, por ejemplo, título, descripción y nivel de urgencia.

- Ejecución de la herramienta: La acción definida realizada por el agente, como enviar una solicitud a la API de su sistema de tickets.

- Salida de confirmación: Una respuesta estructurada que demuestra la finalización, como devolver el ID del ticket y un breve resumen.

Tomemos como ejemplo la automatización de tickets. Al escribir "nuevo ticket", el agente debe recopilar los campos obligatorios, llamar a la API y devolver una confirmación. Sin conjeturas ni suposiciones. Los desencadenadores claros y las entradas estructuradas garantizan la fiabilidad del proceso. Empiece con un flujo de trabajo específico, estabilícelo y luego amplíelo progresivamente.

Operación de OpenClaw en entornos reales

Una vez que su primer flujo de trabajo se estabilice, comienza su uso real. En este punto, OpenClaw se integra a sus operaciones diarias o se convierte en un experimento técnico. La diferencia no radica en añadir más automatizaciones, sino en observar cómo se comporta el proceso existente en condiciones reales. Déjelo funcionar. Pruébelo con diversas entradas. Observe cómo gestiona casos extremos antes de expandirlo.

En el uso diario, la visibilidad es fundamental. Revise la actividad en la interfaz de usuario de Control. Compruebe qué herramientas se están activando y cómo se estructuran los resultados. Si los resultados parecen inconsistentes, la causa suele ser una desviación del alcance o instrucciones poco claras, más que limitaciones del modelo. Pequeñas mejoras en la estructura suelen generar más estabilidad que cambiar el modelo en sí.

La expansión debe ser deliberada. Agregue nuevas tareas gradualmente y aíslelas de los procesos existentes hasta que sean predecibles. OpenClaw funciona mejor cuando los flujos de trabajo están claramente delimitados y la memoria sigue siendo relevante. El uso diario no se trata de experimentación constante. Se trata de escalar de forma controlada un sistema de IA que comprenda y pueda gestionar con confianza.

Consejos prácticos y errores comunes que hay que evitar

OpenClaw puede funcionar sin problemas durante meses o convertirse en una constante tarea de resolución de problemas. La diferencia suele radicar en la disciplina. La mayoría de los problemas no provienen del modelo en sí, sino de decisiones de configuración, un alcance poco claro o límites ignorados. A continuación, se presentan los problemas y hábitos de rendimiento más comunes que distinguen las implementaciones estables de las frágiles.

Errores operativos que deben evitarse

Estos son patrones que se observan repetidamente en implementaciones reales. Puede que no dañen el sistema inmediatamente, pero generan riesgo e inestabilidad con el tiempo.

- Instalación en un dispositivo corporativo sin aprobación: OpenClaw lee archivos locales y puede enviar datos a modelos externos, lo que puede violar políticas internas.

- Introducción de código propietario en modelos de nube sin revisión: Los datos confidenciales transmitidos a través de API pueden generar problemas de cumplimiento y seguridad.

- Conceder acceso sin restricciones al sistema de archivos: El agente no debe tener acceso a todo su directorio personal a menos que sea absolutamente necesario.

- Exponiendo el puerto de enlace para mayor comodidad: Abrir el puerto 18789 públicamente aumenta la superficie de ataque sin ningún beneficio real.

- Tratando la memoria como infalible: La memoria persistente es poderosa, pero puede almacenar contexto obsoleto o incorrecto si no se revisa.

- Complicando demasiado el primer flujo de trabajo: Comenzar con una automatización de varios pasos en lugar de una tarea simple aumenta los errores de configuración.

El principio rector es simple: mantener el alcance limitado, los permisos limitados y expandirse gradualmente una vez que se demuestre la estabilidad.

Optimización del rendimiento y la estabilidad

Si el rendimiento parece inconsistente, la causa suele ser estructural, no misteriosa. OpenClaw depende de la capacidad del modelo, la gestión de la memoria y la claridad de la solicitud. Pequeños ajustes suelen marcar una diferencia notable.

- Reducir el tamaño del modelo al ejecutar localmente: Los modelos más grandes requieren más memoria y potencia de procesamiento, lo que aumenta la latencia.

- Aumente la RAM disponible si es posible: El razonamiento local mejora cuando el sistema tiene suficiente margen.

- Limpiar la acumulación excesiva de memoria: Las sesiones de larga duración con un gran contexto almacenado pueden ralentizar el procesamiento.

- Limitar los bucles de invocación de herramientas: Las llamadas a herramientas repetidas o anidadas pueden crear retrasos innecesarios.

- Utilice indicaciones estructuradas en lugar de instrucciones abiertas: Una entrada clara reduce el uso de tokens y mejora la precisión de la respuesta.

El rendimiento mejora cuando las instrucciones tienen un alcance definido y los recursos se alinean con la carga de trabajo. OpenClaw no requiere ajustes constantes. Requiere una configuración deliberada y expectativas realistas. Cuando estas se cumplen, el sistema se mantiene eficiente y predecible.

Conclusión

OpenClaw se vuelve poderoso en el momento en que dejas de tratarlo como un chatbot y empiezas a tratarlo como una infraestructura. No se trata de respuestas ingeniosas, sino de una ejecución controlada. Al definir un objetivo claro, configurar la puerta de enlace correctamente, elegir el modelo adecuado y estructurar tu primer flujo de trabajo con cuidado, el sistema empieza a parecer menos experimental y más operativo.

La clave es la disciplina. Al principio, mantén un alcance limitado. Protege tu entorno. Crea un flujo de trabajo que funcione de forma fiable y luego expándelo. OpenClaw valora la claridad. Cuanto más claras sean tus entradas y permisos, más predecibles serán los resultados. Si se usa correctamente, no es solo una capa de mensajería con herramientas integradas. Es una capa de ejecución de IA controlable que se integra en el trabajo real. Ahí es donde aporta valor.

Preguntas frecuentes

La instalación es sencilla si se siguen los comandos oficiales. La mayor parte de los problemas se deben a objetivos poco claros, no a la complejidad técnica. Si se define un flujo de trabajo específico antes de la instalación, la configuración se simplifica mucho.

Sí, si usa un modelo local a través de Ollama. En esa configuración, el modelo y la puerta de enlace se ejecutan en su equipo. No se requieren llamadas a la API externa. Tenga en cuenta que el rendimiento depende de la capacidad de su hardware.

Eso depende de las políticas de su organización. OpenClaw puede leer archivos locales e interactuar con modelos externos. Instalarlo en un dispositivo corporativo sin autorización puede infringir las normas de seguridad internas. Es mejor usar un equipo personal o un entorno dedicado.

Empiece con algo medible y de bajo riesgo, como resumir registros, redactar mensajes estructurados o crear tickets. Evite automatizaciones complejas de varios pasos al principio. La estabilidad es más importante que la ambición en esta etapa.

La memoria persistente permite al agente conservar el contexto entre sesiones, lo que mejora la continuidad. Sin embargo, las ventanas de contexto más amplias y las sesiones largas pueden aumentar el uso de recursos, especialmente con modelos locales. Revisar periódicamente la memoria almacenada ayuda a mantener la claridad y la eficiencia.