Os modelos de reconhecimento de imagem raramente falham devido a uma arquitetura incorreta. Eles falham porque a precisão é mal compreendida, medida de forma inadequada ou verificada em condições que não refletem a realidade. Um modelo pode parecer impressionante durante o treinamento e ainda assim falhar no momento em que se depara com dados reais.

Verificar a precisão do reconhecimento de imagens não se resume a buscar uma única pontuação. Trata-se de entender o que o modelo acerta, o que ele erra e por que esses erros acontecem. Na prática, a precisão é uma combinação de métricas, rigor na validação e testes honestos em cenários reais. Este guia explica como avaliar sistemas de reconhecimento de imagens de uma forma que realmente indique se eles estão prontos para uso.

Por que a precisão geral raramente revela a verdade

A precisão geral é a métrica mais comum e também a menos informativa quando os projetos deixam de ser problemas simples. Ela mede a frequência com que as previsões correspondem aos rótulos, mas ignora o desequilíbrio de classes, a gravidade dos erros e as mudanças na distribuição.

Um modelo pode alcançar uma precisão muito alta ao ter um bom desempenho em casos comuns e fáceis, enquanto falha consistentemente em casos raros, porém críticos. Em projetos reais, esses casos raros são frequentemente a razão pela qual o modelo existe em primeiro lugar.

A precisão geral não é inútil, mas deve ser tratada como um sinal superficial. Ela pode indicar se algo está obviamente quebrado, mas não pode confirmar que um sistema é confiável.

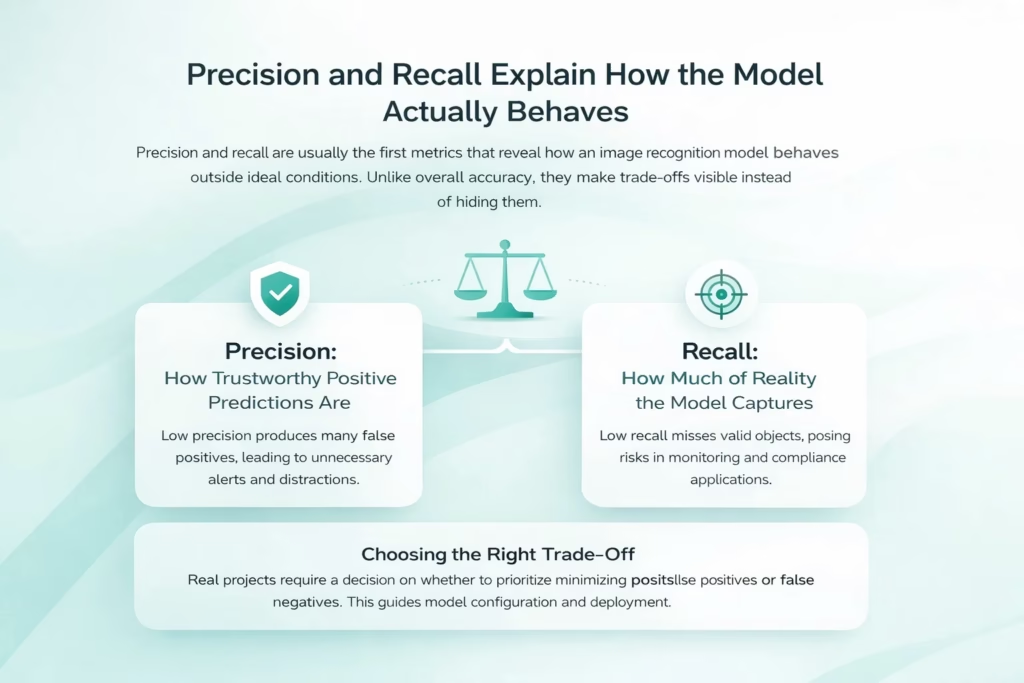

Precisão e revocação explicam como o modelo realmente se comporta.

Precisão e revocação são geralmente as primeiras métricas que revelam como um modelo de reconhecimento de imagem se comporta fora de condições ideais. Ao contrário da acurácia geral, elas tornam as compensações visíveis em vez de escondê-las.

Precisão: Quão confiáveis são as previsões positivas?

A precisão reflete a frequência com que o modelo acerta ao fazer uma previsão positiva. Baixa precisão significa que o sistema produz muitos falsos positivos. Em projetos reais, isso rapidamente se torna um problema quando cada detecção aciona um alerta, um fluxo de trabalho ou uma revisão humana. Mesmo um modelo tecnicamente preciso pode se tornar inutilizável se exigir atenção desnecessária constantemente.

Recordando: Quanta da realidade o modelo captura?

A taxa de recall mede a cobertura. Ela mostra o quanto do que está realmente presente o modelo consegue detectar. Um modelo com baixa taxa de recall deixa de detectar objetos válidos, mesmo que as detecções que ele faça estejam corretas. Em sistemas de monitoramento, segurança ou conformidade, detecções perdidas geralmente representam um risco maior do que detecções falsas.

Escolhendo a relação de compromisso certa

Precisão e revocação descrevem modos de falha diferentes, e nenhum deles é universalmente melhor. Projetos reais exigem uma decisão explícita sobre quais erros são mais aceitáveis. Essa decisão deve orientar o ajuste de limiares, a seleção do modelo e como a precisão é avaliada em última instância.

Tornando a precisão do reconhecimento de imagens prática na FlyPix AI.

No FlyPix IA, Trabalhamos com reconhecimento de imagem, onde a precisão precisa se manter em condições reais, não apenas em dados de teste limpos. Imagens de satélite, aéreas e de drones são complexas por natureza, então nos concentramos em uma precisão que se mantém em diferentes ambientes, escalas e mudanças.

Não consideramos a precisão como uma única métrica. Nossa plataforma foi criada para ajudar equipes a treinar modelos personalizados, validar detecções visualmente e iterar rapidamente. Ao manter o conhecimento do domínio próximo ao modelo e reduzir o tempo necessário para testar e retreinar, transformamos a precisão em algo com que as equipes podem trabalhar ativamente, e não apenas medir uma única vez.

A precisão não termina com a implantação. À medida que as imagens mudam ao longo do tempo, nossos fluxos de trabalho oferecem suporte à validação e ao retreinamento contínuos, para que os modelos permaneçam alinhados com as condições do mundo real, em vez de se tornarem obsoletos gradualmente.

Interpretando as principais métricas de precisão em conjunto

Uma vez que os números básicos de precisão estejam disponíveis, o trabalho de verdade começa. Sistemas de reconhecimento de imagem raramente falham por falta de uma métrica. Eles falham porque as métricas são analisadas isoladamente. Precisão, recall, pontuação F1, IoU e mAP descrevem diferentes aspectos do comportamento do modelo, e nenhum deles é significativo por si só. O objetivo é entender como eles interagem e o que revelam quando analisados em conjunto.

Utilizando a pontuação F1 sem perder detalhes

A pontuação F1 combina precisão e revocação em um único número. É útil para comparações, especialmente quando nenhuma das métricas deve se sobressair.

No entanto, a pontuação F1 nunca deve substituir a inspeção direta da precisão e da revocação. Dois modelos com a mesma pontuação F1 podem se comportar de maneira muito diferente na prática. Um pode não detectar casos raros. O outro pode sobrecarregar o sistema com falsos positivos.

Considere a pontuação F1 como um resumo, não como uma conclusão.

A precisão na detecção de objetos muda as regras.

A precisão do reconhecimento de imagens torna-se mais complexa quando se trata de detecção de objetos. Os sistemas de detecção devem identificar o que está presente e localizá-lo corretamente dentro da imagem.

A Interseção sobre União, ou IoU, mede o quão bem as caixas delimitadoras previstas se sobrepõem aos valores reais. Ela transforma a precisão em um problema espacial, em vez de uma simples tarefa de classificação.

A escolha dos limiares de IoU não é um detalhe técnico. Limiares pouco rigorosos podem mascarar problemas de localização. Limiares extremamente rígidos podem penalizar detecções que são suficientemente boas para uso operacional. Em projetos reais, o IoU deve refletir a precisão necessária das detecções, e não o que fica melhor nos relatórios.

Precisão Média e seus Limites

A Precisão Média (mAP, na sigla em inglês) é amplamente utilizada porque combina a confiança na detecção, a qualidade da classificação e a precisão da localização em diferentes limiares. Ela fornece uma maneira estruturada de comparar modelos de detecção de objetos treinados em condições semelhantes.

O mAP é mais valioso como métrica comparativa. Ele ajuda as equipes a entender se uma abordagem melhora a qualidade da detecção em relação a outra. O que ele não garante é robustez. Um modelo pode ter uma boa pontuação em mAP e ainda assim falhar sob condições específicas de iluminação, ambientes ou arranjos de objetos.

Por essa razão, o mAP deve ser tratado como uma lente, não como um veredicto.

Sempre analise o desempenho por turma.

Um dos motivos mais comuns para o fracasso de sistemas de reconhecimento de imagem é o desempenho desigual entre as classes. Métricas agregadas mascaram esse problema.

Ao avaliar a precisão, sempre inspecione as métricas por classe. Isso revela se certos objetos são consistentemente mais difíceis de detectar ou mais propensos a serem confundidos com outros.

Essa etapa geralmente altera as prioridades. Um modelo que parece robusto no geral pode ser inaceitável se falhar nas classes mais importantes.

Matrizes de confusão transformam erros em padrões.

As matrizes de confusão são uma das ferramentas mais práticas para entender o comportamento de um modelo de reconhecimento de imagens. Em vez de condensar os erros em uma única pontuação, elas mostram como as previsões transitam entre as classes, revelando a estrutura dos erros.

O que as matrizes de confusão revelam

Ao comparar previsões com dados reais, as matrizes de confusão ajudam a responder perguntas que as métricas escalares não conseguem:

- Quais são as classes sociais que são mais frequentemente confundidas entre si?

- Se os erros tendem a ser unidirecionais ou mútuos

- Se os erros se agrupam em torno de categorias visualmente semelhantes ou sobrepostas

Por que essa perspectiva é importante

Esses padrões frequentemente apontam diretamente para problemas subjacentes, como definições de classe ambíguas, rotulagem inconsistente ou exemplos de treinamento ausentes. Como as matrizes de confusão expõem as relações entre as classes, elas são especialmente úteis para decidir se é necessário coletar mais dados, refinar os rótulos ou ajustar os limites das classes.

A validação só funciona com dados verdadeiramente inéditos.

A avaliação da precisão falha quando os dados de validação são muito semelhantes aos dados de treinamento. Isso acontece com mais frequência do que as equipes esperam.

Se versões aumentadas das mesmas imagens aparecerem em múltiplas divisões, ou se os dados provierem das mesmas condições restritas, a precisão parecerá artificialmente alta. O modelo está sendo testado em variações do que já viu.

Um conjunto de testes significativo deve diferir em aspectos relevantes. Isso pode incluir diferentes locais, dispositivos, períodos de tempo ou condições de captura. Sem essa diferenciação, a avaliação da precisão torna-se autoconfirmatória em vez de preditiva.

Testes em condições reais alteram as conclusões.

Muitos problemas de precisão só aparecem quando os modelos encontram imperfeições do mundo real. Desfoque de movimento, ruído, oclusão, artefatos de compressão e iluminação inadequada expõem fragilidades que conjuntos de dados limpos jamais revelam.

Testar em condições realistas muitas vezes leva a descobertas desconfortáveis, mas valiosas. Um modelo que apresenta bom desempenho em cenários ideais pode ter dificuldades quando as condições variam, mesmo que ligeiramente. Descobrir isso antes da implementação economiza tempo, custos e credibilidade.

Esta etapa não exige simulação perfeita. Ela exige uma amostragem honesta de como as imagens realmente se apresentam na produção.

Precisão ao longo do tempo e o papel do viés

A precisão do reconhecimento de imagens não é estática. Os dados do mundo real evoluem constantemente, e os modelos que não são monitorados gradualmente se distanciam da realidade. Mudanças sazonais, novos hardwares, alterações ambientais e mudanças no comportamento do usuário afetam a aparência das imagens e a forma como os modelos as interpretam. Quando a precisão é verificada apenas no lançamento, essa degradação gradual muitas vezes passa despercebida até que as falhas se tornem óbvias.

As verificações de precisão pós-implantação devem se concentrar em tendências, e não em números isolados. O declínio gradual do desempenho costuma ser mais perigoso do que uma falha repentina, pois se esconde por trás de métricas familiares. O monitoramento contínuo permite detectar mudanças sutis precocemente e responder antes que a precisão caia abaixo dos níveis aceitáveis.

O viés desempenha um papel direto nesse processo. Modelos treinados com dados restritos ou desbalanceados tendem a apresentar bom desempenho apenas nas condições que já observaram. Quando novos ambientes, tipos de objetos ou padrões visuais surgem, as métricas de acurácia superestimam a confiabilidade. Reduzir o viés melhora a abrangência, mas também a robustez. Modelos mais justos geralmente são mais estáveis ao longo do tempo e mais fáceis de manter à medida que as condições mudam.

Utilizando a precisão para tomar decisões reais

As métricas de precisão existem para orientar decisões, não para impressionar as partes interessadas. Os relatórios devem explicar as compensações, as limitações e os riscos conhecidos, em vez de escondê-los por trás de um único número. Quando a precisão é apresentada sem contexto, cria uma falsa sensação de segurança e leva as equipes a ignorar problemas que surgem posteriormente na produção.

Na prática, um relatório de precisão útil deve deixar claro o seguinte:

- Quais tipos de erros são mais importantes e por que são aceitáveis ou não?

- Nos casos em que o modelo apresenta desempenho irregular, incluindo classes ou cenários com menor confiabilidade.

- Quais condições a avaliação reflete, como fontes de dados, ambientes ou períodos de tempo?

- Como se espera que o desempenho mude ao longo do tempo e como ele será monitorado.

Relatórios claros e honestos constroem confiança entre as equipes e levam a sistemas mais fáceis de manter, aprimorar e usar no mundo real.

Quando um modelo está realmente pronto

Um modelo está pronto quando seu comportamento é compreendido, não quando suas métricas atingem o ponto mais alto. Pontuações altas podem mascarar um desempenho frágil, especialmente se forem provenientes de conjuntos de dados restritos ou condições ideais. O que importa mais é saber como o modelo falha, onde essas falhas ocorrem e se elas estão de acordo com o risco aceitável. Erros previsíveis podem ser gerenciados por meio de limites, fluxos de trabalho ou retreinamento. Erros desconhecidos surgem mais tarde, geralmente quando o custo de corrigi-los é maior.

A verdadeira prontidão advém de uma avaliação rigorosa, e não de uma interpretação otimista. Isso significa testar em condições realistas, validar com dados verdadeiramente inéditos e monitorar o desempenho após a implementação. Um modelo que é continuamente observado e ajustado é muito mais confiável do que um que simplesmente pareceu robusto no lançamento.

Considerações finais

Verificar a precisão do reconhecimento de imagens em projetos reais não se trata de encontrar a pontuação mais alta. Trata-se de entender como um sistema se comporta quando a realidade interfere.

As métricas são ferramentas. Usadas com cuidado, revelam pontos fortes e fracos. Usadas de forma descuidada, criam confiança sem confiabilidade.

A diferença entre um sistema de demonstração e um sistema confiável de reconhecimento de imagens não está na arquitetura. Está na honestidade com que a precisão é medida, testada e mantida ao longo do tempo.

Perguntas frequentes

Não existe uma única métrica ideal. A acurácia geral pode ser útil como um indicador rápido, mas raramente é suficiente por si só. Em projetos reais, a acurácia deve ser avaliada usando uma combinação de precisão, recall e métricas específicas da tarefa, como IoU ou mAP para detecção de objetos. A combinação ideal depende de quais tipos de erros são mais relevantes para o seu caso de uso.

Isso geralmente acontece quando os dados de avaliação são muito semelhantes aos dados de treinamento ou não refletem as condições reais. Imagens nítidas, ambientes limitados ou vazamento de dados entre divisões podem inflar as pontuações de precisão. Assim que o modelo se depara com novas condições de iluminação, ângulos, ruído ou ambientes, surgem fragilidades que nunca foram testadas.

Depende do custo dos erros. Se falsos positivos acionam revisão manual, alertas ou ações automatizadas, a precisão importa mais. Se a ausência de objetos cria riscos ou pontos cegos, a abrangência é mais importante. A maioria dos sistemas reais exige uma ponderação consciente, em vez de otimizar cegamente uma única métrica.

Não. A pontuação F1 é útil para comparação, mas esconde o equilíbrio entre precisão e recall. Dois modelos com a mesma pontuação F1 podem se comportar de maneira muito diferente na prática. Sempre analise a precisão e o recall separadamente antes de tomar decisões.

A precisão deve ser verificada regularmente após a implementação, e não apenas uma vez. A frequência ideal depende da rapidez com que os dados mudam, mas qualquer sistema exposto a novos ambientes, estações do ano ou hardware deve ser monitorado continuamente. A deriva lenta do desempenho é comum e muitas vezes passa despercebida sem o acompanhamento das tendências.