O OpenClaw não é apenas mais uma interface de chat com um nome bonito. Ele se assemelha mais a uma camada de controle para agentes de IA que podem ler arquivos, acionar ferramentas e responder dentro dos aplicativos que você já usa. Esse poder é o seu principal diferencial. É também por isso que você não deve tratá-lo com leviandade. Se você o encarar como um ChatGPT com um logotipo diferente, perderá o que o torna útil. Se o encarar como infraestrutura, você obterá vantagens reais.

Como o OpenClaw transforma o bate-papo em ação

O OpenClaw não é apenas uma interface de chat com complementos. Ele funciona como um gateway local que conecta sua plataforma de chat, seu modelo de IA e sua camada de ação em um único sistema controlado. Ele se integra a ferramentas como Telegram ou Slack, conecta-se a um modelo executado localmente por meio do Ollama ou via um provedor de nuvem como OpenAI ou Anthropic, e gerencia o acesso a arquivos, APIs e execução de scripts por meio de memória local persistente. Tudo flui por meio desse único gateway.

Na prática, uma mensagem entra pelo chat, o agente a avalia, opcionalmente aciona uma ferramenta e retorna um resultado estruturado. Ele pode ler logs, resumir erros, criar tickets, atualizar registros de CRM ou executar scripts predefinidos. O contexto é mantido entre as sessões, o que transforma o OpenClaw em uma camada operacional, e não apenas em mais um assistente.

FlyPix AI e Automação de IA no Mundo Real

No FlyPix IA, Aplicamos agentes de IA em um domínio diferente, mas o princípio é semelhante. A automação só gera valor quando se conecta diretamente a dados operacionais reais. Nossa plataforma se concentra em imagens de satélite, aéreas e de drones, onde modelos de IA detectam, monitoram e inspecionam objetos em grande escala. Em vez de anotações manuais, automatizamos a análise geoespacial com modelos treinados para identificar e delimitar objetos com precisão.

Criamos o sistema para ser prático desde o início. Os usuários podem treinar modelos de IA personalizados sem conhecimento profundo de programação, definir suas próprias anotações e aplicá-los em diversos setores, como construção, agricultura, manutenção de infraestrutura e projetos governamentais. O foco não é a inteligência abstrata, mas sim a eficiência mensurável em ambientes visuais complexos.

Você também pode encontrar o FlyPix AI em LinkedIn Se você quiser se conectar conosco por lá. Para nossa empresa, IA não se trata de experimentação. Trata-se de transformar dados visuais em resultados estruturados que as equipes possam usar com confiança em operações reais.

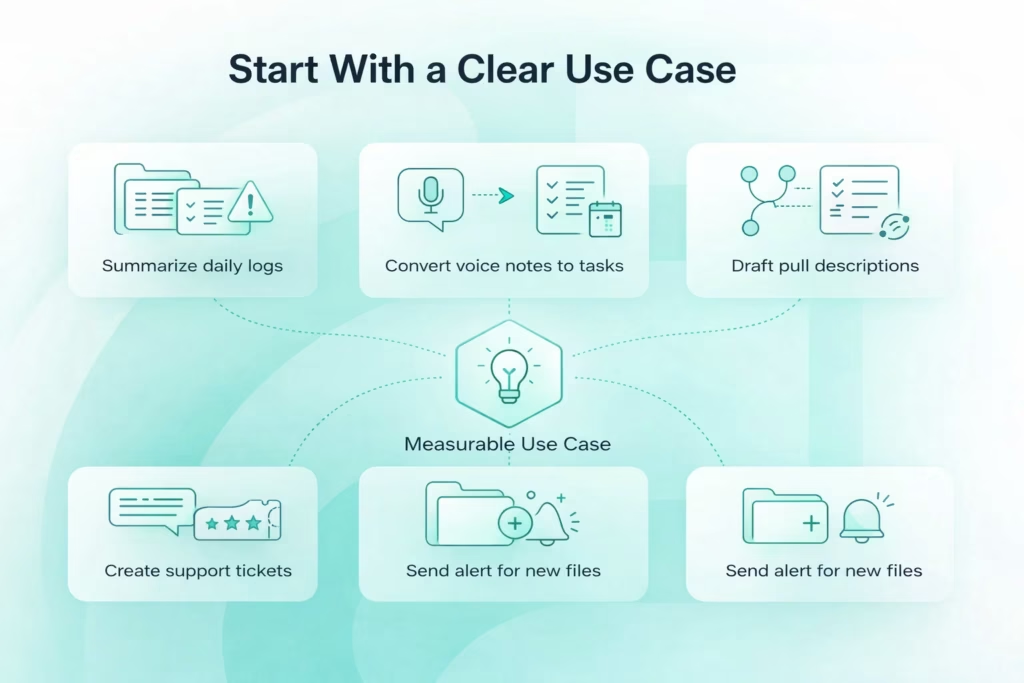

Comece com um caso de uso claro.

O maior erro que as pessoas cometem com o OpenClaw é simples: instalam primeiro e pensam depois. Quando o sistema está funcionando, mas o propósito não está claro, você acaba ajustando configurações em vez de resolver um problema real. Antes de instalar qualquer coisa, defina um caso de uso mensurável. Ele deve ser específico o suficiente para que você possa dizer claramente se funciona ou não. Objetivos iniciais fortes geralmente se parecem com isto:

- Resuma os registros diários de uma pasta específica e destaque o erro crítico mais recente.

- Converta mensagens de voz do Telegram em tarefas estruturadas com título e prazo.

- Elaborar descrições de solicitações de pull request usando o contexto do repositório e commits recentes.

- Crie tickets de suporte a partir de informações estruturadas de chat com níveis de prioridade.

- Monitore uma pasta e envie um alerta quando novos arquivos aparecerem.

Cada exemplo possui um gatilho claro, uma entrada definida e uma saída observável. Essa estrutura mantém a configuração focada e evita complexidade desnecessária. Comece com um objetivo específico. Se a meta for vago, você gastará mais tempo corrigindo a arquitetura do que criando valor. O OpenClaw funciona melhor quando vinculado a um fluxo de trabalho mensurável. Uma vez que esse ciclo esteja estável, a expansão se torna intencional em vez de experimental.

Prepare seu sistema para o OpenClaw

Uma configuração estável do OpenClaw é iniciada antes mesmo de você executar o instalador. Este não é um plugin de bate-papo leve. É um gateway local capaz de ler arquivos, executar ferramentas e conectar-se a modelos externos. Seu computador, sua rede e suas permissões fazem parte do sistema. Alguns minutos de preparação prévia evitam horas de solução de problemas posteriormente.

No mínimo, você precisa da versão LTS mais recente do Node.js, um terminal com o qual você esteja familiarizado e uma chave de API de modelo em nuvem da OpenAI ou da Anthropic, ou da Ollama, caso pretenda executar um modelo localmente. O Telegram é a interface mais simples para os primeiros testes. Se optar por executar localmente, planeje seu hardware de forma realista. Dezesseis gigabytes de RAM são uma base razoável para um desempenho estável. Modelos maiores exigirão mais.

Seu ambiente é importante. Não instale este programa indiscriminadamente em um laptop corporativo. Não exponha portas publicamente por conveniência. Evite executá-lo com privilégios elevados, a menos que seja absolutamente necessário. O OpenClaw lê arquivos locais e executa ações. Essa é a sua principal vantagem. Trate-o com o mesmo cuidado que você daria a qualquer sistema que tenha acesso direto aos seus dados.

Instalação e configuração inicial do OpenClaw

O OpenClaw evolui rapidamente, portanto, a abordagem mais segura é seguir o fluxo de instalação oficial. O objetivo aqui é simples: garantir que o gateway funcione de forma limpa e previsível. Sem experimentos, sem ajustes personalizados por enquanto. Apenas uma base sólida.

1. Escolha o seu método de instalação

Dependendo da distribuição atual, você instalará o OpenClaw por meio de um script de inicialização ou via npm. Ambos os métodos visam o mesmo resultado: instalar as dependências e registrar o serviço de gateway. O fluxo de inicialização típico é o seguinte:

| curl -fsSL https://openclaw.ai/install.sh | bash |

Se você preferir o npm, o caminho de instalação global é simples:

| npm install -g openclaw@latest |

Nenhum dos métodos deve parecer complicado. Se a instalação apresentar erros, pare e resolva-os antes de prosseguir. Uma instalação limpa é mais importante do que a velocidade.

2. Execute o processo de integração.

Após a instalação, execute o assistente de integração:

| Openclaw a bordo |

Esta etapa configura o gateway e o instala como um serviço em segundo plano. Após a conclusão, o sistema deverá informar que o gateway está ativo. Neste ponto, o OpenClaw não está apenas instalado, mas também operacional.

3. Acesse a interface de controle.

Por padrão, a interface de controle (painel de controle) é executada localmente em:

| http://127.0.0.1:18789/ (ou http://localhost:18789/) |

Abra esse endereço no seu navegador. Se tudo estiver configurado corretamente, você deverá ver o painel de controle. Caso não carregue, verifique o seguinte:

- Confirme se o serviço de gateway está em execução.

- Verifique se nenhum outro processo está usando a porta 18789.

- Verifique as configurações do firewall local.

Uma regra importante: mantenha o gateway vinculado ao localhost. Não o exponha publicamente. A interface de controle gerencia um agente que pode acessar arquivos locais e executar ferramentas. Restringir o acesso a 127.0.0.1 mantém essa superfície de controle segura durante o desenvolvimento e os testes.

Configurando a integração com o Telegram

O Telegram é uma das maneiras mais rápidas de ativar o OpenClaw. A configuração é simples, a API é fácil de provisionar e você pode verificar todo o ciclo de mensagens em poucos minutos. É ideal para testes iniciais, quando o foco está na lógica do agente e não na complexidade da integração.

Abra o Telegram, procure por @BotFather e digite /newbot. Escolha um nome e copie o token da API fornecido. Durante a integração com o OpenClaw, cole esse token quando solicitado. Depois de salvo, o gateway conecta seu agente local ao Telegram. A precisão é fundamental aqui. Um único caractere incorreto pode interromper a conexão.

Após a configuração, envie uma mensagem de teste para o seu bot e verifique a interface de controle. Se a mensagem aparecer e uma resposta for recebida no Telegram, o loop está funcionando. Isso confirma que o gateway, o modelo e a camada de comunicação estão funcionando em conjunto. A partir daqui, você passa da configuração para a criação de fluxos de trabalho reais.

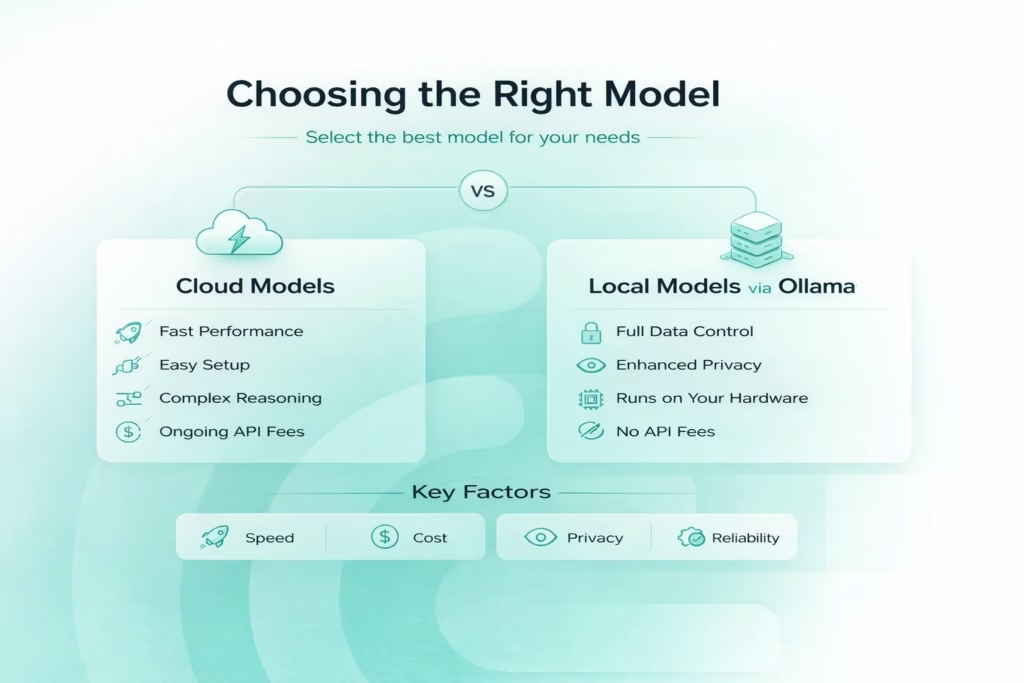

Como escolher o modelo certo

A escolha do modelo afeta diretamente a velocidade, o custo, a privacidade e a confiabilidade geral. O OpenClaw não o prende a um único fornecedor, o que é uma grande vantagem. Mas a flexibilidade só é útil se você entender as vantagens e desvantagens. Existem dois caminhos principais: modelos em nuvem e modelos locais. Cada um atende a uma necessidade operacional diferente.

1. Modelos em Nuvem – Rápidos, Poderosos e com Pouco Atrito

Os modelos em nuvem são a maneira mais rápida de obter um desempenho de raciocínio robusto sem se preocupar com o hardware. Você conecta uma chave de API, configura o provedor e o agente está pronto. Os modelos em nuvem são geralmente mais adequados para:

- Raciocínio complexo e tomada de decisão estruturada

- Fluxos de trabalho de codificação e depuração

- Configuração rápida com configuração mínima

- Equipes que não desejam gerenciar a infraestrutura

Modelos como o Claude 3.5 Sonnet e os sistemas de classes GPT-4 lidam com fluxos de trabalho ágeis com alta confiabilidade. Eles interpretam instruções com clareza, gerenciam bem o raciocínio em várias etapas e respondem rapidamente. As vantagens e desvantagens são claras:

- Custos contínuos da API

- Os dados são transmitidos para fora do seu ambiente local.

- Dependência de disponibilidade externa

Para muitos usuários, isso é aceitável. Para outros, especialmente em ambientes sensíveis, pode não ser.

2. Modelos locais via Ollama – Controle e contenção

Se privacidade e autonomia são importantes, executar um modelo local por meio do Ollama é uma escolha lógica. Nessa configuração, o modelo permanece em sua máquina. Sem chamadas de API externas. Nenhum dado sai da sua rede. É ideal para:

- Fluxos de trabalho sensíveis a dados

- Ambientes de desenvolvimento

- Capacidade offline

- Controle total sobre a execução.

O Ollama suporta modelos como o Qwen2.5-Coder, a série GLM-4, variantes do Llama 3.1/3.2 e outros modelos com grandes janelas de contexto adequadas para agentes. Para o OpenClaw, o tamanho do contexto é importante.

O agente depende da janela de contexto do modelo para gerenciar a memória, portanto, janelas menores podem reduzir a consistência em sessões mais longas. Uma janela de contexto de 32k a 128k é uma base prática para um raciocínio estável (dependendo do modelo; muitos modelos Ollama recomendados para OpenClaw começam com 32k a 128k).

O desempenho está diretamente ligado ao seu hardware. Se as respostas ficarem lentas ou as chamadas de ferramentas apresentarem atrasos, geralmente é uma questão de recursos limitados, e não um erro de configuração. A chave é escolher um modelo que se adeque à sua memória e capacidade de processamento disponíveis.

3. Fazendo a escolha prática

Não existe uma resposta universal. Algumas equipes usam modelos em nuvem para raciocínio complexo e modelos locais para desenvolvimento ou tarefas sensíveis. Outras se dedicam completamente a uma única abordagem. Escolha com base em:

- Sensibilidade dos seus dados

- Requisitos de desempenho

- Restrições orçamentárias

- Capacidade de hardware

O modelo correto não apenas melhora as respostas, como também estabiliza todo o fluxo de trabalho. Quando a camada de modelagem está alinhada às suas necessidades operacionais, o OpenClaw funciona de forma previsível e eficiente.

Entendendo a memória persistente

A memória persistente é um dos recursos que diferencia o OpenClaw de um assistente de bate-papo típico. Em vez de começar do zero a cada interação, ele armazena dados persistentes localmente, usando SQLite para indexação, arquivos Markdown fragmentados como fonte de verdade e busca híbrida (BM25 + embeddings vetoriais). Isso é mais do que um registro de bate-papo. É um contexto organizado que o agente pode consultar posteriormente para tomar decisões.

Por exemplo, você pode dizer ao agente: “Meu painel interno usa React e Tailwind. Prefira componentes funcionais.” Alguns dias depois, você pede para ele criar um componente de cabeçalho. Se a memória estiver funcionando corretamente, ele seguirá essas preferências anteriores sem que você precise repeti-las. Essa continuidade vem do contexto armazenado que é realimentado no processo de raciocínio.

É aqui que a eficiência aumenta com o tempo. Em vez de reescrever instruções a cada sessão, você acumula um contexto duradouro dentro do sistema. Vale a pena revisar a memória armazenada ocasionalmente para ver o que está sendo salvo. Quando você entende como a memória funciona, mantém o agente consistente e previsível à medida que seus fluxos de trabalho se expandem.

Criando seu primeiro fluxo de trabalho real

Assim que a conexão estiver estável, é hora de passar da conversa para a execução. O OpenClaw torna-se prático quando executa tarefas estruturadas, e não apenas responde a perguntas abertas. Isso requer a definição clara de um fluxo de trabalho, para que o agente saiba o que fazer e como confirmar o resultado. Um fluxo de trabalho confiável sempre inclui quatro componentes:

- Acionar: O comando ou evento específico que ativa o processo, como digitar “novo ticket” no Telegram.

- Estrutura de entrada: Os dados exatos que o agente precisa para concluir a tarefa, por exemplo, título, descrição e nível de urgência.

- Execução da ferramenta: A ação definida executada pelo agente, como o envio de uma solicitação para a API do seu sistema de emissão de tickets.

- Saída de confirmação: Uma resposta estruturada que comprove a conclusão do processo, como o envio do número do ticket e um breve resumo.

Considere a automação de tickets como um exemplo simples. Ao digitar "novo ticket", o agente deve coletar os campos obrigatórios, chamar a API e retornar uma confirmação. Sem palpites, sem suposições. Gatilhos claros e entradas estruturadas mantêm o processo confiável. Comece com um fluxo de trabalho focado, estabilize-o e, em seguida, expanda-o de forma gradual.

Operando o OpenClaw em Ambientes Reais

Assim que seu primeiro fluxo de trabalho estiver estável, o uso real começa. É nesse ponto que o OpenClaw se torna parte das suas operações diárias ou permanece como um experimento técnico. A diferença não está em adicionar mais automações, mas sim em observar como o processo existente se comporta em condições reais. Deixe-o rodar. Teste-o com diferentes entradas. Observe como ele lida com casos extremos antes de expandir ainda mais.

No uso diário, a visibilidade é fundamental. Analise a atividade na interface de controle. Verifique quais ferramentas estão sendo acionadas e como os resultados estão estruturados. Se os resultados parecerem inconsistentes, a causa geralmente é o desvio de escopo ou instruções pouco claras, e não limitações do modelo. Pequenos ajustes na estrutura costumam gerar mais estabilidade do que alterar o próprio modelo.

A expansão deve ser deliberada. Adicione novas tarefas gradualmente e isole-as dos processos existentes até que se tornem previsíveis. O OpenClaw tem o melhor desempenho quando os fluxos de trabalho são claramente delimitados e a memória permanece relevante. O uso diário não se trata de experimentação constante, mas sim de escalabilidade controlada de um sistema de IA que você entende e pode gerenciar com confiança.

Conselhos práticos e erros comuns a evitar.

O OpenClaw pode funcionar sem problemas durante meses, ou pode se transformar em um exercício constante de solução de problemas. A diferença geralmente reside na disciplina. A maioria dos problemas não vem do modelo em si, mas sim de decisões de configuração, escopo pouco claro ou limites negligenciados. Abaixo estão as armadilhas e os hábitos de desempenho mais comuns que diferenciam implantações estáveis de instáveis.

Erros operacionais a evitar

Esses são padrões observados repetidamente em implantações reais. Eles podem não quebrar o sistema imediatamente, mas criam riscos e instabilidade ao longo do tempo.

- Instalação em dispositivo corporativo sem autorização: O OpenClaw lê arquivos locais e pode enviar dados para modelos externos, o que pode violar as políticas internas.

- Inserir código proprietário em modelos de nuvem sem revisão: A transmissão de dados sensíveis por meio de APIs pode gerar preocupações com relação à conformidade e à segurança.

- Conceder acesso irrestrito ao sistema de arquivos: O agente não deve ter acesso a toda a sua lista telefônica residencial, a menos que seja absolutamente necessário.

- Expondo a porta do gateway para maior conveniência: Abrir a porta 18789 publicamente aumenta a superfície de ataque sem trazer benefícios reais.

- Tratar a memória como infalível: A memória persistente é poderosa, mas pode armazenar contexto desatualizado ou incorreto se não for revisada.

- Complicar demais o primeiro fluxo de trabalho: Começar com uma automação de várias etapas em vez de uma tarefa simples aumenta os erros de configuração.

O princípio orientador é simples: manter o escopo restrito, limitar as permissões e expandir gradualmente assim que a estabilidade for comprovada.

Otimização de desempenho e estabilidade

Se o desempenho parecer inconsistente, a causa geralmente é estrutural e não misteriosa. O OpenClaw depende da capacidade do modelo, do gerenciamento de memória e da clareza dos comandos. Pequenos ajustes geralmente fazem uma diferença perceptível.

- Reduza o tamanho do modelo ao executar localmente: Modelos maiores exigem mais memória e poder de processamento, o que aumenta a latência.

- Aumente a quantidade de RAM disponível, se possível: O raciocínio local melhora quando o sistema tem margem de segurança suficiente.

- Limpar o excesso de memória acumulada: Sessões de longa duração com grande quantidade de contexto armazenado podem tornar o processamento mais lento.

- Limitar os loops de invocação de ferramentas: Chamadas de ferramentas repetidas ou aninhadas podem causar atrasos desnecessários.

- Use instruções estruturadas em vez de instruções abertas: A entrada de dados clara reduz o uso de tokens e melhora a precisão das respostas.

O desempenho melhora quando as instruções são delimitadas e os recursos são alinhados à carga de trabalho. O OpenClaw não exige ajustes constantes. Ele requer configuração deliberada e expectativas realistas. Quando esses elementos estão presentes, o sistema permanece eficiente e previsível.

Conclusão

O OpenClaw se torna poderoso no momento em que você para de tratá-lo como um chatbot e começa a tratá-lo como infraestrutura. Não se trata de respostas inteligentes, mas sim de execução controlada. Quando você define um objetivo claro, configura o gateway corretamente, escolhe o modelo certo e estrutura seu primeiro fluxo de trabalho com cuidado, o sistema começa a parecer menos experimental e mais operacional.

A chave é a disciplina. Mantenha o escopo restrito inicialmente. Proteja seu ambiente. Crie um fluxo de trabalho confiável e, em seguida, expanda. O OpenClaw valoriza a clareza. Quanto mais claras forem suas entradas e permissões, mais previsíveis serão os resultados. Usado corretamente, ele não é apenas uma camada de mensagens com ferramentas acopladas. É uma camada de execução de IA controlável que pode ser integrada ao trabalho real. É aí que ele agrega valor.

Perguntas frequentes

A instalação em si é simples se você seguir as instruções oficiais. A maior parte das dificuldades surge de objetivos pouco claros, e não de complexidade técnica. Se você definir um fluxo de trabalho específico antes da instalação, a configuração se torna muito mais tranquila.

Sim, se você usar um modelo local por meio do Ollama. Nessa configuração, o modelo e o gateway são executados na sua máquina. Não são necessárias chamadas de API externas. Lembre-se de que o desempenho depende da capacidade do seu hardware.

Isso depende das políticas da sua organização. O OpenClaw pode ler arquivos locais e interagir com modelos externos. Instalá-lo em um dispositivo corporativo sem aprovação pode violar as normas de segurança internas. É melhor usar uma máquina pessoal ou um ambiente dedicado.

Comece com algo mensurável e de baixo risco, como resumir logs, redigir mensagens estruturadas ou criar tickets. Evite automações complexas com várias etapas no início. A estabilidade é mais importante do que a ambição nesta fase.

A memória persistente permite que o agente retenha o contexto entre sessões, o que melhora a continuidade. No entanto, janelas de contexto maiores e sessões longas podem aumentar o uso de recursos, especialmente com modelos locais. Revisar a memória armazenada periodicamente ajuda a manter a clareza e a eficiência.