O OpenClaw é uma ferramenta de código aberto que permite transformar um modelo de linguagem poderoso em um assistente pessoal que realmente realiza tarefas. Você conversa com ele no WhatsApp, Telegram, Discord, Slack ou aplicativos similares, e ele pode ler e enviar e-mails, gerenciar sua agenda, navegar na web, trabalhar com arquivos, executar scripts simples – basicamente, agir como um colega de trabalho prestativo que nunca dorme.

O mais importante é qual modelo de IA você conecta ao OpenClaw. O OpenClaw em si é apenas o mensageiro e o executor. O verdadeiro raciocínio, a memorização e a tomada de decisões acontecem dentro do modelo que você escolher. Escolha o modelo errado e as coisas podem dar errado, custar muito caro ou se tornarem inseguras. Escolha um modelo adequado e a experiência será fluida e confiável.

Por que a escolha do modelo muda tudo

Cada vez que você dá um comando ao OpenClaw, ele envia todo o histórico da conversa até o momento para o modelo – às vezes centenas de milhares de palavras se o bate-papo estiver acontecendo há dias. O modelo precisa entender tudo isso, lembrar o que foi dito anteriormente, descobrir o que fazer em seguida e escrever instruções muito precisas (chamadas de chamadas de ferramenta) para que o OpenClaw saiba qual botão pressionar ou qual e-mail enviar.

Se o modelo começar a esquecer detalhes de mensagens anteriores (mesmo que apenas dez mensagens atrás), ele rapidamente começará a cometer erros e a interromper a conversa. Se ele bagunçar a formatação ou a lógica das chamadas de ferramentas, as ações falharão completamente ou acabarão atingindo o alvo errado — e-mail errado enviado, evento de calendário alterado errado, arquivo acessado errado. E se o modelo for facilmente enganado por palavras ardilosas escondidas em um e-mail recebido ou em uma página da web que ele navega, um comando malicioso pode induzir seu assistente a executar comandos prejudiciais ou vazar informações confidenciais.

Portanto, o modelo não é simplesmente “inteligente ou não inteligente”. Ele precisa ser bom em três coisas principais para o OpenClaw:

- Manter uma memória longa sem se confundir

- seguir as instruções com muita precisão

- chamar ferramentas (funções) corretamente todas as vezes

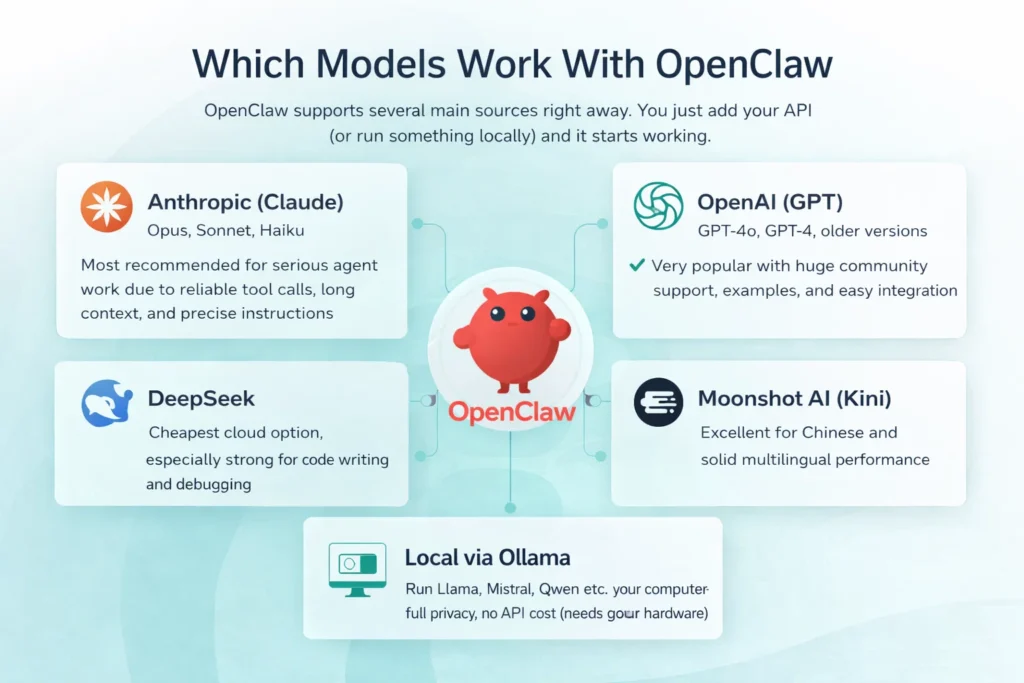

Quais modelos funcionam com o Openclaw?

O OpenClaw oferece suporte imediato a diversas fontes principais. Basta adicionar sua chave de API (ou executar algo localmente) e ele começará a funcionar.

- Antrópico (Claude)Opus, Sonnet, Haiku – altamente recomendados para trabalhos sérios com agentes devido às chamadas de ferramentas confiáveis, contexto extenso e instruções precisas.

- OpenAI (GPT)GPT-4o, GPT-4 e versões mais antigas são muito populares, contam com amplo suporte da comunidade, exemplos e fácil integração.

- DeepSeekOpção de nuvem mais barata, especialmente adequada para escrita e depuração de código.

- IA Moonshot (Kimi)Excelente para chinês e com sólido desempenho multilíngue.

- Local via OllamaExecute Llama, Mistral, Qwen etc. no seu computador – privacidade total, sem custo de API (requer hardware de boa qualidade).

FlyPix AI + OpenClaw: Mais tempo para decisões, menos trabalho manual

No FlyPix IA Somos especialistas em automatizar análises geoespaciais a partir de imagens de satélite, drones e aéreas. Detectamos objetos, contamos seus valores, medimos áreas, rastreamos mudanças ao longo do tempo e entregamos relatórios e mapas claros. Isso auxilia nossos clientes em monitoramento de obras, agricultura, avaliações ambientais, inspeção de infraestrutura e planejamento urbano.

Nossa plataforma economiza até 99,71 TP3T do tempo anteriormente gasto em tarefas manuais de SIG. Não são mais necessários softwares caros ou analistas especializados – nossa interface sem código permite que qualquer equipe crie modelos personalizados para seus objetos específicos.

Sabemos que, mesmo após a conclusão da análise, ainda resta uma quantidade significativa de trabalho administrativo: redigir relatórios, organizar arquivos de imagem e resultados, agendar revisões de acompanhamento ou visitas de campo, classificar e-mails com novos dados e preparar atualizações para as partes interessadas.

É exatamente por isso que vemos o OpenClaw como um complemento natural e poderoso.

Nossos clientes podem executar um assistente de IA local e gratuito (por exemplo, com o Ollama) que mantém o mais alto nível de privacidade de dados e funciona offline – algo essencial ao lidar com imagens sensíveis. O OpenClaw cuida de todas as tarefas subsequentes automaticamente: elabora relatórios a partir dos resultados de nossas análises, organiza arquivos por projeto ou data, gerencia calendários, pesquisa regulamentações ou estudos relevantes e envia resumos rápidos.

Modelos GPT: Flexíveis e Familiares

Os modelos GPT da OpenAI continuam sendo uma escolha muito sólida e amplamente utilizada para o OpenClaw, especialmente entre pessoas que já estão familiarizadas com o ecossistema da OpenAI.

Esses modelos têm um desempenho especialmente bom quando você precisa de respostas rápidas para perguntas simples ou diretas, quando você está frequentemente gerando código ou scripts e requer uma saída estruturada e organizada, como listas, tabelas ou JSON, ou quando você deseja aproveitar a enorme coleção de exemplos, bibliotecas, tutoriais e ferramentas criadas pela comunidade que existem em torno das APIs da OpenAI.

Em comparação com os modelos Claude mais recentes, as variantes do GPT podem, por vezes, apresentar uma ligeira perda de consistência durante conversas muito longas ou quando é necessário um processo extremamente rigoroso de chamadas de ferramentas em várias etapas. No entanto, a diferença prática permanece pequena para a maioria dos fluxos de trabalho do dia a dia. Se você já possui uma assinatura da OpenAI, tem acesso a créditos gratuitos ou simplesmente valoriza a velocidade e a familiaridade geral, o GPT-4o (ou uma variante similar) tende a ser o ponto de partida mais fácil e prático. Muitos usuários do OpenClaw começam com o GPT devido à sua acessibilidade e só migram para o Claude posteriormente, quando se deparam com tarefas que exigem um raciocínio mais preciso ou mecanismos de segurança integrados mais robustos.

Claude: A escolha séria mais comum

Os modelos Claude da Anthropic são a escolha mais popular entre os usuários mais experientes do OpenClaw, pois são projetados para serem cuidadosos, lógicos e excelentes em seguir instruções longas e detalhadas.

- Nível superior (nível Opus)Ideal para lidar com dados sensíveis (financeiros, de saúde, jurídicos, informações privadas), fluxos de trabalho complexos com várias etapas ou quando a segurança é fundamental (forte resistência a injeções e tentativas de manipulação).

- Nível intermediário (nível de soneto): o que a maioria das pessoas usa diariamente: lida com e-mails, calendário, buscas na web e automações padrão de forma confiável, com um ótimo equilíbrio entre qualidade e custo e respostas suficientemente rápidas.

- Nível leve (nível Haiku)Barato e muito rápido, mas adequado apenas para comandos simples, de uma única etapa, onde erros ocasionais não importam muito.

É por isso que o Claude muitas vezes se torna a opção padrão ou a principal recomendação – ele atende melhor às necessidades do OpenClaw em termos de confiabilidade, contexto extenso e uso seguro de ferramentas do que a maioria das alternativas.

Deepseek: Quando você quer gastar quase nada

Os modelos DeepSeek são populares entre os usuários do OpenClaw que priorizam os custos mais baixos possíveis. Eles custam uma fração do Claude ou do GPT e ainda lidam com tarefas básicas a moderadas de forma eficaz.

São ideais para:

- Classificar e responder a e-mails simples.

- Alterações básicas no calendário (adicionar, verificar, mover eventos)

- Ajuda rápida com código, pequenos scripts, depuração de rotina.

- Automações simples sem planejamento complexo

Para uso diário leve a moderado (20 a 50 interações), eles geralmente custam de 5 a 20 vezes menos do que os modelos premium, mantendo-se adequados para trabalhos não críticos.

As concessões são reais:

- Apresenta menor capacidade de concentração em conversas longas (esquece detalhes mais rapidamente).

- Dificuldades com fluxos de trabalho complexos de várias etapas

- Menos preciso em tarefas de alto risco (finanças, jurídico, comunicação com clientes)

- Menor resistência à injeção imediata do que Claude.

Melhor ajusteOrçamento apertado, tarefas predominantemente simples/médias, e você aceita um nível de confiabilidade um pouco menor em tarefas mais complexas.

Muitos usuários executam o DeepSeek para tarefas rotineiras (80–90%) e alternam para modelos mais robustos apenas em casos sensíveis ou complexos – isso mantém os custos muito baixos, ao mesmo tempo que cobre o que é importante.

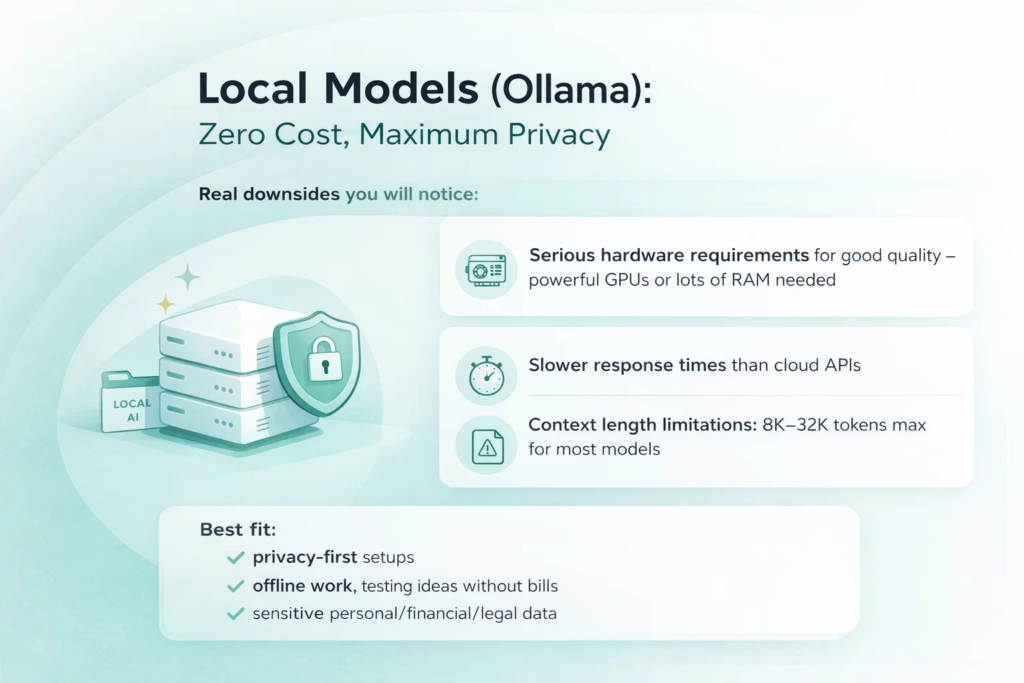

Modelos locais (Ollama): Custo zero, privacidade máxima

Se você não quer ter a mínima chance de seus dados saírem da sua máquina, os modelos locais via Ollama são a única maneira realmente eficaz. Você baixa um modelo openweight, executa-o no seu próprio hardware e o OpenClaw se comunica diretamente com ele por meio de um servidor local – sem chaves de API, sem provedor de nuvem, sem registros em nenhum outro lugar.

Modelos maiores (com cerca de 70 bilhões de parâmetros, como o Llama 3.1 70B, o Qwen 2.5 72B ou variantes do Mistral) podem oferecer desempenho surpreendentemente próximo ao de modelos de nuvem de nível intermediário em muitas tarefas do OpenClaw – gerenciamento de e-mails, gerenciamento de calendários, pesquisa básica na web e auxílio simples em código. Em uma máquina com hardware potente (48 GB ou mais de RAM, boa GPU ou memória unificada no Apple Silicon), eles se mostram bastante adequados para o trabalho diário.

Os modelos menores (7B–13B, como o Llama 3.1 8B, o Phi-3 Mini e o Mistral 7B) funcionam bem até mesmo em laptops comuns com 16 a 32 GB de RAM. São rápidos e baratos de operar, mas claramente mais fracos: têm dificuldades com raciocínio de várias etapas, esquecem o contexto rapidamente e cometem mais erros em tarefas complexas.

Desvantagens reais que você notará:

- Os requisitos de hardware são rigorosos para garantir boa qualidade – modelos maiores precisam de GPUs potentes ou muita RAM; sem isso, tudo fica drasticamente mais lento.

- Os tempos de resposta costumam ser mais lentos do que os das APIs em nuvem (segundos a mais por resposta, às vezes muito mais longos em máquinas menos potentes).

- O comprimento do contexto é limitado – a maioria dos modelos locais tem um limite de 8 a 32 mil tokens (alguns mais recentes chegam a valores maiores com alguns truques), enquanto as sessões do OpenClaw geralmente ultrapassam esse limite, fazendo com que o agente comece a perder detalhes anteriores.

Melhor ajusteConfigurações que priorizam a privacidade, trabalho offline, teste de ideias sem custos adicionais ou quando você está processando dados pessoais/financeiros/jurídicos sensíveis que não confia a nenhum serviço em nuvem.

Qual o custo mensal de cada modelo com o OpenClaw?

Os custos mensais dependem do modelo e do nível de utilização. O OpenClaw envia o histórico completo da conversa a cada interação, portanto, chats mais longos e tarefas frequentes aumentam rapidamente o consumo de tokens. O uso leve corresponde a cerca de 10 a 15 tarefas por dia, o uso moderado a 30 a 50 e o uso intenso a mais de 100 (agente sempre ativo).

Custos mensais aproximados com base em padrões reais de utilização:

- Claude de primeira linha (nível Opus): leve $80–150, moderado $200–400, pesado $500–750+

- Claude de nível intermediário (nível de soneto): leve $15–30, moderado $40–80, grave $100–200

- GPT-4o (OpenAI): leve $12–25, moderado $30–60, grave $80–150

- DeepSeek ou Claude leve (nível Haiku): leve a moderado $5–15 ou menos, grave geralmente abaixo de $30

- Modelos locais via OllamaCusto da API $0 (apenas eletricidade e hardware)

Os valores reais variam de acordo com a duração da sessão, as chamadas de ferramentas e a eficiência das solicitações. Monitore o uso no painel do OpenClaw ou no console do provedor por uma semana para ver seus gastos reais. Escolher o plano certo para sua carga de trabalho gera a maior economia.

Guia rápido: Qual modelo usar para cada tarefa no OpenClaw

| Tarefa/Caso de Uso | Modelo(s) recomendado(s) | Por que este modelo é o mais adequado? |

| Assistente para uso diário (e-mail, calendário, mensagens, pesquisa rápida) | Nível Claude Médio (nível de soneto) ou GPT-4o | Confiável para tarefas diárias, bom equilíbrio entre velocidade e custo, lida bem com contexto e ferramentas. |

| Programação complexa, criação/revisão de scripts, automações que precisam funcionar de primeira. | Claude forte (nível Opus) ou GPT forte | Raciocínio superior, código preciso, menos erros em lógica complexa e depuração. |

| Leitura de documentos extensos, resumo de grandes relatórios, análise aprofundada. | Claude (qualquer nível, de preferência médio/superior) ou Gemini (se disponível) | Excelente capacidade de lidar com contextos longos e extração/sumarização estruturada. |

| Trabalho superprivado – nenhum dado sai do seu dispositivo. | Modelo local grande via Ollama (ex: Llama 70B, Qwen, Mistral) | Todo o processamento permanece no seu hardware, total privacidade, sem chamadas de API. |

| Orçamento muito apertado, apenas tarefas básicas/simples. | DeepSeek ou modelo local pequeno | Custo extremamente baixo (ou gratuito), ainda assim adequado para comandos simples e automações básicas. |

| Muito trabalho em chinês ou em vários idiomas que não sejam o inglês. | Kimi (IA do Projeto Moonshot) ou GPT-4o | Excelente desempenho multilíngue, com fluência e precisão especialmente comprovadas em chinês. |

O que realmente importa ao comparar modelos para Openclaw?

Aqui estão os principais aspectos que as pessoas realmente verificam na prática ao escolher um modelo para o OpenClaw:

- Com que precisão e confiabilidade ele realiza chamadas de ferramentas, sem erros de formato ou lógica?

- Quão bem ele mantém um longo histórico de conversas sem esquecer ou misturar detalhes anteriores?

- O quão rigorosamente ele segue suas instruções exatas, sem adicionar, pular ou alterar nada.

- Quão eficazmente divide tarefas complexas em etapas pequenas, seguras e corretas?

- A rapidez com que responde (faz com que o chat pareça natural em vez de lento)

- Qual o custo mensal para o seu consumo diário normal?

Concluindo

Não existe um modelo "ideal" único para o OpenClaw. Depende do que você faz com mais frequência, de quanto você pode investir e se a privacidade ou a velocidade são mais importantes para você.

Os modelos de Claude (especialmente o do meio) ainda são a opção mais segura para a maioria das pessoas que desejam um comportamento confiável do agente sem correções constantes.

Os modelos GPT são ótimos se você já faz parte do universo OpenAI ou precisa de respostas criativas rápidas.

DeepSeek permite economizar muito dinheiro quando a qualidade não precisa ser perfeita.

Os modelos locais oferecem controle total e custo contínuo zero – desde que você tenha o hardware.

Comece com o que for mais fácil de configurar (geralmente Claude Sonnet ou GPT-4o), use-o por uma semana, veja o que te incomoda e depois tente outra coisa. O OpenClaw facilita a troca, então você não fica preso a um único programa.

Perguntas frequentes

Comece com a fonte Claude Sonnet (versão intermediária). Ela é confiável, lida bem com a maioria das tarefas diárias e existem muitos guias disponíveis para ela.

Sim. Você pode alternar entre os modelos a qualquer momento ou definir modelos diferentes para tarefas/agentes diferentes na configuração.

Para tarefas simples ou privadas, sim, especialmente as mais complexas e que exigem hardware potente. Para conversas longas e complexas ou que exigem alta segurança, os modelos em nuvem costumam ser mais adequados.

É muito bom em seguir instruções à risca, lembrar-se de conversas longas e acionar ferramentas corretamente. Isso reduz falhas de automação e riscos de segurança.

Sim, se suas tarefas forem de nível básico a médio e você não se importar com uma confiabilidade um pouco menor em tarefas mais complexas. É uma das maneiras mais baratas de obter resultados decentes.

Sim. Modelos mais difíceis de enganar e que seguem regras à risca tornam todo o sistema mais seguro, especialmente ao ler e-mails ou sites aleatórios.

Analise a quantidade de mensagens que você envia diariamente. Para uso leve, quase qualquer modelo é barato. Para uso intenso, modelos mais baratos (DeepSeek, Haiku, locais) são os que geram maior economia. Verifique o consumo de tokens no painel de controle após uma semana.