O reconhecimento de imagens parece complexo, mas a ideia central é surpreendentemente simples. Uma máquina analisa imagens como dados, aprende padrões a partir de exemplos e usa essa experiência para reconhecer o que vê na próxima vez. O verdadeiro desafio reside em como esses exemplos são preparados, como o modelo aprende com eles e quão bem esse aprendizado se mantém fora de um ambiente de laboratório.

Neste artigo, vamos analisar passo a passo como funciona o reconhecimento de imagens em aprendizado de máquina. Sem matemática complexa, sem jargões desnecessários. Apenas uma visão clara de como as imagens se transformam em sinais, como os modelos aprendem a interpretá-los e por que alguns sistemas têm bom desempenho em condições reais, enquanto outros falham.

O que o reconhecimento de imagem realmente significa em aprendizado de máquina

Em sua essência, o reconhecimento de imagens se baseia na classificação e identificação. Um sistema recebe uma imagem e responde a perguntas como:

- O que há nesta imagem?

- Onde se encontra um objeto específico?

- Quantos objetos estão presentes?

- Essas imagens pertencem à mesma categoria?

Em termos de aprendizado de máquina, o reconhecimento de imagens faz parte da visão computacional. A visão computacional concentra-se em ensinar máquinas a interpretar dados visuais de uma forma útil para a tomada de decisões.

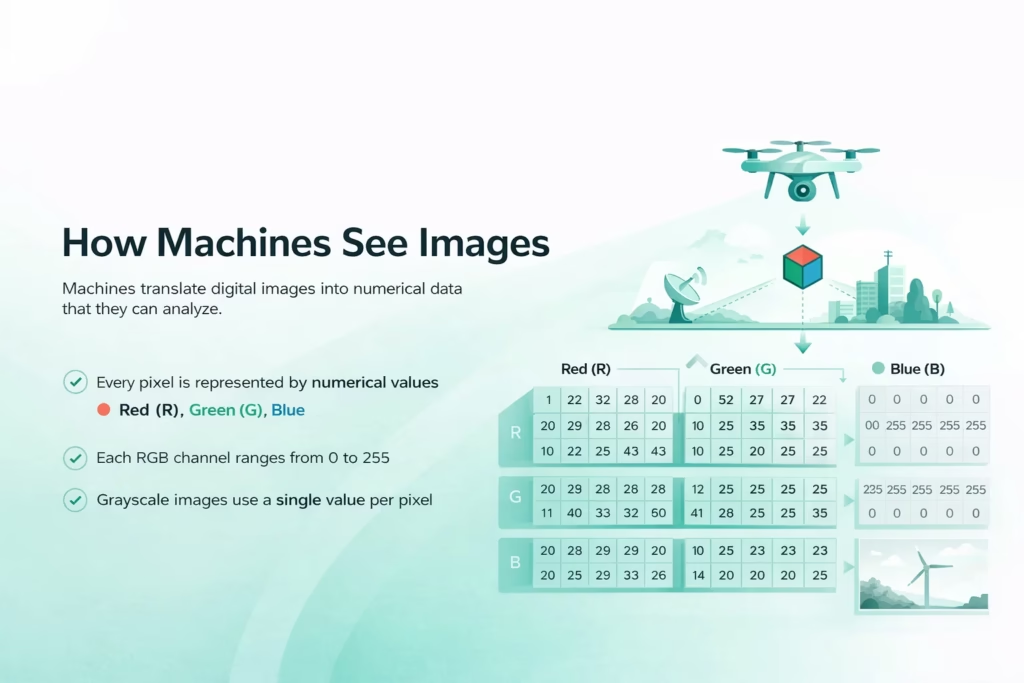

Uma distinção importante a ser feita desde o início é que as máquinas não enxergam imagens da mesma forma que os humanos. Uma pessoa vê um gato. Uma máquina vê uma grade de números. Tudo o que se segue no reconhecimento de imagens existe para preencher essa lacuna.

Como as máquinas veem imagens

Antes que qualquer aprendizado ocorra, uma imagem precisa ser traduzida para um formato que uma máquina possa processar. Imagens digitais são compostas de pixels. Cada pixel contém valores numéricos que descrevem a intensidade da cor.

Em uma imagem RGB padrão, cada pixel contém três valores:

- Vermelho

- Verde

- Azul

Cada valor normalmente varia de 0 a 255. Um pixel preto é representado por zeros. Um pixel branco usa os valores máximos. Uma imagem completa é simplesmente uma grande matriz desses números.

As imagens em tons de cinza simplificam isso usando um único valor por pixel, o que reduz a complexidade e geralmente é suficiente para tarefas que dependem de forma ou contraste, em vez de cor.

Nessa fase, a imagem não tem significado. São apenas dados. Toda a função do reconhecimento de imagem é aprender quais padrões nesses dados são relevantes.

O papel dos dados no reconhecimento de imagens

Um bom sistema de reconhecimento de imagens começa com bons dados. É aqui que muitos projetos têm sucesso ou fracassam, muito antes de qualquer modelo ser treinado. Mesmo algoritmos robustos encontram dificuldades quando as imagens subjacentes não refletem as condições reais de operação.

Coleta de dados

O conjunto de dados precisa refletir as condições que o modelo enfrentará após a implantação. Imagens capturadas em ambientes controlados raramente correspondem à variabilidade do mundo real. A iluminação muda. Os ângulos se alteram. Os objetos se sobrepõem. A resolução varia.

Um conjunto de dados útil inclui

- Pontos de vista diferentes

- Variações na iluminação

- Fundos realistas

- Exemplos imperfeitos ou ruidosos

Se um modelo for treinado apenas com imagens limpas e ideais, provavelmente terá um desempenho ruim em cenários práticos onde as condições são imprevisíveis.

Rotulagem e Anotação

Para o aprendizado supervisionado, as imagens precisam ser rotuladas. Os rótulos informam ao modelo o que ele deve aprender. Isso pode ser tão simples quanto atribuir um nome de categoria ou tão detalhado quanto definir os limites exatos dos objetos no nível do pixel.

Tipos comuns de anotações

- Rótulos em nível de imagem para classificação

- Caixas delimitadoras para detecção de objetos

- Máscaras de pixels para segmentação

- Pontos-chave para estimativa de pose

A qualidade das anotações importa mais do que a quantidade. Rótulos inconsistentes ou imprecisos confundem o modelo e limitam sua capacidade de generalização além dos dados de treinamento.

Como utilizamos o reconhecimento de imagens na análise geoespacial na FlyPix AI

No FlyPix IA, Aplicamos reconhecimento de imagem a dados geoespaciais reais, incluindo imagens de satélite, aéreas e de drones. Esses conjuntos de dados são complexos e densos, o que torna a análise manual lenta e inconsistente. O aprendizado de máquina nos permite detectar, monitorar e inspecionar grandes áreas com precisão e em uma fração do tempo.

Nossa plataforma utiliza agentes de IA para identificar e delimitar milhares de objetos em cenas complexas. Os usuários podem treinar modelos personalizados usando suas próprias anotações, sem a necessidade de habilidades de programação ou conhecimento profundo em IA. Isso torna o reconhecimento de imagem prático para o trabalho diário, e não apenas para equipes técnicas.

Priorizamos a velocidade e a escalabilidade. Tarefas que antes levavam horas ou dias agora podem ser concluídas em segundos, ajudando as equipes a passar da análise de imagens à tomada de decisões mais rapidamente. Projetos de construção, agricultura, operações portuárias, silvicultura, infraestrutura e governamentais se beneficiam dessa abordagem.

Para nós, o reconhecimento de imagens vai além da simples detecção. Trata-se de transformar dados visuais em informações confiáveis que se mostrem válidas em condições reais.

Pré-processamento: Preparando imagens para aprendizagem

Imagens brutas raramente são usadas sem qualquer processamento. O pré-processamento melhora a consistência e ajuda os modelos a aprenderem padrões relevantes de forma mais eficiente, reduzindo a variação desnecessária antes mesmo do início do treinamento.

Esta etapa geralmente envolve redimensionar as imagens para um formato fixo, de modo que o modelo receba uma entrada uniforme, normalizar os valores dos pixels para manter as faixas numéricas estáveis, converter os espaços de cores quando a informação de cor não for essencial, reduzir o ruído causado pelos sensores ou pela compressão e recortar regiões que não contribuem com sinal útil.

A normalização desempenha um papel particularmente importante. Ao dimensionar os valores dos pixels para um intervalo consistente, o modelo evita a instabilidade numérica durante o treinamento e converge de forma mais confiável.

O aumento de dados é frequentemente aplicado em conjunto com o pré-processamento. Técnicas como rotação, inversão, zoom e ajuste de brilho introduzem variação controlada no conjunto de dados sem a necessidade de coletar novas imagens. Isso ajuda a reduzir o sobreajuste e melhora a capacidade do modelo de lidar com mudanças reais de perspectiva, iluminação e orientação.

Extração de características em aprendizado de máquina tradicional

Antes da aprendizagem profunda se tornar dominante, o reconhecimento de imagens dependia muito da extração manual de características. Os engenheiros definiam em quais características visuais o modelo deveria se concentrar.

As características típicas do trabalho artesanal incluem:

- Bordas

- Cantos

- Padrões de textura

- Gradientes

Métodos como Histograma de Gradientes Orientados, Padrões Binários Locais e Saco de Características transformaram imagens em vetores numéricos de comprimento fixo.

Essas abordagens funcionavam bem para tarefas específicas, mas exigiam um profundo conhecimento da área. Além disso, apresentavam dificuldades de adaptação quando as condições visuais mudavam. Cada novo cenário exigia ajustes manuais.

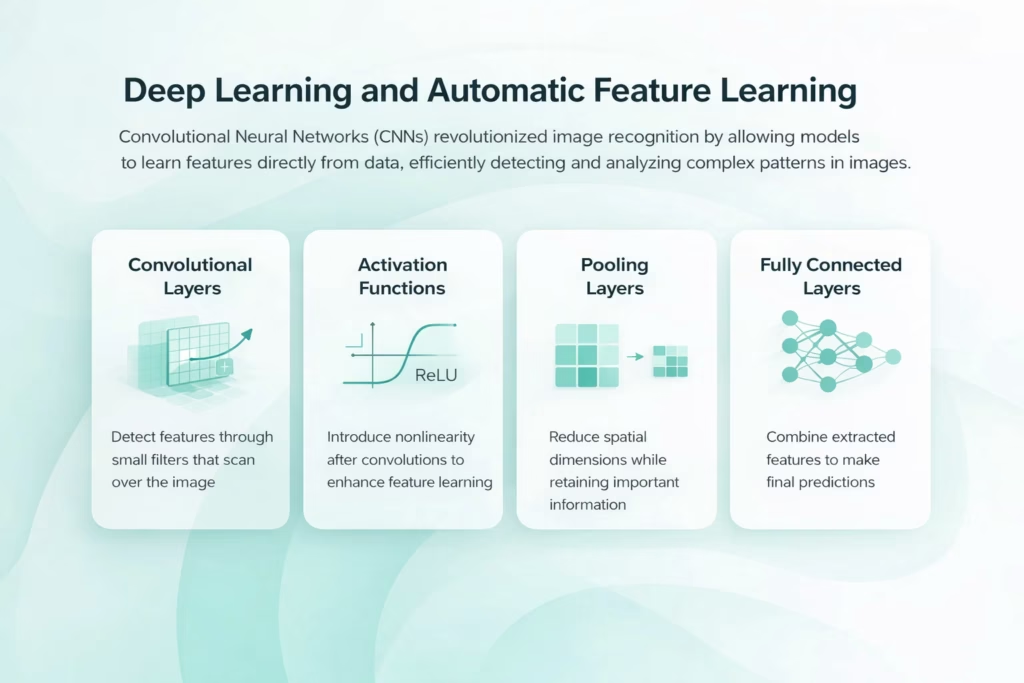

Aprendizado profundo e aprendizado automático de recursos

A aprendizagem profunda revolucionou o reconhecimento de imagens ao eliminar a necessidade de características definidas manualmente. Em vez de instruir o modelo sobre o que procurar, os engenheiros permitem que ele aprenda características diretamente a partir dos dados. As Redes Neurais Convolucionais, ou CNNs, são a espinha dorsal do reconhecimento de imagens moderno. Elas são projetadas para explorar a estrutura espacial das imagens.

Camadas Convolucionais

As camadas convolucionais aplicam pequenos filtros em uma imagem. Esses filtros respondem a padrões locais, como bordas ou texturas. As primeiras camadas detectam formas simples. As camadas mais profundas combinam essas formas em estruturas mais complexas. Essa abordagem em camadas espelha a maneira como os humanos processam informações visuais, desde linhas simples até objetos completos.

Funções de ativação

Após cada convolução, as funções de ativação introduzem não linearidade. Isso permite que a rede modele relações complexas em vez de padrões lineares simples.

Camadas de agrupamento

O agrupamento reduz as dimensões espaciais, preservando características importantes. Isso ajuda os modelos a lidar com pequenas mudanças ou distorções na posição dos objetos.

Camadas totalmente conectadas

Na parte final da rede, as características extraídas são combinadas e avaliadas para fazer previsões. Essas camadas integram informações de toda a imagem.

O Processo de Treinamento Passo a Passo

O treinamento de um modelo de reconhecimento de imagens é um processo iterativo. Envolve a exposição repetida a dados rotulados e o ajuste gradual de parâmetros internos.

1. Passe para frente

O modelo processa uma imagem e produz uma previsão.

2. Cálculo de Perdas

A previsão é comparada ao valor verdadeiro. Uma função de perda mede o quão errada a previsão está.

3. Retropropagação

O modelo ajusta seus pesos internos para reduzir o erro. Isso ocorre propagando a perda para trás através da rede.

4. Otimização

Um otimizador atualiza os parâmetros com base nos gradientes. Ao longo de várias iterações, o modelo melhora sua precisão. O treinamento continua até que o desempenho se estabilize ou atinja níveis aceitáveis nos dados de validação.

Detecção de objetos e segmentação de imagens

O reconhecimento de imagens não se limita à classificação. Em muitos cenários do mundo real, simplesmente saber que um objeto existe em uma imagem não é suficiente. Os sistemas frequentemente precisam entender onde os objetos estão localizados, quantos existem e como se relacionam com o ambiente ao seu redor. Essa necessidade de percepção espacial é o que impulsiona a detecção de objetos e a segmentação de imagens.

- A detecção de objetos identifica o que são os objetos e onde eles aparecem na imagem. O modelo geralmente desenha caixas delimitadoras ao redor dos itens e atribui um rótulo de classe a cada caixa. Famílias de modelos comuns incluem Faster R-CNN, SSD e YOLO, e a escolha geralmente se resume ao equilíbrio entre velocidade e precisão.

- A segmentação de imagens rotula pixels em vez de desenhar retângulos, o que torna os limites muito mais precisos. Isso é útil quando as formas são irregulares, os objetos se sobrepõem ou a precisão nas bordas é importante. A segmentação de instâncias separa objetos individuais da mesma classe, enquanto a segmentação semântica rotula regiões por categoria em toda a imagem.

Aprendizagem supervisionada, não supervisionada e autossupervisionada

A maioria dos sistemas de reconhecimento de imagem depende de aprendizado supervisionado, mas outras abordagens estão se tornando cada vez mais importantes à medida que a disponibilidade de dados e as restrições dos projetos mudam.

Aprendizagem não supervisionada

Os modelos não supervisionados descobrem padrões sem rótulos. Eles agrupam imagens com base na similaridade. Isso é útil quando os dados rotulados são escassos.

Aprendizagem autossupervisionada

Os métodos de autoaprendizagem supervisionada criam sinais de aprendizado a partir dos próprios dados. Tarefas como prever partes faltantes de uma imagem permitem que os modelos aprendam representações úteis com rotulagem mínima. Essas abordagens são especialmente valiosas para conjuntos de dados de grande escala ou especializados.

Implantação e restrições do mundo real

Um modelo treinado só é útil se apresentar um desempenho confiável após a implantação. É aqui que muitos sistemas de reconhecimento de imagem começam a apresentar dificuldades, não porque o modelo seja mal projetado, mas porque as condições do mundo real raramente correspondem ao ambiente de treinamento.

Uma vez implantados, os modelos frequentemente enfrentam variações na qualidade da imagem causadas por diferentes câmeras, níveis de compressão ou desfoque de movimento. Os objetos podem aparecer em formas ou contextos desconhecidos, e fatores ambientais como iluminação, clima ou elementos de fundo podem introduzir padrões que o modelo nunca viu antes. Limitações de hardware também desempenham um papel importante, especialmente quando se espera que os modelos sejam executados em dispositivos com recursos limitados em vez de servidores potentes.

Os sistemas de reconhecimento de imagem podem operar na nuvem ou diretamente em dispositivos na borda da rede. A implantação em nuvem oferece maior capacidade computacional e atualizações mais fáceis, enquanto a implantação na borda melhora a privacidade, reduz a latência e permite que os sistemas funcionem sem conectividade constante. A desvantagem é a capacidade de processamento limitada, que geralmente exige modelos menores ou otimizados.

Para manterem sua eficácia ao longo do tempo, os modelos implantados precisam de monitoramento contínuo. O desempenho pode se degradar à medida que a distribuição dos dados muda, tornando necessário o retreinamento e o ajuste periódicos. Tratar a implantação como um processo contínuo, e não como uma etapa final, é essencial para manter o reconhecimento de imagens confiável em condições reais.

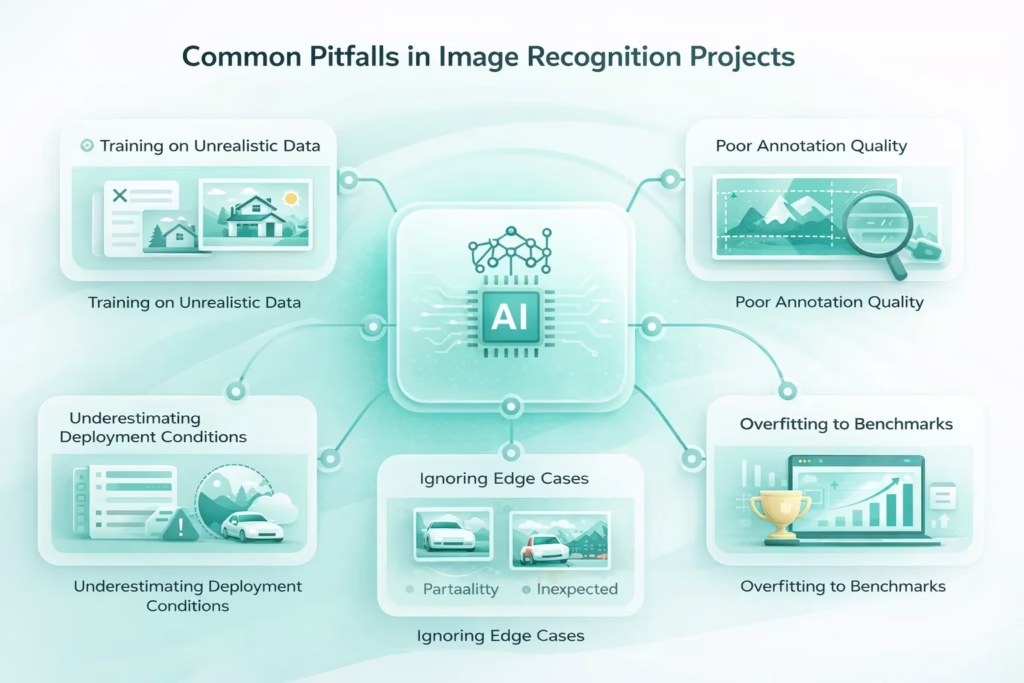

Armadilhas comuns em projetos de reconhecimento de imagem

Mesmo sistemas de reconhecimento de imagem bem projetados podem falhar se alguns problemas recorrentes forem ignorados. Esses problemas tendem a surgir não durante o desenvolvimento, mas depois que um modelo é exposto a condições reais de operação.

- Treinamento com dados irreais. Modelos treinados apenas com imagens limpas, bem iluminadas e perfeitamente enquadradas geralmente apresentam dificuldades no mundo real. Ruído da câmera, desfoque de movimento, sombras e oclusão parcial podem reduzir significativamente a precisão se não estiverem representados no conjunto de treinamento.

- Qualidade de anotação ruim. Rótulos inconsistentes, objetos ausentes ou limites imprecisos geram confusão durante o treinamento. Um conjunto de dados menor com anotações de alta qualidade geralmente apresenta melhor desempenho do que um conjunto de dados grande com rotulagem inadequada.

- Ignorando casos extremos. Situações raras, aparências incomuns de objetos ou planos de fundo inesperados são fáceis de passar despercebidos. Esses casos extremos são frequentemente responsáveis pelas falhas mais graves após a implantação.

- Sobreajuste aos benchmarks. Otimizar modelos para obter bom desempenho em conjuntos de dados padrão pode criar uma falsa sensação de sucesso. Altas pontuações em benchmarks nem sempre se traduzem em desempenho confiável em dados personalizados ou específicos de um domínio.

- Subestimar as condições de implantação. Os modelos se comportam de maneira diferente após serem implantados. Alterações na resolução da imagem, limitações de hardware, latência da rede ou condições ambientais podem afetar o desempenho.

Sistemas de reconhecimento de imagem bem-sucedidos são construídos com ciclos de feedback contínuos, verificações de desempenho regulares e testes em situações reais. Tratar a implementação como um processo contínuo, em vez de uma etapa final, faz toda a diferença entre um modelo que parece bom no papel e um que funciona na prática.

Considerações finais

O reconhecimento de imagens em aprendizado de máquina não é mágica. É um processo estruturado, construído com base em dados, aprendizado e iteração. As máquinas não entendem imagens da mesma forma que os humanos. Elas aprendem associações entre padrões e resultados.

O que torna o reconhecimento de imagens poderoso não é um único algoritmo, mas sim o sistema que o envolve. Qualidade dos dados. Estratégia de treinamento. Disciplina na avaliação. E implementação cuidadosa.

Quando essas peças se alinham, o reconhecimento de imagem se torna uma ferramenta confiável, em vez de uma demonstração frágil. E é isso que o torna prático.

Perguntas frequentes

O reconhecimento de imagens em aprendizado de máquina é o processo de ensinar um sistema a identificar e classificar objetos, padrões ou características em imagens. O modelo aprende com dados visuais rotulados ou não rotulados e usa essa experiência para interpretar novas imagens que não viu antes.

As máquinas não enxergam imagens como objetos ou cenas. Elas processam imagens como dados numéricos compostos por valores de pixels. Os modelos de reconhecimento de imagem aprendem padrões nesses números, como bordas, texturas e formas, e os associam a resultados conhecidos por meio de treinamento.

O reconhecimento de imagens geralmente se refere à identificação do que está presente em uma imagem, frequentemente em um nível elevado. A detecção de objetos vai além, identificando objetos individuais e localizando-os dentro da imagem usando caixas delimitadoras. A detecção adiciona uma percepção espacial que a simples classificação não proporciona.

A detecção de objetos delimita objetos usando caixas retangulares, enquanto a segmentação de imagens rotula pixels individuais. A segmentação permite delimitar objetos com maior precisão e é utilizada quando formas ou regiões exatas são importantes, como em imagens médicas ou análises de satélite.

O modelo só pode aprender com os dados que recebe. Imagens de baixa qualidade, rótulos inconsistentes ou exemplos de treinamento irreais levam a um desempenho fraco. Dados de alta qualidade e bem anotados geralmente têm um impacto maior do que arquiteturas de modelo mais complexas.

A quantidade de dados depende da complexidade da tarefa e do modelo utilizado. Tarefas simples de classificação podem exigir milhares de imagens, enquanto tarefas mais complexas de detecção ou segmentação podem exigir uma quantidade significativamente maior. A aprendizagem por transferência e as abordagens de aprendizagem autossupervisionada podem reduzir a necessidade de dados.