画像認識は複雑に聞こえるかもしれませんが、その核となる考え方は驚くほど単純です。機械は画像をデータとして捉え、例からパターンを学習し、その経験を活用して次に見るものを認識します。真の仕事は、これらの例がどのように準備され、モデルがどのように学習し、そしてその学習が実験室の外でどれほどうまく機能するかにあります。.

この記事では、機械学習における画像認識の仕組みを段階的に解説します。難しい数学や専門用語は一切使用しません。画像がどのように信号に変換されるのか、モデルがどのようにそれを解釈するのかを学習するのか、そしてなぜ一部のシステムは実世界の状況で優れたパフォーマンスを発揮する一方で、他のシステムはうまく機能しないのかを分かりやすく解説します。.

機械学習における画像認識の真の意味

画像認識の本質は、分類と識別です。システムは画像を受け取り、次のような質問に答えます。

- この画像には何がありますか?

- 特定のオブジェクトはどこにありますか?

- オブジェクトはいくつありますか?

- これらの画像は同じカテゴリに属していますか?

機械学習の用語では、画像認識はコンピュータービジョンの一部です。コンピュータービジョンは、視覚データを意思決定に役立つ方法で解釈することを機械に教えることに重点を置いています。.

最初に明確にしておくべき重要な違いは、機械は人間と同じように画像を認識しないということです。人間は猫を見ますが、機械は数字のグリッドを見ます。画像認識における以降のすべての要素は、このギャップを埋めるために存在します。.

機械が画像を見る仕組み

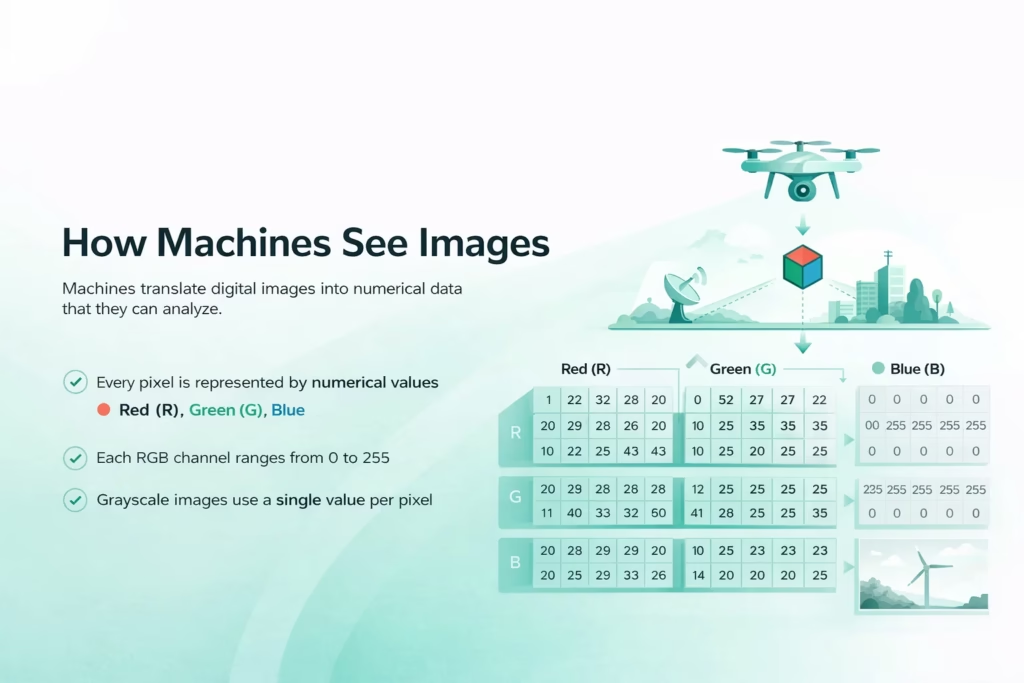

学習を始める前に、画像を機械が処理できる形式に変換する必要があります。デジタル画像はピクセルで構成されています。各ピクセルには、色の強度を表す数値が保持されています。.

標準の RGB 画像では、各ピクセルに次の 3 つの値が含まれます。

- 赤

- 緑

- 青

各値は通常0から255の範囲です。黒のピクセルはゼロで表され、白のピクセルは最大値を使用します。画像全体は、これらの数値の大きな行列で表されます。.

グレースケール画像では、ピクセルごとに単一の値を使用することでこれが簡素化され、複雑さが軽減されるため、色ではなく形状やコントラストに依存するタスクには十分な場合が多くあります。.

この段階では、画像には何の意味もありません。単なるデータです。画像認識の本質は、そのデータ内のどのパターンが重要かを学習することです。.

画像認識におけるデータの役割

優れた画像認識は、優れたデータから始まります。多くのプロジェクトは、モデルを学習させるずっと前から、データの質の高さが成功の鍵となります。たとえ強力なアルゴリズムであっても、基盤となる画像が実際の動作状況を反映していない場合、困難を極めます。.

データ収集

データセットは、モデルが展開後に直面する状況を反映する必要があります。制御された環境で撮影された画像は、現実世界の変動と一致することはほとんどありません。照明の変化、角度の変化、オブジェクトの重なり、解像度の変動などです。.

有用なデータセットには以下が含まれます

- 異なる視点

- 照明の変化

- リアルな背景

- 不完全またはノイズの多い例

モデルがクリーンで理想的な画像のみでトレーニングされた場合、条件が予測できない実際の設定ではパフォーマンスが低下する可能性があります。.

ラベル付けと注釈

教師あり学習では、画像にラベルを付けることが重要です。ラベルは、モデルに学習すべき内容を伝えます。これは、カテゴリ名を割り当てるだけのシンプルなものから、ピクセルレベルで正確なオブジェクトの境界を定義するような詳細なものまで、多岐にわたります。.

一般的な注釈の種類

- 分類のための画像レベルのラベル

- 物体検出のための境界ボックス

- セグメンテーションのためのピクセルマスク

- 姿勢推定のためのキーポイント

アノテーションの質は量よりも重要です。一貫性のない、あるいは不正確なラベルはモデルを混乱させ、トレーニングデータを超えた一般化能力を制限します。.

FlyPix AIにおける地理空間分析における画像認識の活用方法

で フライピックスAI, では、衛星画像、航空画像、ドローン画像などの実際の地理空間データに画像認識を適用しています。これらのデータセットは複雑で高密度であるため、手作業による分析では時間がかかり、一貫性も欠けてしまいます。機械学習を活用することで、広大なエリアをわずかな時間で正確に検出、監視、検査することが可能になります。.

当社のプラットフォームは、AIエージェントを用いて、複雑なシーンに広がる数千ものオブジェクトを識別し、その輪郭を描き出します。ユーザーは、プログラミングスキルやAIに関する深い専門知識を必要とせず、独自のアノテーションを用いてカスタムモデルを学習できます。これにより、画像認識は技術チームだけでなく、日常業務にも実用的になります。.

私たちはスピードとスケールを重視しています。かつては数時間、あるいは数日かかっていたタスクが、今では数秒で完了できるようになり、チームが画像から意思決定へとより迅速に移行できるようになります。建設、農業、港湾運営、林業、インフラ、そして政府プロジェクトなど、あらゆる分野において、このアプローチは大きなメリットをもたらします。.

私たちにとって、画像認識とは単なる検出以上のものです。視覚データを、現実世界の状況に耐えうる信頼性の高い洞察へと変換することです。.

前処理:学習用画像の準備

生の画像をそのまま使用することはほとんどありません。前処理によって一貫性が向上し、トレーニング開始前に不要な変動が削減されるため、モデルは関連パターンをより効率的に学習できるようになります。.

この段階では通常、モデルが均一な入力を受け取るように画像を固定形状にサイズ変更し、数値範囲を安定させるためにピクセル値を正規化し、色情報が必須でない場合は色空間を変換し、センサーや圧縮によって発生するノイズを減らし、有用な信号を提供しない領域を切り取るなどの処理が行われます。.

正規化は特に重要な役割を果たします。ピクセル値を一定の範囲にスケーリングすることで、モデルはトレーニング中の数値的不安定性を回避し、より確実に収束します。.

データ拡張は、前処理と併せて適用されることがよくあります。回転、反転、ズーム、明るさ調整といった手法は、新しい画像を収集することなく、データセットに制御された変化をもたらします。これにより、過学習が軽減され、モデルが現実世界の視点、照明、向きの変化に適切に対応できるようになります。.

従来の機械学習における特徴抽出

ディープラーニングが主流になる前は、画像認識は主に手作業による特徴抽出に依存していました。エンジニアは、モデルがどの視覚的特徴に重点を置くべきかを定義していました。.

典型的な手作りの特徴は次のとおりです:

- エッジ

- コーナー

- テクスチャパターン

- グラデーション

方向勾配ヒストグラム、ローカルバイナリパターン、バッグオブフィーチャーなどの手法により、画像は固定長の数値ベクトルに変換されました。.

これらのアプローチは特定のタスクには有効でしたが、高度な専門知識が必要でした。また、視覚条件の変化への適応にも苦労し、新しいシナリオごとに手動による調整が必要でした。.

ディープラーニングと自動特徴学習

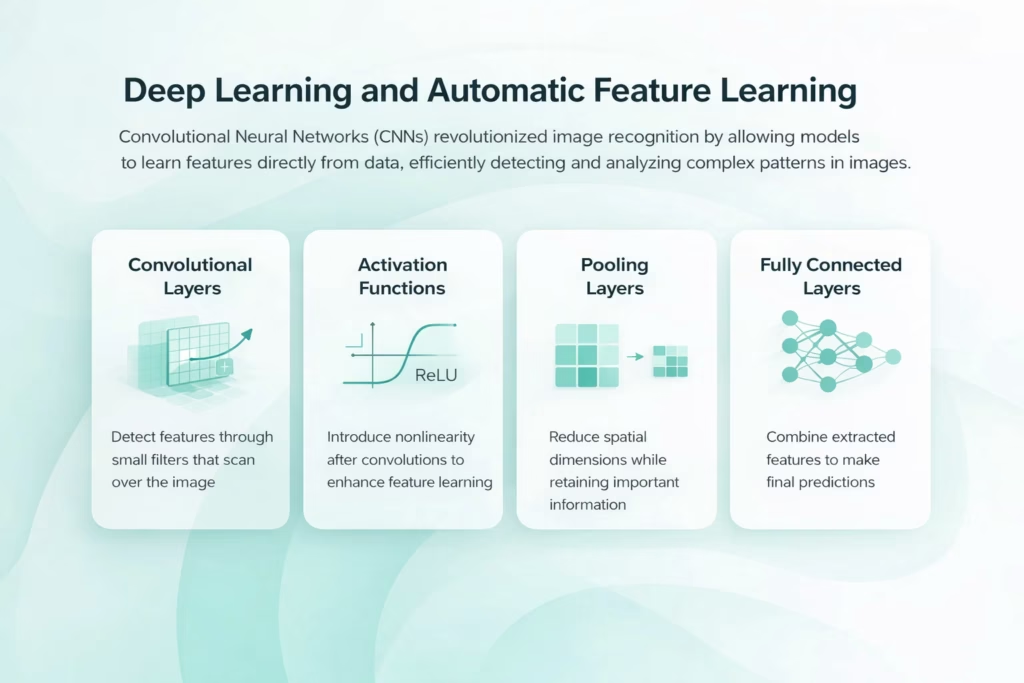

ディープラーニングは、人手による特徴量の作成を不要にすることで画像認識を変革しました。エンジニアはモデルに何を探すべきかを指示するのではなく、データから直接特徴量を学習させます。畳み込みニューラルネットワーク(CNN)は、現代の画像認識の基盤であり、画像の空間構造を活用するように設計されています。.

畳み込み層

畳み込み層は画像全体に小さなフィルターを適用します。これらのフィルターは、エッジやテクスチャなどの局所的なパターンに反応します。初期の層は単純な形状を検出し、より深い層はそれらを組み合わせてより複雑な構造を構築します。この階層的なアプローチは、単純な線から完全な物体まで、人間が視覚情報を処理する方法を反映しています。.

活性化関数

各畳み込みの後、活性化関数は非線形性を導入します。これにより、ネットワークは単純な線形パターンではなく、複雑な関係をモデル化できるようになります。.

プーリングレイヤー

プーリングは、重要な特徴を維持しながら空間次元を削減します。これにより、モデルはオブジェクトの位置における小さなずれや歪みを処理できるようになります。.

完全に接続されたレイヤー

ネットワークの末端では、抽出された特徴が統合・評価され、予測が行われます。これらのレイヤーは、画像全体からの情報を統合します。.

トレーニングプロセスのステップバイステップ

画像認識モデルの学習は反復的なプロセスです。ラベル付きデータへの繰り返しの曝露と、内部パラメータの段階的な調整を伴います。.

1. フォワードパス

モデルは画像を処理して予測を生成します。.

2. 損失計算

予測値は真のラベルと比較されます。損失関数は予測値がどれだけ間違っているかを測定します。.

3. バックプロパゲーション

モデルは内部の重みを調整して誤差を低減します。これは、損失をネットワークを通じて逆方向に伝播させることによって行われます。.

4. 最適化

オプティマイザーは勾配に基づいてパラメータを更新します。多くの反復処理を経て、モデルの精度は向上します。パフォーマンスが安定するか、検証データで許容レベルに達するまで、トレーニングは継続されます。.

物体検出と画像セグメンテーション

画像認識は分類だけに限りません。現実世界の多くのシナリオでは、画像内に物体が存在することを知るだけでは不十分です。システムは、物体がどこにあり、いくつあり、周囲とどのように関係しているかを理解する必要があることがよくあります。この空間認識の必要性こそが、物体検出と画像セグメンテーションの原動力なのです。.

- 物体検出は、物体が何であるか、そして画像内のどこに現れるかを識別します。モデルは通常、物体の周囲に境界ボックスを描き、各ボックスにクラスラベルを割り当てます。一般的なモデルファミリーには、Faster R-CNN、SSD、YOLOなどがあり、選択は速度と精度のトレードオフによって決まることが多いです。.

- 画像セグメンテーションは、長方形を描くのではなくピクセルにラベルを付けるため、境界線の精度が大幅に向上します。これは、形状が不規則な場合、オブジェクトが重なり合っている場合、またはエッジの精度が重要な場合に便利です。インスタンスセグメンテーションは、同じクラスの個々のオブジェクトを分離し、セマンティックセグメンテーションは、画像全体にわたってカテゴリごとに領域をラベル付けします。.

教師あり学習、教師なし学習、自己教師あり学習

ほとんどの画像認識システムは教師あり学習に依存していますが、データの可用性とプロジェクトの制約が変化するにつれて、他のアプローチがますます重要になっています。.

教師なし学習

教師なしモデルはラベルなしでパターンを発見します。類似性に基づいて画像をクラスタリングします。これは、ラベル付きデータが不足している場合に役立ちます。.

自己教師学習

自己教師型学習法は、データ自体から学習信号を生成します。画像の欠落部分を予測するといったタスクでは、モデルは最小限のラベル付けで有用な表現を学習できます。これらのアプローチは、大規模データセットや特殊なデータセットにおいて特に有用です。.

展開と現実世界の制約

学習済みモデルは、デプロイ後に確実に動作して初めて有用となります。多くの画像認識システムがここで苦戦し始めるのは、モデルの設計が不十分なためではなく、現実世界の状況が学習環境と一致することがほとんどないためです。.

モデルをデプロイすると、カメラの違い、圧縮レベル、モーションブラーなどによって画質にばらつきが生じることがよくあります。オブジェクトが見慣れない形状や状況で表示される場合があり、照明、天候、背景の乱雑さといった環境要因によって、モデルがこれまで見たことのないパターンが現れることもあります。特に、モデルが強力なサーバーではなく、リソースが限られたデバイス上で実行される場合、ハードウェアの制限も影響を及ぼします。.

画像認識システムは、クラウド上で動作することも、エッジデバイス上で直接動作させることもできます。クラウドベースの導入では、計算能力が向上し、アップデートが容易になります。一方、エッジ導入ではプライバシーが向上し、レイテンシが低減し、常時接続がなくてもシステムが機能できます。ただし、そのトレードオフとして、処理能力が限られているため、多くの場合、より小規模なモデルや最適化されたモデルが必要になります。.

導入されたモデルが長期にわたって効果を発揮し続けるためには、継続的な監視が必要です。データ分布の変化に伴いパフォーマンスが低下する可能性があるため、定期的な再トレーニングと調整が必要になります。導入を最終段階ではなく継続的なプロセスとして捉えることは、実世界の状況において信頼性の高い画像認識を維持するために不可欠です。.

画像認識プロジェクトにおけるよくある落とし穴

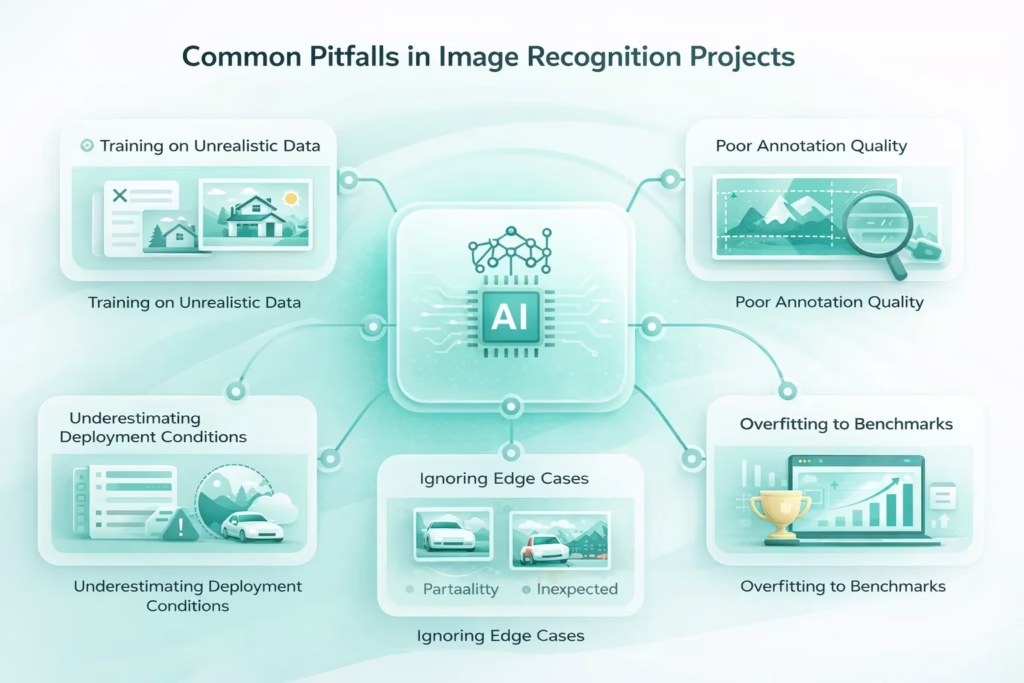

たとえ優れた設計の画像認識システムであっても、いくつかの繰り返し発生する問題を見逃すと、機能不全に陥る可能性があります。こうした問題は開発中ではなく、モデルが実際の運用環境にさらされた後に表面化する傾向があります。.

- 非現実的なデータでのトレーニング。. 明るく、明るく、完璧なフレーミングの画像のみでトレーニングされたモデルは、現実世界ではしばしば苦戦を強いられます。カメラのノイズ、モーションブラー、影、部分的な遮蔽などがトレーニングセットに反映されていない場合、精度が大幅に低下する可能性があります。.

- 注釈の品質が悪い。. 一貫性のないラベル、欠落したオブジェクト、不正確な境界は、学習中に混乱を引き起こします。質の高いアノテーションが付与された小規模なデータセットは、通常、ラベル付けが不十分な大規模データセットよりも優れたパフォーマンスを発揮します。.

- エッジケースを無視します。. 稀な状況、通常とは異なるオブジェクトの外観、予期せぬ背景などは見落とされがちです。こうしたエッジケースは、導入後に最も深刻な障害を引き起こす原因となることがよくあります。.

- ベンチマークへの過剰適合。. 標準データセットで良好なパフォーマンスを発揮するようにモデルを最適化すると、誤った成功感を抱く可能性があります。高いベンチマークスコアが、カスタムデータやドメイン固有のデータで必ずしも信頼できるパフォーマンスにつながるとは限りません。.

- 展開条件を過小評価しています。. モデルはデプロイされると動作が変わります。画像解像度、ハードウェアの制約、ネットワークの遅延、環境条件などの変化は、パフォーマンスに影響を与える可能性があります。.

成功する画像認識システムは、継続的なフィードバックループ、定期的なパフォーマンスチェック、そして実環境でのテストによって構築されます。デプロイメントを最終段階ではなく継続的なプロセスとして扱うことで、理論上は良さそうに見えるモデルと、実際に機能するモデルの違いが生まれます。.

最後に

機械学習における画像認識は魔法ではありません。データ、学習、そして反復処理に基づいて構築された構造化されたプロセスです。機械は人間の感覚で画像を理解するのではなく、パターンと結果の関連性を学習します。.

画像認識を強力にするのは、単一のアルゴリズムではなく、それを取り巻くシステムです。データの品質、トレーニング戦略、評価の規律、そして慎重な導入。.

これらの要素が揃うと、画像認識は脆弱なデモではなく、信頼できるツールになります。そして、それが画像認識を実用化するのです。.

よくある質問

機械学習における画像認識とは、画像内の物体、パターン、または特徴を識別・分類するようにシステムを学習させるプロセスです。モデルはラベル付きまたはラベルなしの視覚データから学習し、その経験を用いて、これまでに見たことのない新しい画像を解釈します。.

機械は画像を物体や風景として認識するのではなく、ピクセル値で構成される数値データとして処理します。画像認識モデルは、エッジ、テクスチャ、形状といった数値データ内のパターンを学習し、トレーニングを通じて既知の結果と関連付けます。.

画像認識は通常、画像内に存在するものを、多くの場合は高レベルで識別することを指します。物体検出はさらに進んで、個々の物体を識別し、境界ボックスを用いて画像内における位置を特定します。検出は、単純な分類では得られない空間認識を付加します。.

物体検出は長方形のボックスで物体の輪郭を描き、画像セグメンテーションは個々のピクセルにラベルを付けます。セグメンテーションはより正確な境界を描き、医療画像や衛星画像解析など、正確な形状や領域が重要な場合に使用されます。.

モデルは受け取ったデータからのみ学習できます。低品質の画像、一貫性のないラベル、非現実的なトレーニング例は、パフォーマンスの低下につながります。高品質で適切にアノテーションされたデータは、通常、より複雑なモデルアーキテクチャよりも大きな効果を発揮します。.

データ量は、タスクの複雑さと使用するモデルによって異なります。単純な分類タスクでも数千枚の画像が必要になる場合がありますが、より複雑な検出やセグメンテーションタスクでは、はるかに多くの画像が必要になる場合があります。転移学習や自己教師あり学習によって、必要なデータ量を削減できます。.