画像認識モデルが失敗する理由が、アーキテクチャの誤りであることは稀です。精度の誤解、測定方法の誤り、あるいは現実を反映しない条件での検証などが原因で失敗することがあります。学習中は優れたモデルに見えても、実際のデータに接した途端、破綻してしまうこともあります。.

画像認識の精度を確認することは、単一のスコアを追い求めることではありません。モデルが何を正しく認識し、何を見逃し、そしてなぜそのような間違いが起こるのかを理解することです。実際には、精度は指標、検証の規律、そして実際のシナリオに対する誠実なテストの組み合わせによって決まります。このガイドでは、画像認識システムが実際に使用できる状態にあるかどうかを判断できる評価方法を詳しく説明します。.

全体的な精度が真実を語らない理由

総合精度は最も一般的な指標ですが、プロジェクトがトイプロブレムの域を超えると、最も情報量が少なくなります。予測がラベルと一致する頻度を測定しますが、クラスの不均衡、エラーの重大性、分布のシフトは考慮されません。.

モデルは、一般的で簡単なケースでは良好なパフォーマンスを発揮する一方で、稀ではあるが重大なケースでは一貫して失敗することで、非常に高い精度を達成できます。実際のプロジェクトでは、こうした稀なケースこそが、そもそもモデルが存在する理由であることが多いのです。.

全体的な精度は役に立たないわけではありませんが、表面的なシグナルとして扱うべきです。何かが明らかに壊れているかどうかを示すことはできますが、システムの信頼性を保証することはできません。.

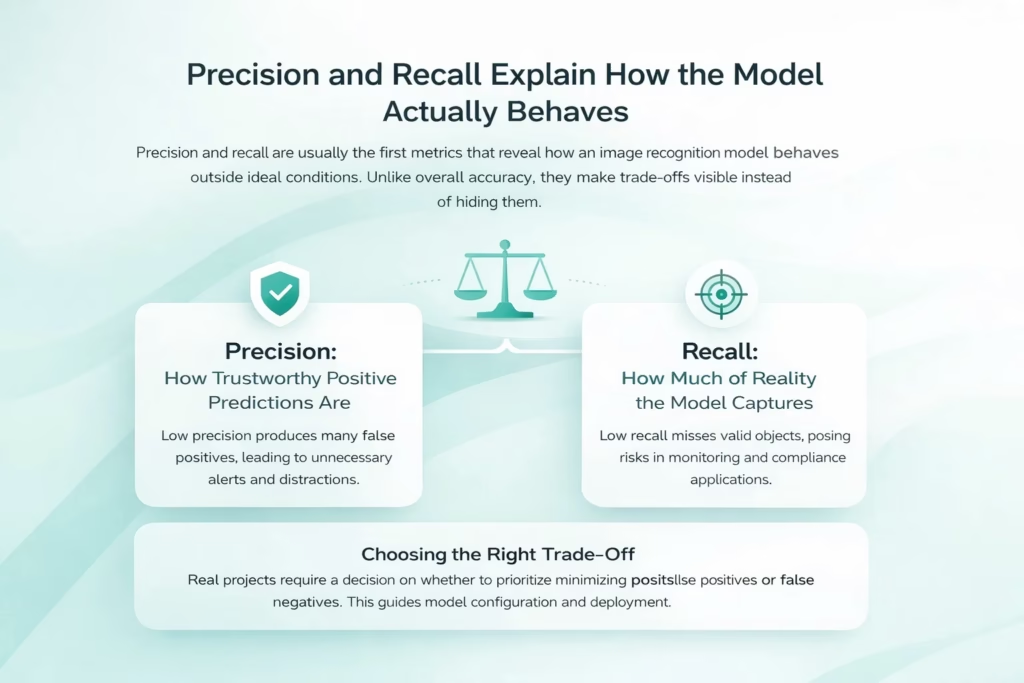

適合率と再現率はモデルの実際の動作を説明する

適合率と再現率は、通常、画像認識モデルが理想的な条件以外でどのように動作するかを明らかにする最初の指標です。全体的な精度とは異なり、これらはトレードオフを隠すのではなく、可視化します。.

精度:肯定的な予測の信頼性

精度は、モデルが肯定的な予測を行った際に、どれほどの頻度で正しいかを表します。精度が低いということは、システムが多くの誤検知を生成することを意味します。実際のプロジェクトでは、検出のたびにアラート、ワークフロー、または人間によるレビューがトリガーされるため、これはすぐに問題となります。技術的に正確なモデルであっても、常に不必要な注意を要求するようでは使い物にならなくなる可能性があります。.

思い出してください: モデルが現実をどれだけ捉えているか

再現率は、モデルが実際に存在するもののうち、どれだけ検出できたかを示す指標です。再現率が低いモデルは、たとえ正しく検出できたとしても、有効なオブジェクトを見逃してしまいます。監視、安全、コンプライアンス関連のシステムでは、誤検出よりも見逃しの方がリスクが高い場合が多くあります。.

適切なトレードオフの選択

適合率と再現率は異なる故障モードを表すものであり、どちらが普遍的に優れているというわけではありません。実際のプロジェクトでは、どちらのエラーがより許容できるかを明確に判断する必要があります。この判断は、閾値の調整、モデルの選択、そして最終的な精度の判断方法を決定する上で重要です。.

FlyPix AIで画像認識精度を実用化

で フライピックスAI, 私たちは画像認識に取り組んでおり、クリーンなテストデータだけでなく、実際の環境でも精度が求められる分野です。衛星画像、航空画像、ドローン画像は本質的に複雑なため、環境、規模、変化に関わらず維持できる精度を重視しています。.

私たちは精度を単一のスコアとして扱いません。私たちのプラットフォームは、チームがカスタムモデルをトレーニングし、検出結果を視覚的に検証し、迅速に反復処理できるよう構築されています。ドメイン知識をモデルに近づけ、テストと再トレーニングにかかる時間を短縮することで、精度を一度測定するだけでなく、チームが積極的に活用できるものにします。.

精度の向上は導入だけで終わりません。画像が時間の経過とともに変化しても、当社のワークフローは継続的な検証と再トレーニングをサポートし、モデルが徐々に関連性を失うことなく、現実世界の状況に適合した状態を維持します。.

コア精度指標の解釈

基本的な精度の数値が表に出たら、いよいよ本格的な作業が始まります。画像認識システムが失敗する原因は、指標の欠落による場合がほとんどです。指標が個別に読み取られるからこそ、失敗するのです。適合率、再現率、F1スコア、IoU、mAPはそれぞれモデルの挙動の異なる側面を表すものであり、それぞれ単独では意味を持ちません。目標は、これらがどのように相互作用し、一緒に見ることで何が明らかになるのかを理解することです。.

詳細を失わずにF1スコアを使用する

F1スコアは、適合率と再現率を1つの数値にまとめたものです。特に、どちらの指標も優勢ではない場合の比較に役立ちます。.

しかし、F1スコアは適合率と再現率の直接的な検証に取って代わるべきではありません。同じF1スコアを持つ2つのモデルが、実際には大きく異なる動作をする可能性があります。一方は稀なケースを見逃してしまう可能性があり、もう一方は誤検出でシステムを混乱させてしまう可能性があります。.

F1 スコアを結論ではなく要約として扱います。.

物体検出精度がルールを変える

画像認識の精度は、物体検出が関わるとさらに複雑になります。検出システムは、画像内に何が存在するかを識別し、画像内で正確に位置を特定する必要があります。.

交差重なり(IoU)は、予測された境界ボックスが真の境界ボックスとどの程度重なっているかを測定します。これにより、精度は単なる分類タスクではなく、空間的な問題として捉えられるようになります。.

IoUの閾値の選択は技術的な詳細ではありません。閾値が緩いと、ローカリゼーションの問題が隠れてしまう可能性があります。一方、閾値が極端に厳しいと、運用上は十分な検出結果が損なわれる可能性があります。実際のプロジェクトでは、IoUはレポートの見栄えではなく、検出の精度を反映するべきです。.

平均精度とその限界

平均適合率(mAP)は、閾値間の検出信頼度、ランキング品質、位置推定精度を総合的に評価するため、広く利用されています。mAPは、類似の条件下でトレーニングされた物体検出モデルを構造的に比較する方法を提供します。.

mAPは比較指標として最も価値があります。あるアプローチが他のアプローチと比較して検出品質を向上させるかどうかをチームが理解するのに役立ちます。ただし、mAPは堅牢性を保証するものではありません。モデルがmAPで高いスコアを獲得しても、特定の照明条件、環境、またはオブジェクトの配置では失敗する可能性があります。.

このため、mAP は判定ではなくレンズとして扱う必要があります。.

常にクラスごとのパフォーマンスを見る

画像認識システムが失敗する最も一般的な理由の一つは、クラスのパフォーマンスが不均一であることです。集約されたメトリクスはこの問題を隠蔽します。.

精度を評価する際は、必ずクラスごとの指標を検査してください。これにより、特定のオブジェクトが常に検出されにくいか、他のオブジェクトと混同されやすいかが明らかになります。.

このステップでは優先順位が頻繁に変更されます。全体的に強力に見えるモデルでも、最も重要なクラスで失敗すると受け入れられない可能性があります。.

混同行列はエラーをパターンに変える

混同行列は、画像認識モデルの挙動を理解するための最も実用的なツールの一つです。誤りを単一のスコアにまとめるのではなく、予測がクラス間でどのように変化するかを示し、誤りの構造を明らかにします。.

混同行列が明らかにするもの

混同行列は、予測を実際の事実と照らし合わせることで、スカラー メトリックでは答えられない次のような質問に答えるのに役立ちます。

- どのクラスが最も頻繁に混同されるか

- エラーが一方的か相互的か

- 間違いが視覚的に類似したカテゴリまたは重複したカテゴリに集中しているかどうか

この見解が重要な理由

これらのパターンは、曖昧なクラス定義、一貫性のないラベル付け、トレーニング例の欠落など、根本的な問題を直接的に示唆することがよくあります。混同行列はクラス間の関係性を明らかにするため、より多くのデータを収集するか、ラベルを改良するか、クラス境界を調整するかを判断する際に特に役立ちます。.

検証は真に目に見えないデータでのみ機能する

検証データがトレーニングデータとあまりにも類似している場合、精度評価は破綻します。これはチームが予想するよりも頻繁に発生します。.

同じ画像の拡張版が複数の分割で出現したり、データが同一の狭い範囲から取得されたりすると、精度が不自然に高く見えることがあります。モデルは、既に観測された画像のバリエーションでテストされています。.

意味のあるテストセットとは、重要な点において異なるものであるべきです。これには、場所、デバイス、期間、キャプチャ条件の違いなどが含まれます。この分離がなければ、精度評価は予測的なものではなく、自己確認的なものになってしまいます。.

実際の条件下でのテストは結論を変える

多くの精度の問題は、モデルが現実世界の不完全性に遭遇した時に初めて現れます。モーションブラー、ノイズ、オクルージョン、圧縮アーティファクト、不十分な照明などは、クリーンなデータセットでは決して明らかにならない弱点を露呈させます。.

現実的な条件下でのテストは、しばしば不便ではあるものの、貴重な発見をもたらします。理想的なシナリオでは良好なパフォーマンスを発揮するモデルであっても、状況がわずかに変化すると、パフォーマンスが低下する可能性があります。これを導入前に発見することで、時間、コスト、そして信頼性を節約できます。.

この段階では完璧なシミュレーションは必要ありません。実際の制作現場で画像がどのように見えるかを忠実にサンプリングする必要があります。.

時間の経過に伴う精度とバイアスの役割

画像認識の精度は静的ではありません。現実世界のデータは常に変化しており、監視されていないモデルは徐々に現実から乖離していきます。季節の変化、新しいハードウェア、環境の変化、そしてユーザー行動の変化はすべて、画像の見え方やモデルの解釈に影響を与えます。精度がリリース時にのみチェックされている場合、こうした緩やかな低下は、不具合が明らかになるまで気づかれないことがよくあります。.

導入後の精度チェックでは、個々の数値ではなく傾向に焦点を当てるべきです。徐々に低下するパフォーマンスは、馴染みのある指標の裏に隠れているため、突然の障害よりも危険な場合が多いです。継続的な監視により、わずかな変化を早期に検知し、精度が許容レベルを下回る前に対応することが可能になります。.

このプロセスにはバイアスが直接的な役割を果たします。狭い範囲のデータや不均衡なデータで学習したモデルは、既に経験した状況でのみ良好なパフォーマンスを発揮する傾向があります。新しい環境、物体の種類、視覚パターンが現れると、精度指標は信頼性を過大評価してしまいます。バイアスを減らすことでカバレッジは向上しますが、同時に堅牢性も向上します。より公平なモデルは通常、時間の経過とともに安定し、状況の変化に応じて維持しやすくなります。.

正確性を活用して真の意思決定を行う

精度指標は意思決定を導くためのものであり、ステークホルダーに感銘を与えるためのものではありません。レポートでは、トレードオフ、制限、既知のリスクを単一の数値で隠すのではなく、それらを説明するべきです。文脈なしに精度が提示されると、誤った自信が生まれ、後々生産段階で表面化する問題をチームが見落としてしまう可能性があります。.

実際には、有用な精度レポートでは、次の点を明確にする必要があります。

- どのタイプのエラーが最も重要か、そしてなぜそれが許容されるか、または許容されないか

- 信頼性が低いクラスやシナリオなど、モデルのパフォーマンスが不均一な場合

- 評価が反映する条件(データソース、環境、期間など)

- パフォーマンスが時間の経過とともにどのように変化すると予想され、どのように監視されるか

明確で正直なレポートは、チーム間の信頼を構築し、実際の使用において維持、改善、および信頼性が容易なシステムにつながります。.

モデルが実際に準備できたとき

モデルは、その動作が理解された時点で完成であり、メトリクスが最高点に達した時点で完成ではありません。高いスコアは、特にデータセットが狭い場合や理想的な条件で得られた場合、脆弱なパフォーマンスを隠してしまう可能性があります。より重要なのは、モデルがどのように失敗し、どこで失敗し、それが許容可能なリスクと一致しているかどうかを把握することです。予測可能なエラーは、しきい値、ワークフロー、または再トレーニングによって管理できます。未知のエラーは、通常は修正コストが高くなった時点で、後になって表面化します。.

真の準備は、楽観的な解釈ではなく、規律ある評価から生まれます。つまり、現実的な条件下でのテスト、真に未知のデータによる検証、そして導入後のパフォーマンスのモニタリングです。継続的に観察・調整されたモデルは、単にローンチ時に強力に見えたモデルよりもはるかに信頼性が高いのです。.

最後に

実際のプロジェクトで画像認識の精度を確認することは、最高スコアを求めることではありません。現実世界の状況が介入した際にシステムがどのように動作するかを理解することが重要です。.

指標はツールです。慎重に使用すれば、強みと弱みが明らかになります。一方、不注意に使用すれば、信頼性のない自信しか生み出しません。.

デモと信頼性の高い画像認識システムの違いは、アーキテクチャではありません。精度がどのように誠実に測定され、テストされ、そして長期にわたって維持されるかにあります。.

よくある質問

最適な指標は一つだけではありません。全体的な精度は手軽なシグナルとして役立ちますが、それだけでは十分ではありません。実際のプロジェクトでは、精度は適合率、再現率、そして物体検出におけるIoUやmAPといったタスク固有の指標を組み合わせて評価する必要があります。適切な組み合わせは、ユースケースにおいてどのようなエラーが最も重要かによって異なります。.

これは通常、評価データがトレーニングデータとあまりにも類似しているか、実際の状況を反映していない場合に発生します。クリーンな画像、限られた環境、あるいは分割間のデータ漏洩は、精度スコアを膨らませる可能性があります。モデルが新しい照明、角度、ノイズ、あるいは環境に遭遇すると、これまでテストされていなかった弱点が現れます。.

エラーのコストによって異なります。誤検知によって手動レビュー、アラート、または自動アクションが実行される場合は、精度がより重要になります。オブジェクトの欠落によってリスクや盲点が生じる場合は、再現率の方が重要です。実際のシステムでは、1つの指標を盲目的に最適化するのではなく、意識的なトレードオフが必要になります。.

いいえ。F1スコアは比較には役立ちますが、適合率と再現率のバランスが分かりにくくなります。同じF1スコアを持つ2つのモデルでも、実際には大きく異なる動作をする可能性があります。判断を下す前に、必ず適合率と再現率を別々に検討してください。.

精度は導入後、一度だけでなく定期的に確認する必要があります。適切な頻度はデータの変化速度によって異なりますが、新しい環境、季節、ハードウェアにさらされるシステムは継続的に監視する必要があります。パフォーマンスの緩やかなドリフトはよく見られ、傾向を追跡しないと気づかれないことがよくあります。.