画像認識モデルの学習は、巧妙なアルゴリズムよりも、基礎を正しく理解することが重要です。最新のアーキテクチャを追いかけるよりも、良質なデータ、明確なラベル、そして思慮深い学習プロセスの方がはるかに重要です。これらのいずれかを省略すれば、どんなに優れたモデルでも現実世界では苦戦するでしょう。.

このガイドでは、チームが実際にどのように画像認識モデルをトレーニングし、実験室の外で通用するかを解説します。理論に固執したり、学術的な内容にこだわったりするのではなく、何に焦点を当てるべきか、何が問題になることが多いのか、そして確実に学習し、時間の経過とともに改善していくモデルを構築する方法を明確に示します。.

画像認識モデルのトレーニングに実際に必要なこと

手順に入る前に、よくある誤解を解いておきましょう。画像認識モデルのトレーニングとは、システムに人間のように「見る」ことを教えることではありません。ピクセル内の統計的なパターンを認識し、それらのパターンを定義したラベルに関連付けることを教えることです。.

トレーニングの本質は、モデルに多くの画像例を示し、何が正しいかを伝え、間違いに基づいてモデルが自ら調整できるようにすることです。時間の経過とともに、モデルはどの視覚信号が重要で、どの信号を無視できるかを学習します。エッジ、テクスチャ、形状、色の遷移、空間関係など、すべてがこの内部表現の一部となります。.

このプロセスは、何よりも次の 3 つの要素に依存します。

- データの品質と関連性

- ラベルの明瞭さと一貫性

- 評価と反復を通じて生み出されるフィードバックループ

アルゴリズムとアーキテクチャは重要ですが、弱いデータや不明確な目標を補うことはほとんどありません。適切に準備されたデータで学習されたシンプルなモデルは、不注意に学習された複雑なモデルよりも、ほぼ確実に優れたパフォーマンスを発揮します。.

トレーニングは一度きりの作業ではないことも理解しておく価値があります。画像認識システムは徐々に改善されます。初期のバージョンは粗雑な場合が多いですが、データが改善され、エッジケースが追加され、仮定が修正されるにつれて、パフォーマンスは向上します。.

その考え方を身に付ければ、以下のステップバイステップのプロセスがより簡単かつ効果的に実行できるようになります。.

FlyPix AIにおける画像認識モデルのトレーニングアプローチ

で フライピックスAI, では、画像認識モデルを、制御されたデモではなく、実際の地理空間条件に基づいてトレーニングします。衛星画像、航空画像、ドローン画像にはノイズ、変動、複雑さが伴うため、当社のトレーニングプロセスは、スケール、不一致、エッジケースに最初から対応できるように構築されています。.

コーディングなしでカスタムAIモデルを学習できるだけでなく、モデルの検出内容と学習方法を完全に制御できます。ユーザーはオブジェクト、アノテーション、優先度を定義できます。当社のプラットフォームは、モデルの学習、最適化、そしてインフラストラクチャの裏側まですべて処理します。.

トレーニングは一度きりのステップとして扱われるのではなく、新しい画像が現れたり条件が変化したりするにつれてモデルが改善していく反復的なプロセスとして設計されています。能動学習は不確実なケースにトレーニングを集中させるのに役立ち、実際に精度を向上させる部分に労力が費やされます。.

私たちの目標はスピードだけでなく信頼性です。実世界の地理空間データでトレーニングすることで、モデルがテストだけでなく本番環境でも確実に機能することを保証します。その結果、複雑な画像を農業、インフラ、林業、政府機関など、あらゆる業界で活用できるインサイトへと変換する画像認識が実現します。.

画像認識モデルのトレーニングの実践的な手順

画像認識モデルの学習は、大きな技術的飛躍ではありません。小さな、そして意図的な意思決定の積み重ねであり、それらは互いに積み重なっていきます。各ステップは特定の問題を解決するものであり、いずれかのステップを省略したり、急いだりすると、後々、精度の低下、予測の不安定化、あるいは理想的な条件下でしか機能しないモデルといった問題が生じます。.

以下の手順は、実際のプロジェクトにおける画像認識システムのトレーニング方法に基づいています。タスクの定義とデータの準備から、トレーニング、評価、そして長期的なメンテナンスへと進みます。ツールやアーキテクチャは変化するかもしれませんが、この基盤となるプロセスは、業界やユースケースを問わず、驚くほど一貫しています。.

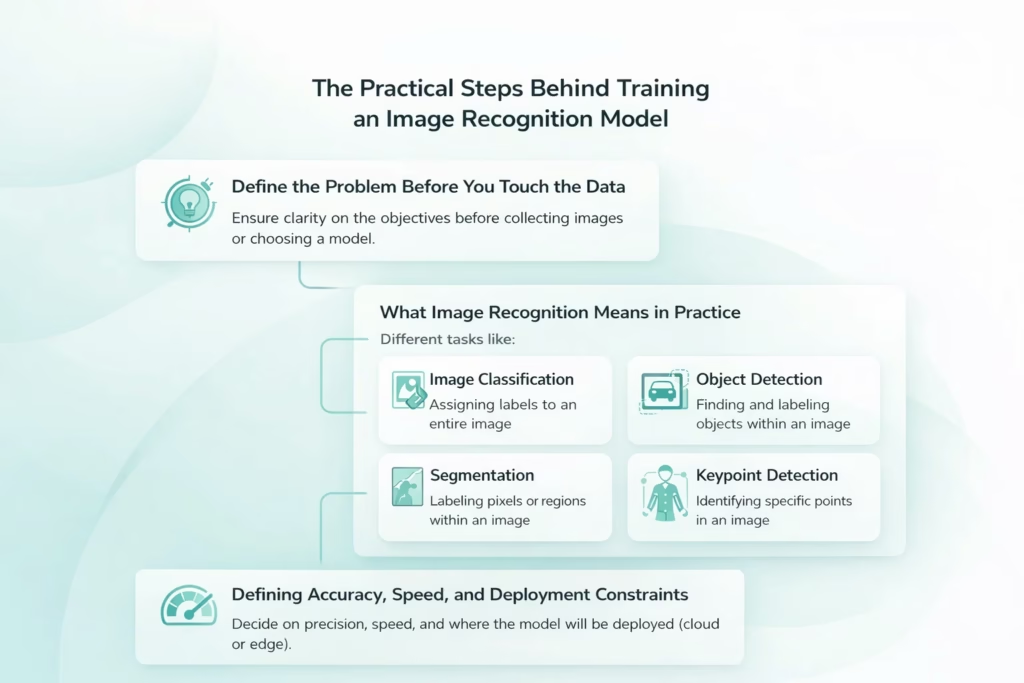

ステップ1: データに触れる前に問題を定義する

画像を収集したりモデルを選択したりする前に、システムが何をすべきかを明確にする必要があります。これは当たり前のことのように聞こえますが、多くのプロジェクトが静かに頓挫してしまう原因です。目標が曖昧だと、間違ったデータ、間違ったラベル、そして間違った評価基準が生まれてしまいます。.

画像認識の実際の意味

画像認識は単一のタスクではありません。システムに何を生成させたいかによって、さまざまな形態をとることができます。.

- 画像分類。画像全体に 1 つ以上のラベルを割り当てます。.

- オブジェクト検出。画像内のオブジェクトを見つけ、その位置とカテゴリを識別します。.

- セグメンテーション。境界ボックスを描画する代わりにピクセルまたは領域にラベルを付けます。精度が重要な場合によく使用されます。.

- キーポイント検出。関節、ランドマーク、参照マーカーなど、画像内の特定のポイントを識別します。.

これらのアプローチはそれぞれ異なるトレーニング設定、アノテーション戦略、そして評価方法を必要とします。画像分類用にトレーニングされたモデルが、そのまま物体検出に使えるとは限りません。出力の構造が、その後のすべてを決定します。.

精度、速度、展開の制約の定義

タスク自体に加えて、システムにどの程度の精度が必要かを決定する必要があります。大まかな分類で十分でしょうか、それともピクセルレベルの精度が必要でしょうか?精度よりも速度が重要ですか?モデルはクラウドで実行するのでしょうか、それともリソースが限られたエッジデバイスで実行するのでしょうか?

これらの質問に早期に答えることで、過剰なエンジニアリングを防ぎ、トレーニング プロセスの後半で適切なトレードオフを選択するのに役立ちます。.

ステップ2:現実世界を反映するデータを収集する

画像認識モデルは、提示されたものだけを学習します。トレーニングデータが実際の使用状況を反映していない場合、展開後にパフォーマンスが低下します。.

優れたデータセットは、単に規模が大きいだけではありません。代表的なデータセットです。.

つまり、次のようになります。

- 異なる照明条件下で撮影された画像

- 角度、距離、視点のバリエーション

- 異なる背景と環境

- 部分的な閉塞と重なり

- ぼやけ、ノイズ、圧縮アーティファクトなどの実際の欠陥

よくある間違いは、クリーンで理想的な画像でトレーニングを行い、乱雑な環境でもモデルが動作すると期待することです。実際のカメラは、キュレーションされたデータセットのようには動作しません。.

もう一つのよくある問題は、クラスの不均衡です。あるカテゴリが他のカテゴリよりもはるかに頻繁に出現する場合、モデルはそのカテゴリを優先するように学習します。理論上は高い精度が得られる一方で、稀ではあるものの重要な事例を見逃してしまう可能性があります。この段階では、現実を反映しない膨大なデータセットよりも、現実を反映した画像を少数用意する方が効果的です。.

ステップ3: データセットを適切に準備して構造化する

画像が収集されたら、モデルが実際に学習できるような形で整理する必要があります。ここで規律が重要になります。この段階での小さな近道は、後々の学習動作に混乱を招きかねません。.

- コアデータセットの構成ルール。トレーニングを開始する前に、画像はいくつかの基本的な構造原則に従う必要があります。.

- 画像間の一貫性。すべての画像は、形式と解像度が一貫している必要があります。画像サイズ、色空間、またはファイルタイプが混在すると、不要なばらつきが生じ、学習の速度が低下します。.

- データセットの明確な分割。画像はトレーニング セット、検証セット、テスト セットに明確に分割され、重複がないようにする必要があります。.

- 分割間で重複データはありません。異なる分割間で重複またはほぼ重複した画像があると、誤解を招く評価結果が生じ、モデルのパフォーマンスに対する誤った信頼性が生じます。.

推奨されるトレーニング、検証、テストの分割

典型的なデータセットの分割は次のようになります。

トレーニングセット

通常、データセット全体の60~80%です。ここでモデルはパターンと特徴を学習します。.

検証セット

通常10~20%。トレーニング中のハイパーパラメータの調整とパフォーマンスの監視に使用されます。.

テストセット

通常10~20%。最終評価のみに使用されます。.

テストセットは最後までそのまま残しておくべきです。トレーニング中に意思決定のガイドとしてテストセットを使用すると、本来の目的が達成されません。.

前処理と正規化

トレーニングを始める前に、画像にも前処理が必要です。これには通常、画像を固定の入力サイズにリサイズし、ピクセル値を正規化することが含まれます。.

正規化により、入力値を予測可能な範囲内に保つことで、モデルの収束が速くなり、さまざまな画像間での動作の一貫性が向上します。.

データセットの構造が適切でないと、後でデバッグするのが難しい微妙な問題が発生するため、このステップで速度を落とすと全体的に時間が節約されます。.

ステップ4:ラベルと注釈を慎重に付ける

アノテーションの品質はモデルのパフォーマンスに直接影響します。モデルは意図を学習するのではなく、ラベルからパターンを学習します。.

分類タスクでは、ラベルは明確でなければなりません。2つのクラスが概念的に重複している場合、モデルがどれほど高度であっても、うまく機能しません。.

オブジェクトの検出とセグメンテーションでは、注釈の精度がさらに重要になります。

- 境界ボックスはタイトで一貫性があるべきである

- オブジェクトを見逃したり、一貫性のないラベルを付けたりしてはならない

- エッジケースは明確なルールに従う必要がある

大規模なラベル付けを始める前に、アノテーションガイドラインを文書化しておく必要があります。そうしないと、同じ画像でもアノテーターによって解釈が異なってしまいます。.

AI支援によるラベリングは作業をスピードアップさせますが、人間によるレビューは依然として不可欠です。小さなアノテーションエラーはノイズとなり、すぐに蓄積されます。後からモデルが混乱しているように見える場合、問題はアーキテクチャではなくラベルにあることが多いのです。.

ステップ5: データ拡張を使用して一般化を改善する

強力なデータセットであっても、拡張の恩恵を受けることができます。拡張は、追加の画像収集を必要とせずに、トレーニングデータに制御されたバリエーションを導入し、モデルがより堅牢な視覚パターンを学習するのに役立ちます。.

一般的な手法としては、画像の回転や反転、スケールや切り抜き領域の調整、明るさやコントラストの調整、少量のノイズやぼかしの導入などが挙げられます。これらの変更はいずれも、画像の基礎となる構造を維持しながら、モデルをわずかに異なる視覚条件にさらします。.

目的は画像をランダムに歪めることではありません。拡張は、モデルが展開後に遭遇する可能性のある種類の変化をシミュレートする必要があります。例えば、医療画像を回転させることはある状況では適切かもしれませんが、テキスト認識画像を反転させると意味が損なわれてしまいます。何が効果的かは、問題領域によって完全に異なります。.

拡張を慎重に適用すると、過剰適合が軽減され、モデルがこれまでに見たことのない画像に一般化する能力が向上します。.

ステップ6: タスクに適したモデルアーキテクチャを選択する

モデルの選択は重要ですが、多くの人が考えるほど重要ではありません。よく訓練されたシンプルなモデルは、訓練が不十分な複雑なモデルよりも優れたパフォーマンスを発揮することがよくあります。.

ほとんどの画像認識タスクにおいて、畳み込みニューラルネットワークは依然としてベースラインとなっています。ResNetやEfficientNetなどのアーキテクチャは、優れたパフォーマンスと柔軟性を提供します。.

特にリアルタイム検出など、速度が重要となる場合は、YOLOのようなシングルショット検出器がよく使用されます。これらの検出器は、速度と簡便性のために、ある程度の精度を犠牲にしています。.

Vision Transformerは、大規模で多様なデータセット、特に高解像度画像に対して優れた結果をもたらします。しかし、より多くのデータと計算量を必要とするため、必ずしも実用的とは限りません。.

多くの場合、転移学習が最適な選択肢です。事前学習済みのモデルから始めることで、特にラベル付きデータが限られている場合に、時間を節約し、結果を向上させることができます。.

ステップ7: 意図的な設定でモデルをトレーニングする

トレーニングは、ただ実行ボタンを押して待つだけではありません。モデルの学習方法は、安定性、速度、そして最終的なパフォーマンスに直接影響を与える少数のパラメータに依存します。.

学習を形作るコアトレーニングパラメータ

トレーニング中は複数の設定が連携して機能します。それぞれの設定は、モデルの更新方法やエラーへの対応方法に影響します。.

学習率とトレーニングの安定性

学習率は、モデルが内部の重みを更新する速度を制御します。設定値が高すぎると、トレーニングが不安定になり、収束に失敗する可能性があります。一方、設定値が低すぎると、学習速度が低下し、モデルは意味のある改善を示さない弱い解に陥る可能性があります。.

バッチサイズとリソースバランス

バッチサイズは、学習の安定性とメモリ使用量の両方に影響します。バッチサイズが大きいほど、更新はスムーズになりますが、より多くの計算リソースが必要になります。バッチサイズが小さいほど、更新にばらつきが生じ、汎化に役立つ場合もありますが、収束が遅くなる場合もあります。.

エポック数とトレーニング期間

エポック数によって、トレーニングの継続期間が決まります。エポック数が少なすぎるとモデルのトレーニング不足に陥る可能性があります。一方、エポック数が多すぎると、検証データでパフォーマンスの向上が止まり、過剰学習につながる可能性があります。.

最適化装置の選択と収束挙動

オプティマイザーの選択は、モデルが損失ランドスケープをどれだけ効率的にナビゲートするかに影響します。オプティマイザーによって勾配、モメンタム、学習ダイナミクスの処理方法が異なり、トレーニングの挙動が著しく変化する可能性があります。.

トレーニングと検証信号の監視

トレーニングと検証の両方の損失を追跡することは、プロセス全体を通して不可欠です。トレーニングの精度は向上し続け、検証のパフォーマンスは停滞または低下する場合、過剰適合が発生している可能性があります。.

忍耐が実を結ぶのはまさにこの時です。一度に複数の変数を変更して混乱を招くのではなく、一度に1つのパラメータを調整することで、実際に何が結果を改善しているのかを理解しやすくなります。.

ステップ8: 過剰適合を防ぐために正規化を適用する

過学習は画像認識における最も一般的な問題の一つです。モデルはトレーニングデータでは良好なパフォーマンスを発揮しますが、新しい画像では失敗します。.

正規化技術はこれを制御するのに役立ちます。

- ドロップアウトはモデルを複数の特徴量に依存させる

- L1とL2のペナルティは重みが大きくなりすぎないようにする

- 早期停止は過剰最適化の前にトレーニングを停止します

これらの手法は、不良データを修正するものではありません。データセットが既に堅牢な場合に最も効果的に機能する安全策です。.

適切に一般化されたモデルは、トレーニング中はそれほど印象的ではないものの、重要な部分では優れたパフォーマンスを発揮することがよくあります。.

ステップ9:適切な指標で評価する

正確さだけでは全体像を把握することは稀です。特に、データセットのバランスが崩れている場合は、誤解を招く可能性があります。.

より良い評価には以下が含まれます。

- 誤検知を理解する精度

- 見逃した検出を理解するためのリコール

- 両者のバランスをとるF1スコア

- クラスレベルの問題を特定するための混同マトリックス

- バイナリ分類問題のためのAUC-ROC

オブジェクト検出では、Intersection over Union や平均精度などのメトリックが不可欠です。.

評価は常に、モデルが使用したことのないデータに基づいて行う必要があります。そうしないと、結果に誤った信頼性が生じます。.

ステップ10: 現実的な条件で検証する

画像認識モデルがデプロイ後にどのように動作するかを理解するには、オフラインのメトリクスだけでは不十分です。実際の運用に近い環境で検証を行う必要があります。.

オフラインベンチマークを超えたテスト

現実的な検証とは、静的なテスト画像ではなく、ライブカメラフィードやリアルタイムデータストリームを用いて推論を実行することを意味します。また、特にリソースが限られたエッジデバイスを含むデプロイメントの場合、異なるハードウェア構成でモデルをテストすることも必要になります。.

変化するシステム負荷下におけるパフォーマンス評価も同様に重要です。単独では良好なパフォーマンスを発揮するモデルでも、大量のデータを処理したり、他のサービスと連携して動作したりすると、動作が大きく異なる可能性があります。この段階で障害事例を手動で確認することで、自動化されたメトリクスでは見逃されるパターンが明らかになることがよくあります。.

多くの問題はこの段階で初めて発生します。レイテンシの急上昇、メモリ制約、予期せぬエッジケースなどにより、モデルの実際の動作が変化する可能性があります。検証は、理論上のパフォーマンスが現実世界の挙動に取って代わられる段階であり、最終的な調整が最も重要になることが多い段階です。.

ステップ11: 仮定ではなく証拠に基づいて反復する

最初の試行で正しいモデルはほとんどないため、反復処理が必要になります。.

優れた反復は分析によって推進されます。

- 偽陽性と偽陰性を確認する

- 欠落データのパターンを特定する

- ラベルや拡張戦略を調整する

- ハイパーパラメータを慎重に微調整する

アーキテクチャを微調整するよりも、データを追加する方が効果的であることが多いです。特に、障害事例を表すデータは効果的です。反復処理は不確実性を低減するものであり、ランダム性をもたらすものではありません。.

ステップ12:時間をかけて維持し、再トレーニングする

画像認識モデルは静的なシステムではありません。環境は変化し、センサーは進化し、実世界の使用状況はほぼ一定ではありません。継続的な注意を払わなければ、強力なモデルであっても徐々に精度を失っていきます。.

メンテナンスが継続的な要件である理由

モデルがデプロイされると、新しいデータパターンとのやり取りが始まります。照明、天候、カメラのハードウェア、ユーザーの行動など、様々な変化によって、元のトレーニングセットと比較して画像の見え方が変化する可能性があります。そのため、継続的なメンテナンスは必須であり、必須ではありません。.

モデルのパフォーマンスの監視

パフォーマンスを長期にわたって追跡することで、すぐにアラートがトリガーされない可能性のある、徐々に低下する精度を把握できます。画像認識システムでは、サイレントデグラデーションはよく見られ、定期的な監視がなければ気づかれないことがよくあります。.

新しい代表的なデータの収集

状況の変化に応じて、新しいデータを取得し、レビューする必要があります。これにより、トレーニングデータセットが古い仮定ではなく、実際の使用状況を反映し続けることが保証されます。.

更新されたデータセットによる再トレーニング

再トレーニングにより、モデルは新しい例を取り込み、新たな弱点を修正することができます。パフォーマンスが大幅に低下するまで待つよりも、段階的に再トレーニングを行う方が効果的であることが多いです。.

監査の偏りとデータのドリフト

定期的な監査は、予測を徐々に歪める可能性のあるバイアス、クラスの不均衡、データドリフトを検出するのに役立ちます。これらの問題を早期に解決することで、さまざまな環境や集団においてモデルの信頼性を維持できます。.

最初から再トレーニングを計画しているチームは、長持ちするシステムを構築する傾向があります。失敗に反応するのではなく、画像認識を学習するデータとともに改善していく生きたプロセスとして扱います。.

最後に

画像認識モデルの学習は、完璧さを追い求めることではありません。信頼性の高い学習を行い、時間の経過とともに適応し、現実世界で予測通りに動作するシステムを構築することです。.

強力な結果は、思慮深いデータ収集、慎重なラベル付け、合理的なモデルの選択、誠実な評価といった基礎が適切に行われることで生まれます。.

これらの要素が揃ったら、モデルは派手である必要はありません。ただ機能すればいいのです。.

そして、一度うまく機能すると、状況が変わっても機能し続ける傾向があります。.

よくある質問

タイムラインは、タスクの範囲、データセットのサイズと品質、そして事前学習済みモデルを使用するかどうかによって異なります。単純な分類モデルであれば数日から数週間で学習できますが、より複雑な物体検出やセグメンテーションシステムでは、データの準備、検証、反復処理などを含め、数週間から数か月かかることがよくあります。.

決まった数はありません。モデルによっては、特に転移学習を用いた場合、数千枚の高品質画像で良好なパフォーマンスを発揮するものもあれば、信頼性の高い一般化を行うために数万枚、数十万枚の画像を必要とするものもあります。量よりも重要なのは、データが現実世界の状況やエッジケースを反映しているかどうかです。.

いいえ。ほとんどの場合、事前学習済みのモデルから始める方がより良い選択肢です。転移学習は学習時間を短縮し、限られたデータでのパフォーマンスを向上させ、インフラコストを削減します。ゼロからの学習は、通常、高度に専門化された分野や非常に大規模なデータセットに限られます。.

データ品質の低さは最も一般的な問題です。ラベルの不一致、エッジケースの欠落、非現実的なトレーニング画像、データセット間のデータ漏洩などは、モデルの選択やハイパーパラメータの設定よりも大きな損害を引き起こすことがよくあります。.

過学習は、トレーニングパフォーマンスが継続的に向上する一方で、検証パフォーマンスの向上が止まるか低下し始める場合によく見られます。これは、モデルがトレーニングデータに過度に近づきすぎて、新しい画像への一般化に失敗していることを示しています。.