OpenClawは、ただの派手な名前のチャットインターフェースではありません。ファイルの読み取り、ツールの呼び出し、そして既に使用しているアプリ内での応答など、AIエージェントの制御レイヤーに近いものです。そのパワーこそがOpenClawの真髄であり、軽視すべきではない理由でもあります。ロゴが違うChatGPTのように捉えると、OpenClawの真価を見失ってしまいます。インフラのように捉えれば、真の力を発揮できるでしょう。.

OpenClawがチャットをアクションに変える方法

OpenClawは、アドオンを備えた単なるチャットインターフェースではありません。チャットプラットフォーム、AIモデル、アクションレイヤーを1つの制御されたシステムに接続するローカルゲートウェイとして機能します。TelegramやSlackなどのツールにリンクし、Ollama経由でローカルで実行されているモデル、またはOpenAIやAnthropicなどのクラウドプロバイダー経由でモデルに接続し、永続的なローカルメモリを介してファイルアクセス、API、スクリプト実行を管理します。すべてがこの単一のゲートウェイを介して流れます。.

実際には、チャットを通じてメッセージが届き、エージェントがそれを評価し、必要に応じてツールを呼び出し、構造化された結果を返します。ログの読み取り、エラーの要約、チケットの作成、CRMレコードの更新、事前定義されたスクリプトの実行などが可能です。コンテキストはセッション間で引き継がれるため、OpenClawは単なるアシスタントではなく、運用レイヤーとして機能します。.

FlyPix AIと現実世界のAI自動化

で フライピックスAI, では、AIエージェントを異なる領域に適用していますが、原理は同様です。自動化は、実際の運用データに直接接続することで初めて価値を生み出します。当社のプラットフォームは、衛星画像、航空画像、ドローン画像に特化しており、AIモデルが大規模な物体の検出、監視、検査を行います。手作業によるアノテーションの代わりに、物体を正確に識別し、輪郭を描くようにトレーニングされたモデルを用いて、地理空間分析を自動化します。.

私たちは、最初から実用性を重視したシステムを構築しています。ユーザーは深いプログラミング知識がなくてもカスタムAIモデルを学習し、独自のアノテーションを定義し、建設、農業、インフラ整備、政府プロジェクトなど、様々な業界に適用できます。焦点は抽象的な知能ではなく、複雑な視覚環境における測定可能な効率性にあります。.

FlyPix AIは以下でもご覧いただけます。 リンクトイン ぜひこちらからご連絡ください。当社にとってAIとは、単なる実験ではありません。視覚的なデータを、チームが実際の業務で自信を持って活用できる構造化された結果へと変換することです。.

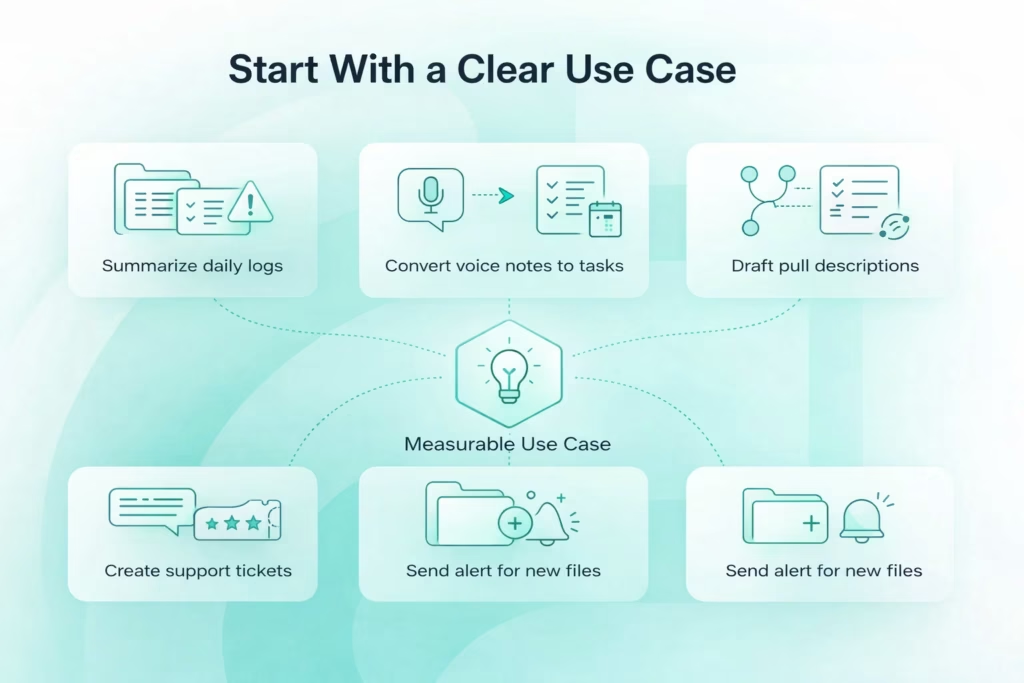

明確なユースケースから始める

OpenClawでよくある最大の間違いはシンプルです。まずインストールしてから後で考えてしまうことです。システムが稼働しているにもかかわらず目的が明確でないと、本当の問題を解決するどころか設定を調整することになってしまいがちです。何かをインストールする前に、測定可能なユースケースを1つ定義しましょう。それが機能するかどうかを明確に判断できるほど具体的なものでなければなりません。効果的な最初のターゲットは、通常、以下のようなものです。

- 特定のフォルダから毎日のログを要約し、最新の重大なエラーを強調表示します

- Telegramの音声メモをタイトルと期限付きの構造化されたタスクに変換する

- リポジトリのコンテキストと最近のコミットを使用してプルリクエストの説明を作成します

- 優先度を設定した構造化されたチャット入力からサポートチケットを作成します

- フォルダを監視し、新しいファイルが追加されたときにアラートを送信する

各サンプルには明確なトリガー、定義された入力、そして観測可能な出力があります。この構造により、セットアップの焦点が絞られ、不必要な複雑さを回避できます。まずは狭い範囲から始めてください。目標が漠然としていると、価値を生み出すよりもアーキテクチャの修正に多くの時間を費やすことになります。OpenClawは、測定可能な単一のワークフローに結び付けられることで最も効果的に機能します。ループが安定すると、拡張は実験的なものではなく、意図的なものになります。.

OpenClaw 用にシステムを準備する

インストーラを実行する前に、安定したOpenClawのセットアップが開始されます。これは軽量のチャットプラグインではありません。ファイルの読み取り、ツールの実行、外部モデルへの接続が可能なローカルゲートウェイです。お使いのマシン、ネットワーク、および権限はシステムの一部です。事前に数分間の準備をしておけば、後々何時間もかかるトラブルシューティングを回避できます。.

最低限、Node.jsの最新LTS、使い慣れたターミナル、そしてOpenAIまたはAnthropicのクラウドモデルAPIキー、あるいはローカルモデルを実行する場合はOllamaが必要です。最初のテストにはTelegramが最もシンプルなインターフェースです。ローカルで実行する場合は、ハードウェアを現実的に計画してください。安定したパフォーマンスを得るには、16GBのRAMが妥当な基準です。大規模なモデルの場合は、より多くのRAMが必要になります。.

環境は重要です。会社のノートパソコンに盲目的にインストールしないでください。利便性のためにポートを公開しないでください。絶対に必要な場合を除き、昇格された権限で実行しないでください。OpenClawはローカルファイルを読み取り、アクションを実行します。それがOpenClawの強みです。データに直接アクセスできるシステムと同じように、OpenClawにも注意を払ってください。.

OpenClawのインストールと初期設定

OpenClawは迅速に開発されているため、公式のインストールフローに従うのが最も安全なアプローチです。ここでの目標はシンプルです。ゲートウェイをクリーンかつ予測通りに動作させることです。まだ実験やカスタム調整は行いません。安定した基盤を構築するだけです。.

1. インストール方法を選択する

OpenClawは、現在のディストリビューションに応じて、ブートストラップスクリプトまたはnpm経由でインストールします。どちらの方法も、依存関係のインストールとゲートウェイサービスの登録という同じ目的を達成します。典型的なブートストラップフローは以下のようになります。

| curl -fsSL https://openclaw.ai/install.sh | bash |

npm を好む場合、グローバル インストール パスは簡単です。

| npm インストール -g openclaw@latest |

どちらの方法も複雑ではありません。インストール中にエラーが発生した場合は、中断して解決してから続行してください。クリーンインストールは速度よりも重要です。.

2. オンボーディングプロセスを実行する

インストール後、オンボーディング ウィザードを実行します。

| オープンクローオンボード |

このステップでは、ゲートウェイを設定し、バックグラウンドサービスとして設定します。完了すると、システムはゲートウェイがアクティブであると報告するはずです。この時点で、OpenClaw はインストールされただけでなく、動作可能な状態になります。.

3. コントロールUIにアクセスする

デフォルトでは、コントロール UI (ダッシュボード) は次の場所でローカルに実行されます。

| http://127.0.0.1:18789/ (または http://localhost:18789/) |

ブラウザでそのアドレスを開いてください。すべてが正しく設定されていれば、ダッシュボードが表示されるはずです。読み込まれない場合は、以下をご確認ください。

- ゲートウェイサービスが実行中であることを確認する

- 他のプロセスがポート18789を使用していないことを確認します

- ローカルファイアウォールの設定を確認する

重要なルールが一つあります。ゲートウェイはlocalhostにバインドしておいてください。公開しないでください。コントロールUIは、ローカルファイルにアクセスしたりツールを実行したりできるエージェントを管理します。アクセスを127.0.0.1に制限することで、ビルドとテスト中にコントロールサーフェスを安全に維持できます。.

Telegram統合の設定

TelegramはOpenClawを最も早く起動する方法の一つです。セットアップはシンプルで、APIのプロビジョニングも容易で、数分でメッセージループ全体を検証できます。統合のオーバーヘッドではなく、エージェントのロジックに重点を置きたい初期テストに最適です。.

Telegramを開き、@BotFatherを検索して「/newbot」と入力します。名前を選択し、提供されたAPIトークンをコピーします。OpenClawのオンボーディング中に、プロンプトが表示されたらそのトークンを貼り付けます。保存すると、ゲートウェイがローカルエージェントをTelegramに接続します。正確さが重要です。1文字でも間違えると接続が切断される可能性があります。.

セットアップが完了したら、ボットにテストメッセージを送信し、コントロールUIを確認してください。メッセージが表示され、Telegramに返信が返ってくる場合、ループは正常に動作しています。これにより、ゲートウェイ、モデル、通信層が連携して機能していることが確認できます。ここからは、セットアップから実際のワークフローの構築へと進みます。.

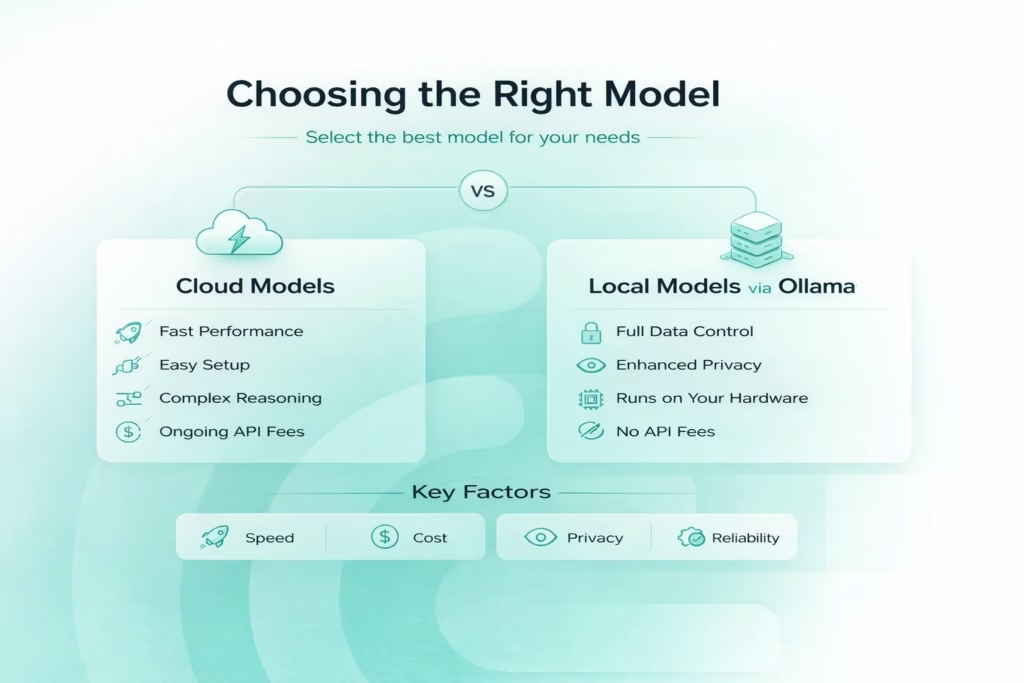

適切なモデルの選択

モデルの選択は、速度、コスト、プライバシー、そして全体的な信頼性に直接影響します。OpenClawは単一のプロバイダーに縛られないという強みがありますが、柔軟性はトレードオフを理解した上で初めて有効となります。クラウドモデルとローカルモデルという2つの主要な選択肢があり、それぞれ異なる運用ニーズに対応します。.

1. クラウドモデル – 高速、強力、低摩擦

クラウドモデルは、ハードウェアを気にすることなく強力な推論性能を実現する最速の方法です。APIキーを接続し、プロバイダーを設定するだけで、エージェントの準備は完了です。クラウドモデルは一般的に以下の用途に最適です。

- 複雑な推論と構造化された意思決定

- コーディングワークフローとデバッグ

- 最小限の設定で迅速なセットアップ

- インフラストラクチャを管理したくないチーム

Claude 3.5 SonnetやGPT-4クラスシステムなどのモデルは、エージェントワークフローを高い信頼性で処理します。これらのモデルは、指示を明確に解釈し、複数段階の推論を適切に管理し、迅速に応答します。トレードオフは明らかです。

- 継続的なAPIコスト

- データはローカル環境外に送信されます

- 外部の稼働時間への依存

多くのユーザーにとっては、これは許容範囲内です。しかし、特に機密性の高い環境では、そうではないかもしれません。.

2. Ollamaによるローカルモデル - 制御と封じ込め

プライバシーと自律性が重要であれば、Ollamaを介してローカルモデルを実行するのが理にかなった選択です。この設定では、モデルはマシン上に残ります。外部API呼び出しやネットワーク外へのデータ流出はありません。以下の用途に最適です。

- データに敏感なワークフロー

- 開発環境

- オフライン機能

- 実行を完全に制御

Ollamaは、Qwen2.5-Coder、GLM-4シリーズ、Llama 3.1/3.2の派生モデルなど、エージェントに適した大きなコンテキストウィンドウを持つモデルをサポートしています。OpenClawでは、コンテキストのサイズが重要です。.

エージェントはメモリ管理をモデルのコンテキストウィンドウに依存しているため、ウィンドウが小さいとセッションが長くなると一貫性が低下する可能性があります。安定した推論を行うための実用的なベースラインは32k~128kのコンテキストウィンドウです(モデルによって異なります。OpenClawに推奨される多くのOllamaモデルは32k~128kから始まります)。.

パフォーマンスはハードウェアに依存します。応答速度が遅くなったり、ツールの呼び出しが遅れたりする場合、通常は設定エラーではなく、リソースの制約が原因です。重要なのは、利用可能なメモリと処理能力に適したモデルを選択することです。.

3. 実践的な選択をする

普遍的な答えはありません。高度な推論にはクラウドモデルを使用し、開発や機密性の高いタスクにはローカルモデルを使用するチームもあれば、どちらか一方のアプローチに固執するチームもあります。以下の点に基づいて選択してください。

- データの機密性

- パフォーマンス要件

- 予算の制約

- ハードウェア機能

適切なモデルは、応答性を向上させるだけでなく、ワークフロー全体を安定化させます。モデルレイヤーが運用ニーズに適合している場合、OpenClawは予測どおりに効率的に動作します。.

永続メモリの理解

永続メモリは、OpenClawを一般的なチャットアシスタントと一線を画す機能の一つです。毎回新規に開始するのではなく、SQLiteを使用してインデックスを作成し、チャンク化されたMarkdownファイルを信頼できる情報源として利用し、ハイブリッド検索(BM25 + ベクトル埋め込み)を使用して永続メモリをローカルに保存します。これは単なるチャットログではありません。エージェントが後で意思決定を行う際に参照できる、整理されたコンテキストです。.

例えば、エージェントに「社内ダッシュボードではReactとTailwindを使用しています。関数型コンポーネントを優先してください」と指示したとします。数日後、ヘッダーコンポーネントの作成を依頼します。記憶が正しく機能していれば、エージェントは以前の設定を繰り返すことなく、その設定に従います。この連続性は、記憶されたコンテキストが推論プロセスにフィードバックされることで実現されます。.

効率性は時間とともに向上していきます。セッションごとに命令を書き換えるのではなく、システム内に永続的なコンテキストを蓄積していきます。保存されているメモリを定期的に確認し、何が保存されているかを確認することは重要です。メモリの仕組みを理解することで、ワークフローが拡大してもエージェントの一貫性と予測可能性を維持できます。.

最初の本格的なワークフローを構築する

接続が安定したら、会話から実行に移ります。OpenClawは、単に自由回答形式の質問に回答するだけでなく、構造化されたタスクを実行することで実用的になります。そのためには、エージェントが何をすべきか、そしてどのように結果を確認すべきかを明確に理解できるよう、ワークフローを明確に定義する必要があります。信頼性の高いワークフローには、常に以下の4つの要素が含まれます。

- トリガー: Telegram で「新しいチケット」と入力するなど、プロセスをアクティブ化する特定のコマンドまたはイベント。.

- 入力構造: エージェントがタスクを完了するために必要な正確なデータ (タイトル、説明、緊急度など)。.

- ツールの実行: チケット システム API へのリクエストの送信など、エージェントによって実行される定義済みのアクション。.

- 確認出力: チケット ID と短い概要を返すなど、完了を証明する構造化された応答。.

チケット自動化を簡単な例として考えてみましょう。「新しいチケット」と入力すると、エージェントは必須フィールドを収集し、APIを呼び出して確認応答を返す必要があります。推測や思い込みは一切不要です。明確なトリガーと構造化された入力によって、プロセスの信頼性が維持されます。まずは1つのワークフローに絞り込み、安定させ、その後、段階的に拡張していくのが理想的です。.

実際の環境でのOpenClawの操作

最初のワークフローが安定したら、実際の使用が始まります。OpenClaw が日常業務の一部となるか、技術的な実験段階にとどまるかは、この時点で決まります。違いは、自動化を追加することではなく、既存のプロセスが実際の状況下でどのように動作するかを観察することです。実際に実行し、さまざまな入力でテストを行い、エッジケースへの対応状況を確認してから、さらに拡張を進めてください。.

日常的な使用においては、可視性が重要です。コントロールUIでアクティビティを確認し、どのツールがトリガーされているか、出力がどのように構成されているかを確認してください。結果に一貫性がないと感じる場合、原因は通常、モデルの制限ではなく、スコープの逸脱や指示の不明確さです。構造を少し改良するだけで、モデル自体を変更するよりも安定性が向上することがよくあります。.

拡張は慎重に行う必要があります。新しいタスクを徐々に追加し、既存のプロセスから分離して、予測可能な状態になるまで進めてください。OpenClawは、ワークフローが明確に区切られ、メモリが適切に管理されている場合にのみ、最高のパフォーマンスを発揮します。日常的な使用は、常に実験を行うことではありません。理解し、自信を持って管理できるAIシステムを、制御された方法で拡張していくことが重要です。.

実践的なアドバイスと避けるべきよくある間違い

OpenClawは、何ヶ月もスムーズに動作することもあれば、常にトラブルシューティングに追われる状態になることもあります。その違いは、多くの場合、規律にかかっています。多くの問題はモデル自体に起因するものではなく、設定の決定、スコープの不明確さ、あるいは境界の見落としなどから生じます。以下は、安定したデプロイメントと脆弱なデプロイメントを分ける、最も一般的な落とし穴とパフォーマンスの習慣です。.

避けるべき運用上のミス

これらは実際の導入で繰り返し見られるパターンです。システムを直ちに破壊することはないかもしれませんが、時間の経過とともにリスクと不安定性を生み出します。.

- 承認なしに企業のデバイスにインストールする: OpenClaw はローカル ファイルを読み取り、データを外部モデルに送信することができますが、これは内部ポリシーに違反する可能性があります。.

- レビューなしで独自のコードをクラウド モデルに取り込む: API を介して送信される機密データは、コンプライアンスとセキュリティに関する懸念を引き起こす可能性があります。.

- 無制限のファイルシステムアクセスを許可する: 絶対に必要な場合を除き、エージェントはホーム ディレクトリ全体にアクセスしないでください。.

- 利便性のためにゲートウェイ ポートを公開する: ポート 18789 を公開すると、実際のメリットがないにもかかわらず、攻撃対象領域が拡大します。.

- 記憶を絶対確実なものとして扱う: 永続的なメモリは強力ですが、確認しないと、古くなったコンテキストや間違ったコンテキストが保存される可能性があります。.

- 最初のワークフローを過度に複雑にする: 単純なタスクではなく、複数のステップの自動化から始めると、構成エラーが増加します。.

基本原則はシンプルです。範囲を狭くし、権限を制限し、安定性が証明されたら徐々に拡張します。.

パフォーマンスと安定性の最適化

パフォーマンスに一貫性がないと感じる場合、原因は謎ではなく構造的なものであることが多いです。OpenClawは、モデルの容量、メモリ管理、そしてプロンプトの明瞭性に依存しています。小さな調整で、通常は目に見える違いが現れます。.

- ローカルで実行するときにモデルのサイズを縮小します。 モデルが大きくなるほど、より多くのメモリと処理能力が必要となり、レイテンシが増加します。.

- 可能な場合は使用可能な RAM を増やします。 システムに十分な余裕がある場合、ローカル推論は改善されます。.

- 過剰なメモリ蓄積をクリーンアップします。 大量のコンテキストが保存された長時間実行されるセッションでは、処理が遅くなる可能性があります。.

- ツール呼び出しループを制限する: ツール呼び出しを繰り返したりネストしたりすると、不要な遅延が発生する可能性があります。.

- 自由形式の指示の代わりに構造化されたプロンプトを使用します。 明確な入力によりトークンの使用量が減り、応答の精度が向上します。.

命令のスコープが明確化され、リソースがワークロードに合わせて調整されると、パフォーマンスが向上します。OpenClaw は継続的なチューニングを必要としません。必要なのは、綿密な構成と現実的な予測です。これらが適切に実行されていれば、システムは効率的で予測可能な状態を維持できます。.

結論

OpenClaw は、チャットボットとしてではなく、インフラとして扱うようになった瞬間に強力になります。巧妙な返答ではなく、制御された実行こそが重要です。明確な目的を定義し、ゲートウェイを適切に設定し、適切なモデルを選択し、最初のワークフローを慎重に構築すると、システムは実験的なものではなく、より実用的になります。.

鍵となるのは規律です。最初はスコープを狭く保ち、環境を保護しましょう。確実に機能するワークフローを一つ構築し、その後拡張していくのです。OpenClawは明確さを重視します。入力と権限が明確であればあるほど、結果の予測可能性が高まります。正しく使用すれば、OpenClawは単なるツールが付属したメッセージングレイヤーではなく、実際の業務に統合できる制御可能なAI実行レイヤーとなります。まさにそこにこそ、OpenClawの価値が発揮されるのです。.

よくある質問

公式コマンドに従えば、インストール自体は簡単です。多くの問題は技術的な複雑さではなく、目的が明確でないことに起因しています。インストール前に具体的なワークフローを定義しておくと、セットアップがはるかにスムーズになります。.

はい、Ollama経由でローカルモデルを使用する場合は可能です。この構成では、モデルとゲートウェイはお客様のマシン上で実行されます。外部API呼び出しは必要ありません。ただし、パフォーマンスはハードウェアの性能に依存することにご注意ください。.

それは組織のポリシーによって異なります。OpenClawはローカルファイルを読み込んだり、外部モデルとやり取りしたりできます。承認なしに企業のデバイスにインストールすると、社内のセキュリティルールに違反する可能性があります。個人用マシンまたは専用環境を使用することをお勧めします。.

ログの要約、構造化されたメッセージの作成、チケットの作成など、測定可能でリスクの低いものから始めましょう。初期段階では、複雑で複数ステップの自動化は避けてください。この段階では、野心よりも安定性が重要です。.

永続メモリにより、エージェントはセッション間でコンテキストを保持できるため、継続性が向上します。ただし、コンテキストウィンドウが大きくなり、セッションが長くなると、特にローカルモデルの場合、リソース使用量が増加する可能性があります。保存されたメモリを定期的に確認することで、明確さと効率性を維持することができます。.