OpenClawは、Telegram、WhatsApp、Discord、Slack、iMessageなど、普段使っているチャットアプリに常駐するオープンソースのパーソナルAIアシスタントです。友達にメッセージを送るのと同じようにメッセージを送るだけで、メールの読み書き、送信、カレンダーの管理、ウェブ検索、ファイルの整理、ターミナルコマンドの実行、航空券の予約など、様々な機能を実行できます。.

プログラム自体は無料でダウンロードして使用できます。実質的なコストは通常、それを動かすAIモデル(Claude、GPT、Geminiなど)から発生します。Claude Opusのようなツールを非常に負荷の高いタスクでノンストップで実行すると、費用は急速に上昇する可能性があります。しかし、ほとんどの人はそのようなコストを必要としませんし、セットアップ全体のコストを現在も長期的にも$0に抑える実用的な方法がいくつかあります。.

Openclaw とは何ですか?

OpenClawは、Telegram、WhatsApp、Discord、Slack、iMessage、Signalなどの一般的なチャットアプリに内蔵された、無料のオープンソースAIアシスタントです。友達にメッセージを送るのと同じようにメッセージを送信するだけで、メールの読み書き、カレンダーの管理、Google検索、パソコン上のファイル整理、ターミナルコマンドの実行、航空券の予約、ブラウザの操作など、様々な機能を実行できます。長い会話を記憶し、スケジュールに従って自動的に作業を進め、リクエストに応じて新しいスキルを学習することも可能です。.

このプログラムは永久に100%無料です。サブスクリプションや追加料金は一切ありません。一度ダウンロードすれば、ご自身のコンピューターまたは安価/無料のサーバーで実行できます。費用が発生するのは、接続するAIブレイン(Claude、GPT、Gemini、または無料のローカルモデルなど)のみです。だからこそ、2026年現在、多くの人がOpenClawを完全に無料で実行しています。ラップトップ上のローカルモデル、無料のOracle Cloudサーバー、またはプレミアムAI用のスタートアップクレジットなどを利用しています。.

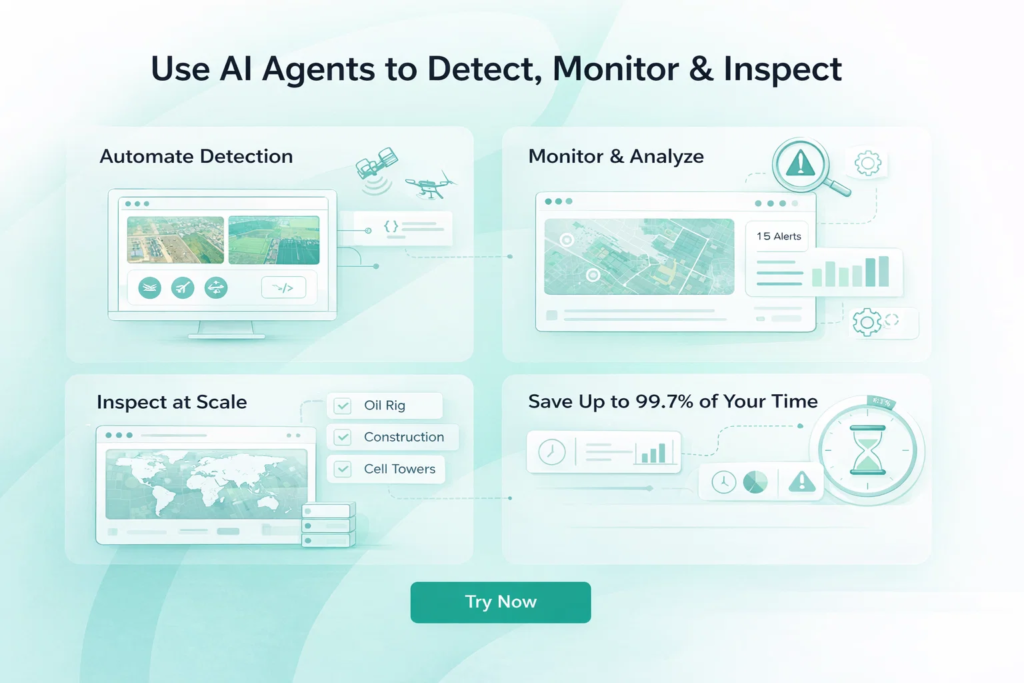

FlyPix AI: 地理空間データに関するワークフローを効率化

私たちのチーム フライピックスAI は、衛星画像やドローン画像における物体の検出と監視を自動化することで、お客様の時間を最大99.7%(正確には99.7%)節約することを目指しています。建設工事の進捗状況を追跡したり、農作物の生育状況を監視したりする場合でも、複雑な地理空間分析は当社のプラットフォームが自動処理するため、お客様は手間を省くことができます。しかし、物体を検出しただけでは仕事は終わりません。レポートの作成、ファイルの整理、チームの同期のスケジュール設定など、まだやるべきことが残っています。.

OpenClawのような無料ツールを日々の業務に取り入れることは、その効率性をさらに高める最適な方法です。ローカルAIモデルを実行することで、FlyPix AIが重視する高いデータプライバシー基準を維持しながら、地理空間調査に伴う管理作業を自動化できます。高精度な自動画像分析とローカルホストのパーソナルアシスタントを組み合わせることで、林業、農業、インフラ整備の専門家は、手作業によるデータ管理に煩わされることなく、重要な意思決定に集中できると考えています。.

オプション1. Ollamaですべてをローカルで実行する

最もプライベートかつ真に自由な方法は、Ollama を使用してすべてを自分のコンピュータ上で実行することです。.

Ollamaを使えば、オープンソースのAIモデルを自分のマシンで直接実行できます。OpenClawはクラウドAPIと通信しているように見えますが、実際にはすべてローカルに保存されており、Web検索を要求しない限り、何もコンピュータから出ません。.

必要なハードウェア

- Mシリーズチップと16GBのRAMを搭載したApple Macが最低限のスペックです。より小型の32GBモデルでも問題なく動作します。.

- 24 GB VRAM を搭載した NVIDIA RTX 3090/4090 (または同等品) は、32~34B モデルで快適な速度を実現します。.

- 48 GB 以上の VRAM を搭載したサーバーグレードの GPU により、最大規模のオープン モデルでもスムーズに実行できます。.

設定方法

OpenClawでOllamaを設定するのはとても簡単で、数分で完了します。分かりやすい英語で書かれたステップバイステップのガイドをご覧ください。.

- Ollamaをインストールする

- 良いモデルをダウンロードする

- ターミナル (またはコマンド プロンプト) を開き、次のように入力します。 オラマ プル クウェン2.5:32b

- OpenClaw にローカル モデルを使用するように指示します。 OLLAMA_API_KEY=”ollama-local” をエクスポート”

- OpenClawを通常通り起動する

より良い結果を得るための追加のヒント

- 量子化は重要: Ollama は、VRAM を節約し、品質をあまり損なわずに速度を向上させるために、デフォルトで量子化バージョン (Q4_K_M など) を取得します。.

- コンテキストの長さ: OpenClaw は、長時間のチャットやタスクで良好なメモリを確保するため、少なくとも 64K トークンを必要とします。現在、32B 以上のほとんどのモデルがこれをサポートしています。.

- 速度の調整: 遅い場合は、他のアプリを閉じるか、より小さな量 (Q3/Q4) を使用するか、GPU を使用している場合は –num-gpu フラグを追加します。.

- アップデート: 新しいバージョンについては、ollama pull を再度実行してください。2026 年にはモデルが急速に改善されます。.

オプション2. LM Studio – 同じアイデアだが、インターフェースが優れている

ターミナルでコマンドを入力するのが面倒だったり、古臭いと感じたりする場合は、LM Studio が最適な代替手段です。.

これは Ollama とほぼ同じことを行います (オープンソースの AI モデルをコンピューター上でローカルに実行します) が、すべてはボタン、メニュー、ライブ統計を備えた美しく使いやすいアプリ内で行われます。.

これを「フレンドリーな顔をした Ollama」と考えてください。モデルを検索し、ワンクリックでダウンロードし、GPU または CPU の使用状況をリアルタイムで確認し、ファイルを編集せずに設定を微調整し、大きな緑色のボタンでローカル サーバーを起動できます。.

ハードウェア要件

Ollamaと全く同じです:

- 最小: 16 GB RAM を搭載した Mac M シリーズ (より小さい 32B モデルでも問題なく動作します)。.

- 快適: 32~34B モデルの場合、24 GB VRAM を搭載した NVIDIA RTX 3090/4090。.

- 最高: 最大モデル向けの 48 GB 以上の VRAM を搭載したサーバー GPU。.

設定方法(ステップバイステップ)

- ダウンロードとインストール

- lmstudio.ai にアクセスし、お使いのシステム(Mac、Windows、または Linux)に応じて「ダウンロード」をクリックします。.

- インストーラーを実行する

- モデルを見つけてダウンロードする

- ローカルサーバーを起動します: lms server start –port 1234

- OpenClawをそれに接続: 作成または編集 ~/.openclaw/openclaw.json lmstudioプロバイダーを追加します(正確なJSONについては公式ドキュメントを参照してください – baseUrl: “http://127.0.0.1:1234/v1”, apiKey: “lmstudio”)。その後、OpenClawを再起動します。.

LM Studioが選ばれる理由

- 端末はまったく必要ありません。すべてがポイントアンドクリックです。.

- さまざまなモデルをすばやく試すのは非常に簡単です (電子メールの並べ替えやファイルの整理などのタスクに最適なモデルを確認するために、一晩で 3 ~ 4 つのモデルをテストする場合に最適です)。.

- モデルを OpenClaw に接続する前にすぐにテストするためのチャット ウィンドウが組み込まれています。.

- メモリ使用量、速度、温度を示すわかりやすいグラフで、ハードウェアが正常かどうかがすぐにわかります。.

- ワンクリックでモデルを更新し、簡単に切り替えることができます。.

これは、初心者や、コマンドラインを学習せずにスムーズな操作を望む人にとって特に適しています。.

オプション3. 無料の短期クラウドクレジットとトライアル

いくつかの企業では、新規ユーザーに OpenClaw で使用できる無料クレジットまたは計算時間を提供しています。.

実際に使用されている例:

- AMD開発者プログラム: $100 のコンピューティング クレジット。これは、強力な GPU で非常に大規模なオープン モデル (100B 以上) を 40 ~ 60 時間実行するのに十分な量です。.

- いくつかの小規模な推論プラットフォーム: Kimi K2.5 などのモデル用の小さな無料クレジットまたは無料レベル (最近 OpenClaw ユーザー向けに無料になりました)。.

- 大手プロバイダーの新規アカウント: トライアル クレジットでは $5–20 になる場合があります。.

なぜ便利なのか

高価なハードウェアを購入せずに、強力なモデルをテストするのに最適です。短時間で、はるかに優れた品質が得られます。.

落とし穴

クレジットは期限切れになります(通常 30 日または一定額)。そのため、永久に有効というわけではありません。.

オプション4. Oracle Cloud Always Free Tier – 有効期限のない無料サーバー

これは現在最も人気のある、24時間365日利用可能な完全無料のオプションの一つです。サインアップしてアカウントを確認すると、Oracleは永久に(トライアルではなく)以下のサービスを提供します。

- 4つのARMコア

- 24 GBのRAM

- 200 GBのストレージ

これは、32B モデルで OpenClaw + Ollama を実行するのに十分な容量であり、バックグラウンド タスク、スケジュールされたジョブ、および複数のチャット接続のための余裕もまだあります。.

通常の方法で OpenClaw をインストールし、Ollama を設定し、メッセージング アプリを接続すると、ラップトップがオフのときでもボットが常にオンラインの状態になります。.

欠点ARM CPU は一部のモデルでは x86 よりも少し遅く、ネットワーク速度は平均的ですが、個人使用には十分すぎるほどです。多くの人がこの方法でアシスタントを何ヶ月も問題なく使用しています。.

オプション5. プレミアムモデルのスタートアップ/開発者クレジットを集める

AI企業向けのあらゆる無料クレジットオファーを掲載したウェブサイトやプログラムがあります。申請すれば、以下の特典が得られます。

- $500~$25,000(アントロピック(クロード)より)

- OpenAIの$500~$50,000

- AWS Bedrock から最大 $100,000

- マイクロソフト、グーグルなどからの少額

いくつかの条件に該当する場合、数千ドル(場合によっては数万ドル)相当の無料APIクレジットを獲得できます。これにより、OpenClawを最高級モデル(Claude Sonnet / Opusレベル)で数か月、あるいは使用頻度に応じて1~3年も実行できます。.

応募プロセスでは通常、ビジネス用のメールアドレスの提出が求められますが、場合によっては、開発中のものについての簡単な説明が求められることもあります。プログラムによっては、簡単な面接を求める場合もあります。.

これは、ローカル ハードウェアの制限なしで「Claude を永久に無料にする」ことに最も近い方法です。.

無料 vs 有料:2026年のOpenClawの品質比較

| タスク / アスペクト | 無料(ローカル Ollama、Qwen 2.5 などの 32B モデル) | 有料(クレジットまたはサブスクリプション経由のClaude) | 最も多くの人にとって勝利するのは誰か |

| 日々の用事(メール、ファイル、リマインダー) | 非常に良い、速い、信頼できる | スマートな返信が少し上手 | 無料(ほぼ同じ) |

| 呼び出しツールと多段階の作業 | 通常はうまく機能しますが、失敗することもあります | 信頼性が大幅に向上し、ミスが減少 | 有料 |

| 綿密な思考と計画 | 通常のタスクには適しているが、難しいタスクには弱い | 非常に複雑なものを最もうまく処理します | 有料(大きな違い) |

| メールや投稿を書く | 短いテキストには適しているが、あまり洗練されていない | より自然でクリエイティブなサウンド | 有料 |

| コーディングとスクリプト | コーディングモデルに強く、無料でも素晴らしい | 非常に難しいコードではわずかに改善される | ほぼ同点(フリーは近い) |

| 長い会話 / 大きなファイル | 十分です(64k以上のコンテキスト) | メモリがはるかに長く、膨大な量を処理できます | 頻繁に使用する場合は有料 |

| プライバシーとオフライン作業 | 100%プライベート、インターネット不要 | データはクラウドへ | 無料 |

| スピード | 常に同じです(PCによって異なります) | 高速だが、混雑時には遅くなることがある | 無料 |

| 料金 | 永久無料(ハードウェアを購入後) | 数ヶ月間はクレジット付きで無料、その後は有料 | 長期無料 |

| 全体的に通常の日常使用に適しています | 必要なものの80~90%をカバー | 最高の品質、最小のエラー | ハイブリッド:ほとんどの日は無料、ハード面は有料 |

クイックセキュリティリマインダー

OpenClawは、コンピュータやサーバー上で実際に操作できるため、非常に強力です。ファイルの読み書き、メールの送信、コードの実行などが可能です。その強力な機能により、ミスや不適切な指示によって、データが削除されたり、キーが漏洩したり、システムが破壊されたりする可能性があります。.

人々が従う基本的なルール:

- Docker内で実行するか、管理者以外のユーザーとして実行する

- すべてのファイルを1つの独立したフォルダに保存します

- 公開グループや共有チャットに接続しないでください

- どのフォルダにアクセスできるかをメッセージで明確に伝える

- 新しいスキルや大きな変更は、まず使い捨ての仮想マシンでテストする

結論

2026年には、月額サブスクリプションなしでOpenClawを完全に無料で実行できます。最も簡単な永久無料のオプションは、Ollamaを使用してローカル32Bモデルを自分のコンピュータで直接実行し、最大限のプライバシーと継続的なコストゼロを実現することです。ラップトップを起動せずに24時間365日オンラインで使用したい場合は、Oracle CloudのAlways Free層に設定してください。難しいタスクで最高の品質と長期間の使用を実現するには、いくつかのスタートアップまたは開発者クレジットプログラムに申し込んで、クレジットが切れるまで(軽い使用で数か月または数年かかる場合が多い)ClaudeやGPTなどのトップモデルに無料でアクセスできるようにします。すべての選択肢にはトレードオフがあります。ローカルモデルは複雑な推論に少し弱く、OracleのARMサーバーは遅くなることがあり、クレジットにはある程度の申請が必要です。Ollamaと堅牢な32Bモデルでシンプルに始め、日常的なニーズにどのように適合するかをテストし、より強力なものが必要な場合はOracleまたはクレジットを追加してください。ハードウェア、忍耐力、優先順位に最適なものがすぐにわかるでしょう。.

よくある質問

はい。オープンソースなのでライセンス費用はかからず、ダウンロードして永久に使用できます。.

はい。ローカルモデル(Ollama / LM Studio)を使用する場合は可能です。インターネット接続が必要なのは、Web検索または外部APIを使用する場合のみです。.

通常、320 億~ 340 億のパラメータで、電子メール、ファイル、カレンダー、基本的な自動化を確実に処理します。.

ボットの入手量と使用頻度によって異なります。軽度/中程度の使用量の場合 → 数か月。多量の使用量の場合 → 6か月から、複数のプログラムを同時に使用している場合は2~3年。.

はい、何千人もの人が実践しています。慎重に設定し、最初の1週間は注意深く見守ってください。.

いいえ、最も難しいタスクでは無理です。しかし、通常のパーソナルアシスタント業務の80~90%程度であれば、十分に近いレベルです。.

はい。OpenClawはプロバイダーやローカルサーバーを簡単に切り替えられるように設計されています。設定を更新して再起動するだけです。.