Beeldherkenning klinkt complex, maar het kernidee is verrassend eenvoudig. Een machine bekijkt afbeeldingen als data, leert patronen uit voorbeelden en gebruikt die ervaring om te herkennen wat het de volgende keer ziet. Het echte werk zit hem in hoe die voorbeelden worden voorbereid, hoe het model ervan leert en hoe goed dat leerproces standhoudt buiten een laboratoriumomgeving.

In dit artikel leggen we stap voor stap uit hoe beeldherkenning in machine learning werkt. Geen ingewikkelde wiskunde, geen modewoorden. Gewoon een heldere blik op hoe beelden worden omgezet in signalen, hoe modellen leren deze te interpreteren en waarom sommige systemen goed presteren in de praktijk, terwijl andere falen.

Wat beeldherkenning werkelijk betekent in machinaal leren

In essentie draait beeldherkenning om classificatie en identificatie. Een systeem ontvangt een afbeelding en beantwoordt vragen zoals:

- Wat is er op deze afbeelding te zien?

- Waar bevindt zich een specifiek object?

- Hoeveel objecten zijn er aanwezig?

- Behoren deze afbeeldingen tot dezelfde categorie?

In de context van machinaal leren is beeldherkenning onderdeel van computervisie. Computervisie richt zich op het trainen van machines om visuele gegevens te interpreteren op een manier die nuttig is voor besluitvorming.

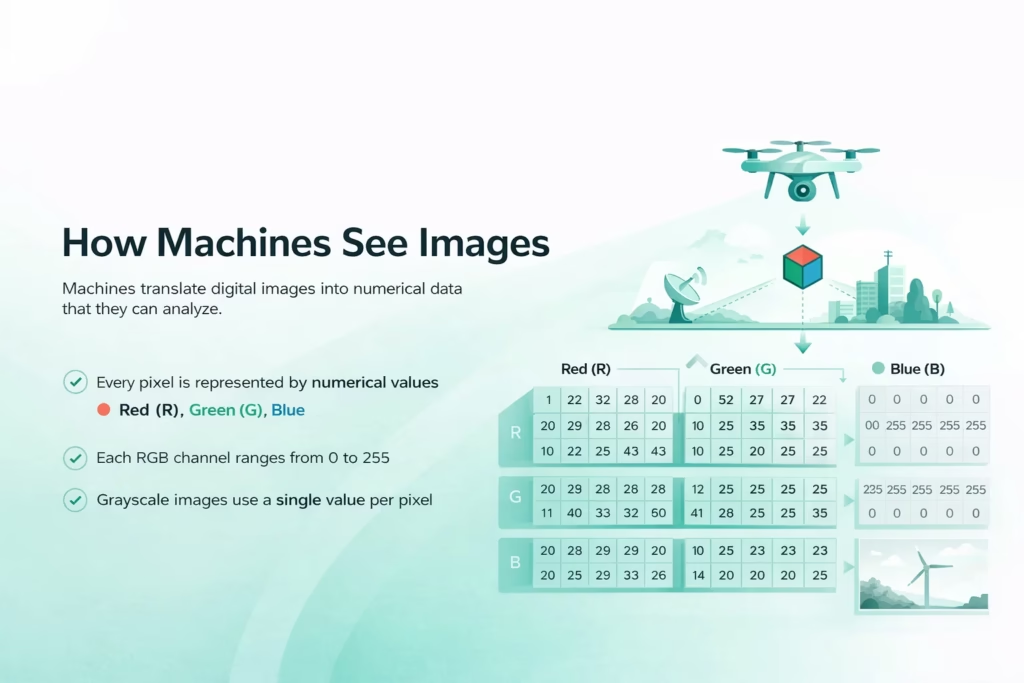

Een belangrijk onderscheid om meteen te maken is dat machines beelden niet op dezelfde manier zien als mensen. Een mens ziet een kat. Een machine ziet een raster van getallen. Alles wat volgt in beeldherkenning is erop gericht die kloof te overbruggen.

Hoe machines beelden waarnemen

Voordat er überhaupt iets geleerd kan worden, moet een afbeelding worden omgezet in een vorm waarmee een machine kan werken. Digitale afbeeldingen zijn opgebouwd uit pixels. Elke pixel bevat numerieke waarden die de kleurintensiteit beschrijven.

In een standaard RGB-afbeelding bevat elke pixel drie waarden:

- Rood

- Groente

- Blauw

Elke waarde ligt doorgaans tussen 0 en 255. Een zwarte pixel wordt weergegeven door nullen. Een witte pixel gebruikt de maximale waarden. Een volledige afbeelding is simpelweg een grote matrix van deze getallen.

Grijswaardenafbeeldingen vereenvoudigen dit door één enkele waarde per pixel te gebruiken, wat de complexiteit vermindert en vaak voldoende is voor taken die afhankelijk zijn van vorm of contrast in plaats van kleur.

In dit stadium heeft het beeld geen betekenis. Het zijn slechts gegevens. De hele taak van beeldherkenning is om te leren welke patronen in die gegevens ertoe doen.

De rol van data in beeldherkenning

Goede beeldherkenning begint met goede data. Veel projecten slagen of falen op dit gebied, lang voordat er ook maar een model getraind is. Zelfs sterke algoritmes hebben moeite wanneer de onderliggende beelden de werkelijke gebruiksomstandigheden niet weerspiegelen.

Gegevensverzameling

De dataset moet de omstandigheden weerspiegelen waarmee het model na de implementatie te maken krijgt. Beelden die in gecontroleerde omgevingen zijn vastgelegd, komen zelden overeen met de variabiliteit in de werkelijkheid. De belichting verandert. De hoeken verschuiven. Objecten overlappen elkaar. De resolutie varieert.

Een nuttige dataset bevat

- Verschillende standpunten

- Variaties in verlichting

- Realistische achtergronden

- Onvolmaakte of ruisende voorbeelden

Als een model alleen getraind wordt op schone, ideale afbeeldingen, zal het waarschijnlijk slecht presteren in praktijksituaties waar de omstandigheden onvoorspelbaar zijn.

Labeling en annotatie

Voor supervised learning moeten afbeeldingen gelabeld worden. Labels vertellen het model wat het moet leren. Dit kan zo simpel zijn als het toewijzen van een categorienaam of zo gedetailleerd als het definiëren van exacte objectgrenzen op pixelniveau.

Veelvoorkomende annotatietypen

- Labels op beeldniveau voor classificatie

- Begrenzingskaders voor objectdetectie

- Pixelmaskers voor segmentatie

- Kernpunten voor houdingsschatting

De kwaliteit van de annotaties is belangrijker dan de kwantiteit. Inconsistente of onnauwkeurige labels verwarren het model en beperken het vermogen om te generaliseren buiten de trainingsdata.

Hoe we beeldherkenning gebruiken in geospatiale analyses bij FlyPix AI

Bij FlyPix-AI, We passen beeldherkenning toe op echte geospatiale data, waaronder satelliet-, lucht- en dronebeelden. Deze datasets zijn complex en bevatten veel gegevens, waardoor handmatige analyse traag en inconsistent is. Machine learning stelt ons in staat om grote gebieden nauwkeurig te detecteren, te monitoren en te inspecteren in een fractie van de tijd.

Ons platform gebruikt AI-agenten om duizenden objecten in complexe scènes te identificeren en te omlijnen. Gebruikers kunnen aangepaste modellen trainen met hun eigen annotaties, zonder programmeerkennis of diepgaande AI-expertise. Dit maakt beeldherkenning praktisch voor dagelijks gebruik, niet alleen voor technische teams.

We leggen sterk de nadruk op snelheid en schaalbaarheid. Taken die voorheen uren of dagen duurden, kunnen nu in seconden worden voltooid, waardoor teams sneller van beeldmateriaal naar beslissingen kunnen overgaan. Bouw, landbouw, havenactiviteiten, bosbouw, infrastructuur en overheidsprojecten profiteren allemaal van deze aanpak.

Voor ons is beeldherkenning meer dan alleen detectie. Het gaat erom visuele data om te zetten in betrouwbare inzichten die ook in de praktijk standhouden.

Voorbewerking: Afbeeldingen voorbereiden voor gebruik

Onbewerkte afbeeldingen worden zelden direct gebruikt. Voorbewerking verbetert de consistentie en helpt modellen relevante patronen efficiënter te leren door onnodige variatie te verminderen nog voordat de training begint.

Deze fase omvat doorgaans het verkleinen van afbeeldingen tot een vaste vorm, zodat het model uniforme invoer ontvangt, het normaliseren van pixelwaarden om numerieke bereiken stabiel te houden, het converteren van kleurruimten wanneer kleurinformatie niet essentieel is, het verminderen van ruis veroorzaakt door sensoren of compressie, en het bijsnijden van gebieden die geen nuttig signaal opleveren.

Normalisatie speelt een bijzonder belangrijke rol. Door pixelwaarden naar een consistent bereik te schalen, voorkomt het model numerieke instabiliteit tijdens de training en convergeert het betrouwbaarder.

Data-augmentatie wordt vaak toegepast in combinatie met voorbewerking. Technieken zoals roteren, spiegelen, zoomen en helderheidsaanpassing introduceren gecontroleerde variatie in de dataset zonder nieuwe afbeeldingen te verzamelen. Dit helpt overfitting te verminderen en verbetert hoe goed het model omgaat met veranderingen in perspectief, belichting en oriëntatie in de echte wereld.

Kenmerkextractie in traditionele machine learning

Voordat deep learning dominant werd, was beeldherkenning sterk afhankelijk van handmatige extractie van kenmerken. Ingenieurs bepaalden op welke visuele kenmerken het model zich moest concentreren.

Typische handgemaakte kenmerken zijn onder meer:

- Randen

- Hoeken

- Textuurpatronen

- Gradiënten

Methoden zoals Histogram of Oriented Gradients, Local Binary Patterns en Bag of Features transformeerden afbeeldingen in numerieke vectoren met een vaste lengte.

Deze benaderingen werkten goed voor specifieke taken, maar vereisten gedegen domeinexpertise. Ze bleken bovendien moeilijk aan te passen aan veranderende visuele omstandigheden. Elk nieuw scenario vereiste handmatige afstemming.

Diep leren en automatisch leren van kenmerken

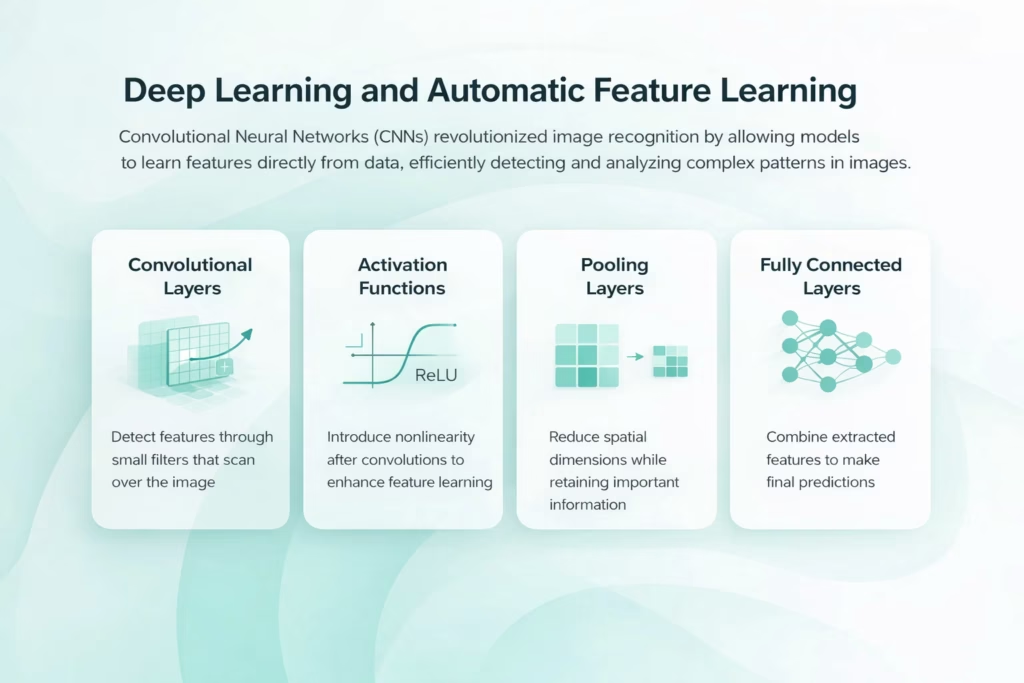

Deep learning heeft beeldherkenning revolutionair veranderd door de noodzaak voor handmatig ontworpen kenmerken overbodig te maken. In plaats van het model te vertellen waarnaar het moet zoeken, laten ontwikkelaars het kenmerken rechtstreeks uit de data leren. Convolutionele neurale netwerken, of CNN's, vormen de ruggengraat van moderne beeldherkenning. Ze zijn ontworpen om de ruimtelijke structuur van beelden te benutten.

Convolutionele lagen

Convolutionele lagen passen kleine filters toe op een afbeelding. Deze filters reageren op lokale patronen zoals randen of texturen. Vroege lagen detecteren eenvoudige vormen. Diepere lagen combineren deze tot complexere structuren. Deze gelaagde aanpak weerspiegelt hoe mensen visuele informatie verwerken, van eenvoudige lijnen tot complete objecten.

Activeringsfuncties

Na elke convolutie introduceren de activeringsfuncties niet-lineariteit. Hierdoor kan het netwerk complexe relaties modelleren in plaats van eenvoudige lineaire patronen.

Lagen samenvoegen

Pooling reduceert de ruimtelijke dimensies, terwijl belangrijke kenmerken behouden blijven. Dit helpt modellen om kleine verschuivingen of vervormingen in de positie van objecten op te vangen.

Volledig verbonden lagen

Aan het einde van het netwerk worden de geëxtraheerde kenmerken gecombineerd en geëvalueerd om voorspellingen te doen. Deze lagen integreren informatie uit de gehele afbeelding.

Het trainingsproces stap voor stap

Het trainen van een beeldherkenningsmodel is een iteratief proces. Het omvat herhaalde blootstelling aan gelabelde data en geleidelijke aanpassing van interne parameters.

1. Voorwaartse pass

Het model verwerkt een afbeelding en produceert een voorspelling.

2. Schadeberekening

De voorspelling wordt vergeleken met het werkelijke label. Een verliesfunctie meet hoe onnauwkeurig de voorspelling is.

3. Terugpropagatie

Het model past zijn interne gewichten aan om de fout te verminderen. Dit gebeurt door het verlies achterwaarts door het netwerk te propageren.

4. Optimalisatie

Een optimizer werkt parameters bij op basis van gradiënten. Gedurende vele iteraties verbetert het model zijn nauwkeurigheid. De training gaat door totdat de prestaties stabiliseren of een acceptabel niveau bereiken op de validatiegegevens.

Objectdetectie en beeldsegmentatie

Beeldherkenning beperkt zich niet tot classificatie. In veel praktijksituaties is het simpelweg weten dat een object in een afbeelding aanwezig is niet voldoende. Systemen moeten vaak begrijpen waar objecten zich bevinden, hoeveel er zijn en hoe ze zich verhouden tot hun omgeving. Die behoefte aan ruimtelijk inzicht is de drijvende kracht achter objectdetectie en beeldsegmentatie.

- Objectdetectie identificeert wat de objecten zijn en waar ze in de afbeelding voorkomen. Het model tekent doorgaans begrenzingskaders rond objecten en kent aan elk kader een klasselabel toe. Bekende modelfamilies zijn Faster R-CNN, SSD en YOLO, en de keuze hangt vaak af van de afweging tussen snelheid en nauwkeurigheid.

- Bij beeldsegmentatie worden pixels gelabeld in plaats van rechthoeken getekend, waardoor de grenzen veel preciezer zijn. Dit is handig wanneer vormen onregelmatig zijn, objecten elkaar overlappen of nauwkeurigheid aan de randen belangrijk is. Instantiesegmentatie scheidt individuele objecten van dezelfde klasse, terwijl semantische segmentatie regio's labelt op basis van categorie over de gehele afbeelding.

Begeleid, onbegeleid en zelfgestuurd leren

De meeste beeldherkenningssystemen maken gebruik van supervised learning, maar andere benaderingen worden steeds belangrijker naarmate de beschikbaarheid van data en de projectbeperkingen veranderen.

Onbegeleid leren

Niet-gesuperviseerde modellen ontdekken patronen zonder labels. Ze groeperen afbeeldingen op basis van gelijkenis. Dit is handig wanneer er weinig gelabelde data beschikbaar is.

Zelfgestuurd leren

Zelflerende methoden genereren leersignalen uit de data zelf. Taken zoals het voorspellen van ontbrekende delen van een afbeelding stellen modellen in staat om bruikbare representaties te leren met minimale labeling. Deze benaderingen zijn vooral waardevol voor grootschalige of gespecialiseerde datasets.

Implementatie en praktische beperkingen

Een getraind model is pas nuttig als het na implementatie betrouwbaar presteert. Dit is waar veel beeldherkenningssystemen problemen beginnen te ondervinden, niet omdat het model slecht is ontworpen, maar omdat de omstandigheden in de praktijk zelden overeenkomen met de trainingsomgeving.

Eenmaal geïmplementeerd, ondervinden modellen vaak variaties in beeldkwaliteit als gevolg van verschillende camera's, compressieniveaus of bewegingsonscherpte. Objecten kunnen in onbekende vormen of contexten verschijnen, en omgevingsfactoren zoals belichting, weer of achtergrondruis kunnen patronen introduceren die het model nog nooit eerder heeft gezien. Hardwarebeperkingen spelen ook een rol, vooral wanneer van modellen wordt verwacht dat ze draaien op apparaten met beperkte resources in plaats van krachtige servers.

Beeldherkenningssystemen kunnen in de cloud of direct op apparaten aan de rand van het netwerk werken. Implementatie in de cloud biedt een grotere rekenkracht en maakt updates eenvoudiger, terwijl implementatie aan de rand van het netwerk de privacy verbetert, de latentie verlaagt en ervoor zorgt dat systemen kunnen functioneren zonder constante internetverbinding. Het nadeel is de beperkte verwerkingskracht, waardoor vaak kleinere of geoptimaliseerde modellen nodig zijn.

Om op de lange termijn effectief te blijven, moeten geïmplementeerde modellen continu worden gemonitord. De prestaties kunnen afnemen naarmate de dataverdeling verandert, waardoor periodieke hertraining en aanpassing noodzakelijk zijn. Het is essentieel om de implementatie als een doorlopend proces te beschouwen, in plaats van als een laatste stap, om betrouwbare beeldherkenning in de praktijk te garanderen.

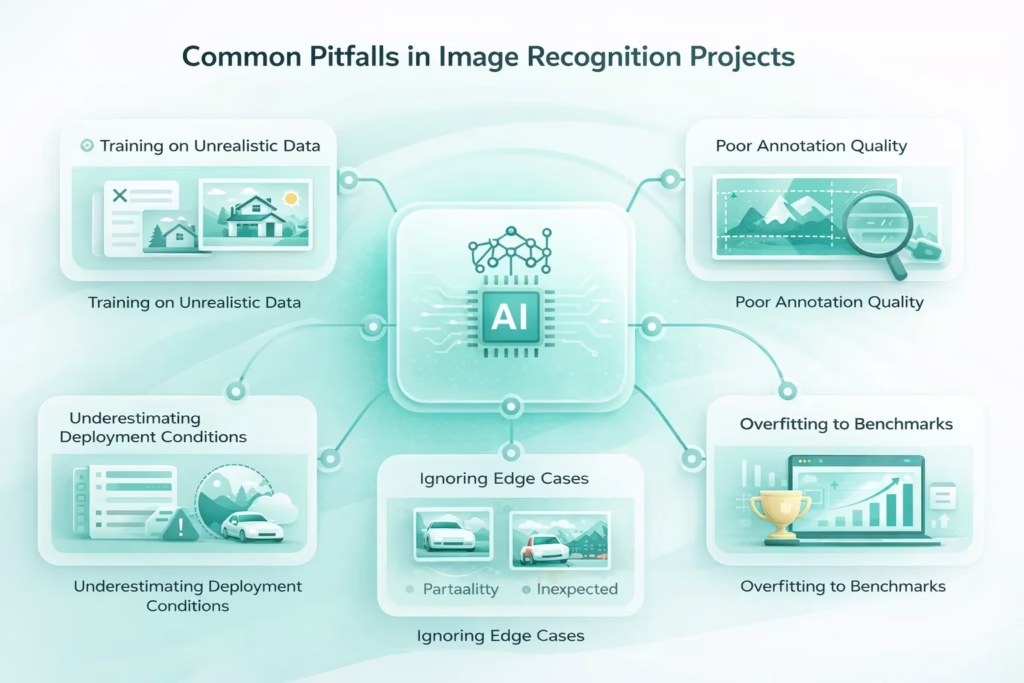

Veelvoorkomende valkuilen bij beeldherkenningsprojecten

Zelfs goed ontworpen beeldherkenningssystemen kunnen falen als een paar terugkerende problemen over het hoofd worden gezien. Deze problemen komen meestal niet aan het licht tijdens de ontwikkeling, maar pas nadat een model in de praktijk wordt gebruikt.

- Trainen met onrealistische data. Modellen die alleen getraind zijn op schone, goed belichte en perfect gekaderde afbeeldingen, presteren vaak slecht in de praktijk. Cameraruis, bewegingsonscherpte, schaduwen en gedeeltelijke occlusie kunnen de nauwkeurigheid aanzienlijk verminderen als deze factoren niet in de trainingsset zijn opgenomen.

- Slechte annotatiekwaliteit. Inconsistente labels, ontbrekende objecten of onnauwkeurige grenzen zorgen voor verwarring tijdens de training. Een kleinere dataset met hoogwaardige annotaties presteert doorgaans beter dan een grote dataset met slordige labeling.

- Uitzonderlijke gevallen worden buiten beschouwing gelaten. Zeldzame situaties, ongebruikelijke objectverschijningen of onverwachte achtergronden worden gemakkelijk over het hoofd gezien. Deze uitzonderlijke gevallen zijn vaak verantwoordelijk voor de ernstigste storingen na de implementatie.

- Overfitting aan benchmarks. Het optimaliseren van modellen om goed te presteren op standaard datasets kan een vals gevoel van succes geven. Hoge benchmarkscores vertalen zich niet altijd in betrouwbare prestaties op aangepaste of domeinspecifieke data.

- De inzetomstandigheden onderschatten. Modellen gedragen zich anders zodra ze in gebruik zijn genomen. Wijzigingen in beeldresolutie, hardwarebeperkingen, netwerklatentie of omgevingsomstandigheden kunnen allemaal van invloed zijn op de prestaties.

Succesvolle beeldherkenningssystemen worden gebouwd met continue feedbackloops, regelmatige prestatiecontroles en praktijktests. Door implementatie als een doorlopend proces te beschouwen in plaats van als een laatste stap, ontstaat het verschil tussen een model dat er op papier goed uitziet en een model dat in de praktijk werkt.

Laatste gedachten

Beeldherkenning in machine learning is geen magie. Het is een gestructureerd proces gebaseerd op data, leren en iteratie. Machines begrijpen beelden niet op dezelfde manier als mensen. Ze leren verbanden te leggen tussen patronen en uitkomsten.

Wat beeldherkenning zo krachtig maakt, is niet één enkel algoritme, maar het systeem eromheen. Datakwaliteit. Trainingsstrategie. Evaluatiediscipline. En zorgvuldige implementatie.

Als deze elementen op hun plaats vallen, wordt beeldherkenning een betrouwbaar instrument in plaats van een fragiele demonstratie. En dat maakt het praktisch.

Veelgestelde vragen

Beeldherkenning in machine learning is het proces waarbij een systeem leert objecten, patronen of kenmerken in afbeeldingen te identificeren en te classificeren. Het model leert van gelabelde of ongelabelde visuele data en gebruikt die ervaring om nieuwe afbeeldingen te interpreteren die het nog niet eerder heeft gezien.

Machines zien beelden niet als objecten of scènes. Ze verwerken beelden als numerieke gegevens die bestaan uit pixelwaarden. Beeldherkenningsmodellen leren patronen binnen die getallen, zoals randen, texturen en vormen, en koppelen deze door middel van training aan bekende uitkomsten.

Beeldherkenning verwijst meestal naar het identificeren van wat er in een afbeelding aanwezig is, vaak op een hoog niveau. Objectdetectie gaat een stap verder door individuele objecten te identificeren en hun locatie binnen de afbeelding te bepalen met behulp van begrenzingskaders. Detectie voegt ruimtelijk inzicht toe dat eenvoudige classificatie niet biedt.

Objectdetectie omlijnt objecten met rechthoekige kaders, terwijl beeldsegmentatie individuele pixels labelt. Segmentatie maakt nauwkeurigere grenzen mogelijk en wordt gebruikt wanneer exacte vormen of gebieden van belang zijn, zoals bij medische beeldvorming of satellietanalyse.

Het model kan alleen leren van de gegevens die het ontvangt. Afbeeldingen van slechte kwaliteit, inconsistente labels of onrealistische trainingsvoorbeelden leiden tot zwakke prestaties. Hoogwaardige, goed geannoteerde data hebben doorgaans een grotere impact dan complexere modelarchitecturen.

De hoeveelheid data hangt af van de complexiteit van de taak en het gebruikte model. Eenvoudige classificatietaken vereisen mogelijk duizenden afbeeldingen, terwijl complexere detectie- of segmentatietaken er aanzienlijk meer nodig hebben. Transfer learning en zelflerende methoden kunnen de datavereisten verminderen.