Modellen voor beeldherkenning falen zelden omdat de architectuur verkeerd is. Ze falen omdat de nauwkeurigheid verkeerd wordt begrepen, slecht wordt gemeten of wordt getest onder omstandigheden die de realiteit niet weerspiegelen. Een model kan er tijdens de training indrukwekkend uitzien, maar toch volledig falen zodra het met echte data in aanraking komt.

Het controleren van de nauwkeurigheid van beeldherkenning draait niet om het behalen van één enkele score. Het gaat erom te begrijpen wat het model goed doet, wat het mist en waarom die fouten optreden. In de praktijk is nauwkeurigheid een combinatie van meetwaarden, validatiediscipline en eerlijke tests met realistische scenario's. Deze handleiding beschrijft hoe je beeldherkenningssystemen kunt evalueren op een manier die je daadwerkelijk vertelt of ze klaar zijn voor gebruik.

Waarom algemene nauwkeurigheid zelden de waarheid vertelt

De algehele nauwkeurigheid is de meest gebruikte meeteenheid, maar tegelijkertijd ook de minst informatieve zodra projecten verder gaan dan eenvoudige problemen. Het meet hoe vaak voorspellingen overeenkomen met labels, maar negeert klasse-ongelijkheid, de ernst van fouten en verschuivingen in de verdeling.

Een model kan een zeer hoge nauwkeurigheid behalen door goed te presteren in veelvoorkomende, eenvoudige gevallen, terwijl het consequent faalt in zeldzame maar cruciale gevallen. In echte projecten zijn die zeldzame gevallen vaak de reden waarom het model überhaupt bestaat.

De algehele nauwkeurigheid is niet nutteloos, maar moet worden beschouwd als een oppervlakkig signaal. Het kan aangeven of er duidelijk iets kapot is, maar het kan niet bevestigen dat een systeem betrouwbaar is.

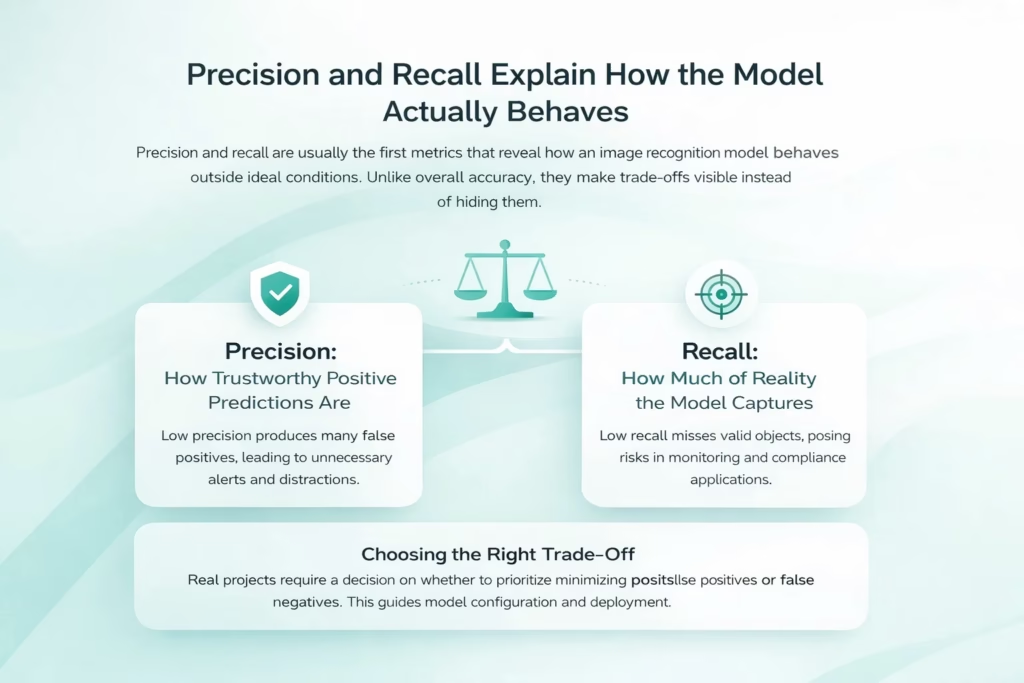

Precisie en recall verklaren hoe het model zich daadwerkelijk gedraagt.

Precisie en recall zijn doorgaans de eerste meetwaarden die onthullen hoe een beeldherkenningsmodel presteert buiten ideale omstandigheden. In tegenstelling tot de algehele nauwkeurigheid maken ze de compromissen zichtbaar in plaats van ze te verbergen.

Nauwkeurigheid: Hoe betrouwbaar zijn positieve voorspellingen?

Precisie geeft aan hoe vaak het model gelijk heeft bij een positieve voorspelling. Een lage precisie betekent dat het systeem veel valse positieven produceert. In de praktijk wordt dit al snel een probleem wanneer elke detectie een waarschuwing, een workflow of een handmatige controle activeert. Zelfs een technisch correct model kan onbruikbaar worden als het constant onnodige aandacht vereist.

Terugblik: Hoeveel van de werkelijkheid legt het model vast?

Recall meet de dekkingsgraad. Het laat zien hoeveel van wat daadwerkelijk aanwezig is het model weet te detecteren. Een model met een lage recall mist geldige objecten, zelfs als de detecties die het wel doet correct zijn. In monitoring-, veiligheids- of compliance-gerelateerde systemen brengen gemiste detecties vaak een groter risico met zich mee dan valse detecties.

De juiste afweging maken

Precisie en recall beschrijven verschillende soorten fouten, en geen van beide is per definitie beter. In de praktijk is het belangrijk om expliciet te bepalen welke fouten acceptabeler zijn. Die beslissing moet leidend zijn voor het afstemmen van drempelwaarden, de modelselectie en de uiteindelijke beoordeling van de nauwkeurigheid.

Bij FlyPix AI maken we nauwkeurige beeldherkenning praktisch toepasbaar.

Bij FlyPix-AI, We werken met beeldherkenning waarbij nauwkeurigheid onder reële omstandigheden moet worden gewaarborgd, niet alleen met schone testdata. Satelliet-, lucht- en dronebeelden zijn van nature complex, dus we richten ons op nauwkeurigheid die standhoudt in verschillende omgevingen, op verschillende schalen en bij wisselende omstandigheden.

Wij beschouwen nauwkeurigheid niet als een enkele score. Ons platform is ontworpen om teams te helpen bij het trainen van aangepaste modellen, het visueel valideren van detecties en het snel itereren. Door domeinkennis dicht bij het model te houden en de tijd die nodig is voor testen en hertrainen te verkorten, zorgen we ervoor dat teams actief met nauwkeurigheid kunnen werken, in plaats van deze slechts eenmalig te meten.

Nauwkeurigheid stopt niet bij de implementatie. Omdat beeldmateriaal in de loop van de tijd verandert, ondersteunen onze workflows continue validatie en hertraining, zodat modellen afgestemd blijven op de werkelijke omstandigheden in plaats van langzaam irrelevant te worden.

Het gezamenlijk interpreteren van de belangrijkste nauwkeurigheidsstatistieken

Zodra de basisnauwkeurigheidscijfers bekend zijn, begint het echte werk. Beeldherkenningssystemen falen zelden omdat er een bepaalde meetwaarde ontbreekt. Ze falen omdat meetwaarden geïsoleerd worden bekeken. Precisie, recall, F1-score, IoU en mAP beschrijven allemaal verschillende aspecten van het gedrag van een model, en geen van deze meetwaarden is op zichzelf betekenisvol. Het doel is om te begrijpen hoe ze op elkaar inwerken en wat ze onthullen wanneer ze samen worden bekeken.

Het F1-score gebruiken zonder details te verliezen

De F1-score combineert precisie en recall in één getal. Deze score is nuttig voor vergelijkingen, vooral wanneer geen van beide meetwaarden de boventoon mag voeren.

De F1-score mag echter nooit een directe vervanging zijn voor een nauwkeurige beoordeling van de precisie en recall. Twee modellen met dezelfde F1-score kunnen in de praktijk heel verschillend presteren. Het ene model mist mogelijk zeldzame gevallen, terwijl het andere het systeem overspoelt met valse detecties.

Beschouw de F1-score als een samenvatting, niet als een conclusie.

De nauwkeurigheid van objectdetectie verandert de regels.

De nauwkeurigheid van beeldherkenning wordt complexer wanneer objectdetectie een rol speelt. Detectiesystemen moeten vaststellen wat er aanwezig is en het correct lokaliseren binnen het beeld.

Intersection over Union, ofwel IoU, meet hoe goed voorspelde begrenzingskaders overlappen met de werkelijke begrenzingskaders. Het maakt van nauwkeurigheid een ruimtelijk probleem in plaats van een simpele classificatietaak.

Het kiezen van IoU-drempelwaarden is geen technisch detail. Ruime drempelwaarden kunnen lokalisatieproblemen maskeren. Extreem strenge drempelwaarden kunnen detecties die operationeel gezien goed genoeg zijn, benadelen. In echte projecten moet IoU de vereiste precisie van detecties weerspiegelen, niet wat er het beste uitziet in rapporten.

Gemiddelde precisie en de beperkingen ervan

De gemiddelde precisie (mAP) wordt veel gebruikt omdat deze de detectiebetrouwbaarheid, de rangschikkingskwaliteit en de lokalisatienauwkeurigheid over verschillende drempelwaarden combineert. Het biedt een gestructureerde manier om objectdetectiemodellen te vergelijken die onder vergelijkbare omstandigheden zijn getraind.

mAP is vooral waardevol als vergelijkende maatstaf. Het helpt teams te begrijpen of de ene aanpak de detectiekwaliteit verbetert ten opzichte van de andere. Wat het echter niet garandeert, is robuustheid. Een model kan goed scoren op mAP en toch falen onder specifieke lichtomstandigheden, omgevingen of objectopstellingen.

Om die reden moet mAP worden beschouwd als een lens, niet als een oordeel.

Kijk altijd naar de prestaties per klas.

Een van de meest voorkomende redenen waarom beeldherkenningssystemen falen, is de ongelijke prestatie tussen de verschillende klassen. Geaggregeerde statistieken maskeren dit probleem.

Bij het evalueren van de nauwkeurigheid is het belangrijk om altijd de statistieken per klasse te bekijken. Dit laat zien of bepaalde objecten consequent moeilijker te detecteren zijn of vaker met andere objecten worden verward.

Deze stap leidt vaak tot een verandering in prioriteiten. Een model dat er over het algemeen sterk uitziet, kan onacceptabel zijn als het faalt op de belangrijkste onderdelen.

Verwarringsmatrices zetten fouten om in patronen.

Verwarringsmatrices zijn een van de meest praktische hulpmiddelen om te begrijpen hoe een beeldherkenningsmodel zich gedraagt. In plaats van fouten samen te vatten in één enkele score, laten ze zien hoe voorspellingen tussen klassen verschuiven, waardoor de structuur van de fouten aan het licht komt.

Wat verwarringsmatrices onthullen

Door voorspellingen te vergelijken met de werkelijke situatie, helpen verwarringsmatrices vragen te beantwoorden die met scalaire meetwaarden niet beantwoord kunnen worden:

- Welke klassen worden het vaakst met elkaar verward?

- Of fouten doorgaans eenzijdig of wederzijds zijn.

- Of fouten zich ophopen rond visueel vergelijkbare of overlappende categorieën.

Waarom dit standpunt belangrijk is

Deze patronen wijzen vaak direct op onderliggende problemen, zoals onduidelijke klassedefinities, inconsistente labeling of ontbrekende trainingsvoorbeelden. Omdat verwarringsmatrices de relaties tussen klassen blootleggen, zijn ze bijzonder nuttig bij het bepalen of er meer data verzameld moet worden, labels verfijnd moeten worden of klasse-grenzen aangepast moeten worden.

Validatie werkt alleen met gegevens die nog niet eerder zijn gezien.

De nauwkeurigheidsevaluatie loopt vast wanneer de validatiegegevens te veel lijken op de trainingsgegevens. Dit gebeurt vaker dan teams verwachten.

Als er in meerdere sets bewerkte versies van dezelfde afbeeldingen voorkomen, of als de gegevens afkomstig zijn van dezelfde specifieke omstandigheden, lijkt de nauwkeurigheid kunstmatig hoog. Het model wordt getest op variaties van wat het al eerder heeft gezien.

Een zinvolle testset moet op belangrijke punten verschillen. Dat kan bijvoorbeeld gaan om verschillende locaties, apparaten, tijdsperioden of opnameomstandigheden. Zonder deze verschillen wordt de nauwkeurigheidsevaluatie eerder zelfbevestigend dan voorspellend.

Testen onder reële omstandigheden verandert de conclusies.

Veel nauwkeurigheidsproblemen komen pas aan het licht wanneer modellen te maken krijgen met imperfecties uit de echte wereld. Bewegingsonscherpte, ruis, occlusie, compressieartefacten en slechte belichting leggen zwakke punten bloot die in schone datasets nooit aan het licht komen.

Testen onder realistische omstandigheden leidt vaak tot ongemakkelijke, maar waardevolle ontdekkingen. Een model dat goed presteert in ideale scenario's, kan problemen ondervinden zodra de omstandigheden ook maar enigszins veranderen. Dit vóór de implementatie vaststellen bespaart tijd, kosten en geloofwaardigheid.

Deze fase vereist geen perfecte simulatie. Het gaat erom een eerlijke steekproef te nemen van hoe beelden er in de praktijk uitzien.

Nauwkeurigheid in de loop van de tijd en de rol van vooringenomenheid

De nauwkeurigheid van beeldherkenning is niet statisch. Gegevens uit de praktijk veranderen voortdurend en modellen die niet worden gemonitord, raken geleidelijk uit de pas met de werkelijkheid. Seizoenswisselingen, nieuwe hardware, veranderingen in de omgeving en veranderingen in gebruikersgedrag beïnvloeden allemaal hoe beelden eruitzien en hoe modellen ze interpreteren. Wanneer de nauwkeurigheid alleen bij de lancering wordt gecontroleerd, blijft deze geleidelijke achteruitgang vaak onopgemerkt totdat de problemen duidelijk worden.

Na de implementatie moeten nauwkeurigheidscontroles zich richten op trends in plaats van op geïsoleerde cijfers. Een geleidelijke afname van de prestaties is vaak gevaarlijker dan een plotselinge uitval, omdat deze zich verschuilt achter bekende meetwaarden. Continue monitoring maakt het mogelijk om subtiele veranderingen vroegtijdig te detecteren en te reageren voordat de nauwkeurigheid onder een acceptabel niveau daalt.

Vooroordelen spelen een directe rol in dit proces. Modellen die getraind zijn op beperkte of onevenwichtige datasets presteren doorgaans alleen goed onder de omstandigheden die ze al eerder hebben gezien. Wanneer nieuwe omgevingen, objecttypen of visuele patronen verschijnen, overschatten nauwkeurigheidsstatistieken de betrouwbaarheid. Het verminderen van vooroordelen verbetert niet alleen de dekking, maar ook de robuustheid. Eerlijkere modellen zijn over het algemeen stabieler in de tijd en gemakkelijker te onderhouden wanneer de omstandigheden veranderen.

Nauwkeurigheid gebruiken om echte beslissingen te nemen

Nauwkeurigheidsstatistieken zijn bedoeld om beslissingen te onderbouwen, niet om indruk te maken op belanghebbenden. Rapportages moeten afwegingen, beperkingen en bekende risico's toelichten in plaats van ze te verbergen achter één enkel cijfer. Wanneer nauwkeurigheid zonder context wordt gepresenteerd, schept dit een vals gevoel van zekerheid en zorgt het ervoor dat teams problemen over het hoofd zien die later in de productie aan het licht komen.

In de praktijk moet een nuttige nauwkeurigheidsrapportage het volgende duidelijk maken:

- Welke soorten fouten zijn het belangrijkst en waarom zijn ze wel of niet acceptabel?

- Wanneer het model ongelijkmatig presteert, inclusief klassen of scenario's met een lagere betrouwbaarheid.

- Welke omstandigheden de evaluatie weerspiegelt, zoals gegevensbronnen, omgevingen of tijdsperioden.

- Hoe de prestaties naar verwachting in de loop van de tijd zullen veranderen en hoe dit zal worden gemonitord.

Duidelijke en eerlijke rapportage schept vertrouwen binnen teams en leidt tot systemen die gemakkelijker te onderhouden, te verbeteren en te gebruiken zijn in de praktijk.

Wanneer een model daadwerkelijk klaar is

Een model is klaar wanneer het gedrag ervan begrepen is, niet wanneer de prestatie-indicatoren hun hoogste punt bereiken. Hoge scores kunnen zwakke prestaties maskeren, vooral als ze afkomstig zijn van beperkte datasets of ideale omstandigheden. Wat belangrijker is, is weten hoe het model faalt, waar die fouten optreden en of ze overeenkomen met een acceptabel risico. Voorspelbare fouten kunnen worden beheerd door middel van drempelwaarden, workflows of hertraining. Onbekende fouten komen later aan het licht, meestal wanneer de kosten om ze te herstellen hoger zijn.

Echte paraatheid komt voort uit een gedisciplineerde evaluatie in plaats van een optimistische interpretatie. Dat betekent testen onder realistische omstandigheden, valideren aan de hand van werkelijk onbekende gegevens en de prestaties na de implementatie monitoren. Een model dat continu wordt geobserveerd en bijgesteld, is veel betrouwbaarder dan een model dat er bij de lancering alleen maar sterk uitzag.

Laatste gedachten

Het controleren van de nauwkeurigheid van beeldherkenning in echte projecten draait niet om het behalen van de hoogste score. Het gaat erom te begrijpen hoe een systeem zich gedraagt wanneer de realiteit een rol speelt.

Metrieken zijn hulpmiddelen. Zorgvuldig gebruikt, onthullen ze sterke en zwakke punten. Onzorgvuldig gebruikt, wekken ze vertrouwen zonder betrouwbaarheid.

Het verschil tussen een demo en een betrouwbaar beeldherkenningssysteem zit hem niet in de architectuur. Het zit hem in de eerlijkheid waarmee de nauwkeurigheid wordt gemeten, getest en in de loop der tijd wordt gewaarborgd.

Veelgestelde vragen

Er bestaat niet één beste meeteenheid. De algehele nauwkeurigheid kan nuttig zijn als snelle indicatie, maar is zelden op zichzelf voldoende. In echte projecten moet de nauwkeurigheid worden beoordeeld aan de hand van een combinatie van precisie, recall en taakspecifieke meetwaarden zoals IoU of mAP voor objectdetectie. De juiste mix hangt af van welke soorten fouten het belangrijkst zijn in uw specifieke toepassing.

Dit gebeurt meestal wanneer de evaluatiegegevens te veel lijken op de trainingsgegevens of de werkelijke omstandigheden niet weerspiegelen. Schone afbeeldingen, beperkte omgevingen of datalekken tussen de verschillende trainingssets kunnen de nauwkeurigheidsscores kunstmatig verhogen. Zodra het model nieuwe belichting, hoeken, ruis of omgevingen tegenkomt, komen zwakke punten aan het licht waar nooit op getest is.

Het hangt af van de kosten van fouten. Als valse positieven leiden tot handmatige controle, waarschuwingen of geautomatiseerde acties, is precisie belangrijker. Als ontbrekende objecten risico's of blinde vlekken creëren, is recall belangrijker. De meeste systemen in de praktijk vereisen een bewuste afweging in plaats van blindelings één enkele parameter te optimaliseren.

Nee. De F1-score is nuttig voor vergelijking, maar verhult hoe de balans tussen precisie en recall is. Twee modellen met dezelfde F1-score kunnen in de praktijk heel verschillend presteren. Bekijk precisie en recall altijd afzonderlijk voordat u een beslissing neemt.

De nauwkeurigheid moet na de implementatie regelmatig worden gecontroleerd, niet slechts eenmalig. De juiste frequentie hangt af van hoe snel de gegevens veranderen, maar elk systeem dat wordt blootgesteld aan nieuwe omgevingen, seizoenen of hardware moet continu worden gemonitord. Langzame prestatieafwijkingen komen vaak voor en blijven vaak onopgemerkt als trends niet worden bijgehouden.