Die Bilderkennung hat sich still und leise aus den Forschungslaboren in alltägliche Systeme entwickelt. Sie verschlagwortet Fotos, steuert autonome Fahrzeuge, scannt medizinische Bilder und überwacht Infrastrukturen im großen Stil. Auf dem Papier sehen die Genauigkeitswerte oft beeindruckend aus. In der Praxis ist das Bild jedoch differenzierter.

Die Genauigkeit in der Bilderkennung lässt sich nicht in einer einzigen Zahl messen und ist nicht in jedem Kontext gleich zu interpretieren. Ein Modell, das bei sauberen Benchmark-Bildern gute Ergebnisse liefert, kann unter realen Bedingungen, bei ungewöhnlichen Blickwinkeln, schlechten Lichtverhältnissen oder komplexen Szenen Schwierigkeiten haben. Um die tatsächliche Genauigkeit dieser Technologie zu verstehen, ist es hilfreich, über die Schlagzeilen hinauszublicken und zu untersuchen, wie die Genauigkeit gemessen wird, wo sie sich bewährt und wo noch Lücken bestehen.

Dieser Artikel erklärt das in einfachen Worten, ohne Übertreibungen, und konzentriert sich darauf, wie sich die Bilderkennung außerhalb kontrollierter Demos verhält.

Genauigkeit bei der Bilderkennung

Genauigkeit bei der Bilderkennung bedeutet nicht, dass ein System immer das sieht, was ein Mensch sieht. Sie bedeutet, dass ein Modell unter definierten Bedingungen Vorhersagen liefert, die gemäß spezifischer Regeln mit den gekennzeichneten Daten übereinstimmen.

Die meisten Systeme werden anhand strukturierter Datensätze evaluiert, in denen Bilder vorab annotiert sind. Ein Modell gilt als präzise, wenn seine Vorhersagen innerhalb akzeptierter Schwellenwerte mit diesen Annotationen übereinstimmen. Dies birgt bereits eine Einschränkung: Modelle werden anhand menschlicher Beurteilungen gemessen, nicht anhand der Realität selbst.

Die Genauigkeit variiert je nach Aufgabe. Die Bildklassifizierung konzentriert sich auf die Identifizierung vorhandener Objekte. Die Objekterkennung erfordert zusätzlich die Lokalisierung der Objekte. Die Segmentierung geht noch einen Schritt weiter und definiert präzise Grenzen. Jeder Schritt erhöht die Komplexität und birgt neue Fehlerquellen.

Kernmetriken, die in der Bilderkennung verwendet werden

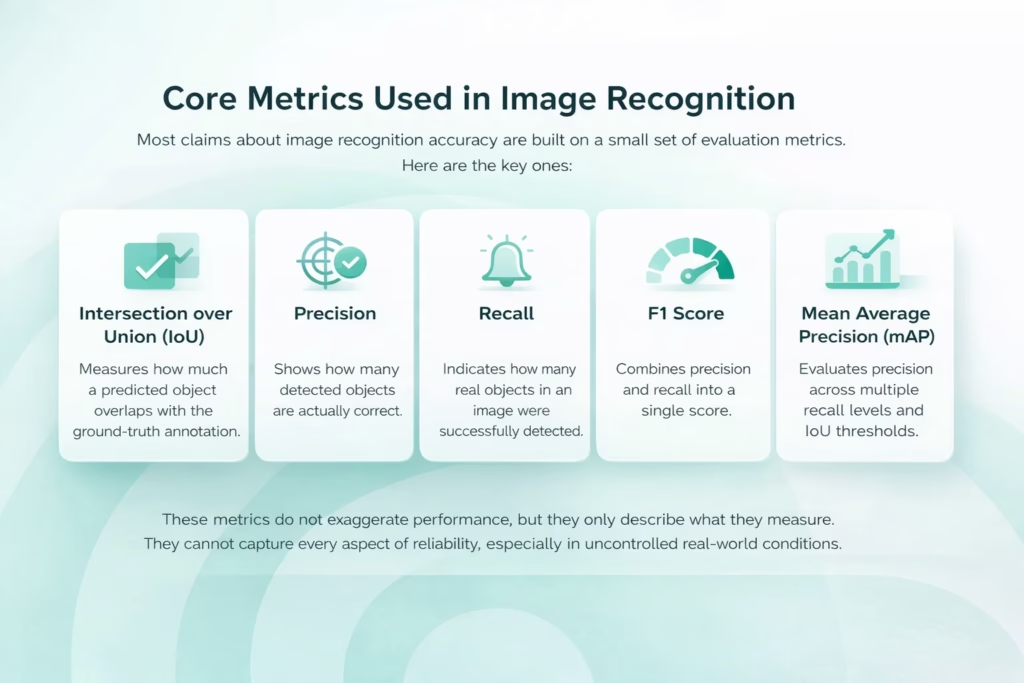

Die meisten Aussagen zur Genauigkeit der Bilderkennung basieren auf einer kleinen Anzahl von Bewertungsmetriken. Jede dieser Metriken erfasst einen anderen Aspekt der Leistung, und keine allein liefert ein vollständiges Bild.

- Kreuzung über Vereinigung (IoU). Misst, wie genau ein vorhergesagtes Objekt mit der tatsächlichen Objektannotation übereinstimmt. Dabei liegt der Fokus auf der räumlichen Ausrichtung, nicht nur darauf, ob ein Objekt erkannt wurde.

- Präzision. Zeigt an, wie viele der erkannten Objekte tatsächlich korrekt sind. Hohe Präzision bedeutet weniger Fehlalarme.

- Abrufen. Zeigt an, wie viele reale Objekte in einem Bild erfolgreich erkannt wurden. Eine hohe Trefferquote bedeutet weniger übersehene Objekte.

- F1-Wertung. Kombiniert Präzision und Trefferquote in einem einzigen Wert. Nützlich für Vergleiche, kann aber wichtige Wechselwirkungen zwischen falsch positiven und falsch negativen Ergebnissen verschleiern.

- Mittlere durchschnittliche Präzision (mAP). Wird häufig zur Objekterkennung eingesetzt. Bewertet die Präzision über verschiedene Recall-Werte und IoU-Schwellenwerte hinweg. Leistungsstark, aber oft missverstanden oder ohne Kontext zitiert.

Diese Kennzahlen übertreiben die Leistung nicht, sondern beschreiben lediglich das, was sie messen sollen. Sie können nicht jeden Aspekt der Zuverlässigkeit erfassen, insbesondere wenn Systeme von kontrollierten Datensätzen in reale Einsatzbedingungen überführt werden.

Genauigkeit der Bilderkennung bei FlyPix AI

Bei FlyPix AI, Wir arbeiten mit Bilderkennung in realen Geodaten, wobei die Genauigkeit durch Maßstab, Komplexität und sich ändernde Bedingungen auf die Probe gestellt wird. Satelliten-, Luft- und Drohnenbilder sind selten fehlerfrei, daher muss die Genauigkeit über die üblichen Benchmarks hinaus bestehen.

Wir konzentrieren uns darauf, Bilderkennung in der Praxis nutzbar zu machen. Das bedeutet KI-Systeme, die Objekte schnell erkennen und umreißen, aber auch Modelle, die mit branchenspezifischen Daten anstatt mit generischen Beispielen trainiert werden. Durch individuelles Training kann die Genauigkeit die tatsächliche Arbeitsweise von Teams widerspiegeln, sei es im Bauwesen, in der Landwirtschaft oder bei der Infrastrukturüberwachung.

Für uns ist Genauigkeit nicht nur eine einzelne Zahl. Es geht um Konsistenz über große Datensätze hinweg, Zuverlässigkeit über die Zeit und eine stabile Leistung, die auch beim Übergang von Pilotprojekten zur Produktion erhalten bleibt. Das ist der Standard, auf dem FlyPix AI basiert.

Warum die Genauigkeit von Benchmarks irreführend sein kann

Hohe Benchmark-Ergebnisse sind zwar real, können aber einen falschen Eindruck erwecken. Viele Bilderkennungssysteme erzielen hervorragende Ergebnisse auf gängigen Datensätzen, was leicht als “Problem gelöst” interpretiert werden kann. Der Haken dabei ist, dass Benchmarks oft Leistungen unter Bedingungen belohnen, die sauberer und besser vorhersehbar sind als die, denen Systeme nach der Implementierung ausgesetzt sind.

Benchmarks testen oft den einfachen Teil

Das Problem liegt nicht darin, dass Benchmark-Ergebnisse fehlerhaft sind. Vielmehr ist es so, dass viele Benchmarks einfacher sind als die realen Bedingungen. Bilder in kuratierten Datensätzen zeigen oft klare Motive, vertraute Perspektiven und relativ übersichtliche Kompositionen. Die Beleuchtung ist stabil, Objekte sind zentriert, und die ungewöhnlichen Fälle, die Modelle in der Praxis zum Absturz bringen, treten seltener auf.

Wenn Modelle mit solchen Daten trainiert und anhand dieser Daten evaluiert werden, werden sie in dem, was sie am häufigsten sehen, sehr gut. Dann treffen sie auf die reale Welt: unterschiedliche Kamerawinkel, unruhigere Hintergründe, saisonale Veränderungen, Bewegungsunschärfe, Verdeckung und Objekte, die nicht der Abbildung im Lehrbuch entsprechen. Die Leistung kann drastisch sinken, und dieser Rückgang ist in den Genauigkeitszahlen selten sichtbar.

Die Bildschwierigkeit ist ungleichmäßig, aber die Metriken behandeln sie so, als wäre sie gleich.

Eine hilfreiche Denkweise ist folgende: Nicht jedes Bild ist gleich gut erkennbar, selbst für Menschen. Manche Bilder werden sofort verstanden. Andere erfordern einen zweiten Blick, mehr Kontext oder einfach mehr Zeit.

Die traditionelle Evaluierung behandelt alle Bilder so, als hätten sie den gleichen Schwierigkeitsgrad, was die Bedeutung von “Genauigkeit” verzerrt. Viele Benchmark-Datensätze enthalten überwiegend Bilder, die Menschen schnell erkennen können. Das ist problematisch, da Modelle scheinbar große Verbesserungen erzielen, obwohl sie sich hauptsächlich auf die einfachen Bilder konzentrieren und nicht auf die wirklich anspruchsvollen.

Größere Modelle zeigen dieses Muster oft deutlich: Starke Fortschritte bei einfacheren Bildern und geringere bei schwierigeren. Der Durchschnittswert steigt also, aber die Lücke bei schwierigen, realitätsnahen visuellen Darstellungen bleibt hartnäckig bestehen.

Menschen und Modelle scheitern auf unterschiedliche Weise.

Menschen und Maschinen gehen bei der Bilderkennung unterschiedlich vor. Menschen verlassen sich auf Kontext, Erinnerung und flexibles Denken. Modelle hingegen basieren auf gelernten statistischen Mustern. Dieser Unterschied wird deutlich, sobald ein Bild mehrdeutig, unübersichtlich oder ungewohnt wird.

Menschen können oft auch mit unvollständigen Informationen eine gute Entscheidung treffen. Modelle hingegen sind tendenziell anfälliger, und wenn das Muster nicht mehr funktioniert, kann der Fehler abrupt eintreten. Einige neuere Systeme, die Bildverarbeitung und Sprache kombinieren, verhalten sich bei ungewöhnlichen Eingaben etwas menschenähnlicher, aber eine Robustheit auf menschlichem Niveau ist noch nicht die Norm.

Deshalb basieren pauschale Behauptungen wie “KI ist dem Menschen in der Bildverarbeitung überlegen” meist auf eng gefassten Vergleichsstudien. In unübersichtlichen, unkontrollierten Umgebungen gestaltet sich die Sache komplexer, und genau dort ist Genauigkeit von größter Bedeutung.

Genauigkeit in realen Anwendungen

Industrielle und Infrastrukturnutzung

In kontrollierten Umgebungen kann die Bilderkennung sehr genau sein. Fest installierte Kameras, stabile Beleuchtung und eine begrenzte Anzahl an Objekttypen ermöglichen einen zuverlässigen Systembetrieb. Dies ist gängig bei der Fertigungsinspektion und der Infrastrukturüberwachung.

Autonome Fahrzeuge und sicherheitskritische Systeme

In dynamischen Umgebungen wie Straßen wird es schwieriger, Genauigkeit zu gewährleisten. Beleuchtung, Wetter und unvorhersehbare Objekte stellen selbst hochentwickelte Systeme vor Herausforderungen. Hier ist Zuverlässigkeit unter Belastung wichtiger als durchschnittliche Genauigkeit.

Medizinische Bildgebung

Die medizinische Bilderkennung unterliegt strengen Anforderungen. Die Bilder sind komplex und die Folgen sind gravierend. Selbst kleinste Fehler haben Konsequenzen. Verbesserungen der Genauigkeit sind zwar wertvoll, doch die Systeme erfordern eine sorgfältige Validierung und menschliche Überwachung.

Überwachung und Sicherheit

Überwachungssysteme stehen vor zusätzlichen Herausforderungen in Bezug auf Verzerrungen, Fairness und Umwelteinflüsse. Die Genauigkeit kann je nach Bevölkerungsgruppe oder Standort variieren, was Bedenken aufwirft, die über die technische Leistungsfähigkeit hinausgehen.

Schwächen des Gegners und Zuverlässigkeitsgrenzen

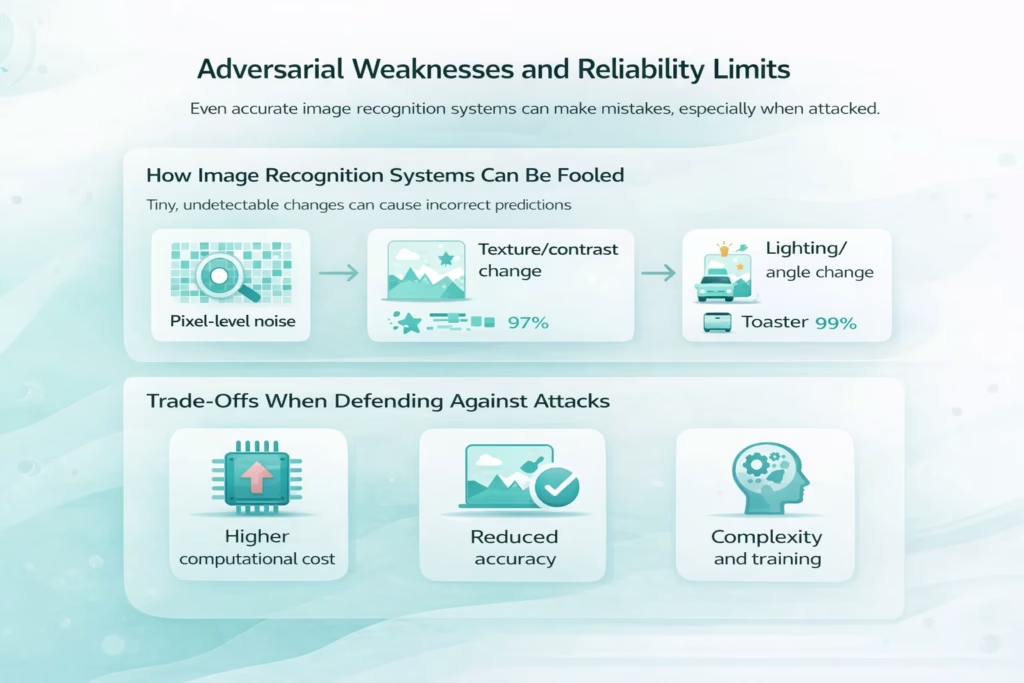

Selbst hochpräzise Bilderkennungssysteme können unerwartet versagen. Diese Fehler sind nicht immer offensichtlich und treten oft in Situationen auf, die für einen menschlichen Beobachter trivial erscheinen.

Wie Bilderkennungssysteme getäuscht werden können

Kleine, sorgfältig vorgenommene Änderungen an einem Bild können dazu führen, dass ein Modell zwar selbstsichere, aber falsche Vorhersagen trifft.

- Geringfügiges Rauschen auf Pixelebene, das für das menschliche Auge unsichtbar ist

- Subtile Textur- oder Kontrastveränderungen, die erlernte Muster verändern

- Geringfügige Änderungen der Beleuchtung, des Winkels oder der Hintergrundkomposition

- Künstliche Störungen, die speziell entwickelt wurden, um Modelle zu verwirren

Für den Betrachter sieht das Bild nach wie vor unverändert aus. Für das Model hingegen gehört es plötzlich einer völlig anderen Kategorie an.

Abwägungen bei der Verteidigung gegen Angriffe

Es gibt zwar Techniken, um Modelle robuster zu gestalten, aber diese sind selten kostenlos.

- Erhöhter Rechenaufwand und langsamere Schlussfolgerung

- Verringerte Genauigkeit bei sauberen, nicht-adversariellen Bildern

- Komplexere Schulungs- und Wartungsprozesse

- Höhere Bereitstellungs- und Betriebskosten

Aufgrund dieser Zielkonflikte akzeptieren viele Systeme in der realen Welt ein gewisses Maß an Fragilität, anstatt auf vollständige Widerstandsfähigkeit gegenüber Angriffen abzuzielen.

Warum Genauigkeit allein nicht ausreicht

Ein System kann im Durchschnitt präzise arbeiten und dennoch in den entscheidenden Momenten versagen. Viele Bilderkennungsmodelle funktionieren gut mit bekannten Daten, versagen aber bei Grenzfällen, ungewöhnlichen Bedingungen oder Szenarien, die während des Trainings unzureichend abgebildet wurden. Diese Fehler sind nicht immer gravierend. Oft arbeitet das System weiter, als wäre nichts geschehen, und liefert Ergebnisse, die zwar sicher wirken, aber in Wirklichkeit falsch sind.

Deshalb sind Konsistenz und Transparenz oft wichtiger als rein formale Genauigkeitszahlen. Teams müssen verstehen, wie sich ein System in unsicheren Situationen verhält, wo seine Schwachstellen liegen und wie Fehler auftreten. Eine verantwortungsvolle Implementierung setzt voraus, dass man nicht nur weiß, wie oft ein Modell richtig liegt, sondern auch, wie und warum es falsch liegt, wenn etwas schiefgeht.

Wie genau ist also die Bilderkennungstechnologie?

Unter kontrollierten Bedingungen kann Bilderkennungstechnologie extrem präzise arbeiten. Bei klar definierten Aufgaben, stabilen Umgebungen und Daten, die den Trainingsdatensätzen weitgehend entsprechen, kann die Leistung mit der menschlichen Leistung mithalten oder diese sogar übertreffen. Daher eignet sich die Technologie so gut für strukturierte Umgebungen wie die Fertigungsinspektion oder die Überwachung fester Infrastrukturen.

In komplexen, realen Umgebungen sinkt die Genauigkeit merklich. Modelle haben Schwierigkeiten mit seltenen Ereignissen, ungewohnten Kontexten und Veränderungen in der Datenverteilung im Zeitverlauf. Fortschritte in der Bilderkennung sind zwar vorhanden, aber ungleichmäßig. Genauigkeitsmetriken erfassen nur einen Teil des Bildes, nicht das ganze Bild, und müssen im Kontext von Kontext, Risiko und realem Verhalten interpretiert werden.

Schlussfolgerung

Die Genauigkeit der Bilderkennung ist keine Garantie. Sie ist ein bedingtes Ergebnis, das von Daten, Auswertungsmethoden und Kontext abhängt.

Bei sorgfältiger Anwendung, realistischen Erwartungen und angemessenen Sicherheitsvorkehrungen liefert die Bilderkennung echten Mehrwert. Wird sie jedoch als unfehlbar betrachtet, birgt sie Risiken.

Die wichtigste Frage ist nicht, wie genau die Bilderkennung theoretisch ist, sondern wie sie sich unter den konkreten Einsatzbedingungen verhält. Erst dann wird Genauigkeit wirklich relevant.

Häufig gestellte Fragen

Bilderkennung kann in kontrollierten Umgebungen und bei klar definierten Aufgaben sehr genau sein. Unter realen Bedingungen variiert die Genauigkeit je nach Datenqualität, Kontext und Übereinstimmung der Einsatzbedingungen mit den Trainingsdaten.

Die Genauigkeit gibt an, wie gut die Vorhersagen eines Modells gemäß bestimmter Bewertungsregeln mit den gekennzeichneten Daten übereinstimmen. Sie misst weder das Verständnis noch die Schlussfolgerungsfähigkeit oder die Zuverlässigkeit unter unerwarteten Bedingungen.

Viele Benchmarks enthalten saubere, vorhersagbare Bilder, die leichter zu erkennen sind als reale Daten. Daher können Modelle hohe Punktzahlen erzielen, ohne robust gegenüber Variationen, Rauschen oder seltenen Ereignissen zu sein.

Bei klar definierten, sich wiederholenden Aufgaben mit eindeutigen visuellen Informationen können Bilderkennungssysteme dem Menschen überlegen sein. In komplexen, mehrdeutigen oder ungewohnten Situationen bleiben Menschen im Allgemeinen zuverlässiger.

Gängige Kennzahlen sind Intersection over Union (IoU), Präzision, Trefferquote, F1-Score und mittlere durchschnittliche Präzision (mAP). Jede Kennzahl erfasst einen anderen Aspekt der Leistung und sollte im Zusammenhang mit den anderen Kennzahlen und nicht isoliert interpretiert werden.