Bilderkennung klingt komplex, aber das Grundprinzip ist überraschend einfach. Eine Maschine analysiert Bilder als Daten, lernt Muster aus Beispielen und nutzt diese Erfahrung, um das Gesehene beim nächsten Mal wiederzuerkennen. Die eigentliche Herausforderung besteht darin, wie diese Beispiele aufbereitet werden, wie das Modell daraus lernt und wie gut dieses Lernen auch außerhalb des Labors funktioniert.

In diesem Artikel erklären wir Schritt für Schritt, wie Bilderkennung im maschinellen Lernen funktioniert. Keine komplizierten mathematischen Erklärungen, keine unnötigen Fachbegriffe. Wir zeigen Ihnen anschaulich, wie Bilder in Signale umgewandelt werden, wie Modelle lernen, diese zu interpretieren, und warum manche Systeme in der Praxis gut funktionieren, während andere versagen.

Was Bilderkennung im maschinellen Lernen wirklich bedeutet

Im Kern geht es bei der Bilderkennung um Klassifizierung und Identifizierung. Ein System empfängt ein Bild und beantwortet Fragen wie:

- Was ist auf diesem Bild zu sehen?

- Wo befindet sich ein bestimmtes Objekt?

- Wie viele Objekte sind vorhanden?

- Gehören diese Bilder zur selben Kategorie?

Im Kontext des maschinellen Lernens ist die Bilderkennung ein Teilgebiet der Computer Vision. Computer Vision konzentriert sich darauf, Maschinen beizubringen, visuelle Daten so zu interpretieren, dass sie für die Entscheidungsfindung nützlich sind.

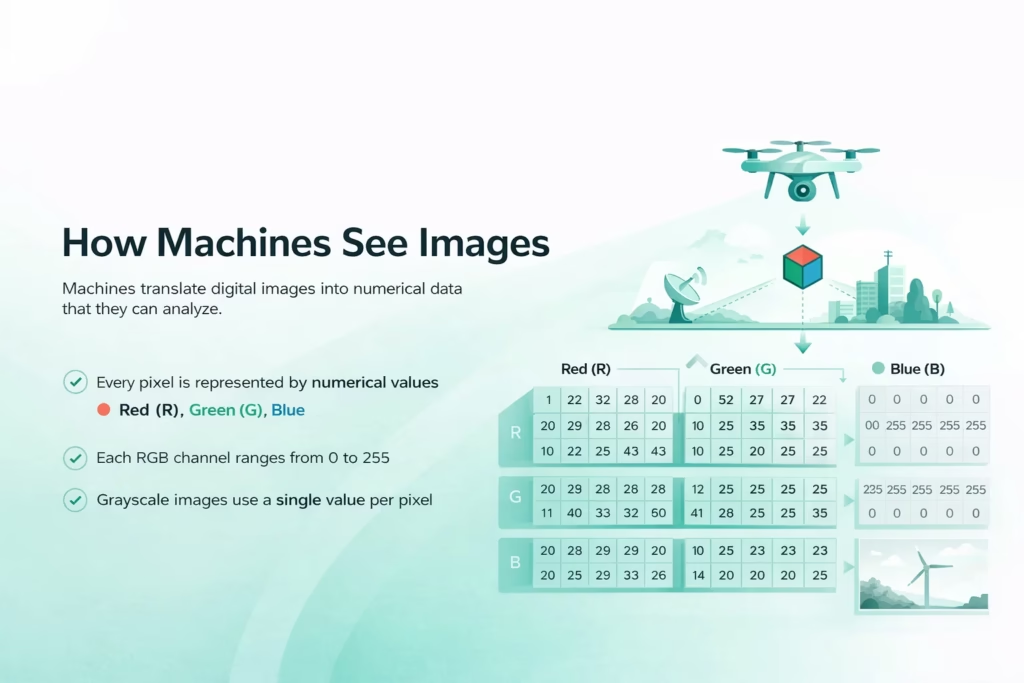

Eine wichtige Unterscheidung, die man gleich zu Beginn treffen muss, ist, dass Maschinen Bilder nicht so wahrnehmen wie Menschen. Ein Mensch sieht eine Katze. Eine Maschine sieht ein Zahlenraster. Alles, was im Bereich der Bilderkennung folgt, dient dazu, diese Kluft zu überbrücken.

Wie Maschinen Bilder sehen

Bevor ein Lernprozess stattfinden kann, muss ein Bild in ein für Maschinen verständliches Format umgewandelt werden. Digitale Bilder bestehen aus Pixeln. Jedes Pixel enthält numerische Werte, die die Farbintensität beschreiben.

In einem Standard-RGB-Bild enthält jedes Pixel drei Werte:

- Rot

- Grün

- Blau

Jeder Wert liegt typischerweise zwischen 0 und 255. Ein schwarzes Pixel wird durch Nullen dargestellt. Ein weißes Pixel verwendet die Maximalwerte. Ein vollständiges Bild ist einfach eine große Matrix dieser Zahlen.

Graustufenbilder vereinfachen dies, indem sie einen einzigen Wert pro Pixel verwenden, was die Komplexität reduziert und oft für Aufgaben ausreicht, bei denen es eher auf Form oder Kontrast als auf Farbe ankommt.

In diesem Stadium hat das Bild noch keine Bedeutung. Es sind lediglich Daten. Die gesamte Aufgabe der Bilderkennung besteht darin, zu lernen, welche Muster in diesen Daten relevant sind.

Die Rolle von Daten bei der Bilderkennung

Eine gute Bilderkennung beginnt mit guten Daten. Hier entscheidet sich der Erfolg oder Misserfolg vieler Projekte, lange bevor überhaupt ein Modell trainiert wird. Selbst leistungsstarke Algorithmen stoßen an ihre Grenzen, wenn die zugrundeliegenden Bilder nicht die realen Betriebsbedingungen widerspiegeln.

Datenerfassung

Der Datensatz muss die Bedingungen widerspiegeln, denen das Modell nach dem Einsatz ausgesetzt sein wird. In kontrollierten Umgebungen aufgenommene Bilder entsprechen selten der Variabilität in der realen Welt. Die Beleuchtung ändert sich. Blickwinkel verändern sich. Objekte überlappen sich. Die Auflösung variiert.

Ein nützlicher Datensatz umfasst

- Unterschiedliche Standpunkte

- Schwankungen der Beleuchtung

- Realistische Hintergründe

- Unvollkommene oder verrauschte Beispiele

Wenn ein Modell nur mit sauberen, idealen Bildern trainiert wird, wird es in praktischen Umgebungen, in denen die Bedingungen unvorhersehbar sind, wahrscheinlich schlecht abschneiden.

Beschriftung und Annotation

Beim überwachten Lernen müssen Bilder beschriftet werden. Die Beschriftungen geben dem Modell vor, was es lernen soll. Dies kann so einfach sein wie die Vergabe eines Kategorienamens oder so detailliert wie die Definition exakter Objektgrenzen auf Pixelebene.

Häufige Annotationstypen

- Bildbezogene Labels für die Klassifizierung

- Begrenzungsrahmen zur Objekterkennung

- Pixelmasken für die Segmentierung

- Schlüsselpunkte für die Pose-Schätzung

Die Qualität der Annotationen ist wichtiger als deren Menge. Inkonsistente oder ungenaue Bezeichnungen verwirren das Modell und schränken seine Fähigkeit ein, über die Trainingsdaten hinaus zu generalisieren.

Wie wir Bilderkennung in der Geodatenanalyse bei FlyPix AI einsetzen

Bei FlyPix AI, Wir wenden Bilderkennung auf reale Geodaten an, darunter Satelliten-, Luft- und Drohnenbilder. Diese Datensätze sind komplex und umfangreich, was die manuelle Analyse langsam und inkonsistent macht. Maschinelles Lernen ermöglicht es uns, große Gebiete in einem Bruchteil der Zeit präzise zu erkennen, zu überwachen und zu untersuchen.

Unsere Plattform nutzt KI-Agenten, um Tausende von Objekten in komplexen Szenen zu erkennen und zu umreißen. Nutzer können eigene Modelle mit ihren Annotationen trainieren, ohne Programmierkenntnisse oder tiefgreifendes KI-Wissen zu benötigen. Dadurch wird die Bilderkennung nicht nur für technische Teams, sondern auch für den Arbeitsalltag nutzbar.

Wir legen großen Wert auf Geschwindigkeit und Skalierbarkeit. Aufgaben, die früher Stunden oder Tage dauerten, lassen sich jetzt in Sekundenschnelle erledigen, sodass Teams schneller von der Bildanalyse zu Entscheidungen gelangen. Bauwesen, Landwirtschaft, Hafenbetrieb, Forstwirtschaft, Infrastruktur und Regierungsprojekte profitieren gleichermaßen von diesem Ansatz.

Für uns bedeutet Bilderkennung mehr als nur die Erkennung von Daten. Es geht darum, visuelle Daten in verlässliche Erkenntnisse umzuwandeln, die sich unter realen Bedingungen bewähren.

Vorverarbeitung: Bilder für das Lernen vorbereiten

Rohbilder werden selten direkt verwendet. Die Vorverarbeitung verbessert die Konsistenz und hilft Modellen, relevante Muster effizienter zu lernen, indem unnötige Variationen reduziert werden, bevor das Training überhaupt beginnt.

In dieser Phase werden üblicherweise Bilder auf eine feste Form skaliert, damit das Modell einheitliche Eingaben erhält. Außerdem werden Pixelwerte normalisiert, um die numerischen Bereiche stabil zu halten. Farbräume werden konvertiert, wenn Farbinformationen nicht unbedingt erforderlich sind. Durch Sensoren oder Komprimierung verursachtes Rauschen wird reduziert. Bereiche, die kein nützliches Signal liefern, werden abgeschnitten.

Die Normalisierung spielt eine besonders wichtige Rolle. Durch die Skalierung der Pixelwerte auf einen einheitlichen Bereich vermeidet das Modell numerische Instabilität während des Trainings und konvergiert zuverlässiger.

Datenaugmentation wird häufig zusammen mit der Vorverarbeitung eingesetzt. Techniken wie Drehen, Spiegeln, Zoomen und Helligkeitsanpassung führen zu kontrollierten Variationen im Datensatz, ohne neue Bilder aufzunehmen. Dies trägt dazu bei, Überanpassung zu reduzieren und die Fähigkeit des Modells zu verbessern, mit realen Veränderungen in Perspektive, Beleuchtung und Orientierung umzugehen.

Merkmalsextraktion im traditionellen maschinellen Lernen

Bevor Deep Learning dominant wurde, basierte die Bilderkennung stark auf der manuellen Merkmalsextraktion. Ingenieure legten fest, auf welche visuellen Merkmale sich das Modell konzentrieren sollte.

Typische Merkmale handgefertigter Produkte sind:

- Kanten

- Ecken

- Texturmuster

- Gradienten

Methoden wie Histogram of Oriented Gradients, Local Binary Patterns und Bag of Features transformieren Bilder in numerische Vektoren fester Länge.

Diese Ansätze funktionierten zwar für bestimmte Aufgaben gut, erforderten aber fundierte Fachkenntnisse. Zudem ließen sie sich nur schwer an veränderte Sichtverhältnisse anpassen. Jedes neue Szenario erforderte manuelle Feinabstimmungen.

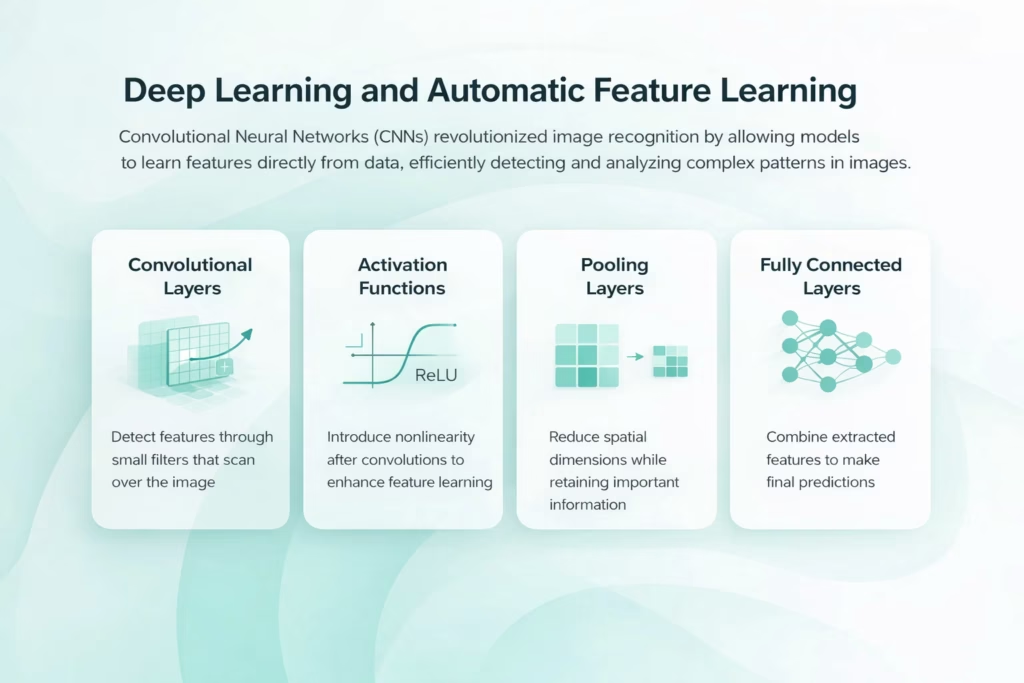

Deep Learning und automatisches Merkmalslernen

Deep Learning revolutionierte die Bilderkennung, indem es die Notwendigkeit manuell erstellter Merkmale beseitigte. Anstatt dem Modell vorzugeben, wonach es suchen soll, lernen die Entwickler Merkmale direkt aus den Daten. Convolutional Neural Networks (CNNs) bilden das Rückgrat der modernen Bilderkennung. Sie sind darauf ausgelegt, die räumliche Struktur von Bildern auszunutzen.

Faltungsschichten

Faltungsschichten wenden kleine Filter auf ein Bild an. Diese Filter reagieren auf lokale Muster wie Kanten oder Texturen. Frühe Schichten erkennen einfache Formen. Tiefere Schichten kombinieren diese zu komplexeren Strukturen. Dieser geschichtete Ansatz spiegelt die menschliche Verarbeitung visueller Informationen wider, von einfachen Linien bis hin zu vollständigen Objekten.

Aktivierungsfunktionen

Nach jeder Faltung führen Aktivierungsfunktionen zu Nichtlinearitäten. Dadurch kann das Netzwerk komplexe Zusammenhänge anstelle einfacher linearer Muster modellieren.

Pooling-Ebenen

Pooling reduziert die räumlichen Dimensionen und erhält gleichzeitig wichtige Merkmale. Dies hilft Modellen, kleine Verschiebungen oder Verzerrungen der Objektposition zu verarbeiten.

Vollständig verbundene Schichten

Am Ende des Netzwerks werden die extrahierten Merkmale kombiniert und ausgewertet, um Vorhersagen zu treffen. Diese Schichten integrieren Informationen aus dem gesamten Bild.

Der Trainingsprozess Schritt für Schritt

Das Training eines Bilderkennungsmodells ist ein iterativer Prozess. Er beinhaltet die wiederholte Verarbeitung von gelabelten Daten und die schrittweise Anpassung interner Parameter.

1. Vorwärtspass

Das Modell verarbeitet ein Bild und erstellt eine Vorhersage.

2. Verlustberechnung

Die Vorhersage wird mit dem tatsächlichen Wert verglichen. Eine Verlustfunktion misst, wie falsch die Vorhersage ist.

3. Rückpropagation

Das Modell passt seine internen Gewichte an, um den Fehler zu reduzieren. Dies geschieht durch die Rückwärtspropagierung des Verlusts durch das Netzwerk.

4. Optimierung

Ein Optimierer aktualisiert die Parameter anhand von Gradienten. Über viele Iterationen hinweg verbessert das Modell seine Genauigkeit. Das Training wird fortgesetzt, bis sich die Leistung stabilisiert oder auf den Validierungsdaten ein akzeptables Niveau erreicht.

Objekterkennung und Bildsegmentierung

Bilderkennung beschränkt sich nicht auf die Klassifizierung. In vielen realen Anwendungsszenarien reicht es nicht aus, lediglich zu wissen, dass sich ein Objekt in einem Bild befindet. Systeme müssen oft verstehen, wo sich Objekte befinden, wie viele es sind und in welcher Beziehung sie zu ihrer Umgebung stehen. Dieses räumliche Verständnis ist die Grundlage für Objekterkennung und Bildsegmentierung.

- Die Objekterkennung identifiziert Objekte und deren Positionen im Bild. Das Modell zeichnet typischerweise Begrenzungsrahmen um die Objekte und ordnet jedem Rahmen eine Klassenbezeichnung zu. Gängige Modellfamilien sind Faster R-CNN, SSD und YOLO. Die Wahl hängt oft vom Verhältnis zwischen Geschwindigkeit und Genauigkeit ab.

- Die Bildsegmentierung segmentiert Pixel anstatt Rechtecke zu zeichnen, wodurch Grenzen deutlich präziser definiert werden. Dies ist besonders nützlich bei unregelmäßigen Formen, überlappenden Objekten oder wenn es auf Genauigkeit an den Kanten ankommt. Die Instanzsegmentierung trennt einzelne Objekte derselben Klasse, während die semantische Segmentierung Bereiche im gesamten Bild nach Kategorien ordnet.

Überwachtes, unüberwachtes und selbstüberwachtes Lernen

Die meisten Bilderkennungssysteme basieren auf überwachtem Lernen, doch andere Ansätze gewinnen zunehmend an Bedeutung, da sich die Datenverfügbarkeit und die Projektbeschränkungen ändern.

Unüberwachtes Lernen

Unüberwachte Modelle erkennen Muster ohne Beschriftungen. Sie gruppieren Bilder anhand ihrer Ähnlichkeit. Dies ist nützlich, wenn nur wenige beschriftete Daten verfügbar sind.

Selbstüberwachtes Lernen

Selbstüberwachte Methoden generieren Lernsignale direkt aus den Daten. Aufgaben wie die Vorhersage fehlender Bildteile ermöglichen es Modellen, mit minimaler Beschriftung nützliche Repräsentationen zu erlernen. Diese Ansätze sind besonders wertvoll für große oder spezialisierte Datensätze.

Einsatz und Einschränkungen in der Praxis

Ein trainiertes Modell ist nur dann nützlich, wenn es nach dem Einsatz zuverlässig funktioniert. Hier stoßen viele Bilderkennungssysteme an ihre Grenzen, nicht weil das Modell schlecht konzipiert ist, sondern weil die realen Bedingungen selten mit der Trainingsumgebung übereinstimmen.

Nach der Bereitstellung sind Modelle häufig mit Schwankungen der Bildqualität konfrontiert, die durch unterschiedliche Kameras, Komprimierungsstufen oder Bewegungsunschärfe verursacht werden. Objekte können in ungewohnten Formen oder Kontexten erscheinen, und Umgebungsfaktoren wie Beleuchtung, Wetter oder unruhiger Hintergrund können Muster erzeugen, die das Modell noch nie zuvor gesehen hat. Auch Hardwarebeschränkungen spielen eine Rolle, insbesondere wenn Modelle auf ressourcenbeschränkten Geräten anstatt auf leistungsstarken Servern laufen sollen.

Bilderkennungssysteme können in der Cloud oder direkt auf Endgeräten (Edge-Geräten) ausgeführt werden. Cloudbasierte Bereitstellungen bieten höhere Rechenkapazität und einfachere Aktualisierungen, während Edge-Lösungen den Datenschutz verbessern, die Latenz reduzieren und den Betrieb von Systemen ohne ständige Verbindung ermöglichen. Der Nachteil ist die begrenzte Rechenleistung, die häufig kleinere oder optimierte Modelle erfordert.

Um langfristig effektiv zu bleiben, müssen eingesetzte Modelle kontinuierlich überwacht werden. Die Leistung kann sich durch Veränderungen der Datenverteilung verschlechtern, weshalb regelmäßiges Nachtrainieren und Anpassen erforderlich ist. Die Implementierung als fortlaufenden Prozess und nicht als abschließenden Schritt zu betrachten, ist entscheidend für eine zuverlässige Bilderkennung unter realen Bedingungen.

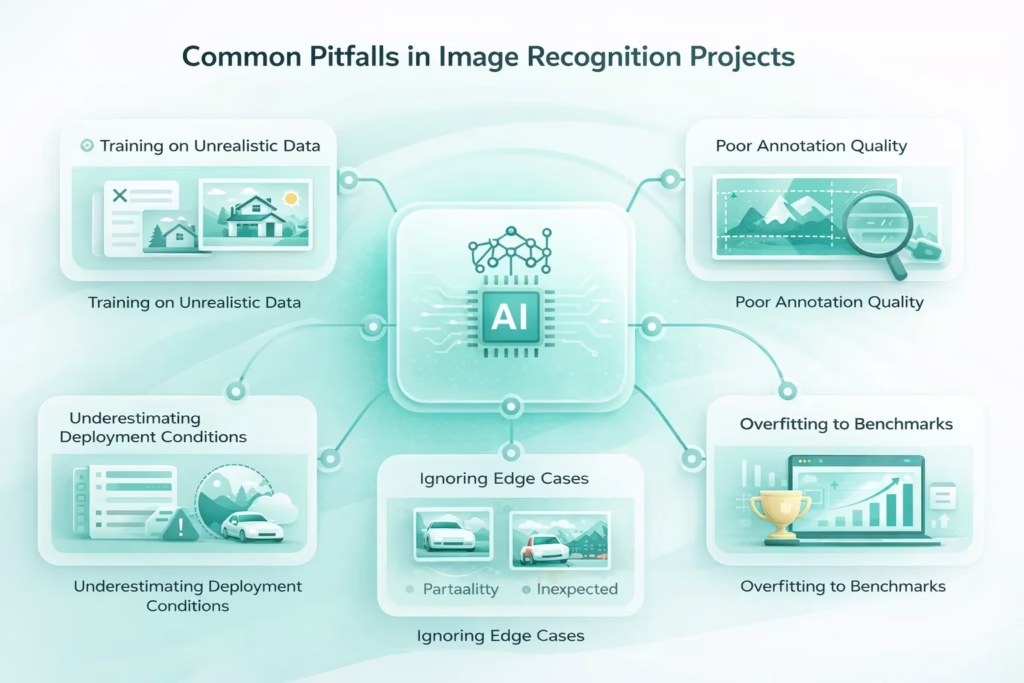

Häufige Fehler bei Bilderkennungsprojekten

Selbst gut konzipierte Bilderkennungssysteme können versagen, wenn einige wiederkehrende Probleme übersehen werden. Diese Probleme treten meist nicht während der Entwicklung auf, sondern erst, nachdem ein Modell unter realen Betriebsbedingungen eingesetzt wird.

- Training mit unrealistischen Daten. Modelle, die ausschließlich mit sauberen, gut beleuchteten und perfekt komponierten Bildern trainiert wurden, stoßen in der realen Welt oft an ihre Grenzen. Kamerarauschen, Bewegungsunschärfe, Schatten und teilweise Verdeckung können die Genauigkeit erheblich beeinträchtigen, wenn sie im Trainingsdatensatz nicht berücksichtigt werden.

- Mangelhafte Annotationsqualität. Inkonsistente Bezeichnungen, fehlende Objekte oder ungenaue Grenzen führen beim Training zu Verwirrung. Ein kleinerer Datensatz mit hochwertigen Annotationen ist in der Regel einem großen Datensatz mit ungenauer Beschriftung überlegen.

- Randfälle werden außer Acht gelassen. Seltene Situationen, ungewöhnliche Objektverläufe oder unerwartete Hintergründe werden leicht übersehen. Diese Sonderfälle sind oft für die schwerwiegendsten Fehler nach der Bereitstellung verantwortlich.

- Überanpassung an Benchmarks. Die Optimierung von Modellen für gute Ergebnisse auf Standarddatensätzen kann ein trügerisches Erfolgsgefühl erzeugen. Hohe Benchmark-Ergebnisse lassen sich nicht immer auf zuverlässige Ergebnisse bei benutzerdefinierten oder domänenspezifischen Daten übertragen.

- Unterschätzung der Einsatzbedingungen. Modelle verhalten sich nach dem Einsatz anders. Änderungen der Bildauflösung, Hardwarebeschränkungen, Netzwerklatenz oder Umgebungsbedingungen können die Leistung beeinträchtigen.

Erfolgreiche Bilderkennungssysteme basieren auf kontinuierlichen Feedbackschleifen, regelmäßigen Leistungsprüfungen und Praxistests. Die Implementierung als fortlaufenden Prozess und nicht als abschließenden Schritt zu betrachten, macht den Unterschied zwischen einem Modell, das auf dem Papier gut aussieht, und einem, das in der Praxis funktioniert.

Abschließende Gedanken

Bilderkennung im maschinellen Lernen ist keine Zauberei. Es handelt sich um einen strukturierten Prozess, der auf Daten, Lernen und Iteration basiert. Maschinen verstehen Bilder nicht im menschlichen Sinne. Sie lernen Zusammenhänge zwischen Mustern und Ergebnissen.

Die Leistungsfähigkeit der Bilderkennung beruht nicht auf einem einzelnen Algorithmus, sondern auf dem gesamten System. Datenqualität. Trainingsstrategie. Disziplin bei der Evaluierung. Und sorgfältige Implementierung.

Wenn diese Elemente zusammenpassen, wird die Bilderkennung zu einem zuverlässigen Werkzeug und nicht zu einer fragilen Demonstration. Und genau das macht sie praktisch.

Häufig gestellte Fragen

Bilderkennung im maschinellen Lernen ist der Prozess, einem System beizubringen, Objekte, Muster oder Merkmale in Bildern zu identifizieren und zu klassifizieren. Das Modell lernt anhand von beschrifteten oder unbeschrifteten Bilddaten und nutzt diese Erfahrung, um neue, unbekannte Bilder zu interpretieren.

Maschinen sehen Bilder nicht als Objekte oder Szenen. Sie verarbeiten Bilder als numerische Daten, die aus Pixelwerten bestehen. Bilderkennungsmodelle lernen Muster in diesen Zahlen, wie Kanten, Texturen und Formen, und verknüpfen diese durch Training mit bekannten Ergebnissen.

Bilderkennung bezeichnet üblicherweise die Identifizierung von Objekten in einem Bild, oft auf einer allgemeinen Ebene. Objekterkennung geht darüber hinaus, indem sie einzelne Objekte identifiziert und diese mithilfe von Begrenzungsrahmen im Bild lokalisiert. Die Objekterkennung erweitert die räumliche Orientierung um eine einfache Klassifizierung, die diese nicht bietet.

Die Objekterkennung umreißt Objekte mithilfe von Rechtecken, während die Bildsegmentierung einzelne Pixel kennzeichnet. Die Segmentierung ermöglicht präzisere Abgrenzungen und wird eingesetzt, wenn es auf exakte Formen oder Bereiche ankommt, beispielsweise in der medizinischen Bildgebung oder Satellitenanalyse.

Das Modell kann nur aus den ihm zugeführten Daten lernen. Bilder von geringer Qualität, inkonsistente Beschriftungen oder unrealistische Trainingsbeispiele führen zu schwachen Ergebnissen. Hochwertige, gut annotierte Daten haben in der Regel einen größeren Einfluss als komplexere Modellarchitekturen.

Die benötigte Datenmenge hängt von der Komplexität der Aufgabe und des verwendeten Modells ab. Einfache Klassifizierungsaufgaben können Tausende von Bildern erfordern, während komplexere Erkennungs- oder Segmentierungsaufgaben deutlich mehr Daten benötigen. Transferlernen und selbstüberwachte Verfahren können den Datenbedarf reduzieren.