Bilderkennungsmodelle scheitern selten aufgrund einer fehlerhaften Architektur. Sie scheitern vielmehr, weil Genauigkeit falsch verstanden, ungenau gemessen oder unter realitätsfernen Bedingungen überprüft wird. Ein Modell kann während des Trainings beeindruckend erscheinen und dennoch versagen, sobald es mit realen Daten in Berührung kommt.

Die Überprüfung der Genauigkeit von Bilderkennungssystemen beschränkt sich nicht auf einen einzelnen Messwert. Vielmehr geht es darum zu verstehen, was das Modell richtig erkennt, was es falsch macht und warum diese Fehler auftreten. In der Praxis ist Genauigkeit eine Kombination aus verschiedenen Metriken, sorgfältiger Validierung und praxisnahen Tests anhand realer Szenarien. Dieser Leitfaden zeigt Ihnen, wie Sie Bilderkennungssysteme so evaluieren, dass Sie feststellen können, ob sie einsatzbereit sind.

Warum die Gesamtgenauigkeit selten die Wahrheit sagt

Die Gesamtgenauigkeit ist zwar die gebräuchlichste, aber auch die am wenigsten aussagekräftige Metrik, sobald Projekte über einfache Beispielprobleme hinausgehen. Sie misst, wie oft Vorhersagen mit den Labels übereinstimmen, ignoriert aber Klassenungleichgewichte, Fehlerschweregrade und Verteilungsverschiebungen.

Ein Modell kann eine sehr hohe Genauigkeit erzielen, indem es bei häufigen, einfachen Fällen gut abschneidet, während es bei seltenen, aber kritischen Fällen konsequent versagt. In realen Projekten sind diese seltenen Fälle oft der eigentliche Grund für die Existenz des Modells.

Die Gesamtgenauigkeit ist zwar nicht nutzlos, sollte aber als oberflächliches Signal betrachtet werden. Sie kann zwar auf einen offensichtlichen Defekt hinweisen, aber sie bestätigt nicht die Zuverlässigkeit eines Systems.

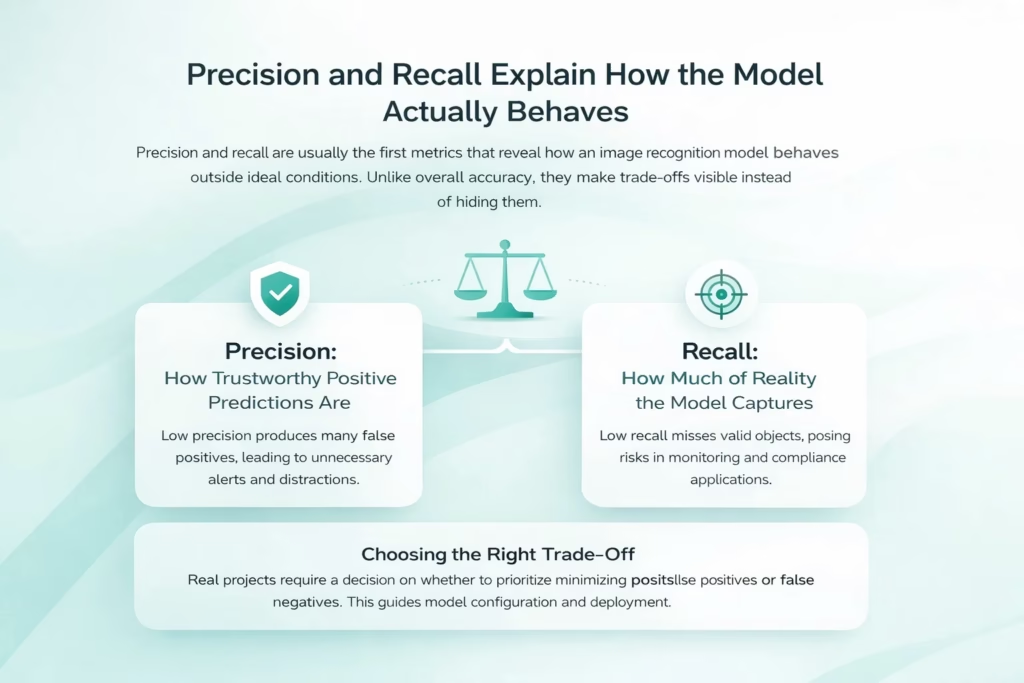

Präzision und Trefferquote erklären das tatsächliche Verhalten des Modells.

Präzision und Trefferquote sind in der Regel die ersten Kennzahlen, die aufzeigen, wie sich ein Bilderkennungsmodell außerhalb idealer Bedingungen verhält. Im Gegensatz zur Gesamtgenauigkeit machen sie Kompromisse sichtbar, anstatt sie zu verbergen.

Präzision: Wie vertrauenswürdig positive Vorhersagen sind

Die Präzision gibt an, wie oft das Modell bei einer positiven Vorhersage richtig liegt. Eine geringe Präzision bedeutet, dass das System viele Fehlalarme auslöst. In realen Projekten wird dies schnell zum Problem, wenn jede Erkennung eine Warnung, einen Workflow oder eine manuelle Überprüfung auslöst. Selbst ein technisch präzises Modell kann unbrauchbar werden, wenn es ständig unnötigen Aufwand erfordert.

Zur Erinnerung: Wie viel von der Realität erfasst das Modell?

Die Trefferquote (Recall) misst die Abdeckung. Sie zeigt, wie viel von dem tatsächlich Vorhandenen das Modell erkennt. Ein Modell mit niedriger Trefferquote übersieht gültige Objekte, selbst wenn die erkannten Objekte korrekt sind. In Überwachungs-, Sicherheits- oder Compliance-Systemen bergen übersehene Objekte oft ein höheres Risiko als Fehlalarme.

Die richtige Abwägung wählen

Präzision und Trefferquote beschreiben unterschiedliche Fehlermodi, und keiner von beiden ist generell besser. In realen Projekten muss explizit entschieden werden, welche Fehler akzeptabel sind. Diese Entscheidung sollte die Schwellenwertanpassung, die Modellauswahl und die letztendliche Beurteilung der Genauigkeit bestimmen.

Bilderkennungsgenauigkeit in der Praxis bei FlyPix AI

Bei FlyPix AI, Wir arbeiten mit Bilderkennung, bei der die Genauigkeit unter realen Bedingungen und nicht nur mit sauberen Testdaten bestehen muss. Satelliten-, Luft- und Drohnenbilder sind naturgemäß komplex, daher konzentrieren wir uns auf eine Genauigkeit, die in verschiedenen Umgebungen, Maßstäben und bei Veränderungen erhalten bleibt.

Wir betrachten Genauigkeit nicht als einen einzelnen Wert. Unsere Plattform unterstützt Teams beim Trainieren eigener Modelle, der visuellen Validierung von Erkennungen und schnellen Iterationen. Indem wir das Domänenwissen eng mit dem Modell verknüpfen und den Zeitaufwand für Testen und Nachtrainieren reduzieren, ermöglichen wir Teams, aktiv mit Genauigkeit zu arbeiten – anstatt sie nur einmal zu messen.

Die Genauigkeit endet auch nicht mit der Bereitstellung. Da sich Bildmaterial im Laufe der Zeit verändert, unterstützen unsere Arbeitsabläufe die kontinuierliche Validierung und das erneute Training, sodass die Modelle stets den realen Bedingungen entsprechen und nicht langsam an Relevanz verlieren.

Gemeinsame Interpretation der wichtigsten Genauigkeitsmetriken

Sobald die grundlegenden Genauigkeitswerte vorliegen, beginnt die eigentliche Arbeit. Bilderkennungssysteme scheitern selten an fehlenden Kennzahlen, sondern daran, dass Kennzahlen isoliert betrachtet werden. Präzision, Trefferquote, F1-Score, IoU und mAP beschreiben unterschiedliche Aspekte des Modellverhaltens und sind für sich genommen nicht aussagekräftig. Ziel ist es, ihre Wechselwirkungen zu verstehen und zu erkennen, was sie im Zusammenspiel offenbaren.

Die F1-Wertung nutzen, ohne Details zu verlieren

Der F1-Score kombiniert Präzision und Trefferquote in einer einzigen Zahl. Er eignet sich gut für Vergleiche, insbesondere wenn keine der beiden Kennzahlen dominieren sollte.

Der F1-Score sollte jedoch niemals die direkte Überprüfung von Präzision und Trefferquote ersetzen. Zwei Modelle mit demselben F1-Score können sich in der Praxis sehr unterschiedlich verhalten. Das eine Modell übersieht möglicherweise seltene Fälle, das andere überflutet das System mit Fehlalarmen.

Betrachten Sie den F1-Wert als Zusammenfassung, nicht als Schlussfolgerung.

Die Genauigkeit der Objekterkennung verändert die Regeln

Die Genauigkeit der Bilderkennung wird komplexer, wenn Objekterkennung einbezogen wird. Erkennungssysteme müssen erkennen, was vorhanden ist, und es im Bild korrekt lokalisieren.

Die Intersection over Union (IoU) misst, wie gut die vorhergesagten Begrenzungsrahmen mit den tatsächlichen Begrenzungsrahmen übereinstimmen. Dadurch wird die Genauigkeit zu einem räumlichen Problem anstatt einer einfachen Klassifizierungsaufgabe.

Die Wahl der IoU-Schwellenwerte ist keine rein technische Angelegenheit. Zu niedrige Schwellenwerte können Lokalisierungsprobleme verschleiern. Zu hohe Schwellenwerte können Erkennungen bestrafen, die für den operativen Einsatz völlig ausreichend sind. In realen Projekten sollte der IoU-Wert die erforderliche Genauigkeit der Erkennungen widerspiegeln und nicht das, was in Berichten am besten aussieht.

Mittlere durchschnittliche Präzision und ihre Grenzen

Die mittlere durchschnittliche Präzision (mAP) ist weit verbreitet, da sie Erkennungssicherheit, Rankingqualität und Lokalisierungsgenauigkeit über verschiedene Schwellenwerte hinweg kombiniert. Sie bietet eine strukturierte Möglichkeit, Objekterkennungsmodelle zu vergleichen, die unter ähnlichen Bedingungen trainiert wurden.

mAP ist vor allem als Vergleichsmetrik wertvoll. Es hilft Teams zu verstehen, ob ein Ansatz die Erkennungsqualität im Vergleich zu einem anderen verbessert. Was es jedoch nicht garantiert, ist Robustheit. Ein Modell kann bei mAP gute Werte erzielen und dennoch unter bestimmten Lichtverhältnissen, in bestimmten Umgebungen oder bei bestimmten Objektanordnungen versagen.

Aus diesem Grund sollte mAP als eine Art Linse und nicht als ein Urteil betrachtet werden.

Achten Sie stets auf die Leistung pro Klasse.

Einer der häufigsten Gründe für das Versagen von Bilderkennungssystemen ist die uneinheitliche Leistung der einzelnen Klassen. Aggregierte Metriken verschleiern dieses Problem.

Bei der Bewertung der Genauigkeit sollten Sie stets die Metriken pro Klasse prüfen. Dies zeigt, ob bestimmte Objekte generell schwieriger zu erkennen sind oder eher mit anderen verwechselt werden.

Dieser Schritt verändert oft die Prioritäten. Ein Modell, das insgesamt vielversprechend aussieht, kann unakzeptabel sein, wenn es in den wichtigsten Bereichen versagt.

Konfusionsmatrizen wandeln Fehler in Muster um

Konfusionsmatrizen gehören zu den praktischsten Werkzeugen, um das Verhalten eines Bilderkennungsmodells zu verstehen. Anstatt Fehler in einem einzigen Wert zusammenzufassen, zeigen sie, wie sich Vorhersagen zwischen den Klassen verändern und decken so die Struktur der Fehler auf.

Was Konfusionsmatrizen offenbaren

Durch den Vergleich von Vorhersagen mit den tatsächlichen Gegebenheiten helfen Konfusionsmatrizen dabei, Fragen zu beantworten, die mit skalaren Metriken nicht beantwortet werden können:

- Welche Klassen werden am häufigsten miteinander verwechselt?

- Ob Fehler eher einseitig oder beidseitig auftreten.

- Ob sich Fehler um visuell ähnliche oder sich überschneidende Kategorien gruppieren

Warum diese Sichtweise wichtig ist

Diese Muster weisen oft direkt auf zugrundeliegende Probleme hin, wie etwa uneindeutige Klassendefinitionen, inkonsistente Kennzeichnung oder fehlende Trainingsbeispiele. Da Konfusionsmatrizen Beziehungen zwischen Klassen aufzeigen, sind sie besonders hilfreich, um zu entscheiden, ob weitere Daten erhoben, Kennzeichnungen verfeinert oder Klassengrenzen angepasst werden sollten.

Die Validierung funktioniert nur mit wirklich unbekannten Daten.

Die Genauigkeitsbewertung versagt, wenn die Validierungsdaten den Trainingsdaten zu ähnlich sind. Dies geschieht häufiger, als die Teams erwarten.

Wenn augmentierte Versionen derselben Bilder in mehreren Teilungen auftreten oder die Daten aus denselben, eng begrenzten Bedingungen stammen, erscheint die Genauigkeit künstlich hoch. Das Modell wird anhand von Variationen dessen getestet, was es bereits gesehen hat.

Ein aussagekräftiger Testdatensatz sollte sich in relevanten Aspekten unterscheiden. Dies kann beispielsweise die Verwendung unterschiedlicher Standorte, Geräte, Zeiträume oder Aufnahmebedingungen umfassen. Ohne diese Differenzierung wird die Genauigkeitsbewertung zu einer Bestätigung der bisherigen Ergebnisse anstatt zu einer Vorhersage.

Tests unter realen Bedingungen verändern die Schlussfolgerungen

Viele Genauigkeitsprobleme treten erst zutage, wenn Modelle auf Unvollkommenheiten der realen Welt treffen. Bewegungsunschärfe, Rauschen, Verdeckung, Kompressionsartefakte und schlechte Beleuchtung decken Schwächen auf, die in sauberen Datensätzen verborgen bleiben.

Tests unter realistischen Bedingungen führen oft zu unbequemen, aber wertvollen Erkenntnissen. Ein Modell, das in idealen Szenarien gut funktioniert, kann Schwierigkeiten haben, sobald die Bedingungen auch nur geringfügig abweichen. Dies vor der Implementierung zu erkennen, spart Zeit, Kosten und Glaubwürdigkeit.

Diese Phase erfordert keine perfekte Simulation. Sie erfordert eine realistische Darstellung, wie Bilder in der Produktion tatsächlich aussehen.

Genauigkeit im Laufe der Zeit und die Rolle von Verzerrungen

Die Genauigkeit der Bilderkennung ist nicht statisch. Daten aus der realen Welt verändern sich ständig, und Modelle, die nicht überwacht werden, entfernen sich allmählich von der Realität. Saisonale Schwankungen, neue Hardware, Umweltveränderungen und verändertes Nutzerverhalten beeinflussen das Aussehen von Bildern und deren Interpretation durch die Modelle. Wird die Genauigkeit nur bei der Markteinführung überprüft, bleibt diese schleichende Verschlechterung oft unbemerkt, bis Fehler offensichtlich werden.

Die Genauigkeitsprüfungen nach der Implementierung sollten sich auf Trends und nicht auf einzelne Zahlen konzentrieren. Ein schleichender Leistungsabfall ist oft gefährlicher als ein plötzlicher Ausfall, da er sich hinter vertrauten Kennzahlen verbirgt. Kontinuierliche Überwachung ermöglicht es, subtile Veränderungen frühzeitig zu erkennen und zu reagieren, bevor die Genauigkeit unter ein akzeptables Niveau sinkt.

Verzerrungen spielen in diesem Prozess eine direkte Rolle. Modelle, die mit einseitigen oder unausgewogenen Daten trainiert wurden, erzielen tendenziell nur unter den ihnen bereits bekannten Bedingungen gute Ergebnisse. Treten neue Umgebungen, Objekttypen oder visuelle Muster auf, überschätzen Genauigkeitsmetriken die Zuverlässigkeit. Die Reduzierung von Verzerrungen verbessert nicht nur die Abdeckung, sondern auch die Robustheit. Fairere Modelle sind in der Regel über die Zeit stabiler und leichter an veränderte Bedingungen anzupassen.

Genauigkeit als Grundlage für echte Entscheidungen

Genauigkeitskennzahlen dienen der Entscheidungsfindung, nicht der Beeindruckung von Stakeholdern. Berichte sollten Kompromisse, Einschränkungen und bekannte Risiken erläutern, anstatt sie hinter einer einzigen Zahl zu verbergen. Wird Genauigkeit ohne Kontext präsentiert, erzeugt dies ein falsches Sicherheitsgefühl und führt dazu, dass Teams Probleme übersehen, die später im Produktivbetrieb auftreten.

In der Praxis sollte eine sinnvolle Genauigkeitsberichterstattung Folgendes verdeutlichen:

- Welche Fehlertypen sind am wichtigsten und warum sind sie akzeptabel oder nicht?

- Wo das Modell ungleichmäßig funktioniert, einschließlich Klassen oder Szenarien mit geringerer Zuverlässigkeit

- Welche Bedingungen werden bei der Bewertung berücksichtigt, z. B. Datenquellen, Umgebungen oder Zeiträume?

- Wie sich die Leistung voraussichtlich im Laufe der Zeit verändern wird und wie sie überwacht wird

Eine klare und ehrliche Berichterstattung schafft Vertrauen zwischen den Teams und führt zu Systemen, die leichter zu warten, zu verbessern und im realen Einsatz zuverlässiger zu nutzen sind.

Wenn ein Modell tatsächlich fertig ist

Ein Modell ist einsatzbereit, wenn sein Verhalten verstanden wird, nicht wenn seine Kennzahlen ihren Höchstwert erreichen. Hohe Werte können eine schwache Leistungsfähigkeit verschleiern, insbesondere wenn sie auf kleinen Datensätzen oder idealen Bedingungen basieren. Entscheidender ist, zu wissen, wie das Modell versagt, wo diese Fehler auftreten und ob sie mit einem akzeptablen Risiko vereinbar sind. Vorhersehbare Fehler lassen sich durch Schwellenwerte, Arbeitsabläufe oder erneutes Training beheben. Unbekannte Fehler treten später auf, in der Regel dann, wenn die Kosten für ihre Behebung höher sind.

Echte Einsatzbereitschaft entsteht durch disziplinierte Evaluierung, nicht durch optimistische Interpretation. Das bedeutet Tests unter realistischen Bedingungen, Validierung anhand tatsächlich unbekannter Daten und Überwachung der Leistung nach der Implementierung. Ein Modell, das kontinuierlich beobachtet und angepasst wird, ist weitaus zuverlässiger als eines, das beim Start lediglich vielversprechend aussah.

Abschließende Gedanken

Bei der Überprüfung der Genauigkeit der Bilderkennung in realen Projekten geht es nicht darum, die höchste Punktzahl zu erzielen. Es geht darum zu verstehen, wie sich ein System verhält, wenn die Realität eingreift.

Kennzahlen sind Werkzeuge. Sorgfältig eingesetzt, decken sie Stärken und Schwächen auf. Unachtsam verwendet, erzeugen sie Vertrauen ohne Verlässlichkeit.

Der Unterschied zwischen einer Demo und einem zuverlässigen Bilderkennungssystem liegt nicht in der Architektur. Er liegt darin, wie ehrlich die Genauigkeit gemessen, getestet und im Laufe der Zeit aufrechterhalten wird.

Häufig gestellte Fragen

Es gibt keine allgemein beste Kennzahl. Die Gesamtgenauigkeit kann zwar als erster Anhaltspunkt dienen, ist aber allein selten ausreichend. In realen Projekten sollte die Genauigkeit anhand einer Kombination aus Präzision, Trefferquote und aufgabenspezifischen Metriken wie IoU oder mAP für die Objekterkennung bewertet werden. Die richtige Kombination hängt davon ab, welche Fehlerarten in Ihrem Anwendungsfall am relevantesten sind.

Dies geschieht üblicherweise, wenn die Auswertungsdaten den Trainingsdaten zu ähnlich sind oder die realen Bedingungen nicht widerspiegeln. Saubere Bilder, eingeschränkte Umgebungen oder Datenlecks zwischen den Aufteilungen können die Genauigkeitswerte verfälschen. Sobald das Modell auf neue Lichtverhältnisse, Blickwinkel, Rauschen oder Umgebungen trifft, treten Schwächen zutage, die zuvor nicht getestet wurden.

Es kommt auf die Kosten von Fehlern an. Wenn Fehlalarme manuelle Überprüfungen, Warnmeldungen oder automatisierte Aktionen auslösen, ist Präzision wichtiger. Wenn fehlende Objekte Risiken oder blinde Flecken verursachen, ist die Trefferquote wichtiger. Die meisten realen Systeme erfordern einen bewussten Kompromiss, anstatt blind eine einzelne Kennzahl zu optimieren.

Nein. Der F1-Score eignet sich zwar gut für Vergleiche, verschleiert aber das Verhältnis von Präzision und Trefferquote. Zwei Modelle mit demselben F1-Score können sich in der Praxis sehr unterschiedlich verhalten. Präzision und Trefferquote sollten daher immer separat betrachtet werden, bevor Entscheidungen getroffen werden.

Die Genauigkeit sollte nach der Inbetriebnahme regelmäßig, nicht nur einmalig, überprüft werden. Die optimale Häufigkeit hängt von der Geschwindigkeit der Datenänderung ab, aber jedes System, das neuen Umgebungen, Jahreszeiten oder Hardware ausgesetzt ist, sollte kontinuierlich überwacht werden. Langsame Leistungsveränderungen sind häufig und bleiben oft unbemerkt, wenn keine Trends verfolgt werden.