Beim Training eines Bilderkennungsmodells geht es weniger um ausgeklügelte Algorithmen als vielmehr darum, die Grundlagen zu beherrschen. Gute Daten, eindeutige Labels und ein durchdachter Trainingsprozess sind weitaus wichtiger als die neueste Architektur. Werden diese Aspekte vernachlässigt, wird selbst das beste Modell in der Praxis Schwierigkeiten haben.

Dieser Leitfaden zeigt Teams, wie sie Bilderkennungsmodelle trainieren, die auch außerhalb des Labors zuverlässig funktionieren. Er ist nicht theorielastig und nicht akademisch. Vielmehr bietet er einen klaren Überblick darüber, worauf es ankommt, was häufig schiefgeht und wie man ein Modell entwickelt, das zuverlässig lernt und sich mit der Zeit verbessert.

Was das Training eines Bilderkennungsmodells wirklich beinhaltet

Bevor wir zu den einzelnen Schritten kommen, ist es hilfreich, ein weit verbreitetes Missverständnis auszuräumen. Beim Training eines Bilderkennungsmodells geht es nicht darum, einem System beizubringen, wie Menschen zu “sehen”. Es geht vielmehr darum, ihm beizubringen, statistische Muster in Pixeln zu erkennen und diese Muster mit von Ihnen definierten Labels zu verknüpfen.

Im Kern bedeutet Training, einem Modell viele Bildbeispiele zu zeigen, ihm zu erklären, was korrekt ist, und es anhand von Fehlern selbstständig korrigieren zu lassen. Mit der Zeit lernt das Modell, welche visuellen Signale relevant sind und welche ignoriert werden können. Kanten, Texturen, Formen, Farbübergänge und räumliche Beziehungen werden Teil dieser internen Repräsentation.

Dieser Prozess hängt vor allem von drei Dingen ab:

- Die Qualität und Relevanz der Daten

- Die Klarheit und Einheitlichkeit der Etiketten

- Der durch Bewertung und Iteration erzeugte Feedback-Kreislauf

Algorithmen und Architekturen sind wichtig, können aber selten schwache Daten oder unklare Ziele ausgleichen. Ein einfaches, mit gut aufbereiteten Daten trainiertes Modell ist einem komplexen, nachlässig trainierten Modell fast immer überlegen.

Es ist außerdem wichtig zu verstehen, dass Training kein einmaliger Vorgang ist. Bilderkennungssysteme verbessern sich schrittweise. Frühe Versionen sind oft ungenau. Die Leistung steigt mit besseren Daten, der Hinzunahme von Sonderfällen und der Korrektur von Annahmen.

Mit dieser Denkweise wird der unten beschriebene Schritt-für-Schritt-Prozess leichter nachzuvollziehen und wesentlich effektiver anzuwenden.

Unser Ansatz zum Training von Bilderkennungsmodellen bei FlyPix AI

Bei FlyPix AI, Wir trainieren Bilderkennungsmodelle für reale Geodatenbedingungen, nicht für kontrollierte Demos. Satelliten-, Luft- und Drohnenbilder weisen Rauschen, Variationen und Komplexität auf. Daher ist unser Trainingsprozess von Anfang an darauf ausgelegt, Skalierung, Inkonsistenzen und Sonderfälle zu bewältigen.

Wir ermöglichen das Training benutzerdefinierter KI-Modelle ohne Programmierung und bieten dabei volle Kontrolle darüber, was das Modell erkennt und wie es lernt. Nutzer definieren Objekte, Annotationen und Prioritäten. Unsere Plattform kümmert sich im Hintergrund um Modelltraining, Optimierung und Infrastruktur.

Das Training wird nicht als einmaliger Schritt betrachtet. Wir gestalten es als iterativen Prozess, in dem sich die Modelle mit jedem neuen Bildmaterial und sich ändernden Bedingungen verbessern. Aktives Lernen hilft, das Training auf unsichere Fälle zu konzentrieren, sodass die Anstrengungen dort eingesetzt werden, wo sie die Genauigkeit tatsächlich verbessern.

Unser Ziel ist nicht nur Geschwindigkeit, sondern auch Zuverlässigkeit. Durch das Training mit realen Geodaten stellen wir sicher, dass sich unsere Modelle im Produktiveinsatz bewähren und nicht nur in Tests. Das Ergebnis ist eine Bilderkennung, die komplexe Bilder in nutzbare Erkenntnisse für Branchen wie Landwirtschaft, Infrastruktur, Forstwirtschaft und den öffentlichen Sektor umwandelt.

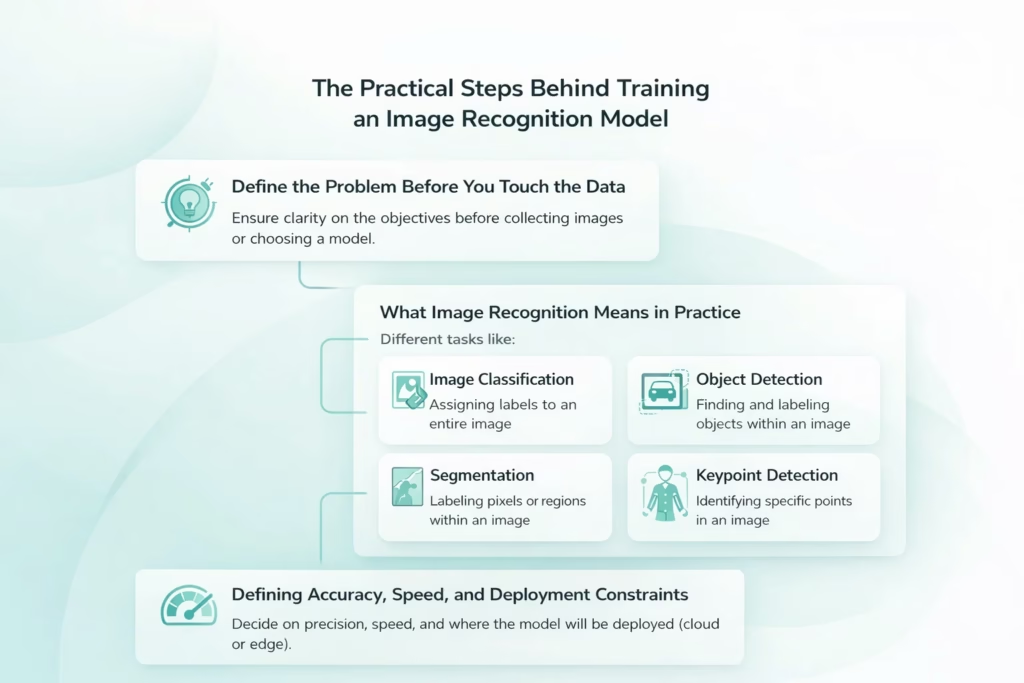

Die praktischen Schritte hinter dem Training eines Bilderkennungsmodells

Das Training eines Bilderkennungsmodells ist kein einzelner großer technischer Sprung. Es ist eine Abfolge kleiner, wohlüberlegter Entscheidungen, die aufeinander aufbauen. Jeder Schritt löst ein spezifisches Problem, und das Überspringen oder Übereilen eines Schrittes führt in der Regel später zu geringer Genauigkeit, instabilen Vorhersagen oder einem Modell, das nur unter idealen Bedingungen funktioniert.

Die folgenden Schritte entsprechen dem Trainingsprozess von Bilderkennungssystemen in realen Projekten. Er umfasst die Aufgabenstellung, die Datenaufbereitung, das Training, die Evaluierung und die langfristige Wartung. Obwohl sich Werkzeuge und Architekturen ändern können, bleibt dieser zugrunde liegende Prozess über Branchen und Anwendungsfälle hinweg erstaunlich konstant.

Schritt 1: Definieren Sie das Problem, bevor Sie die Daten bearbeiten.

Bevor Sie Bilder sammeln oder ein Modell auswählen, müssen Sie genau wissen, was das System leisten soll. Das klingt selbstverständlich, doch genau hier scheitern viele Projekte unbemerkt. Unklare Ziele führen zu falschen Daten, falschen Bezeichnungen und falschen Bewertungskriterien.

Was Bilderkennung in der Praxis bedeutet

Bilderkennung ist keine einheitliche Aufgabe. Sie kann verschiedene Formen annehmen, je nachdem, was das System liefern soll.

- Bildklassifizierung. Einem gesamten Bild ein oder mehrere Labels zuweisen.

- Objekterkennung. Objekte in einem Bild finden und ihre Positionen und Kategorien bestimmen.

- Segmentierung. Das Beschriften von Pixeln oder Regionen anstelle des Zeichnens von Begrenzungsrahmen wird häufig angewendet, wenn es auf Genauigkeit ankommt.

- Schlüsselpunkterkennung. Identifizierung spezifischer Punkte in einem Bild, wie z. B. Gelenke, Orientierungspunkte oder Referenzmarken.

Jeder dieser Ansätze erfordert ein anderes Trainingssetup, eine andere Annotationsstrategie und eine andere Evaluierungsmethode. Ein für die Bildklassifizierung trainiertes Modell eignet sich nicht automatisch zur Objekterkennung. Die Struktur der Ausgabe bestimmt alles Weitere.

Definition von Genauigkeits-, Geschwindigkeits- und Einsatzbeschränkungen

Neben der eigentlichen Aufgabe müssen Sie auch entscheiden, wie präzise das System sein soll. Ist eine grobe Klassifizierung ausreichend oder benötigen Sie pixelgenaue Präzision? Ist Geschwindigkeit wichtiger als Genauigkeit? Soll das Modell in der Cloud oder auf Edge-Geräten mit begrenzten Ressourcen laufen?

Die frühzeitige Beantwortung dieser Fragen beugt Überentwicklung vor und hilft Ihnen, später im Trainingsprozess die richtigen Kompromisse zu finden.

Schritt 2: Sammeln Sie Daten, die die reale Welt widerspiegeln

Ein Bilderkennungsmodell lernt nur das, was man ihm zeigt. Wenn die Trainingsdaten nicht der realen Nutzung entsprechen, wird die Leistung nach der Implementierung stark nachlassen.

Gute Datensätze sind nicht nur groß, sondern auch repräsentativ.

Das bedeutet:

- Bilder, aufgenommen unter verschiedenen Lichtverhältnissen

- Variationen von Winkeln, Entfernungen und Perspektiven

- Unterschiedliche Hintergründe und Umgebungen

- Teilokklusionen und Überlappungen

- Reale Unvollkommenheiten wie Unschärfe, Rauschen oder Kompressionsartefakte

Ein häufiger Fehler besteht darin, das Modell mit sauberen, idealen Bildern zu trainieren und zu erwarten, dass es auch unter schwierigen Bedingungen funktioniert. Reale Kameras verhalten sich nicht wie sorgfältig zusammengestellte Datensätze.

Ein weiteres häufiges Problem ist das Klassenungleichgewicht. Wenn eine Kategorie deutlich häufiger vorkommt als andere, lernt das Modell, diese zu bevorzugen. Man erzielt zwar theoretisch eine hohe Genauigkeit, übersieht aber seltene, wichtige Fälle. In dieser Phase ist es besser, weniger, aber realitätsnahe Bilder zu haben als einen riesigen Datensatz, der die Realität nicht widerspiegelt.

Schritt 3: Daten richtig vorbereiten und strukturieren

Sobald die Bilder gesammelt sind, müssen sie so organisiert werden, dass das Modell daraus lernen kann. Hierbei ist Disziplin gefragt. Kleine Abkürzungen in dieser Phase führen später oft zu verwirrendem Trainingsverhalten.

- Grundregeln für die Organisation des Datensatzes. Bevor das Training beginnt, sollten die Bilder einigen grundlegenden Strukturprinzipien folgen.

- Einheitlichkeit der Bilder. Alle Bilder sollten ein einheitliches Format und eine einheitliche Auflösung aufweisen. Unterschiedliche Bildgrößen, Farbräume oder Dateitypen führen zu unnötiger Variabilität und verlangsamen den Lernprozess.

- Klare Aufteilung der Datensätze. Die Bilder müssen klar in Trainings-, Validierungs- und Testdatensätze unterteilt werden, ohne Überschneidungen zwischen ihnen.

- Keine doppelten Daten in den verschiedenen Aufteilungen. Doppelte oder nahezu identische Bilder in verschiedenen Aufteilungen führen zu irreführenden Auswertungsergebnissen und einem falschen Vertrauen in die Leistungsfähigkeit des Modells.

Empfohlene Aufteilung in Trainings-, Validierungs- und Testdaten

Eine typische Aufteilung eines Datensatzes sieht folgendermaßen aus:

Trainingsset

Üblicherweise 60 bis 80 Prozent des gesamten Datensatzes. Hier lernt das Modell Muster und Merkmale.

Validierungssatz

Typischerweise 10 bis 20 Prozent. Wird verwendet, um Hyperparameter zu optimieren und die Leistung während des Trainings zu überwachen.

Testset

Üblicherweise 10 bis 20 Prozent. Ausschließlich für die Endbewertung reserviert.

Der Testdatensatz sollte bis zum Schluss unberührt bleiben. Ihn zur Entscheidungsfindung während des Trainings zu nutzen, widerspricht seinem Zweck.

Vorverarbeitung und Normalisierung

Bilder müssen vor dem Training vorverarbeitet werden. Dies umfasst üblicherweise die Skalierung der Bilder auf eine feste Eingabegröße und die Normalisierung der Pixelwerte.

Durch die Normalisierung konvergiert das Modell schneller und verhält sich über verschiedene Bilder hinweg konsistenter, da die Eingabewerte in einem vorhersehbaren Bereich gehalten werden.

Eine mangelhafte Datensatzstruktur verursacht subtile Probleme, die später schwer zu beheben sind. Deshalb spart ein langsamerer Arbeitsschritt insgesamt Zeit.

Schritt 4: Sorgfältig beschriften und kommentieren

Die Qualität der Annotationen hat einen direkten Einfluss auf die Modellleistung. Modelle lernen keine Absichten, sondern Muster aus den Labels.

Bei Klassifizierungsaufgaben müssen die Bezeichnungen eindeutig sein. Wenn sich zwei Klassen inhaltlich überschneiden, wird das Modell Schwierigkeiten haben, egal wie fortschrittlich es ist.

Für die Objekterkennung und -segmentierung ist die Genauigkeit der Annotationen noch wichtiger:

- Die Begrenzungsrahmen sollten eng und gleichmäßig sein.

- Objekte sollten weder übersehen noch uneinheitlich beschriftet werden.

- Für Sonderfälle sollten klare Regeln befolgt werden.

Vor Beginn der großflächigen Beschriftung sollten Annotationsrichtlinien schriftlich festgehalten werden. Andernfalls werden verschiedene Bearbeiter dasselbe Bild unterschiedlich interpretieren.

KI-gestütztes Labeling kann den Prozess beschleunigen, aber die menschliche Überprüfung ist weiterhin unerlässlich. Kleine Annotationsfehler führen zu Rauschen, und dieses Rauschen summiert sich schnell. Wenn das Modell später verwirrt wirkt, liegt das Problem oft nicht an der Architektur, sondern an den Labels.

Schritt 5: Datenerweiterung zur Verbesserung der Generalisierung

Auch umfangreiche Datensätze profitieren von Datenaugmentation. Durch Datenaugmentation werden kontrollierte Variationen in die Trainingsdaten eingeführt, ohne dass zusätzliche Bilder gesammelt werden müssen. Dies hilft dem Modell, robustere visuelle Muster zu erlernen.

Gängige Techniken umfassen das Drehen oder Spiegeln von Bildern, das Anpassen des Maßstabs oder das Beschneiden von Bereichen, das Verändern von Helligkeit und Kontrast sowie das Hinzufügen von leichtem Rauschen oder Unschärfe. Jede dieser Änderungen setzt das Modell leicht unterschiedlichen visuellen Bedingungen aus, während die zugrundeliegende Bildstruktur erhalten bleibt.

Ziel ist es nicht, Bilder willkürlich zu verzerren. Die Datenaugmentation sollte vielmehr die Variationen simulieren, denen das Modell nach dem Einsatz voraussichtlich begegnen wird. Beispielsweise kann das Drehen medizinischer Bilder in manchen Kontexten sinnvoll sein, während das Spiegeln von Texterkennungsbildern deren Bedeutung zerstören würde. Was funktioniert, hängt vollständig vom jeweiligen Anwendungsbereich ab.

Bei durchdachter Anwendung reduziert die Datenaugmentation das Overfitting und verbessert die Fähigkeit eines Modells, auf Bilder zu generalisieren, die es noch nie zuvor gesehen hat.

Schritt 6: Wählen Sie eine Modellarchitektur, die zur Aufgabe passt.

Die Wahl des Modells ist wichtig, aber nicht so wichtig, wie viele annehmen. Ein gut trainiertes, einfacheres Modell ist einem schlecht trainierten, komplexen Modell oft überlegen.

Für die meisten Bilderkennungsaufgaben stellen Convolutional Neural Networks (CNNs) weiterhin die Basis dar. Architekturen wie ResNet und EfficientNet bieten hohe Leistungsfähigkeit und Flexibilität.

Wenn es auf Geschwindigkeit ankommt, insbesondere bei der Echtzeitdetektion, werden häufig Einzelbilddetektoren wie YOLO eingesetzt. Diese bieten jedoch höhere Geschwindigkeit und Einfachheit und opfern dafür etwas Genauigkeit.

Vision Transformers liefern hervorragende Ergebnisse bei großen, heterogenen Datensätzen, insbesondere bei hochauflösenden Bildern. Allerdings benötigen sie mehr Daten und Rechenleistung und sind daher nicht immer praktikabel.

In vielen Fällen ist Transferlernen die beste Option. Die Verwendung eines vortrainierten Modells spart Zeit und verbessert die Ergebnisse, insbesondere bei begrenzten Datenmengen mit annotierten Daten.

Schritt 7: Trainieren Sie das Modell mit gezielten Einstellungen

Training besteht nicht einfach nur aus dem Drücken des Startknopfes und Warten. Wie das Modell lernt, hängt von einer kleinen Anzahl von Parametern ab, die Stabilität, Geschwindigkeit und die endgültige Leistung direkt beeinflussen.

Kernparameter des Trainings, die das Lernen prägen

Während des Trainings wirken mehrere Einstellungen zusammen. Jede einzelne beeinflusst, wie sich das Modell selbst aktualisiert und auf Fehler reagiert.

Lernrate und Trainingsstabilität

Die Lernrate steuert, wie schnell das Modell seine internen Gewichte aktualisiert. Ist sie zu hoch eingestellt, wird das Training instabil und konvergiert möglicherweise nicht. Ist sie zu niedrig, verlangsamt sich das Lernen, und das Modell kann in schwachen Lösungen verharren, die sich nie wesentlich verbessern.

Losgröße und Ressourcenbalance

Die Batchgröße beeinflusst sowohl die Stabilität des Trainings als auch den Speicherverbrauch. Größere Batches führen tendenziell zu gleichmäßigeren Aktualisierungen, benötigen aber mehr Rechenressourcen. Kleinere Batches bringen mehr Varianz in die Aktualisierungen ein, was die Generalisierung mitunter fördern, aber auch die Konvergenz verlangsamen kann.

Epochenanzahl und Trainingsdauer

Die Anzahl der Epochen bestimmt die Dauer des Trainings. Zu wenige Epochen können dazu führen, dass das Modell unzureichend trainiert wird, während zu viele Epochen zu Überanpassung führen können, wenn sich die Leistung bei den Validierungsdaten nicht mehr verbessert.

Optimiererwahl und Konvergenzverhalten

Die Wahl des Optimierers beeinflusst, wie effizient das Modell die Verlustlandschaft bewältigt. Unterschiedliche Optimierer behandeln Gradienten, Momentum und Lerndynamik auf unterschiedliche Weise, was das Trainingsverhalten merklich verändern kann.

Überwachung von Trainings- und Validierungssignalen

Die Überwachung sowohl des Trainings- als auch des Validierungsverlusts ist während des gesamten Prozesses unerlässlich. Verbessert sich die Trainingsgenauigkeit kontinuierlich, während die Validierungsleistung stagniert oder abnimmt, liegt wahrscheinlich Überanpassung vor.

Hier zahlt sich Geduld aus. Wenn man jeweils nur einen Parameter anpasst, lässt sich leichter erkennen, was die Ergebnisse tatsächlich verbessert, anstatt durch die gleichzeitige Änderung mehrerer Variablen Verwirrung zu stiften.

Schritt 8: Regularisierung anwenden, um Überanpassung zu vermeiden

Überanpassung ist eines der häufigsten Probleme bei der Bilderkennung. Das Modell erzielt gute Ergebnisse mit den Trainingsdaten, versagt aber bei neuen Bildern.

Regularisierungstechniken helfen dabei, dies zu kontrollieren:

- Dropout zwingt das Modell dazu, sich auf mehrere Merkmale zu stützen.

- Die Strafen L1 und L2 verhindern, dass die Gewichte zu groß werden

- Durch frühzeitiges Stoppen wird das Training vor einer Überoptimierung beendet.

Diese Techniken sind keine Lösungen für fehlerhafte Daten. Sie sind Schutzmechanismen, die am besten funktionieren, wenn der Datensatz bereits solide ist.

Ein Modell, das gut generalisiert, wirkt während des Trainings oft weniger beeindruckend, schneidet aber dort besser ab, wo es darauf ankommt.

Schritt 9: Bewertung anhand der richtigen Kennzahlen

Genauigkeit allein sagt selten alles aus. Besonders bei unausgewogenen Datensätzen kann sie irreführend sein.

Eine bessere Bewertung umfasst:

- Präzision zum Verständnis von Fehlalarmen

- Erinnern Sie sich, um verpasste Erkennungen zu verstehen

- F1-Wertung, um beides auszugleichen

- Konfusionsmatrizen zur Identifizierung von Problemen auf Klassenebene

- AUC-ROC für binäre Klassifizierungsprobleme

Für die Objekterkennung sind Metriken wie Intersection over Union und Mean Average Precision unerlässlich.

Die Evaluierung sollte stets anhand von Daten erfolgen, die dem Modell unbekannt sind. Andernfalls vermitteln die Ergebnisse ein falsches Sicherheitsgefühl.

Schritt 10: Validierung unter realistischen Bedingungen

Offline-Metriken reichen nicht aus, um das Verhalten eines Bilderkennungsmodells nach dem Einsatz zu verstehen. Die Validierung muss in Umgebungen erfolgen, die dem realen Produktionseinsatz möglichst nahekommen.

Tests jenseits von Offline-Benchmarks

Realistische Validierung bedeutet oft, Inferenz auf Live-Kamerabildern oder Echtzeit-Datenströmen durchzuführen, anstatt auf statischen Testbildern. Sie kann auch das Testen des Modells auf verschiedenen Hardwarekonfigurationen umfassen, insbesondere bei der Bereitstellung auf Edge-Geräten mit begrenzten Ressourcen.

Die Bewertung der Leistung unter variierender Systemlast ist ebenso wichtig. Ein Modell, das isoliert betrachtet gut funktioniert, kann sich bei der Verarbeitung großer Datenmengen oder im Zusammenspiel mit anderen Diensten völlig anders verhalten. Die manuelle Überprüfung von Fehlerfällen in dieser Phase deckt häufig Muster auf, die automatisierte Metriken nicht erfassen.

Viele Probleme treten erst in dieser Phase auf. Latenzspitzen, Speicherengpässe und unerwartete Grenzfälle können das Verhalten des Modells in der Praxis verändern. Bei der Validierung weicht die theoretische Leistung dem realen Verhalten, und hier sind letzte Anpassungen oft am wichtigsten.

Schritt 11: Iterieren Sie auf der Grundlage von Beweisen, nicht von Annahmen.

Nur sehr wenige Modelle sind auf Anhieb korrekt. Iterationen sind daher zu erwarten.

Eine gute Iteration basiert auf Analysen:

- Überprüfung falsch positiver und falsch negativer Ergebnisse

- Fehlende Datenmuster identifizieren

- Etiketten oder Erweiterungsstrategien anpassen

- Feinabstimmung der Hyperparameter mit Bedacht

Das Hinzufügen weiterer Daten ist oft hilfreicher als die Optimierung von Architekturen. Dies gilt insbesondere für Daten, die Fehlerfälle repräsentieren. Iteration sollte Unsicherheit verringern, nicht Zufall einführen.

Schritt 12: Regelmäßiges Training und Weiterbildung

Bilderkennungsmodelle sind keine statischen Systeme. Umgebungen verändern sich, Sensoren entwickeln sich weiter, und die Anwendung in der Praxis bleibt selten unverändert. Ohne kontinuierliche Anpassung verlieren selbst leistungsstarke Modelle mit der Zeit an Genauigkeit.

Warum Wartung eine kontinuierliche Anforderung ist

Nach der Bereitstellung interagiert ein Modell mit neuen Datenmustern. Änderungen der Beleuchtung, des Wetters, der Kamerahardware oder des Nutzerverhaltens können das Aussehen der Bilder im Vergleich zum ursprünglichen Trainingsdatensatz verändern. Daher ist die kontinuierliche Wartung unerlässlich und nicht optional.

Leistung des Überwachungsmodells

Die kontinuierliche Leistungsüberwachung hilft, schleichende Genauigkeitsverluste aufzudecken, die möglicherweise keine sofortigen Warnmeldungen auslösen. Stille Leistungsverschlechterungen sind bei Bilderkennungssystemen häufig und bleiben ohne regelmäßige Überwachung oft unbemerkt.

Erhebung neuer und repräsentativer Daten

Da sich die Bedingungen ändern, müssen neue Daten erfasst und überprüft werden. Dies stellt sicher, dass der Trainingsdatensatz weiterhin die tatsächliche Nutzung widerspiegelt und nicht veraltete Annahmen.

Neutraining mit aktualisierten Datensätzen

Durch erneutes Training kann das Modell neue Beispiele integrieren und auftretende Schwächen korrigieren. Oft ist es effektiver, schrittweises Training durchzuführen, als abzuwarten, bis die Leistung deutlich nachlässt.

Prüfung von Verzerrungen und Datenabweichungen

Regelmäßige Prüfungen helfen, Verzerrungen, Klassenungleichgewichte und Datenabweichungen zu erkennen, die Vorhersagen schleichend verfälschen können. Die frühzeitige Behebung dieser Probleme gewährleistet die Zuverlässigkeit des Modells in verschiedenen Umgebungen und Populationen.

Teams, die von Anfang an auf Nachschulungen setzen, entwickeln tendenziell langlebige Systeme. Anstatt auf Fehler zu reagieren, betrachten sie die Bilderkennung als einen lebendigen Prozess, der sich anhand der gewonnenen Erkenntnisse stetig verbessert.

Abschließende Gedanken

Beim Training eines Bilderkennungsmodells geht es nicht darum, Perfektion anzustreben. Es geht darum, ein System zu entwickeln, das zuverlässig lernt, sich im Laufe der Zeit anpasst und sich in der realen Welt vorhersagbar verhält.

Starke Ergebnisse basieren auf gut umgesetzten Grundlagen: sorgfältiger Datenerhebung, präziser Kennzeichnung, vernünftiger Modellauswahl und ehrlicher Bewertung.

Wenn diese Teile vorhanden sind, muss das Modell nicht auffällig sein. Es muss einfach nur funktionieren.

Und wenn es funktioniert, funktioniert es in der Regel auch weiterhin, selbst wenn sich die Bedingungen ändern.

Häufig gestellte Fragen

Der Zeitrahmen hängt vom Umfang der Aufgabe, der Größe und Qualität des Datensatzes sowie der Verwendung vortrainierter Modelle ab. Einfache Klassifizierungsmodelle lassen sich innerhalb von Tagen oder Wochen trainieren, während komplexere Systeme zur Objekterkennung oder -segmentierung oft mehrere Wochen bis Monate benötigen, wenn Datenaufbereitung, Validierung und Iterationen einbezogen werden.

Es gibt keine festgelegte Anzahl. Manche Modelle erzielen mit einigen Tausend hochwertigen Bildern gute Ergebnisse, insbesondere beim Transferlernen. Andere benötigen Zehntausende oder Hunderttausende von Bildern, um zuverlässig zu generalisieren. Wichtiger als die Datenmenge ist, ob die Daten reale Bedingungen und Grenzfälle widerspiegeln.

Nein. In den meisten Fällen ist die Verwendung eines vortrainierten Modells die bessere Option. Transferlernen verkürzt die Trainingszeit, verbessert die Leistung bei begrenzten Daten und senkt die Infrastrukturkosten. Das Training von Grund auf ist in der Regel hochspezialisierten Bereichen oder sehr großen Datensätzen vorbehalten.

Mangelhafte Datenqualität ist das häufigste Problem. Inkonsistente Labels, fehlende Grenzfälle, unrealistische Trainingsbilder oder Datenlecks zwischen Datensätzen verursachen oft größeren Schaden als die Modellwahl oder die Hyperparameter-Einstellungen.

Überanpassung tritt üblicherweise dann auf, wenn sich die Trainingsleistung zwar stetig verbessert, die Validierungsleistung jedoch stagniert oder sogar abnimmt. Dies deutet darauf hin, dass das Modell die Trainingsdaten zu genau lernt und nicht in der Lage ist, auf neue Bilder zu generalisieren.