OpenClaw ist nicht einfach nur eine weitere Chat-Oberfläche mit einem schicken Namen. Es ist vielmehr eine Steuerungsebene für KI-Agenten, die Dateien lesen, Tools aufrufen und innerhalb Ihrer bestehenden Anwendungen reagieren können. Genau diese Leistungsfähigkeit ist der Kern der Sache. Deshalb sollten Sie es auch nicht unterschätzen. Wenn Sie es wie ChatGPT mit einem anderen Logo betrachten, werden Sie seinen Nutzen nicht erkennen. Wenn Sie es hingegen als Infrastruktur betrachten, werden Sie sein volles Potenzial ausschöpfen.

Wie OpenClaw Chat in Aktion umsetzt

OpenClaw ist mehr als nur eine Chat-Oberfläche mit Add-ons. Es fungiert als lokales Gateway, das Ihre Chat-Plattform, Ihr KI-Modell und Ihre Aktionsschicht zu einem kontrollierten System verbindet. Es integriert Tools wie Telegram oder Slack, verbindet sich mit einem lokal über Ollama oder über einen Cloud-Anbieter wie OpenAI oder Anthropic laufenden Modell und verwaltet Dateizugriff, APIs und Skriptausführung über einen persistenten lokalen Speicher. Der gesamte Datenverkehr läuft über dieses zentrale Gateway.

In der Praxis geht eine Nachricht über den Chat ein, der Agent wertet sie aus, ruft optional ein Tool auf und gibt ein strukturiertes Ergebnis zurück. Er kann Protokolle lesen, Fehler zusammenfassen, Tickets erstellen, CRM-Datensätze aktualisieren oder vordefinierte Skripte ausführen. Der Kontext bleibt sitzungsübergreifend erhalten, wodurch OpenClaw zu einer operativen Ebene und nicht nur zu einem weiteren Assistenten wird.

FlyPix KI und KI-Automatisierung in der Praxis

Bei FlyPix AI, Wir setzen KI-Systeme in einem anderen Bereich ein, das Prinzip ist jedoch ähnlich. Automatisierung schafft nur dann Mehrwert, wenn sie direkt mit realen Betriebsdaten verknüpft ist. Unsere Plattform konzentriert sich auf Satelliten-, Luft- und Drohnenbilder, auf denen KI-Modelle Objekte in großem Umfang erkennen, überwachen und untersuchen. Anstelle manueller Annotationen automatisieren wir die Geodatenanalyse mit Modellen, die darauf trainiert sind, Objekte präzise zu identifizieren und zu umreißen.

Wir haben das System von Anfang an praxisorientiert gestaltet. Nutzer können ohne tiefgreifende Programmierkenntnisse eigene KI-Modelle trainieren, eigene Annotationen definieren und diese branchenübergreifend einsetzen, beispielsweise im Bauwesen, in der Landwirtschaft, bei der Instandhaltung von Infrastrukturen und in öffentlichen Projekten. Im Fokus steht nicht abstrakte Intelligenz, sondern messbare Effizienz in komplexen visuellen Umgebungen.

FlyPix AI finden Sie auch auf LinkedIn Wenn Sie dort mit uns in Kontakt treten möchten. Für unser Unternehmen geht es bei KI nicht um Experimente. Es geht darum, visuelle Daten in strukturierte Ergebnisse umzuwandeln, die Teams im realen Arbeitsalltag sicher nutzen können.

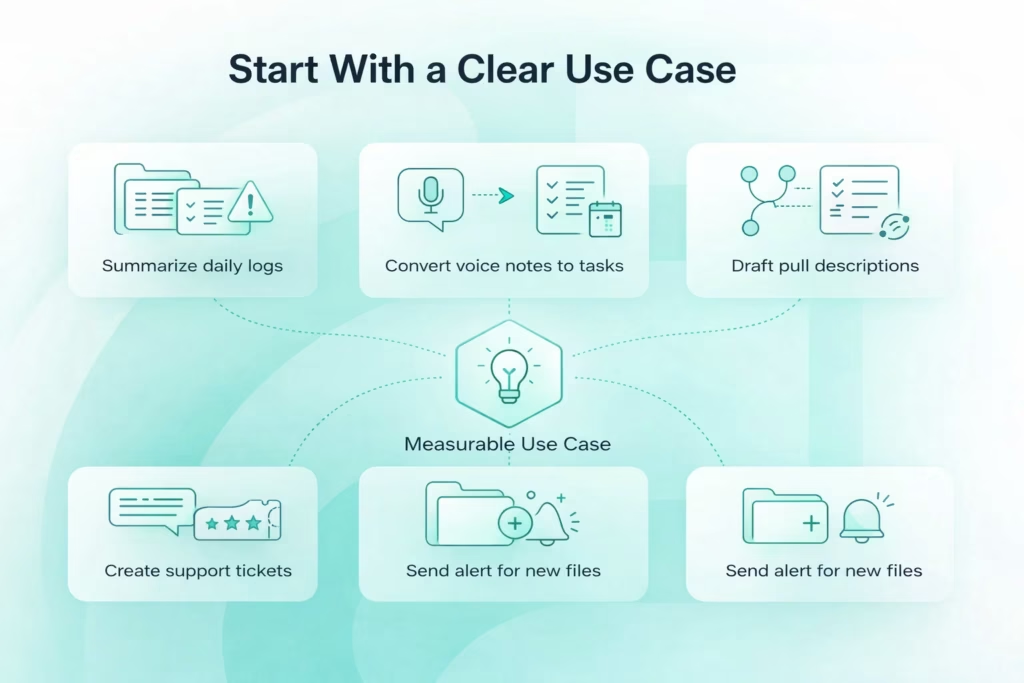

Beginnen Sie mit einem klaren Anwendungsfall

Der größte Fehler, den viele bei OpenClaw machen, ist ganz einfach: Sie installieren es und denken erst später darüber nach. Wenn das System läuft, der Zweck aber unklar ist, verstellt man sich in den Einstellungen, anstatt ein echtes Problem zu lösen. Definieren Sie vor jeder Installation einen messbaren Anwendungsfall. Dieser sollte so spezifisch sein, dass Sie klar feststellen können, ob es funktioniert oder nicht. Sinnvolle erste Ziele sehen in der Regel so aus:

- Fassen Sie die täglichen Protokolle eines bestimmten Ordners zusammen und heben Sie den letzten kritischen Fehler hervor.

- Telegram-Sprachnachrichten in strukturierte Aufgaben mit Titel und Frist umwandeln

- Entwurf von Pull-Request-Beschreibungen unter Verwendung des Repository-Kontexts und der letzten Commits

- Erstellen Sie Support-Tickets aus strukturierten Chat-Eingaben mit Prioritätsstufen

- Überwachen Sie einen Ordner und senden Sie eine Benachrichtigung, wenn neue Dateien erscheinen.

Jedes Beispiel hat einen klaren Auslöser, definierte Eingaben und beobachtbare Ausgaben. Diese Struktur sorgt für eine fokussierte Einrichtung und vermeidet unnötige Komplexität. Beginnen Sie mit einem kleinen Fokus. Ist das Ziel vage, verbringen Sie mehr Zeit mit der Optimierung der Architektur als mit der Wertschöpfung. OpenClaw funktioniert am besten, wenn es an einen messbaren Workflow gebunden ist. Sobald dieser Workflow stabil ist, erfolgt die Erweiterung gezielt statt experimentell.

Bereiten Sie Ihr System für OpenClaw vor

Eine stabile OpenClaw-Installation beginnt bereits vor dem Ausführen des Installationsprogramms. Es handelt sich hierbei nicht um ein einfaches Chat-Plugin, sondern um ein lokales Gateway, das Dateien lesen, Tools ausführen und Verbindungen zu externen Modellen herstellen kann. Ihr Rechner, Ihr Netzwerk und Ihre Berechtigungen sind Teil des Systems. Ein paar Minuten Vorbereitung ersparen Ihnen später stundenlange Fehlersuche.

Sie benötigen mindestens die neueste LTS-Version von Node.js, ein Terminal Ihrer Wahl und entweder einen Cloud-Modell-API-Schlüssel von OpenAI oder Anthropic oder Ollama, falls Sie ein lokales Modell ausführen möchten. Telegram bietet die einfachste Oberfläche für erste Tests. Planen Sie Ihre Hardwareanforderungen realistisch, wenn Sie lokal arbeiten. 16 Gigabyte RAM sind eine gute Basis für stabile Leistung. Größere Modelle benötigen mehr.

Ihre Umgebung ist wichtig. Installieren Sie OpenClaw nicht unbedacht auf einem Firmenlaptop. Geben Sie keine Ports öffentlich frei, nur um es sich bequemer zu machen. Vermeiden Sie die Ausführung mit erhöhten Rechten, es sei denn, dies ist absolut notwendig. OpenClaw liest lokale Dateien und führt Aktionen aus. Das ist seine Stärke. Behandeln Sie es mit der gleichen Sorgfalt wie jedes andere System, das direkten Zugriff auf Ihre Daten hat.

OpenClaw-Installation und Ersteinrichtung

OpenClaw entwickelt sich rasant, daher ist es am sichersten, sich an den offiziellen Installationsablauf zu halten. Das Ziel ist einfach: Das Gateway soll reibungslos und zuverlässig funktionieren. Noch keine Experimente, keine individuellen Anpassungen. Nur eine stabile Basis.

1. Wählen Sie Ihre Installationsmethode

Je nach verwendeter Distribution installieren Sie OpenClaw entweder über ein Bootstrap-Skript oder via npm. Beide Methoden verfolgen dasselbe Ziel: die Installation der Abhängigkeiten und die Registrierung des Gateway-Dienstes. Der typische Bootstrap-Ablauf sieht folgendermaßen aus:

| curl -fsSL https://openclaw.ai/install.sh | bash |

Falls Sie npm bevorzugen, ist der globale Installationspfad unkompliziert:

| npm install -g openclaw@latest |

Beide Methoden sollten nicht kompliziert sein. Falls bei der Installation Fehler auftreten, brechen Sie ab und beheben Sie diese, bevor Sie fortfahren. Eine saubere Installation ist wichtiger als die Geschwindigkeit.

2. Führen Sie den Onboarding-Prozess durch.

Führen Sie nach der Installation den Onboarding-Assistenten aus:

| Openclaw an Bord |

Dieser Schritt konfiguriert das Gateway und richtet es als Hintergrunddienst ein. Nach Abschluss des Vorgangs sollte das System melden, dass das Gateway aktiv ist. OpenClaw ist nun nicht nur installiert, sondern betriebsbereit.

3. Zugriff auf die Steuerungs-UI

Standardmäßig läuft die Steuerungsoberfläche (Dashboard) lokal unter:

| http://127.0.0.1:18789/ (oder http://localhost:18789/) |

Öffnen Sie diese Adresse in Ihrem Browser. Wenn alles korrekt konfiguriert ist, sollte das Dashboard angezeigt werden. Falls es nicht geladen wird, überprüfen Sie Folgendes:

- Prüfen Sie, ob der Gateway-Dienst ausgeführt wird.

- Stellen Sie sicher, dass kein anderer Prozess Port 18789 verwendet.

- Lokale Firewall-Einstellungen überprüfen

Eine wichtige Regel: Das Gateway muss an localhost gebunden sein. Es darf nicht öffentlich zugänglich gemacht werden. Die Steuerungsoberfläche verwaltet einen Agenten, der auf lokale Dateien zugreifen und Tools ausführen kann. Durch die Beschränkung des Zugriffs auf 127.0.0.1 bleibt die Steuerungsoberfläche während der Entwicklungs- und Testphase sicher.

Einrichtung der Telegram-Integration

Telegram ist eine der schnellsten Möglichkeiten, OpenClaw zu aktivieren. Die Einrichtung ist einfach, die API lässt sich leicht bereitstellen, und Sie können die gesamte Nachrichtenverarbeitung innerhalb weniger Minuten überprüfen. Es eignet sich ideal für erste Tests, wenn der Fokus auf der Agentenlogik und nicht auf dem Integrationsaufwand liegt.

Öffne Telegram, suche nach @BotFather und gib /newbot ein. Wähle einen Namen und kopiere das bereitgestellte API-Token. Füge dieses Token während des OpenClaw-Onboardings ein, wenn du dazu aufgefordert wirst. Nach dem Speichern verbindet das Gateway deinen lokalen Agenten mit Telegram. Genauigkeit ist hierbei entscheidend. Ein einziges falsches Zeichen kann die Verbindung unterbrechen.

Senden Sie nach der Einrichtung eine Testnachricht an Ihren Bot und überprüfen Sie die Benutzeroberfläche. Wenn die Nachricht angezeigt wird und eine Antwort an Telegram zurückkommt, funktioniert die Schleife. Dies bestätigt, dass Gateway, Modell und Kommunikationsschicht zusammenarbeiten. Nun können Sie von der Einrichtung zur Erstellung realer Arbeitsabläufe übergehen.

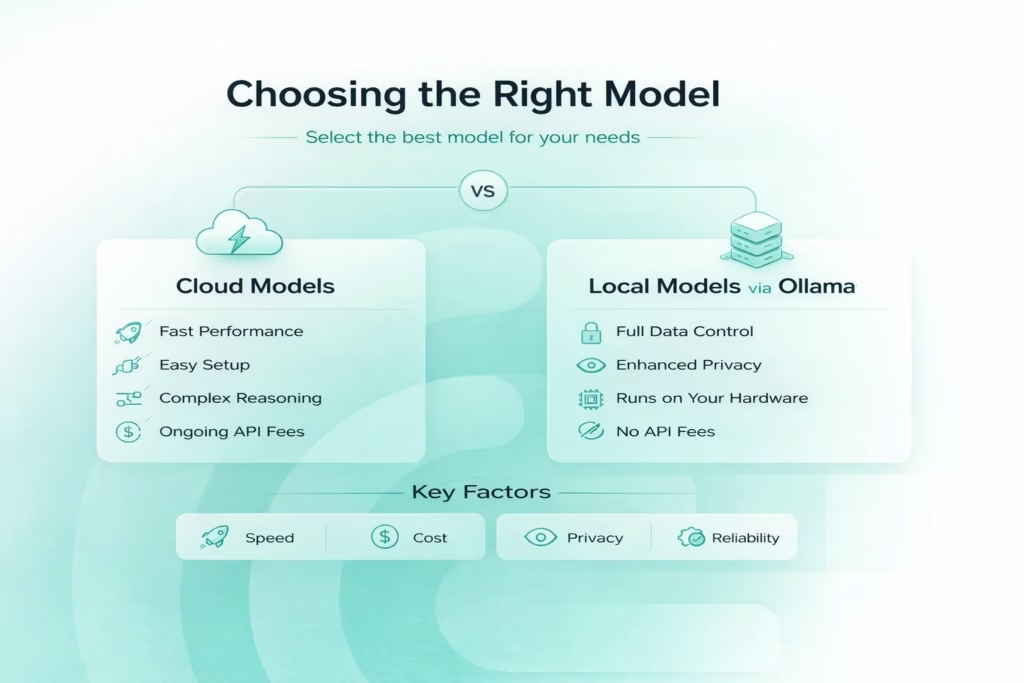

Das richtige Modell auswählen

Die Wahl des richtigen Modells beeinflusst direkt Geschwindigkeit, Kosten, Datenschutz und die allgemeine Zuverlässigkeit. OpenClaw bindet Sie nicht an einen einzelnen Anbieter, was ein Vorteil ist. Flexibilität ist jedoch nur dann von Nutzen, wenn Sie die damit verbundenen Kompromisse verstehen. Es gibt zwei Hauptwege: Cloud-Modelle und lokale Modelle. Jeder Weg erfüllt unterschiedliche betriebliche Anforderungen.

1. Cloud-Modelle – Schnell, leistungsstark, reibungsarm

Cloud-Modelle bieten den schnellsten Weg zu hoher Leistung bei der Datenverarbeitung, ohne dass Sie sich um die Hardware kümmern müssen. Sie verbinden einen API-Schlüssel, konfigurieren den Anbieter, und der Agent ist einsatzbereit. Cloud-Modelle eignen sich typischerweise am besten für:

- Komplexes Denken und strukturierte Entscheidungsfindung

- Programmierabläufe und Debugging

- Schnelle Einrichtung mit minimaler Konfiguration

- Teams, die die Infrastruktur nicht verwalten wollen

Modelle wie Claude 3.5 Sonnet und Systeme der GPT-4-Klasse verarbeiten agentenbasierte Arbeitsabläufe mit hoher Zuverlässigkeit. Sie interpretieren Anweisungen klar, bewältigen mehrstufige Schlussfolgerungen gut und reagieren schnell. Die damit verbundenen Kompromisse sind offensichtlich:

- Laufende API-Kosten

- Die Daten werden außerhalb Ihrer lokalen Umgebung übertragen.

- Abhängigkeit von externer Verfügbarkeit

Für viele Nutzer ist dies akzeptabel. Für andere, insbesondere in sensiblen Umgebungen, ist es das möglicherweise nicht.

2. Lokale Modelle über Ollama – Kontrolle und Eindämmung

Wenn Datenschutz und Autonomie wichtig sind, ist die Ausführung eines lokalen Modells über Ollama eine logische Wahl. In dieser Konfiguration verbleibt das Modell auf Ihrem Rechner. Es finden keine externen API-Aufrufe statt. Es verlassen Ihr Netzwerk nicht. Es eignet sich besonders für:

- Datensensible Arbeitsabläufe

- Entwicklungsumgebungen

- Offline-Fähigkeit

- Volle Kontrolle über die Ausführung

Ollama unterstützt Modelle wie Qwen2.5-Coder, die GLM-4-Serie, Varianten von Llama 3.1/3.2 und andere Modelle mit großen Kontextfenstern, die für Agenten geeignet sind. Für OpenClaw ist die Kontextgröße relevant.

Der Agent nutzt das Kontextfenster des Modells zur Speicherverwaltung; kleinere Fenster können daher die Konsistenz in längeren Sitzungen beeinträchtigen. Ein Kontextfenster von 32.000 bis 128.000 Byte stellt eine praktikable Basis für stabiles Schließen dar (abhängig vom Modell; viele empfohlene Ollama-Modelle für OpenClaw beginnen bei 32.000 bis 128.000 Byte).

Die Leistung hängt von Ihrer Hardware ab. Langsame Reaktionszeiten oder verzögerte Tool-Aufrufe deuten in der Regel auf Ressourcenengpässe und nicht auf einen Konfigurationsfehler hin. Entscheidend ist die Wahl eines Modells, das zu Ihrem verfügbaren Arbeitsspeicher und Ihrer Rechenleistung passt.

3. Die praktische Entscheidung treffen

Es gibt keine allgemeingültige Antwort. Manche Teams nutzen Cloud-Modelle für komplexe Analysen und lokale Modelle für die Entwicklung oder sensible Aufgaben. Andere setzen vollständig auf einen Ansatz. Die Wahl sollte auf folgenden Kriterien basieren:

- Sensibilität Ihrer Daten

- Leistungsanforderungen

- Budgetbeschränkungen

- Hardwarekapazität

Das richtige Modell verbessert nicht nur die Reaktionszeiten, sondern stabilisiert den gesamten Workflow. Wenn die Modellebene Ihren betrieblichen Anforderungen entspricht, arbeitet OpenClaw vorhersehbar und effizient.

Das Verständnis des persistenten Gedächtnisses

Die persistente Speicherung ist eines der Merkmale, die OpenClaw von herkömmlichen Chat-Assistenten abheben. Anstatt jedes Mal von vorn zu beginnen, speichert es persistente Daten lokal mithilfe von SQLite zur Indizierung, segmentierten Markdown-Dateien als zentralem Datenspeicher und einer hybriden Suche (BM25 + Vektoreinbettungen). Dies ist mehr als nur ein Chatprotokoll. Es handelt sich um einen strukturierten Kontext, auf den der Agent später bei Entscheidungen zurückgreifen kann.

Sie könnten dem Agenten beispielsweise mitteilen: “Mein internes Dashboard verwendet React und Tailwind. Bevorzugt werden funktionale Komponenten.” Einige Tage später bitten Sie ihn, eine Header-Komponente zu erstellen. Funktioniert der Speicher korrekt, wendet er diese vorherigen Einstellungen automatisch an, ohne dass Sie sie wiederholen müssen. Diese Kontinuität entsteht dadurch, dass der gespeicherte Kontext in den Denkprozess zurückfließt.

Hier entsteht mit der Zeit Effizienz. Anstatt Anweisungen in jeder Sitzung neu zu schreiben, wird ein dauerhafter Kontext im System gespeichert. Es empfiehlt sich, den gespeicherten Speicher gelegentlich zu überprüfen, um zu sehen, was gespeichert wird. Wenn Sie verstehen, wie der Speicher funktioniert, bleibt der Agent konsistent und vorhersehbar, auch wenn Ihre Arbeitsabläufe wachsen.

Erstellen Ihres ersten echten Workflows

Sobald die Verbindung stabil ist, kann die Kommunikation in die Ausführung übergehen. OpenClaw erweist sich als besonders praktisch, wenn strukturierte Aufgaben ausgeführt werden und nicht nur offene Fragen beantwortet werden. Dazu ist ein klar definierter Workflow erforderlich, damit der Agent weiß, was zu tun ist und wie er das Ergebnis bestätigen kann. Ein zuverlässiger Workflow umfasst stets vier Komponenten:

- Auslösen: Der konkrete Befehl oder das Ereignis, das den Prozess auslöst, wie zum Beispiel die Eingabe von “new ticket” in Telegram.

- Eingabestruktur: Die genauen Daten, die der Agent zur Erledigung der Aufgabe benötigt, zum Beispiel Titel, Beschreibung und Dringlichkeitsgrad.

- Werkzeugausführung: Die vom Agenten ausgeführte Aktion, wie beispielsweise das Senden einer Anfrage an die API Ihres Ticketsystems.

- Bestätigungsausgabe: Eine strukturierte Antwort, die den Abschluss belegt, z. B. die Rückgabe der Ticket-ID und einer kurzen Zusammenfassung.

Nehmen wir die Ticketautomatisierung als einfaches Beispiel. Wenn Sie “Neues Ticket” eingeben, erfasst der Agent die erforderlichen Felder, ruft die API auf und sendet eine Bestätigung. Kein Rätselraten, keine Annahmen. Klare Auslöser und strukturierte Eingaben gewährleisten einen zuverlässigen Prozess. Beginnen Sie mit einem fokussierten Workflow, optimieren Sie ihn und erweitern Sie ihn dann gezielt.

OpenClaw in realen Umgebungen betreiben

Sobald Ihr erster Workflow stabil läuft, beginnt die eigentliche Nutzung. An diesem Punkt entscheidet sich, ob OpenClaw Teil Ihrer täglichen Abläufe wird oder ein technisches Experiment bleibt. Der Unterschied liegt nicht in der Hinzufügung weiterer Automatisierungen, sondern darin, zu beobachten, wie sich der bestehende Prozess unter realen Bedingungen verhält. Lassen Sie ihn laufen. Testen Sie ihn mit verschiedenen Eingaben. Beobachten Sie, wie er mit Sonderfällen umgeht, bevor Sie ihn erweitern.

Im täglichen Gebrauch ist Transparenz entscheidend. Überprüfen Sie die Aktivitäten in der Steuerungsoberfläche. Prüfen Sie, welche Tools ausgelöst werden und wie die Ausgaben strukturiert sind. Wenn die Ergebnisse inkonsistent erscheinen, liegt die Ursache meist in einer Abweichung vom Anwendungsbereich oder unklaren Anweisungen und nicht in Modellbeschränkungen. Kleine Strukturverbesserungen führen oft zu mehr Stabilität als eine Änderung des Modells selbst.

Die Erweiterung sollte wohlüberlegt erfolgen. Neue Aufgaben sollten schrittweise hinzugefügt und von bestehenden Prozessen isoliert werden, bis sie vorhersehbar sind. OpenClaw erzielt die besten Ergebnisse, wenn Workflows klar abgegrenzt sind und der Speicherverbrauch gering bleibt. Im täglichen Einsatz geht es nicht um ständiges Experimentieren, sondern um die kontrollierte Skalierung eines KI-Systems, das Sie verstehen und sicher steuern können.

Praktische Tipps und häufige Fehler, die Sie vermeiden sollten

OpenClaw kann monatelang reibungslos laufen oder sich zu einer ständigen Fehlersuche entwickeln. Der Unterschied liegt meist in der Disziplin. Die meisten Probleme entstehen nicht durch das Modell selbst, sondern durch Fehlentscheidungen bei der Konfiguration, unklare Abgrenzungen oder übersehene Grenzen. Im Folgenden werden die häufigsten Fallstricke und Leistungsgewohnheiten beschrieben, die stabile von instabilen Implementierungen unterscheiden.

Zu vermeidende operative Fehler

Dies sind Muster, die in realen Anwendungen immer wieder auftreten. Sie führen zwar möglicherweise nicht sofort zum Systemausfall, bergen aber mit der Zeit Risiken und Instabilität.

- Installation auf einem Firmengerät ohne Genehmigung: OpenClaw liest lokale Dateien und kann Daten an externe Modelle senden, was gegen interne Richtlinien verstoßen kann.

- Proprietären Code ohne Überprüfung in Cloud-Modelle einspeisen: Die Übertragung sensibler Daten über APIs kann zu Compliance- und Sicherheitsbedenken führen.

- Uneingeschränkten Dateisystemzugriff gewähren: Der Makler sollte nur dann Zugriff auf Ihr gesamtes Adressbuch haben, wenn dies unbedingt erforderlich ist.

- Zur Vereinfachung den Gateway-Port freigeben: Die öffentliche Öffnung von Port 18789 vergrößert die Angriffsfläche ohne wirklichen Nutzen.

- Das Gedächtnis als unfehlbar betrachten: Der persistente Speicher ist zwar leistungsstark, kann aber veraltete oder falsche Inhalte speichern, wenn er nicht regelmäßig überprüft wird.

- Den ersten Arbeitsablauf unnötig verkomplizieren: Der Einsatz einer mehrstufigen Automatisierung anstelle einer einfachen Aufgabe erhöht die Wahrscheinlichkeit von Konfigurationsfehlern.

Das Leitprinzip ist einfach: Den Umfang eng halten, die Berechtigungen einschränken und erst dann schrittweise erweitern, wenn die Stabilität nachgewiesen ist.

Leistungs- und Stabilitätsoptimierung

Wenn die Performance unbeständig erscheint, liegt die Ursache oft eher in der Struktur als in mysteriösen Details. OpenClaw ist abhängig von der Modellkapazität, dem Speichermanagement und der Klarheit der Eingabeaufforderung. Kleine Anpassungen bewirken in der Regel einen spürbaren Unterschied.

- Modellgröße bei lokaler Ausführung reduzieren: Größere Modelle benötigen mehr Speicher und Rechenleistung, was die Latenz erhöht.

- Erhöhen Sie nach Möglichkeit den verfügbaren Arbeitsspeicher: Lokales Schließen verbessert sich, wenn das System über ausreichend Spielraum verfügt.

- Übermäßigen Speicherverbrauch reduzieren: Langlaufende Sitzungen mit großem gespeichertem Kontext können die Verarbeitung verlangsamen.

- Werkzeugaufrufschleifen begrenzen: Wiederholte oder verschachtelte Tool-Aufrufe können unnötige Verzögerungen verursachen.

- Verwenden Sie strukturierte Anweisungen anstelle von offenen Anweisungen: Eine übersichtliche Eingabe reduziert den Tokenverbrauch und verbessert die Antwortgenauigkeit.

Die Leistung verbessert sich, wenn Anweisungen präzise definiert und Ressourcen an die Arbeitslast angepasst werden. OpenClaw erfordert keine ständige Optimierung, sondern eine sorgfältige Konfiguration und realistische Erwartungen. Sind diese gegeben, bleibt das System effizient und zuverlässig.

Schlussfolgerung

OpenClaw entfaltet sein volles Potenzial erst, wenn man es nicht mehr wie einen Chatbot, sondern wie eine Infrastruktur behandelt. Es geht nicht um clevere Antworten, sondern um kontrollierte Ausführung. Definiert man ein klares Ziel, konfiguriert das Gateway korrekt, wählt das passende Modell und strukturiert den ersten Workflow sorgfältig, fühlt sich das System weniger experimentell und mehr betriebsbereit an.

Der Schlüssel liegt in der Disziplin. Halten Sie den Umfang anfangs klein. Schützen Sie Ihre Umgebung. Entwickeln Sie einen zuverlässig funktionierenden Workflow und erweitern Sie ihn dann. OpenClaw belohnt Klarheit. Je klarer Ihre Eingaben und Berechtigungen sind, desto vorhersehbarer werden die Ergebnisse. Richtig eingesetzt, ist es nicht nur eine Messaging-Schicht mit angehängten Tools. Es ist eine steuerbare KI-Ausführungsschicht, die sich in reale Arbeitsabläufe integrieren lässt. Genau darin liegt der Mehrwert.

Häufig gestellte Fragen

Die Installation selbst ist unkompliziert, wenn man den offiziellen Anweisungen folgt. Die meisten Schwierigkeiten entstehen durch unklare Ziele, nicht durch technische Komplexität. Wenn man vor der Installation einen konkreten Arbeitsablauf festlegt, verläuft die Einrichtung deutlich reibungsloser.

Ja, wenn Sie ein lokales Modell über Ollama verwenden. In dieser Konfiguration laufen Modell und Gateway auf Ihrem Rechner. Externe API-Aufrufe sind nicht erforderlich. Beachten Sie, dass die Leistung von Ihrer Hardwarekapazität abhängt.

Das hängt von den Richtlinien Ihres Unternehmens ab. OpenClaw kann lokale Dateien lesen und mit externen Modellen interagieren. Die Installation auf einem Firmenrechner ohne Genehmigung kann gegen interne Sicherheitsbestimmungen verstoßen. Es empfiehlt sich daher, einen privaten Rechner oder eine dedizierte Umgebung zu verwenden.

Beginnen Sie mit messbaren und risikoarmen Aufgaben, wie dem Zusammenfassen von Protokollen, dem Verfassen strukturierter Nachrichten oder dem Erstellen von Tickets. Vermeiden Sie anfangs komplexe, mehrstufige Automatisierungen. Stabilität ist in dieser Phase wichtiger als ambitionierte Ziele.

Der persistente Speicher ermöglicht es dem Agenten, den Kontext über Sitzungen hinweg beizubehalten, was die Kontinuität verbessert. Größere Kontextfenster und lange Sitzungen können jedoch den Ressourcenverbrauch erhöhen, insbesondere bei lokalen Modellen. Die regelmäßige Überprüfung des gespeicherten Speichers trägt zur Aufrechterhaltung von Übersichtlichkeit und Effizienz bei.